在网络爬虫的开发和使用中,遵守目标网站的爬虫政策是至关重要的。其中,robots.txt文件是网站与爬虫之间沟通的重要桥梁。

1. robots.txt文件简介

robots.txt是一个放置在网站服务器上的文本文件,用来告知网络爬虫哪些页面可以抓取,哪些页面不可以抓取。这个文件是网站所有者对爬虫行为的明确指示,遵守这个文件的规定是网络爬虫合法合规操作的基础。

一般robots.txt怎么找到呢?在网址后面添加robots.txt即可实现跳转访问

例如:https://www.baidu.com/robots.txt

2. robots.txt文件的结构

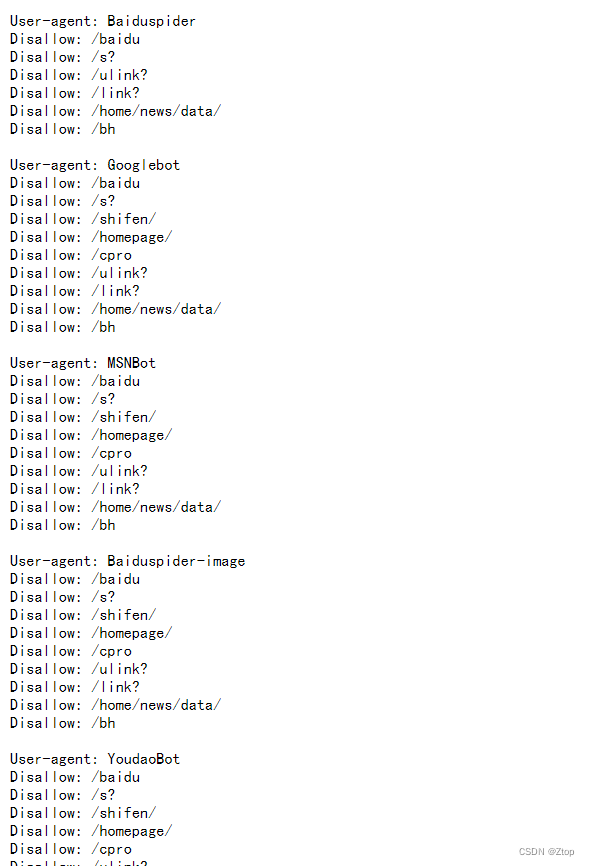

一个典型的robots.txt文件包含以下两个主要部分:

-

User-agent:指定规则适用于哪些爬虫。常见的User-agent包括Googlebot、Bingbot等,也可以使用*来匹配所有爬虫。

-

Disallow:指出不希望被爬虫访问的网页路径。可以是具体的页面,也可以是目录或者使用通配符。

以下是一个robots.txt文件的示例:

User-agent: *

Disallow: /private/

Disallow: /secret/

这个示例表示所有爬虫

订阅专栏 解锁全文

订阅专栏 解锁全文

602

602

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?