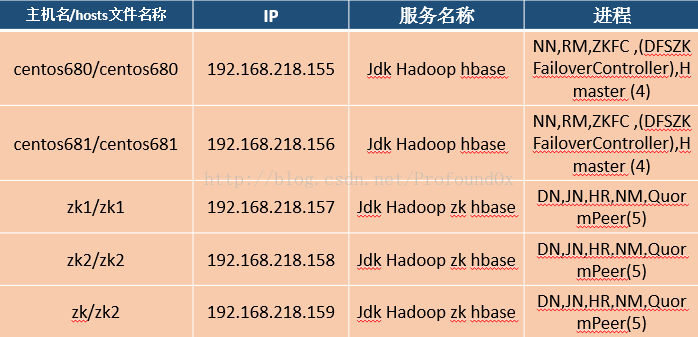

- 在真正进行安装前,我们先对全局节点进行一个整理,具体如下:

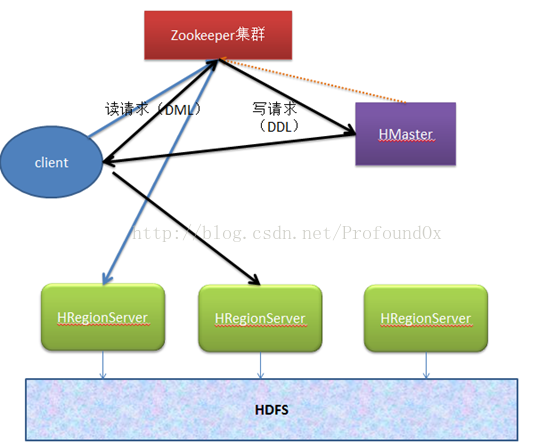

- 大体配置思路:指定hdfs(由于hbase依赖于hdfs,因此只开启hdfs即可。可以不需要开启yarn),指定ZooKeeper,指定regionserver。

- 各节点组件划分如下下图所示:

- 安装的Hbase的前提是ZooKeeper和hadoop的集群已经搭建完毕。(ZooKeeper和hadoop具体安装细节细节可以点击这里查看)同时意味着防火墙、JDK、SSH免密登陆已经完成。

- 以下操作都在centos680上完成。

- 拷贝hbase-1.2.4-bin.tar.gz文件包到/opt(自己指定目录,一般自定义软件安装在/opt下),并解压到指定文件夹下:tar -zxvf hbase-1.2.4-bin.tar.gz -C /opt/bigdata/。

- 修改配置文件(在/opt/bigdata/hbase-1.2.4/conf/下)

- hbase-env.sh

export JAVA_HOME=/usr/java

export HBASE_MANAGES_ZK=false

-

-

- hbase-site.xml

-

<property>

<name>hbase.rootdir</name>

<value>hdfs://ns/hbase</value>

</property>

<property>

<name>hbase.cluster.distributed</name>

<value>true</value>

</property>

<property>

<name>hbase.zookeeper.quorum</name>

<value>zk1:2181,zk2:2181,zk3:2181</value>

</property>

-

-

- regionservers

-

zk1

zk2

zk3

-

- 复制hdfs的相关配置文件到hbase的conf目录下(假定当前位置是hbase的conf 目录),执行如下命令:

cp /opt/bigdata/hadoop-2.7.3/etc/hadoop/core-site.xml /opt/bigdata/hadoop-2.7.3/etc/hadoop/hdfs-site.xml .(

注意:这里有一个点,不要丢弃。)

-

- 复制配置好的Hbase到其他机器上:

- scp -r /opt/bigdata/hbase-1.2.4/ node2:/opt/bigdata/

- scp -r /opt/bigdata/hbase-1.2.4/ node3:/opt/bigdata/

- 启动

- 到zk1,zk2,zk3上启动ZooKeeper(/opt/bigdata/zookeeper-3.4.9/bin/zkServer.sh start)

- 在centos680上启动hdfs(start-dfs.sh)

- 同时在centos680上启动Hbase(start-hbase.sh--在hbase bin目录下)

- 开启Hbase的HA,在centos681上执行(start-hbase.sh)

- 校验HA是否启动成功。

- 首先查看各节点进程。

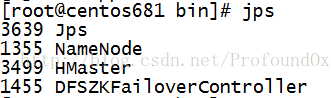

- centos680(我这里将yarn开启了)

- centos681

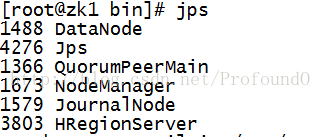

- zk1

- zk2

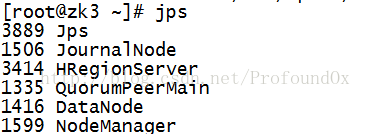

- zk3

- centos680(我这里将yarn开启了)

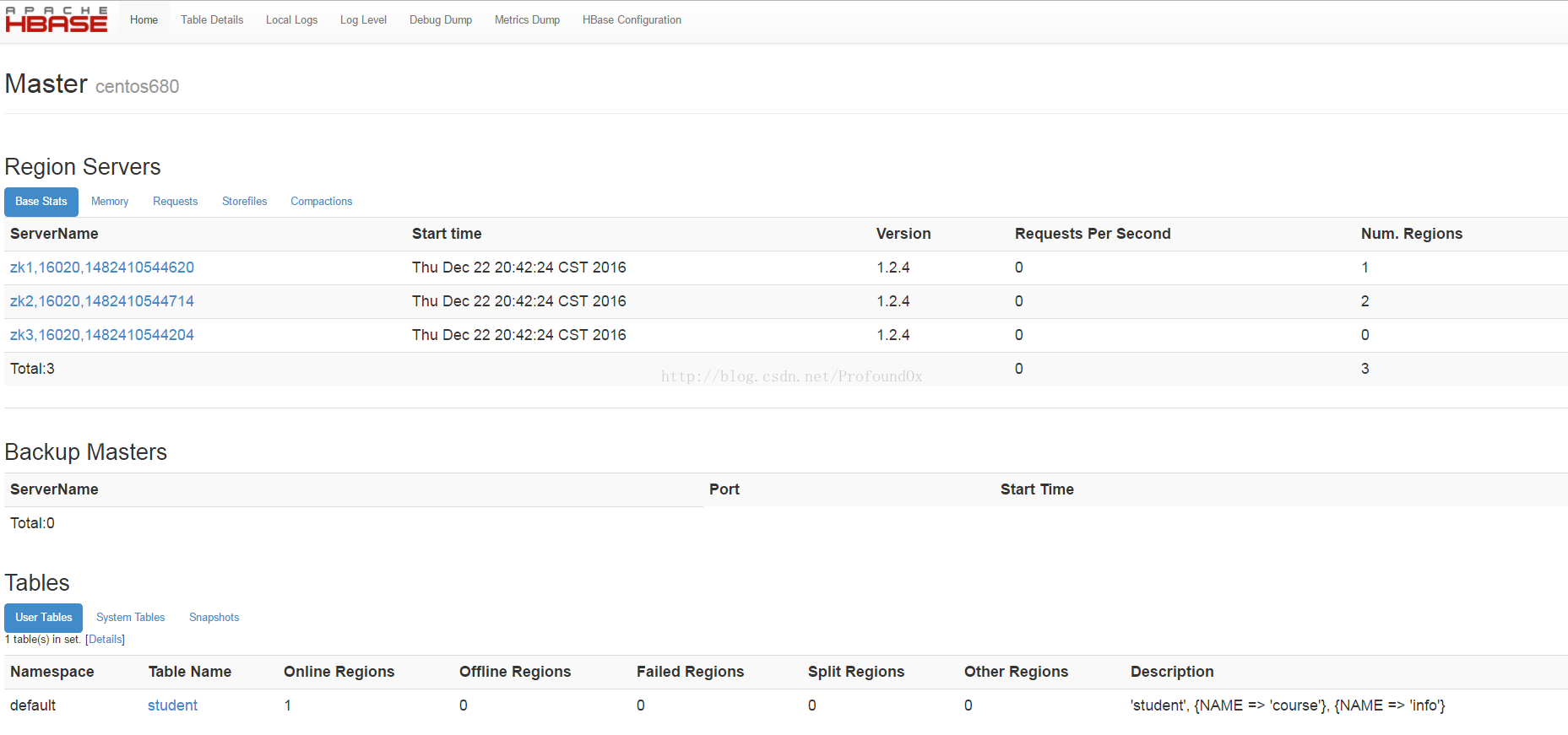

- 同时访问:centos680:16010可以查看hbase节点的状况。

- 注意:要实现Hbase的HA(High Availablity),必须在centos681上执行:hbase-daemon.sh start master

- 下图为centos680Hbase节点状态,及其他Region Servers、BackMaster信息。(成功!!!)

- 首先查看各节点进程。

- 复制配置好的Hbase到其他机器上:

7980

7980

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?