Java内存模型

共享内存模型指的就是Java内存模型(简称JMM),JMM决定一个线程对共享变量的写入何时对另一个线程可见。并发编程中可以满足原子性、可见性及有序性。有一个重要的概念,那就是——内存模型。

为了保证共享内存的正确性(可见性、有序性、原子性),内存模型定义了共享内存系统中多线程程序读写操作行为的规范本地。内存是JMM的一个抽象概念,并不真实存在。它涵盖了缓存,写缓冲区,寄存器以及其他的硬件和编译器优化。

提高计算速度,但会出现数据不一致的问题。可以通过总线锁,锁住整个总线,但是效率比较低。也可以通过缓存锁,各种缓存一致性协议保证数据一致。MSI,MESI(Inter),MOSI等。

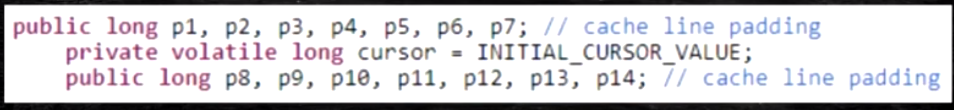

缓存行对齐

位于同一缓存行的两个不同数据,被两个不同CPU锁定,产生互相影响的伪共享问题。这段代码可以使INITIAL_CURSOR_VALUE处于自己的缓存行里,不会和其他缓存行混在一起。提升处理速度。

乱序执行

CPU为了提高指令执行效率,会在一条指令执行过程中(比如去内存读数据(慢100倍)),去同时执行另一条指令,前提是,两条指令没有依赖关系

如何保证特定情况下不乱序

硬件内存屏障 X86

sfence: store| 在sfence指令前的写操作当必须在sfence指令后的写操作前完成。

lfence:load | 在lfence指令前的读操作当必须在lfence指令后的读操作前完成。

mfence:modify/mix | 在mfence指令前的读写操作当必须在mfence指令后的读写操作前完成。

原子指令,如x86上的”lock …” 指令是一个Full Barrier,执行时会锁住内存子系统来确保执行顺序,甚至跨多个CPU。Software Locks通常使用了内存屏障或原子指令来实现变量可见性和保持程序顺序

JVM级别如何规范(JSR133)

LoadLoad屏障:

对于这样的语句Load1; LoadLoad; Load2,在Load2及后续读取操作要读取的数据被访问前,保证Load1要读取的数据被读取完毕。

StoreStore屏障:

对于这样的语句Store1; StoreStore; Store2,

在Store2及后续写入操作执行前,保证Store1的写入操作对其它处理器可见。

LoadStore屏障:

对于这样的语句Load1; LoadStore; Store2,

在Store2及后续写入操作被刷出前,保证Load1要读取的数据被读取完毕。

StoreLoad屏障:

对于这样的语句Store1; StoreLoad; Load2, 在Load2及后续所有读取操作执行前,保证Store1的写入对所有处理器可见。

volatile的实现细节

-

字节码层面

ACC_VOLATILE -

JVM层面

volatile内存区的读写 都加屏障StoreStoreBarrier

volatile 写操作

StoreLoadBarrier

LoadLoadBarrier

volatile 读操作

LoadStoreBarrier

-

OS和硬件层面

hsdis - HotSpot Dis Assembler

windows lock 指令实现 | MESI实现

synchronized实现细节

- 字节码层面

ACC_SYNCHRONIZED

monitorenter monitorexit - JVM层面

C C++ 调用了操作系统提供的同步机制 - OS和硬件层面

X86 : lock cmpxchg / xxxHappens-before原则

As if serial

不管如何重排序,单线程执行的结果不会改变

5932

5932

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?