安装前准备

- 修改主机名

hostname xx 将主机名修改成xx

hostname 查看主机名

vi /etc/sysconfig/network 修改配置文件,增加一行HOSTNAME=xx并保存退出

vi /etc/hosts ip与主机名绑定,hosts文件打开最后面增加:ip地址=xx保存退出,ping xx 进行验证是否绑定成功 - 关闭防火墙

根据需要自行关闭,自行百度。 - SSH免密码登录

执行命令ssh-keygen -t rsa 产生密钥,位于~/.ssh文件夹中 连续回车

.ssh文件夹下会有两个文件id_rsa id_rsa.pub;

执行cp id_rsa.pub authorized_keys 此时后文件夹内容:authorized_keys id_rsa id_rsa.pub

验证方式多样,自己和自己玩,如:ssh localhost 如果成功会提示last login,也就是退出当前用户。 安装jdk

注:最好卸载原有的openJdk 可参考:http://www.cnblogs.com/sixiweb/archive/2012/11/25/2787684.html 是否安装相关依赖,各取所需。

解压,配置环境变量就不一一解说了。安装Hadoop

1~4都是准备工作 当然主机名可以不改,防火墙也可以不关,有需要再关闭也是可以的,互不影响。

tar -zxvf 安装包名 解压完成后可以通过: mv 解压后文件名 修改的名字 ,来修改文件名,当然不修改也没人强迫,我只是为了简短方便修改了而已,纯属个人爱好。

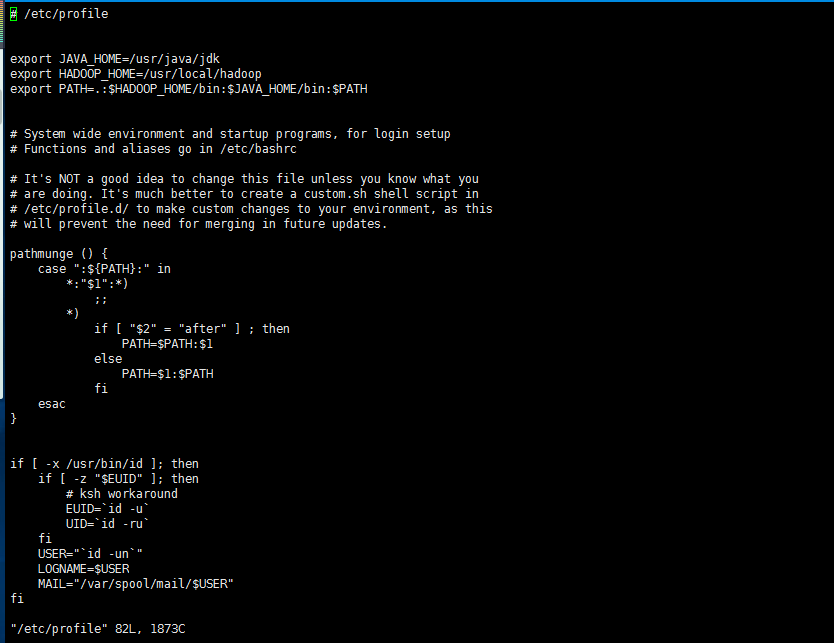

设置Hadoop环境变量,和jdk环境变量设置方式相似。例:

下面进入重要环节,Hadoop需要修改的配置文件

- hadoop-env.sh

export JAVA_HOME=/usr/local/jdk/ - 2.core-site.xml

内容修改<configuration>这里写代码片`

<property>

<name>fs.default.name</name>

<value>hdfs://主机名:9000</value>

<description>change your own hostname</description>

</property>

<property>

<name>hadoop.tmp.dir</name>

<value>/usr/local/hadoop/tmp</value>

</property>

</configuration> - hdfs-site.xml

<configuration>

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

<property>

<name>dfs.permissions</name>

<value>false</value>

</property>

</configuration>

`

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?