Redis

文章目录

Redis学习内容

- nosql 数据模型

- Nosql 四大分类

- CAP

- BASE

- Redis 入门

- Redis安装(Window & Linux服务器)

- 五大基本数据类型

- String

- List

- Set

- Hash

- Zset

- 三种特殊数据类型

- geo

- hyperloglog

- bitmap

- Redis配置详解

- Redis持久化

- RDB

- AOF

- Redis 事务操作 ACID(mysql)

- Redis 实现订阅发布 (消息队列)

- Redis 主从复制

- Redis 哨兵模式 (现在公司中所有的集群都用哨兵模式)

- 缓存穿透及解决方案

- 缓存击穿及解决方案

- 缓存雪崩及解决方案

- 基础API 之 Jedis 详解

- SpringBoot 集成 Redis 操作

- Redis 的实践分析

1、Nosql概述

为什么要使用Nosql

我们现在处于2020年,大数据时代;

大数据一般的数据库无法进行分析处理了!2006年 Hadoop

一定要逼着自己学习,这是在这个社会生产的唯一法则。

1、单机MySQL的年代

90年代,一个基本的网站访问量一般不会太大,单个数据库完全足够。

那个时候,更多的去使用静态网页 Html 服务器根本没有太大的压力。

思考一下,这种情况下:整个网站的瓶颈是什么?

- 数据量如果太大,一台机器放不下了。

- 数据的索引 (B+Tree),一个机器内存页放不下。(300万就一定要建立索引)

- 访问量(读写混合),一个服务器承受不了。

只要你开始出现以上的三种情况之一,那么你必须要晋级。

2、Memcached (缓存) + MySQL + 垂直拆分(读写分离)

网站80%的情况都是在读,每次都要查询数据库会十分麻烦。所以我们希望减轻数据的压力,我们可以使用缓存保证效率!

发展过程:优化数据结构和索引 --> 文件缓存(IO)–> Memcached(当时最热门的技术)

3、分库分表 + 水平拆分 + MySQL集群

技术和业务在发展的同时,对人的要求也越来越高。

本质:数据库(读,写)

早年引擎MyISAM:表锁(100万 张三-密码),锁整个用户表,十分影响效率,高并发就会出现严重锁问题

转战Innodb:行锁,每次查询只锁这一行

订单、用户、支付(拆分)

慢慢的就开始使用分库分表来解决写的压力。MySQL在那个年代推出了表分区。这个并没有多少公司使用。MySQL 的集群,很好的满足了那个年代的所有需求。

4、如今最近的年代

技术爆炸:2010-2020十年之间,世界已经发生了翻天覆地的变化。(定位,也是一种数据,音乐,热榜)

MySQL 等关系型数据库就不够用了,因为数据量很大,变化很快。

MySQL 有的使用它来存储一些比较大的文件,博客,图片。数据库表很大,效率就低。如果有一种数据库专门处理这种数据,MySQL 的压力就会变小。(研究如何处理这些问题)大数据的IO压力下,表几乎没法更改。灰度发布,平滑升级,在最开始时解决。

目前一个基本的互联网项目

为什么要用NoSQL

用户的个人信息,社交网络,地址位置。用户自己产生的数据,用户日志等爆发式增长!

这时候我们就需要使用NoSQL数据库,Nosql可以很好的处理以上的情况。

什么是NoSQL

NoSQL

NoSQL = Not Only SQL(不仅仅是SQL)

关系型数据库:表格,行,列(POI)

泛指非关系型数据库,随着web2.0互联网的诞生,传统的关系型数据库很难对付web2.0时代。尤其是超大规模的高并发社区。暴露出来很多难以克服的问题,NoSQL在当今大数据环境下发展的十分迅速,Redis是发展最快的,而且是我们当下必须掌握的技术。

很多的数据类型用户的个人信息,社交网络,地理位置。这些数据类型的存储不需要一个固定的格式。不需要多余的操作就可以横向扩展的。Map<String,Object>使用键值对来控制。

Get Set

NoSQL特点

解耦

- 方便扩展(数据之间没有关系,很好扩展)

- 大数据量高性能(Redis一秒写8万次,读取11万,NoSQL的缓存记录级,是一种细粒度缓存,性能会比较高)

- 数据类型是多样型的(不需要事先设计数据库,随取随用。如果是数据量十分大的表,很多人就无法设计了)

- 传统 RDBMS 和 NoSQL

传统的 RDBMS

结构化组织

SQL

数据和关系都存在单独的表中 row col

数据操作,数据定义语言

严格的一致性

基础的事务

Nosql

不仅仅是数据

没有固定查询语言

键值对存储,列存储,文档存储,图形数据库(社交关系)

最终一致性

CAP定理 和 BASE理论(异地多活)

高性能,高可用,高可拓

了解:3V+3高

大数据时代的3V:主要是描述问题的

- 海量Volume

- 多样Variety

- 实时Velocity

大数据时代的3高:主要是对程序的要求 - 高并发

- 高可拓(随时水平拆分,机器不够了,可以扩展机器来解决)

- 高性能(保证用户体验和性能,每周维护)

实践:NoSQL + RDBMS 一起使用才是最强的,阿里巴巴的架构引进。

敏捷开发(Agile): 捷开发以用户的需求进化为核心,是一种以人为核心、迭代、循序渐进的开发方法。在敏捷开发中,把一个大项目分为多个子项目,每个项目相互联系,各个子项目都经过测试,具备可视、可集成和可运行使用的特征。但也可独立运行的小项目,并分别完成,在此过程中软件一直处于可使用状态。敏捷开发并不追求前期完美的设计、完美编码,而是力求在很短的周期内开发出产品的核心功能,尽早发布出可用的版本。然后在后续的生产周期内,按照新需求不断迭代升级,完善产品。

极限编程(ExtremeProgramming): 是一种轻量(敏捷)、高效、低风险、柔性、可预测、科学而且充满乐趣的软件开发方式

-

商品的基本信息:名称、价格、商家信息

关系型数据库就可以解决了; MySQL(组件)/ Oracle(淘宝早年就去IOE了 - 王坚:《阿里云的这群疯子》) -

商品的描述:评论(文字居多)

文档型数据库中,Redis -> MongoDB -

图片

分布式文件系统 FastDFS

淘宝自己的 TFS

Gooale的 GFS

Hadoop HDFS

阿里云的 oss -

商品的关键字(用于搜索)

搜索引擎 solr elasticsearch

ISerach:多隆(多了解一些技术大佬) -

商品热门的波段信息

内存数据库

Redis、Tair、Memache -

商品的交易,外部的支付接口

三方应用

要知道,一个简单的网页背后的技术,一定不是大家所想的那么简单。

大型互联网应用问题:

- 数据类型太多了。

- 数据源繁多,经常重构。

- 数据要改造,大面积改造。

UDSL(统一数据服务平台)

这里以上都是NoSQL入门概述,不仅能够提高大家的只是,还可以更好地帮助大家了解大厂的工作内容。

2、NoSQL的四大分类

-

KV键值对:

- 新浪:Redis

- 美团:Redis + Tair

- 阿里、百度:Redis + memcache

-

文档型数据库(bson格式和json一样):

- MongoDB(一般必须要掌握)

- MongoDB 是一个基于分布式文件存储的数据库,C++编写,主要用来处理大量的文档。

- MongoDB 是一个介于关系型数据库和非关系型数据中间的产品。MongoDB 是非关系型数据库中功能最丰富,最像关系型数据库的。

- ConchDB

- MongoDB(一般必须要掌握)

-

列存储数据库

- HBase

- 分布式文件系统

-

图关系数据库

- 他不是存图形,放的是关系,比如:朋友圈社交网络,广告推荐!

- Neo4j,InfoGrid

3、Redis入门

概述

Redis是什么?

Redis (Remote Dictionary Server),即远程字典服务。

C语言编写,支持网络,基于内存,Key-Value数据库,提供多种语言API。

免费和开源,是当下最热门的 NoSQL 技术之一,也被人们称之为结构化数据库。

redis会周期性的把更新的数据写入磁盘或者把修改操作写入追加的记录文件,并且在此基础上实现了master-slave(主从)同步。

Redis能干什么?

- 内存存储、持久化,内存中是断电即失、所以说持久化很重要(rdb、aof)

- 效率高,可以用于告诉缓存

- 发布订阅系统

- 地图信息分析

- 计时器、计数器(浏览量)

…

特性

- 开源

- 多种数据类型

- 持久化

- 集群

- 事务

…

学习中需要用到的东西

- 官网:https://redis.io/

- 中文网:http://www.redis.cn/

- 下载地址:通过官网下载即可

注意:Window在 Github山下载(停更很久了)

Redis推荐都是在Linux上服务器上搭建的

Windows安装

- 下载安装包:https://github.com/dmajkic/redis

- 下载完毕后得到压缩包

- 解压到自己电脑上的环境目录下就可以了

- 开启Redis,双击运行服务即可

- 使用redis客户端来连接redis

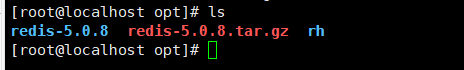

Linux安装

(暂略)

- 下载安装包!

- 解压Redis的安装包

- 进入解压后的文件,可以看到我们redis的配置文件

- 基本的环境安装

yum install gcc-c++

make

make install

- redis 默认的安装路径

/usr - 将redis配置文件,复制到我们当前的目录下

- redis默认不是后台启动的,修改配置文件!

- 启动redis服务

- 使用redis-cli 进行连接测试

- 查看redis的进程是否开启

ps -ef|grep redis

- 如何关闭redis

shutdown

- 再次查看redis进程是否存在

- 后面我们会使用单机多Redis启动集群测试

测试性能

redis-benchmark 是一个压力测试工具!

官方自带的性能测试工具

图片来源:菜鸟教程

我们来简单测试下:

测试:100个并发连接,100000 请求

redis-benchmark -h localhost -p 6379 -c 100 -n 100000(如下图)

如何查看这些分析

所有请求在3毫秒内处理完成 每秒处理94607.38个请求

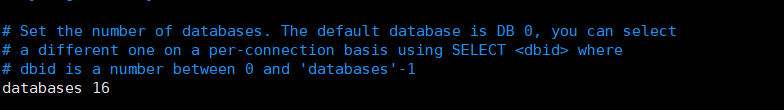

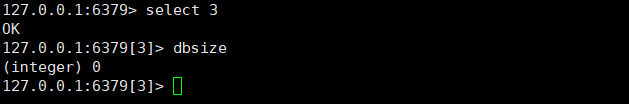

4、Redis基础知识

redis默认有16个数据库

默认使用的是第0个

可以使用select进行切换

查看数据库所有的key

keys *

清空

flushdb 清空当前库

flushdball 清空全部

思考:为什么redis是 6379 ,粉丝效应(了解即可,MySQL同理)

Redis是单线程的!

明白Redis是很快的,官方表示,Redis是基于内存操作的,CPU不是Redis性能瓶颈,Redis的瓶颈是根据机器内存和网络带宽,既然可以使用单线程来实现,就使用单线程了。

Redis是 C 语言写的,官方提供的数据为 100000+ 的QPS,完全不比同样使用key-value的Memecache差。

Redis 为什么单线程还这么快?

- 误区1:高性能的服务器一定是多线程的?不一定。

- 误区2:多线程(CPU上下文切换)一定比单线程效率高。

先去了解CPU>内存>硬盘的速度要有所了解

核心:redis是将所有的数据全部放在内存中的,所以说使用单线程去操作效率就是最高的,多线程(CPU上下文切换:耗时的操作),而对于内存系统来说,如果没有上下文切换,效率就是最高的。多次读写都是在一个CPU上的,所以在内存情况下,这个就是最佳的方案。具体还可以继续查询相关的文献。

Redis数据类型

官网文档:

全段翻译:

Redis 是一个开源(BSD许可)的,内存中的数据结构存储系统,它可以用作数据库、缓存和消息中间件MQ。 它支持多种类型的数据结构,如 字符串(strings), 散列(hashes), 列表(lists), 集合(sets), 有序集合(sorted sets) 与范围查询, bitmaps, hyperloglogs 和 地理空间(geospatial) 索引半径查询。 Redis 内置了 复制(replication),LUA脚本(Lua scripting), LRU驱动事件(LRU eviction),事务(transactions) 和不同级别的 磁盘持久化(persistence), 并通过 Redis哨兵(Sentinel)和自动 分区(Cluster)提供高可用性(high availability)。

五大数据类型

Redis-Key

keys * 查看所有的key

set name swaelee 设置key

get name 取出key

exists判断某个键是否存在

exists name 判断name是否存在,返回1存在,返回0不存在

move移除某个键

move name 1 将name设为1,移到数据库1

expire设置key过期时间,单位为秒

expire name 10 name这个值,10秒过期

ttl name 查看name剩余时间

(单点登录)

type 查看当前key的类型

type name

后面如果遇到不会的命令,可以在官网查看帮助文档

String

# append 拼接字符串,如果当前追加的字符串不存在,相当于setkey

set key1 v1

append key1 "hello" 向hello拼接值

get key1

v1hello

# exists key1 判断某一个key是否存在

# strlen 获取字符串长度

strlen key1

14

################################################################

# 自增 incr 自减 decr

127.0.0.1:6379> set views 0

OK

127.0.0.1:6379> get views

"0"

127.0.0.1:6379> incr views 浏览量增加1

(integer) 1

127.0.0.1:6379> get views

"1"

127.0.0.1:6379> incr views

(integer) 2

127.0.0.1:6379> decr views 浏览量自减1

(integer) 1

127.0.0.1:6379> get views

"1"

127.0.0.1:6379> decr views

(integer) 0

127.0.0.1:6379> get views

"0"

# 步长设置 INCRBY DECRBY

127.0.0.1:6379> incrby views 5 views自增5

(integer) 5

127.0.0.1:6379> decrby views 10 views自减10

(integer) -5

################################################################

# 字符串范围 range

127.0.0.1:6379> set key1 "hello,swaelee"

OK

127.0.0.1:6379> get key1

"hello,swaelee"

127.0.0.1:6379> getrange key1 0 5 取出key1 0-5 范围的值

"hello,"

127.0.0.1:6379> getrange key1 0 -1 取出key1 所有值

"hello,swaelee"

127.0.0.1:6379> getrange key1 6 -1 取出key1 6-end 范围的值

"swaelee"

# 替换 setrange

127.0.0.1:6379> set key2 abcdefg

OK

127.0.0.1:6379> get key2

"abcdefg"

127.0.0.1:6379> setrange key2 1 xxxxx 替换指定位置开始的字符串,从第一个开始替换,后面5个为x

(integer) 7

127.0.0.1:6379> get key2

"axxxxxg"

################################################################

# setex(set with expire) # 设置过期时间

# setnx(set if not expire)# 不存在设置(在分布式锁中经常使用)

127.0.0.1:6379> setex key3 30 "jessie" 设置key3值,30秒过期

OK

127.0.0.1:6379> ttl key3 查看key3值剩余时间

(integer) 25

127.0.0.1:6379> get key3

"jessie"

127.0.0.1:6379> setnx myKey "redis" 如果不存在myKey,设置myKey值

(integer) 1

127.0.0.1:6379> keys *

1) "myKey"

2) "key2"

3) "key1"

127.0.0.1:6379> ttl key3

(integer) -2

127.0.0.1:6379> setnx myKey "MongoDB" 存在myKey,所以MongoDB无效

(integer) 0

127.0.0.1:6379> get myKey

"redis"

################################################################

# mset

# mget

127.0.0.1:6379> mset k1 v1 k2 v2 k3 v3 同时设置k1 k2 k3值分别为v1 v2 v3

OK

127.0.0.1:6379> keys *

1) "k3"

2) "k2"

3) "k1"

127.0.0.1:6379> mget k1 k2 k3 同时获取k1 k2 k3

1) "v1"

2) "v2"

3) "v3"

127.0.0.1:6379> mget k3 k1 k2 同时获取k3 k1 k2

1) "v3"

2) "v1"

3) "v2"

127.0.0.1:6379> msetnx k1 v1 k4 v4 k5 v5 msetnx 是一个原子性的操作,要么一起成功,要么一起失败

(integer) 0

127.0.0.1:6379> keys *

1) "k3"

2) "k2"

3) "k1"

################################################################

# 对象

set user:1{name:zhangsan,age:3} 设置一个user:1对象,值为 json 字符串来保存一个字符串

# 这里的key是一个巧妙的设计: user:{id}:{filed},如此设计在Redis中是完全可以的。

127.0.0.1:6379> mset user:1:name zhangsan user:1:age 18

OK

127.0.0.1:6379> mget user:1:name user:1:age

1) "zhangsan"

2) "18"

127.0.0.1:6379> mset kk:name kkname kk:age kk18

OK

127.0.0.1:6379> mget kk:name kk:age

1) "kkname"

2) "kk18"

################################################################

# getset 先get再set,如果不存在值返回null,如果存在值,获取原来的值并设置新的值

127.0.0.1:6379> getset db1 redis

(nil)

127.0.0.1:6379> get db1

"redis"

127.0.0.1:6379> getset db1 MongoDB

"redis"

127.0.0.1:6379> get db1

"MongoDB"

数据结构是相同的,未来的话,Jedis

String类似的使用场景:value除了是我们的字符串,还可以是我们的数字。

- 计数器

- 统计多单位的数量 {uid:465672315:follw 0 incr}

- 粉丝数

- 对象缓存存储

List

基本的数据类型,列表

在redis里面,我们可以把list玩成,栈,队列,阻塞队列

所有的list命令都是用l开头的,Redis不区分大小写命令

127.0.0.1:6379> lpush list one

(integer) 1

127.0.0.1:6379> lpush list two

(integer) 2

127.0.0.1:6379> lpush list three

(integer) 3

127.0.0.1:6379> lrange list 0 -1

1) "three"

2) "two"

3) "one"

127.0.0.1:6379> lrange list 1

(error) ERR wrong number of arguments for 'lrange' command

127.0.0.1:6379> lrange list 1 2

1) "two"

2) "one"

################################################################

# rpush 向队列尾部插入值

127.0.0.1:6379> rpush list right

(integer) 4

127.0.0.1:6379> lrange list 0 -1

1) "three"

2) "two"

3) "one"

4) "right"

# lpush 向队列首部插入值

127.0.0.1:6379> lpush list left

(integer) 5

127.0.0.1:6379> lrange list 0 -1

1) "left"

2) "three"

3) "two"

4) "one"

5) "right"

################################################################

# 移除Lpop 移除列表第一个元素

# Rpop移除列表最后一个元素

127.0.0.1:6379> lrange list 0 -1

1) "left"

2) "three"

3) "two"

4) "one"

5) "right"

127.0.0.1:6379> Lpop list 移除列表第一个元素

"left"

127.0.0.1:6379> lrange list 0 -1

1) "three"

2) "two"

3) "one"

4) "right"

127.0.0.1:6379> Rpop list 移除列表第一个元素

"right"

127.0.0.1:6379> lrange list 0 -1

1) "three"

2) "two"

3) "one"

################################################################

# Lindex 通过下表获取 list 中的某一个值

127.0.0.1:6379> Lindex list 1 通过下表获取 list 中的第一个值

"two"

127.0.0.1:6379> Lindex list 0

"three"

################################################################

# Llen 获取列表长度

127.0.0.1:6379> Lpush list one

(integer) 1

127.0.0.1:6379> Lpush list two

(integer) 2

127.0.0.1:6379> lpush list three

(integer) 3

127.0.0.1:6379> Llen list 获取 list 长度

(integer) 3

################################################################

# 移除指定的值 取关 uid

# Lrem 移除 list 集合中指定个数的value,精确匹配

127.0.0.1:6379> lrem list 1 one

(integer) 1

127.0.0.1:6379> lrange list 0 -1

1) "three"

2) "three"

3) "two"

127.0.0.1:6379> lrem list 1 three

(integer) 1

127.0.0.1:6379> lrange list 0 -1

1) "three"

2) "two"

################################################################

# trim 修剪。list 保留其中一部分元素,截断。

127.0.0.1:6379> rpush mylist "pop somke"

(integer) 1

127.0.0.1:6379> rpush mylist "travis scott"

(integer) 2

127.0.0.1:6379> rpush mylist "polo g"

(integer) 3

127.0.0.1:6379> rpush mylist "litajy"

(integer) 4

127.0.0.1:6379> lrange mylist 0 -1

1) "pop somke"

2) "travis scott"

3) "polo g"

4) "litajy"

127.0.0.1:6379> ltrim mylist 1 2 通过下标截取 mylist 指定长度,这个list已经被改变了,只剩下截取的元素了。

OK

127.0.0.1:6379> lrange mylist 0 -1

1) "travis scott"

2) "polo g"

################################################################

# rpoplpush 移除列表最后一个元素,并将它添加到另外一个列表

127.0.0.1:6379> rpush mylist "j1"

(integer) 1

127.0.0.1:6379> rpush mylist "j2"

(integer) 2

127.0.0.1:6379> rpush mylist "j3"

(integer) 3

127.0.0.1:6379> rpoplpush mylist anotherlist 将mylist列表最后一个元素移动到 anotherlist 中,移动 anotherlist 时正序

"j3"

127.0.0.1:6379> lrange mylist 0 -1

1) "j1"

2) "j2"

127.0.0.1:6379> keys *

1) "anotherlist"

2) "mylist"

127.0.0.1:6379> lrange anotherlist 0 -1

1) "j3"

127.0.0.1:6379> rpoplpush mylist anotherlist 将mylist列表最后一个元素移动到 anotherlist 中

"j2"

127.0.0.1:6379> lrange anotherlist 0 -1

1) "j2"

2) "j3"

################################################################

# lset 替换列表指定下标的值,相当于更新

127.0.0.1:6379> lset list 0 item 不可设置空列表,如果替换不存在的列表就会报错

(error) ERR no such key

127.0.0.1:6379> keys *

1) "anotherlist"

2) "mylist"

127.0.0.1:6379> lpush list value1

(integer) 1

127.0.0.1:6379> lrange list 0 0

1) "value1"

127.0.0.1:6379> lset list 1 item 不可设置空元素,如果替换不存在下标就会报错

(error) ERR index out of range

127.0.0.1:6379> lset list 0 item 替换 list 指定下标0的值

OK

127.0.0.1:6379> lrange list 0 0

1) "item"

################################################################

# linsert 插入值 将某个具体的 value 插入到列表中某个元素的前面或后面

127.0.0.1:6379> rpush mylist "jessie"

(integer) 1

127.0.0.1:6379> rpush mylist "lee"

(integer) 2

127.0.0.1:6379> linsert mylist after "lee" "made another one" 在 mylist 列表中 lee 元素的 后面 添加 made another one

(integer) 3

127.0.0.1:6379> lrange mylist 0 -1

1) "jessie"

2) "lee"

3) "made another one"

127.0.0.1:6379> linsert mylist before "jessie" "oh lord" 在 mylist 列表中 jessie元素的 后面 添加 oh lord

(integer) 4

127.0.0.1:6379> lrange mylist 0 -1

1) "oh lord"

2) "jessie"

3) "lee"

4) "made another one"

小结

- List它实际上是一个链表,before Node after,left,right 都可以插入值

- 如果key不存在,创建新的链表

- 如果key存在,新增内容

- 如果移除了所有的值,空链表,也代表不存在

- 在两边插入或改动值,效率最高。改动中间元素,相对来说效率会低。

消息排队,消息队列(Lpush Rpop),栈( Lpush Rpop)

Set(集合)

set中的值是不能重复的

127.0.0.1:6379> sadd myset "hello" # 在set集合中添加元素

(integer) 1

127.0.0.1:6379> sadd myset "swaelee"

(integer) 1

127.0.0.1:6379> sadd myset "gang gang"

(integer) 1

127.0.0.1:6379> smembers myset # 查看指定set的所有值

1) "gang gang"

2) "swaelee"

3) "hello"

127.0.0.1:6379> sismember myset ganggang # 判断某个值是否在set集合中

(integer) 0

127.0.0.1:6379> sismember myset "gang gang"

(integer) 1

################################################################

127.0.0.1:6379> scard myset 获取集合个数

(integer) 3

127.0.0.1:6379> sadd myset "swaelee" 不能添加重复值

(integer) 0

127.0.0.1:6379> sadd myset "swaelee2"

(integer) 1

127.0.0.1:6379> scard myset

(integer) 4

127.0.0.1:6379> smembers myset

1) "gang gang"

2) "swaelee2"

3) "swaelee"

4) "hello"

################################################################

# srem 移除set集合中指定元素

127.0.0.1:6379> srem myset hello

(integer) 1

127.0.0.1:6379> smembers myset

1) "gang gang"

2) "swaelee2"

3) "swaelee"

# srandmember(无序不重复),抽随机

127.0.0.1:6379> srandmember myset 在myset集合中随机抽出一个元素

"swaelee2"

127.0.0.1:6379> srandmember myset

"swaelee"

127.0.0.1:6379> srandmember myset

"swaelee2"

127.0.0.1:6379> srandmember myset 2 在myset集合中随机抽出指定个数集合

1) "gang gang"

2) "swaelee"

################################################################

# 删除指定的key,随机删除key

127.0.0.1:6379> smembers myset

1) "gang gang"

2) "swaelee2"

3) "swaelee"

127.0.0.1:6379> spop myset # 随机删除一个元素

"swaelee"

127.0.0.1:6379> smembers myset

1) "gang gang"

2) "swaelee2"

127.0.0.1:6379> spop myset # 随机删除一个元素

"gang gang"

127.0.0.1:6379> smembers myset

1) "swaelee2"

################################################################

# 将一个指定的元素,移动到另外一个set集合

127.0.0.1:6379> sadd set1 "s1"

(integer) 1

127.0.0.1:6379> sadd set1 "s2"

(integer) 1

127.0.0.1:6379> sadd set1 "s3"

(integer) 1

127.0.0.1:6379> smove set1 set2 "s3" 将set1中的 s3 元素移动到set2集合中

(integer) 1

127.0.0.1:6379> smembers set1

1) "s2"

2) "s1"

127.0.0.1:6379> smembers set2

1) "s3"

微博,B站,共同关注(并集)

数字集合类:

- 差集

- 交集

- 并集

127.0.0.1:6379> sadd key1 a

(integer) 1

127.0.0.1:6379> sadd key1 b

(integer) 1

127.0.0.1:6379> sadd key1 c

(integer) 1

127.0.0.1:6379> sadd key2 c

(integer) 1

127.0.0.1:6379> sadd key2 d

(integer) 1

127.0.0.1:6379> sadd key2 e

(integer) 1

127.0.0.1:6379> sdiff key1 key2

1) "a"

2) "b"

127.0.0.1:6379> sdiff key2 key1

1) "d"

2) "e"

127.0.0.1:6379> sinter key1 key2 # 差集

1) "c"

127.0.0.1:6379> sinter key2 key1 # 交集 共同好友可以这样实现

1) "c"

127.0.0.1:6379> sunion key1 key2 # 并集

1) "a"

2) "c"

3) "d"

4) "b"

5) "e"

微博,A用户将所有关注的人放在一个set集合中,将它的粉丝也放在一个集合中。

共同关注,共同爱好,二度好友(六度分割理论)

Hash(哈希)

Map集合,key-Map集合,相当于key<key-map>,这时候这个值是一个map集合。本质和String类型没有太大区别,还是一个简单的key-value

hset myhash field xxx

127.0.0.1:6379> hset myhash user swaelee # hset 设置一个具体的 key-value

(integer) 1

127.0.0.1:6379> hget myhash user

"swaelee"

127.0.0.1:6379> hmset myhash user jessie type trap # hmset 设置多个 key-value

OK

127.0.0.1:6379> hmget myhash user type # hmget 获取多个字段值

1) "jessie"

2) "trap"

127.0.0.1:6379> hgetall myhash # hgetall获取 myhash 中全部的数据

1) "user"

2) "jessie"

3) "type"

4) "trap"

################################################################

# hdel 删除

127.0.0.1:6379> hdel myhash user # 删除hash指定key字段,对应的value值也消失了

(integer) 1

127.0.0.1:6379> hgetall myhash

1) "type"

2) "trap"

################################################################

# hlen 获取hash表的字段数量

127.0.0.1:6379> hgetall myhash

1) "type"

2) "trap"

3) "username"

4) "swaelee"

127.0.0.1:6379> hlen myhash

(integer) 2

################################################################

# hexists 判断hash中指定字段是否存在

127.0.0.1:6379> hexists myhash username # 判断myhash中username是否存在

(integer) 1

127.0.0.1:6379> hexists myhash password # 判断myhash中password是否存在

(integer) 0

################################################################

# 只获得所有的字段(key)

# 只获得所有的值(value)

127.0.0.1:6379> hkeys myhash # 获得所有myhash字段

1) "type"

2) "username"

127.0.0.1:6379> hvals myhash # 获得所有myhash的值

1) "trap"

2) "swaelee"

################################################################

# 自增 incr 自减 decr

127.0.0.1:6379> hset myhash like 1 # 设置myhash like 为1

(integer) 1

127.0.0.1:6379> hincrby myhash like 1 # 设置 like 自增1

(integer) 2

127.0.0.1:6379> hincrby myhash like -2

(integer) 0

127.0.0.1:6379> hsetnx myhash mark ATL # 如果不存在新增字段

(integer) 1

127.0.0.1:6379> hset myhash mark chicago # 如果存在则不能增加

(integer) 0

hash类应用,hash变更的数据 user name age ,尤其是用户信息之类的,经常变动的信息。

hash更适合对象的存储,String更加适合字符串存储。

Zset(有序集合)

在set的基础上,增加了一个值,set k1 v1,zset k1 score1 v1

127.0.0.1:6379> zadd myzset 1 one # 添加一个值

(integer) 1

127.0.0.1:6379> zadd myzset 2 two

(integer) 1

127.0.0.1:6379> zadd myzset 3 three 4 four # 添加多个值

(integer) 2

127.0.0.1:6379> zrange myzset 0 -1

1) "one"

2) "two"

3) "three"

4) "four"

# zset添加值不可重复,score可以重复,优先级相同时,按照添加顺序排列,后添加的在前

127.0.0.1:6379> zrange zset 0 -1

1) "h1"

2) "hello"

3) "hi"

4) "world"

5) "swaelee"

127.0.0.1:6379> zadd zset 1 "hi" # 不可添加重复值,score相同,按照添加顺序排列,后添加的在前

(integer) 0

127.0.0.1:6379> zrange zset 0 -1

1) "h1"

2) "hello"

3) "hi"

4) "world"

5) "swaelee"

################################################################

# 排序如何实现

127.0.0.1:6379> zadd salary 2500 xiaohong # 添加三个用户

(integer) 1

127.0.0.1:6379> zadd salary 5000 zhangsan

(integer) 1

127.0.0.1:6379> zadd salary 1000 xiaoqiang

(integer) 1

127.0.0.1:6379> zrangebyscore salary -inf +inf # 升序排序

1) "xiaoqiang"

2) "xiaohong"

3) "zhangsan"

127.0.0.1:6379> zrangebyscore salary -inf +inf withscores # 升序排序显示值

1) "xiaoqiang"

2) "1000"

3) "xiaohong"

4) "2500"

5) "zhangsan"

6) "5000"

127.0.0.1:6379> zrevrangebyscore salary +inf -inf # 降序排序

1) "zhangsan"

2) "xiaohong"

3) "xiaoqiang"

127.0.0.1:6379> zrangebyscore salary -inf 2500 withscores # 升序排序带范围,工资小于2500

1) "xiaoqiang"

2) "1000"

3) "xiaohong"

4) "2500"

127.0.0.1:6379> zrangebyscore salary (1000 2500 # 排序查找 1000 < salary <= 2500

1) "xiaohong"

127.0.0.1:6379> zrangebyscore salary (1000 (2500 # 排序查找 1000 < salary < 2500

(empty list or set)

################################################################

# zrem移除元素

127.0.0.1:6379> zrange salary 0 -1

1) "xiaoqiang"

2) "xiaohong"

3) "zhangsan"

127.0.0.1:6379> zrem salary xiaohong # 移除有序集合 salary 中的 xiaohong 元素

(integer) 1

# zcard 获取集合个数

127.0.0.1:6379> zrange salary 0 -1

1) "xiaoqiang"

2) "xiaohong"

3) "zhangsan"

127.0.0.1:6379> zcard salary # 获取有序集合中的个数

(integer) 2

################################################################

# zcount 获取指定区间的成员数量

127.0.0.1:6379> zadd zset 1 "hello"

(integer) 1

127.0.0.1:6379> zadd zset 2 "world" 3 "swaelee"

(integer) 2

127.0.0.1:6379> zcount zset 1 3 # 获取zset 1 3区间的成员数量

(integer) 3

127.0.0.1:6379> zcount zset 1 2

(integer) 2

其他的一些API,剩下的如果工作中有需要,可以去官方文档。

案例思路:set 排序 存储班级成绩表,工资表排序。

普通消息 1,重要消息 2,带权重进行判断。

排行榜应用实现,取 TOP N 测试。

三种特殊数据类型

Geospatial 地理位置

朋友的定位,附近的人,打车距离计算。

Redis的 Geo 在Redis3.2版本就推出了,这个功能可以推算地理位置的信息,两地之间的距离,方圆几里的人

可以查询一些测试数据:http://www.jsons.cn/lngcode/

只有六个命令

相关命令

- GEOADD

- GEODIST

- GEOHASH

- GEOPOS

- GEORADIUS

- GEORADIUSBYMEMBER

geoadd

# getadd添加地理位置 添加指定的地理空间位置(纬度、经度、名称)

# 规则:地球两极无法直接添加,我们一般会下载城市数据,直接通过java程序一次性导入。

# 参数 key value(纬度、经度、名称)

127.0.0.1:6379> geoadd china:city 122.26 43.61 tongliao

(integer) 1

127.0.0.1:6379> geoadd china:city 118.95 42.27 chifeng

(integer) 1

127.0.0.1:6379> geoadd china:city 123.42 41.79 shenyang

(integer) 1

127.0.0.1:6379> geoadd china:city 116.40 39.90 beijing

(integer) 1

127.0.0.1:6379> geoadd china:city 121.61 38.91 dalian

(integer) 1

geopos

获得当前定位:一定是一个坐标值

127.0.0.1:6379> geopos china:city beijing # 获取指定的城市的经度和纬度

1) 1) "116.39999896287918091"

2) "39.90000009167092543"

127.0.0.1:6379> geopos china:city shenyang tongliao

1) 1) "123.41999977827072144"

2) "41.78999971580505246"

2) 1) "122.25999802350997925"

2) "43.61000048040287425"

getpos

两人之间的距离

单位:

- m 米

- km 千米

- mi 英里

- ft 英尺

127.0.0.1:6379> geodist china:city beijing tongliao

"637439.8437"

127.0.0.1:6379> geodist china:city beijing chifeng km # 赤峰到北京的直线距离

"339.3605"

127.0.0.1:6379> geodist china:city beijing shenyang km # 沈阳到北京的直线距离

"626.7297"

georadius 以给定的经纬度为中心,找出某一半径内的元素

我附近的人(获得所有附近的人的地址,定位)通过半径来查询

获得指定数量的人,500

所有的数据都应该录入:china:city,才会让结果更加清晰。

127.0.0.1:6379> georadius china:city 110 30 1000 km # 以110,30这个经纬为中心,寻找方圆1000km内的城市

(empty list or set)

127.0.0.1:6379> georadius china:city 110 30 2000 km # 寻找经纬度 110 30 附近2000km的实体

1) "beijing"

2) "dalian"

3) "chifeng"

4) "shenyang"

5) "tongliao"

127.0.0.1:6379> georadius china:city 120 40 2000 km withdist # 显示到中心距离的位置 (withcoord 精准)

1) 1) "beijing"

2) "307.1405"

2) 1) "dalian"

2) "183.8861"

3) 1) "chifeng"

2) "267.3603"

4) 1) "shenyang"

2) "349.6969"

5) 1) "tongliao"

2) "443.0490"

127.0.0.1:6379> georadius china:city 120 40 1500 km withdist withcoord count 1 # 根据count限制搜索结果个数

1) 1) "dalian"

2) "183.8861"

3) 1) "121.61000221967697144"

2) "38.90999884014095045"

georadiusbymember

# 找出位于指定元素周围的其他元素

127.0.0.1:6379> georadiusbymember china:city beijing 1000 km 北京 1000km内

1) "beijing"

2) "dalian"

3) "chifeng"

4) "shenyang"

5) "tongliao"

geohash 命令-返回一个或多个位置元素的 Geohash 表示

该命令将返回11个字符的Geohash字符串

# 将二维的经纬度转换为一维的字符串,如果两个字符串越接近,则距离越近

127.0.0.1:6379> geohash china:city beijing chifeng

1) "wx4fbxxfke0"

2) "wxs86z08xg0"

GEO 底层的实现原理其实就是 Zset,我们可以使用Zset命令还操作geo。

127.0.0.1:6379> zrange china:city 0 -1 # 查看地图中全部的元素

1) "beijing"

2) "dalian"

3) "chifeng"

4) "shenyang"

5) "tongliao"

127.0.0.1:6379> zrem china:city tongliao # 移除一个城市

(integer) 1

127.0.0.1:6379> zrange china:city 0 -1

1) "beijing"

2) "dalian"

3) "chifeng"

4) "shenyang"

Hyperloglog

什么是基础?

A{1,3,5,7,8,7}

B{1,3,5,7,8}

基础(不重复的元素) = 5,可以接受误差

简介

Redis 2.8.9版本就更新了 Hyperloglog 数据结构

Redis Hyperloglog 基础统计的算法

优点:占用的内存是固定的,2^64不同的元素基数,只需要废12kb内存。如果从内存角度来比较的话 Nyperloglog 首选

网页的UV(一个人访问一个网站多次,但还是算作一个人)

传统的方式,set 保存用户的id,然后就可以统计 set 中的元素数量作为标准判断。

这个方式如果保存大量的用户id,就会比较麻烦。我们的目的是为了计数,而不是保存用户id;

0.81%错误率,统计UV任务,可以忽略不计的。

127.0.0.1:6379> pfadd mykey a b c d e f g h i j # 创建第一组元素 mykey

(integer) 1

127.0.0.1:6379> pfcount mykey # 统计 mykey 元素的基数数量

(integer) 10

127.0.0.1:6379> pfadd key u v w a b c # 创建第二组元素 key

(integer) 1

127.0.0.1:6379> pfcount key

(integer) 6

127.0.0.1:6379> pfmerge mykey4 mykey key # 将两组合并,不合并重复的元素,mykey key => mykey4 并集

OK

127.0.0.1:6379> pfcount mykey4 # 看并集的数量

(integer) 13

如果允许容错,那么一定可以使用 Hyperloglog

如过不允许容错,就是用 set 或自己的数据类型即可。

Bitmaps

这些在生活或开发中,都有十分多的应用场景,学习了,就多一种思路。

位存储

统计打疫苗的人数:0 1 0 1 0

统计用户信息,活跃,不活跃,登录、未登录,打卡,365打卡。两个状态的,都可以使用Bitmaps,位图,数据结构。都是操作二进制位来进行记录,就只有0 和 1两个状态。

365 天 = 365 bit 1字节 = 8bit 46个字节左右。

使用bitmap 来记录周一到周日的打卡。

周一:1 周二:0 周三:0 周四:1…

127.0.0.1:6379> setbit sign 0 1

(integer) 0

127.0.0.1:6379> setbit sign 1 0

(integer) 0

127.0.0.1:6379> setbit sign 2 0

(integer) 0

127.0.0.1:6379> setbit sign 3 1

(integer) 0

127.0.0.1:6379> setbit sign 4 1

(integer) 0

127.0.0.1:6379> setbit sign 5 0

(integer) 0

127.0.0.1:6379> setbit sign 6 0

(integer) 0

查看某一天是否打卡

127.0.0.1:6379> getbit sign 6

(integer) 0

127.0.0.1:6379> getbit sign 3

(integer) 1

127.0.0.1:6379> getbit sign 2

(integer) 0

统计操作,统计打卡的天数。

127.0.0.1:6379> bitcount sign # 统计这周的打卡记录,就可以看到是否有全勤

(integer) 3

5、事务

Redis:事务本质:一组命令的集合。一个事务的所有命令都会被序列化,在事务执行的过程中,会按照顺序执行。

一次性、顺序性、排他性。执行一系列的命令

---------- 队列 set set set 执行 ----------

Redis事务没有隔离级别的概念。

所有的命令在事务中,并没有直接被执行,只有发起执行命令的时候才会被执行。Exec

Redis单条命令保存原子性的,但是事务不保证原子性。

redis的事务:

- 开启事务(multi)

- 命令入队(…)

- 执行事务(exec)

锁:Redis可以实现乐观锁

正常执行事务

127.0.0.1:6379> multi # 开启事务

OK

# 命令入队

127.0.0.1:6379> set k1 v1

QUEUED

127.0.0.1:6379> set k2 v2

QUEUED

127.0.0.1:6379> get k1

QUEUED

127.0.0.1:6379> get k2

QUEUED

127.0.0.1:6379> set k3 v3

QUEUED

127.0.0.1:6379> exec # 执行事务

1) OK

2) OK

3) "v1"

4) "v2"

5) OK

放弃事务

127.0.0.1:6379> set k1 v1

QUEUED

127.0.0.1:6379> set k2 v2

QUEUED

127.0.0.1:6379> set k8 asen

QUEUED

127.0.0.1:6379> discard # 取消事务

OK

127.0.0.1:6379> get k8 # 事务队列中的命令都不会被执行

(nil)

编译型异常(代码有问题,命令有错)事务中所有的命令都不会被执行

127.0.0.1:6379> multi

OK

127.0.0.1:6379> set k1 kiv

QUEUED

127.0.0.1:6379> set k2 toyokii

QUEUED

127.0.0.1:6379> set k3 thomeboydontkill

QUEUED

127.0.0.1:6379> set k4 asen

QUEUED

127.0.0.1:6379> set k5 macovaseas

QUEUED

127.0.0.1:6379> getset k5

(error) ERR wrong number of arguments for 'getset' command # 错误的命令

127.0.0.1:6379> set k6 sakee

QUEUED

127.0.0.1:6379> exec # 执行事务报错

(error) EXECABORT Transaction discarded because of previous errors.

127.0.0.1:6379> get k1 # 所有的命令都不会被执行

(nil)

运行时异常(1/0),如果事务队列中存在语法性错误,那么执行命令时,其他命令可以正常执行,错误命令抛出异常。

127.0.0.1:6379> set kk1 "v1" # 设置kk1 为字符串

OK

127.0.0.1:6379> multi

OK

127.0.0.1:6379> incr kk1 # 执行时会失败

QUEUED

127.0.0.1:6379> set kk2 3ho

QUEUED

127.0.0.1:6379> set kk3 air

QUEUED

127.0.0.1:6379> exec

1) (error) ERR value is not an integer or out of range # 虽然第一条命令报错,但是依旧正常执行成功

2) OK

3) OK

127.0.0.1:6379> get kk2

"3ho"

127.0.0.1:6379> get kk3

"air"

监控 Watch (面试常问)

悲观锁:

- 很悲观,什么时候都会出问题,无论做什么都会加锁。

乐观锁:

- 很乐观,什么时候都不会出现问题,所以不会加锁。更新数据的时候去判断一下,在此期间是否有人修改过这个数据

- 获取version。

- 更新的时候比较 version

Redis的监视测试

正常执行成功

127.0.0.1:6379> set money 100

OK

127.0.0.1:6379> set out 0

OK

127.0.0.1:6379> watch money # 监视 money 对象

OK

127.0.0.1:6379> multi # 事务正常结束,数据期间没有发生变动,这个时候就正常执行成功

OK

127.0.0.1:6379> decrby money 20

QUEUED

127.0.0.1:6379> incrby out 20

QUEUED

127.0.0.1:6379> exec

1) (integer) 80

2) (integer) 20

测试多线程修改值,使用 watch 可以当作redis的乐观锁操作

127.0.0.1:6379> watch money

OK

127.0.0.1:6379> multi

OK

127.0.0.1:6379> decrby money 10

QUEUED

127.0.0.1:6379> incrby out 10

QUEUED

127.0.0.1:6379> exec # 执行之前,另外一个线程,修改了我们的值,这时就会导致事务执行失败

(nil)

# 获取money=100,更新这个值的时候,比较money还是不是100,发现不是100,因为在另一端将money的改变了,执行失败

如果发现事务执行失败,就先解锁,再去获取锁(相当于version失败,放弃了原来的version,在获取一个新的version)

如果修改失败,获取最新的值就好。

解锁unwatch

6、Jedis

我们要使用 Java 来操作 Redis

什么是Jedis,是 Redis 官方推荐的 java 连接开发工具,使用 Java 操作 Redis 中间件,如果你要使用 Java 操作 redis,那么一定要对 Jedis 十分的熟悉。

测试

- 导入对应的依赖

<dependency>

<groupId>redis.clients</groupId>

<artifactId>jedis</artifactId>

<version>3.2.0</version>

</dependency>

<!--fastjson-->

<dependency>

<groupId>com.alibaba</groupId>

<artifactId>fastjson</artifactId>

<version>1.2.62</version>

</dependency>

- 编码测试:

- 连接数据库

- 操作命令

- 断开连接

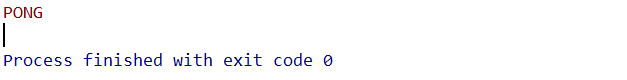

测试连接

public class TestPing {

public static void main(String[] args) {

// Jedis一切皆对象

Jedis jedis = new Jedis("127.0.0.1",6379); // 参数为 本地+端口号

// Jedis 所有的命令就是我们之前学习的所有指令

System.err.println(jedis.ping());

}

}

常用的API

String

List

Set

Hash

Zset

System.out.println(清空数据库:+jedis.flushDB());

System.out.println(判断某个键是否存在:+jedis.exists(k1));

System.out.println(新增k1,v1键值对:+jedis.set(k1,v1));

System.out.println(新增k2,v2键值对:+jedis.get(k1));

System.out.println(系统中所有的键如下:);

SetString keys = jedis.keys(*);

System.out.println(keys);

System.out.println(删除键k2:+jedis.del(k2));

System.out.println(判断键k2是否存在:+jedis.exists(k2));

System.out.println(查看键 k1 所存储的数据类型:+jedis.type(k1));

System.out.println(随机返回 key 空间的一个:+jedis.randomKey());

System.out.println(重命名 key :+jedis.rename(k1,newk1));

System.out.println(取出改后的 newk1 :+jedis.get(newk1));

System.out.println(按索引查询:+jedis.select(0));

System.out.println(删除当前选择数据库中的所有键:+jedis.flushDB());

System.out.println(返回当前数据库中 key 的数量:+jedis.dbSize());

System.out.println(删除所有数据库中的所有 key :+jedis.flushAll());

Jedis事务

public class TestTX {

public static void main(String[] args) {

Jedis jedis = new Jedis("127.0.0.1", 6379);

jedis.flushDB();

JSONObject json = new JSONObject();

json.put("hello","hello");

json.put("name","SwaeLee");

// 开启事务

Transaction multi = jedis.multi();

String res = json.toJSONString();

try {

multi.set("user1", res);

multi.set("user2", res);

int i = 1/0;

multi.exec();

} catch (Exception e) {

multi.discard(); // 放弃事务

e.printStackTrace();

} finally {

System.err.println(jedis.get("user1"));

System.err.println(jedis.get("user2"));

jedis.close(); // 关闭连接

}

}

}

7、SpringBoot整合

SpringBoot 操作数据:spring-data jpa jdbc mongodb redis

SpringData 也是和 SpringBoot 齐名的项目。

说明:在SpringBoot 2.x之后,原来使用的Jedis被替换成了 lettuce

-

Jedis:采用的是直连,多个线程操作的话,是不安全的,如果想要避免不安全的,使用 jedis pool 连接池,线程多redis-server就非常大。更像 BIO 模式

-

lettuce:采用netty,实例可以在多个线程中共享,不存在线程不安全的情况,可以减少线程数量。更像 NIO 模式

BIO: 同步并阻塞,服务器实现模式为一个连接一个线程,即客户端有连接请求时服务器端就需要启动一个线程进行处理,如果这个连接不做任何事情会造成不必要的线程开销,当然可以通过线程池机制改善。

NIO:同步非阻塞,服务器实现模式为一个请求一个线程,即客户端发送的连接请求都会注册到多路复用器上,多路复用器轮询到连接有I/O请求时才启动一个线程进行处理。

AIO:异步非阻塞,服务器实现模式为一个有效请求一个线程,客户端的I/O请求都是由OS先完成了再通知服务器应用去启动线程进行处理

源码分析:

@Bean

@ConditionalOnMissingBean(

name = {"redisTemplate"}

)

@ConditionalOnSingleCandidate(RedisConnectionFactory.class)

public RedisTemplate<Object, Object> redisTemplate(RedisConnectionFactory redisConnectionFactory) {

// 默认的 RedisTemplate 没有过多的设置,redis 对象都是需要序列化的。

// 两个泛型都是 Object,Object 的类型,我都后面使用要强转<String,Object>

RedisTemplate<Object, Object> template = new RedisTemplate();

template.setConnectionFactory(redisConnectionFactory);

return template;

}

@Bean

@ConditionalOnMissingBean

@ConditionalOnSingleCandidate(RedisConnectionFactory.class)

public StringRedisTemplate stringRedisTemplate(RedisConnectionFactory redisConnectionFactory) {

StringRedisTemplate template = new StringRedisTemplate();

template.setConnectionFactory(redisConnectionFactory);

return template;

}

整合测试

- 导入依赖

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-data-redis</artifactId>

</dependency>

- 配置连接

# 配置redis

spring.redis.host=127.0.0.1

spring.redis.port=6379

- 测试

@SpringBootTest

class Redis02SpringbootApplicationTests {

@Autowired

private RedisTemplate redisTemplate;

@Test

void contextLoads() {

// redisTemplate 操作不同的数据类型,api和我们的指令是一样的

// opsForValue 操作字符串 类似String

// opsForList List

// opsForSet Set

// opsForHash Hash

// 获取redis的连接对象

// 除了基本的操作,我们常用的方法都可以通过redisTemplate操作,比如事务,基本的CRUD

RedisConnection connection = redisTemplate.getConnectionFactory().getConnection();

//connection.flushDb();

//connection.flushAll();

redisTemplate.opsForValue().set("mykey", "SwaeLeeForJava");

System.err.println(redisTemplate.opsForValue().get("mykey"));

}

}

Java 序列化

Java 提供了一种对象序列化的机制,该机制中,一个对象可以被表示为一个字节序列,该字节序列包括该对象的数据、有关对象的类型的信息和存储在对象中数据的类型。

将序列化对象写入文件之后,可以从文件中读取出来,并且对它进行反序列化,也就是说,对象的类型信息、对象的数据,还有对象中的数据类型可以用来在内存中新建对象。

整个过程都是 Java 虚拟机(JVM)独立的,也就是说,在一个平台上序列化的对象可以在另一个完全不同的平台上反序列化该对象。

类 ObjectInputStream 和 ObjectOutputStream 是高层次的数据流,它们包含反序列化和序列化对象的方法。

ObjectOutputStream 类包含很多写方法来写各种数据类型,但是一个特别的方法例外:

序列化配置:

默认的序列化方式是JDK序列化,我们可能会使用Json来序列化。

关于对象的保存:

模板 RedisConfig 拿来即用

@Bean

@SuppressWarnings("all")

public RedisTemplate<String, Object> redisTemplate(RedisConnectionFactory factory) {

// 我们为了自己开发方便,一般直接使用 <String,Object>

RedisTemplate<String, Object> template = new RedisTemplate<String, Object>();

template.setConnectionFactory(factory);

// 序列化配置

Jackson2JsonRedisSerializer jackson2JsonRedisSerializer = new Jackson2JsonRedisSerializer(Object.class);

ObjectMapper om = new ObjectMapper();

om.setVisibility(PropertyAccessor.ALL, JsonAutoDetect.Visibility.ANY);

om.enableDefaultTyping(ObjectMapper.DefaultTyping.NON_FINAL);

jackson2JsonRedisSerializer.setObjectMapper(om);

// String 的序列化

StringRedisSerializer stringRedisSerializer = new StringRedisSerializer();

// key采用String的序列化方式

template.setKeySerializer(stringRedisSerializer);

// hash的key也采用String的序列化方式

template.setHashKeySerializer(stringRedisSerializer);

// value序列化方式采用jackson

template.setValueSerializer(jackson2JsonRedisSerializer);

// hash的value序列化方式采用jackson

template.setHashValueSerializer(jackson2JsonRedisSerializer);

template.afterPropertiesSet();

return template;

}

RedisUtil

@Component

public final class RedisUtil {

@Autowired

private RedisTemplate<String, Object> redisTemplate;

// =============================common============================

/**

* 指定缓存失效时间

* @param key 键

* @param time 时间(秒)

*/

public boolean expire(String key, long time) {

try {

if (time > 0) {

redisTemplate.expire(key, time, TimeUnit.SECONDS);

}

return true;

} catch (Exception e) {

e.printStackTrace();

return false;

}

}

/**

* 根据key 获取过期时间

* @param key 键 不能为null

* @return 时间(秒) 返回0代表为永久有效

*/

public long getExpire(String key) {

return redisTemplate.getExpire(key, TimeUnit.SECONDS);

}

/**

* 判断key是否存在

* @param key 键

* @return true 存在 false不存在

*/

public boolean hasKey(String key) {

try {

return redisTemplate.hasKey(key);

} catch (Exception e) {

e.printStackTrace();

return false;

}

}

/**

* 删除缓存

* @param key 可以传一个值 或多个

*/

@SuppressWarnings("unchecked")

public void del(String... key) {

if (key != null && key.length > 0) {

if (key.length == 1) {

redisTemplate.delete(key[0]);

} else {

redisTemplate.delete(CollectionUtils.arrayToList(key));

}

}

}

// ============================String=============================

/**

* 普通缓存获取

* @param key 键

* @return 值

*/

public Object get(String key) {

return key == null ? null : redisTemplate.opsForValue().get(key);

}

/**

* 普通缓存放入

* @param key 键

* @param value 值

* @return true成功 false失败

*/

public boolean set(String key, Object value) {

try {

redisTemplate.opsForValue().set(key, value);

return true;

} catch (Exception e) {

e.printStackTrace();

return false;

}

}

/**

* 普通缓存放入并设置时间

* @param key 键

* @param value 值

* @param time 时间(秒) time要大于0 如果time小于等于0 将设置无限期

* @return true成功 false 失败

*/

public boolean set(String key, Object value, long time) {

try {

if (time > 0) {

redisTemplate.opsForValue().set(key, value, time, TimeUnit.SECONDS);

} else {

set(key, value);

}

return true;

} catch (Exception e) {

e.printStackTrace();

return false;

}

}

/**

* 递增

* @param key 键

* @param delta 要增加几(大于0)

*/

public long incr(String key, long delta) {

if (delta < 0) {

throw new RuntimeException("递增因子必须大于0");

}

return redisTemplate.opsForValue().increment(key, delta);

}

/**

* 递减

* @param key 键

* @param delta 要减少几(小于0)

*/

public long decr(String key, long delta) {

if (delta < 0) {

throw new RuntimeException("递减因子必须大于0");

}

return redisTemplate.opsForValue().increment(key, -delta);

}

// ================================Map=================================

/**

* HashGet

* @param key 键 不能为null

* @param item 项 不能为null

*/

public Object hget(String key, String item) {

return redisTemplate.opsForHash().get(key, item);

}

/**

* 获取hashKey对应的所有键值

* @param key 键

* @return 对应的多个键值

*/

public Map<Object, Object> hmget(String key) {

return redisTemplate.opsForHash().entries(key);

}

/**

* HashSet

* @param key 键

* @param map 对应多个键值

*/

public boolean hmset(String key, Map<String, Object> map) {

try {

redisTemplate.opsForHash().putAll(key, map);

return true;

} catch (Exception e) {

e.printStackTrace();

return false;

}

}

/**

* HashSet 并设置时间

* @param key 键

* @param map 对应多个键值

* @param time 时间(秒)

* @return true成功 false失败

*/

public boolean hmset(String key, Map<String, Object> map, long time) {

try {

redisTemplate.opsForHash().putAll(key, map);

if (time > 0) {

expire(key, time);

}

return true;

} catch (Exception e) {

e.printStackTrace();

return false;

}

}

/**

* 向一张hash表中放入数据,如果不存在将创建

*

* @param key 键

* @param item 项

* @param value 值

* @return true 成功 false失败

*/

public boolean hset(String key, String item, Object value) {

try {

redisTemplate.opsForHash().put(key, item, value);

return true;

} catch (Exception e) {

e.printStackTrace();

return false;

}

}

/**

* 向一张hash表中放入数据,如果不存在将创建

*

* @param key 键

* @param item 项

* @param value 值

* @param time 时间(秒) 注意:如果已存在的hash表有时间,这里将会替换原有的时间

* @return true 成功 false失败

*/

public boolean hset(String key, String item, Object value, long time) {

try {

redisTemplate.opsForHash().put(key, item, value);

if (time > 0) {

expire(key, time);

}

return true;

} catch (Exception e) {

e.printStackTrace();

return false;

}

}

/**

* 删除hash表中的值

*

* @param key 键 不能为null

* @param item 项 可以使多个 不能为null

*/

public void hdel(String key, Object... item) {

redisTemplate.opsForHash().delete(key, item);

}

/**

* 判断hash表中是否有该项的值

*

* @param key 键 不能为null

* @param item 项 不能为null

* @return true 存在 false不存在

*/

public boolean hHasKey(String key, String item) {

return redisTemplate.opsForHash().hasKey(key, item);

}

/**

* hash递增 如果不存在,就会创建一个 并把新增后的值返回

*

* @param key 键

* @param item 项

* @param by 要增加几(大于0)

*/

public double hincr(String key, String item, double by) {

return redisTemplate.opsForHash().increment(key, item, by);

}

/**

* hash递减

*

* @param key 键

* @param item 项

* @param by 要减少记(小于0)

*/

public double hdecr(String key, String item, double by) {

return redisTemplate.opsForHash().increment(key, item, -by);

}

// ============================set=============================

/**

* 根据key获取Set中的所有值

* @param key 键

*/

public Set<Object> sGet(String key) {

try {

return redisTemplate.opsForSet().members(key);

} catch (Exception e) {

e.printStackTrace();

return null;

}

}

/**

* 根据value从一个set中查询,是否存在

*

* @param key 键

* @param value 值

* @return true 存在 false不存在

*/

public boolean sHasKey(String key, Object value) {

try {

return redisTemplate.opsForSet().isMember(key, value);

} catch (Exception e) {

e.printStackTrace();

return false;

}

}

/**

* 将数据放入set缓存

*

* @param key 键

* @param values 值 可以是多个

* @return 成功个数

*/

public long sSet(String key, Object... values) {

try {

return redisTemplate.opsForSet().add(key, values);

} catch (Exception e) {

e.printStackTrace();

return 0;

}

}

/**

* 将set数据放入缓存

*

* @param key 键

* @param time 时间(秒)

* @param values 值 可以是多个

* @return 成功个数

*/

public long sSetAndTime(String key, long time, Object... values) {

try {

Long count = redisTemplate.opsForSet().add(key, values);

if (time > 0)

expire(key, time);

return count;

} catch (Exception e) {

e.printStackTrace();

return 0;

}

}

/**

* 获取set缓存的长度

*

* @param key 键

*/

public long sGetSetSize(String key) {

try {

return redisTemplate.opsForSet().size(key);

} catch (Exception e) {

e.printStackTrace();

return 0;

}

}

/**

* 移除值为value的

*

* @param key 键

* @param values 值 可以是多个

* @return 移除的个数

*/

public long setRemove(String key, Object... values) {

try {

Long count = redisTemplate.opsForSet().remove(key, values);

return count;

} catch (Exception e) {

e.printStackTrace();

return 0;

}

}

// ===============================list=================================

/**

* 获取list缓存的内容

*

* @param key 键

* @param start 开始

* @param end 结束 0 到 -1代表所有值

*/

public List<Object> lGet(String key, long start, long end) {

try {

return redisTemplate.opsForList().range(key, start, end);

} catch (Exception e) {

e.printStackTrace();

return null;

}

}

/**

* 获取list缓存的长度

*

* @param key 键

*/

public long lGetListSize(String key) {

try {

return redisTemplate.opsForList().size(key);

} catch (Exception e) {

e.printStackTrace();

return 0;

}

}

/**

* 通过索引 获取list中的值

*

* @param key 键

* @param index 索引 index>=0时, 0 表头,1 第二个元素,依次类推;index<0时,-1,表尾,-2倒数第二个元素,依次类推

*/

public Object lGetIndex(String key, long index) {

try {

return redisTemplate.opsForList().index(key, index);

} catch (Exception e) {

e.printStackTrace();

return null;

}

}

/**

* 将list放入缓存

*

* @param key 键

* @param value 值

*/

public boolean lSet(String key, Object value) {

try {

redisTemplate.opsForList().rightPush(key, value);

return true;

} catch (Exception e) {

e.printStackTrace();

return false;

}

}

/**

* 将list放入缓存

* @param key 键

* @param value 值

* @param time 时间(秒)

*/

public boolean lSet(String key, Object value, long time) {

try {

redisTemplate.opsForList().rightPush(key, value);

if (time > 0)

expire(key, time);

return true;

} catch (Exception e) {

e.printStackTrace();

return false;

}

}

/**

* 将list放入缓存

*

* @param key 键

* @param value 值

* @return

*/

public boolean lSet(String key, List<Object> value) {

try {

redisTemplate.opsForList().rightPushAll(key, value);

return true;

} catch (Exception e) {

e.printStackTrace();

return false;

}

}

/**

* 将list放入缓存

*

* @param key 键

* @param value 值

* @param time 时间(秒)

* @return

*/

public boolean lSet(String key, List<Object> value, long time) {

try {

redisTemplate.opsForList().rightPushAll(key, value);

if (time > 0)

expire(key, time);

return true;

} catch (Exception e) {

e.printStackTrace();

return false;

}

}

/**

* 根据索引修改list中的某条数据

*

* @param key 键

* @param index 索引

* @param value 值

* @return

*/

public boolean lUpdateIndex(String key, long index, Object value) {

try {

redisTemplate.opsForList().set(key, index, value);

return true;

} catch (Exception e) {

e.printStackTrace();

return false;

}

}

/**

* 移除N个值为value

*

* @param key 键

* @param count 移除多少个

* @param value 值

* @return 移除的个数

*/

public long lRemove(String key, long count, Object value) {

try {

Long remove = redisTemplate.opsForList().remove(key, count, value);

return remove;

} catch (Exception e) {

e.printStackTrace();

return 0;

}

}

}

所有的redis操作,其实对于java开发人员来说,十分的简单,更重要是去理解redis的思想和每一种数据结构的用处和作用

测试:

@Autowired

private RedisUtil redisUtil;

@Test

public void test2(){

redisUtil.set("aka", "JessieLee");

System.err.println(redisUtil.get("aka"));

}

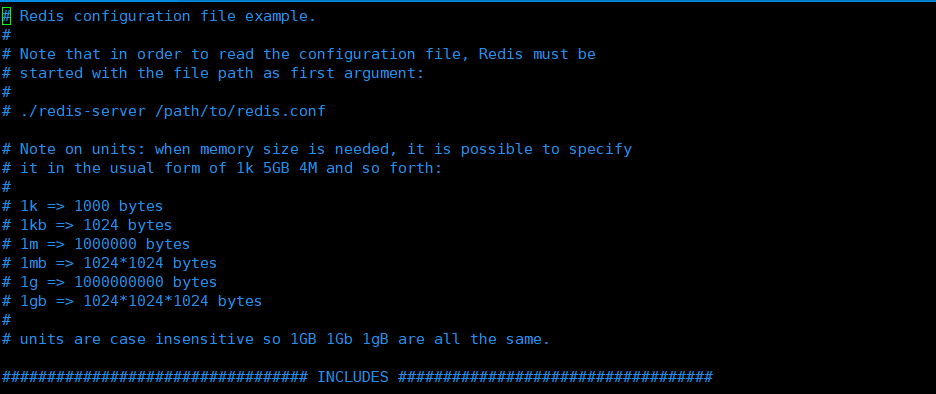

8、Redis配置文件详解

Redis.conf详解

启动的时候,就通过配置文件来启动.

单位

设置最大值大小,配置文件对大小写不敏感

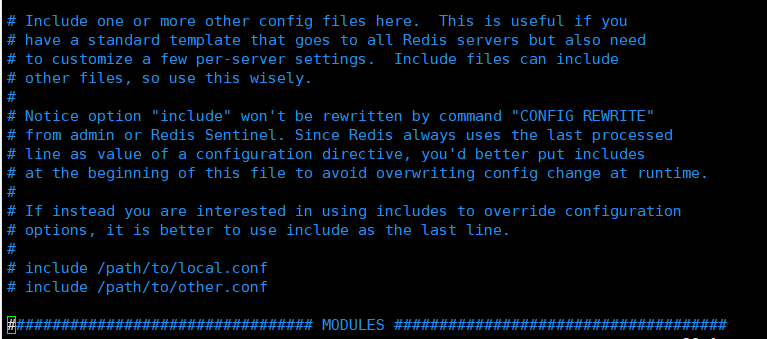

包含

好比我们学习Spring、Improt、Include

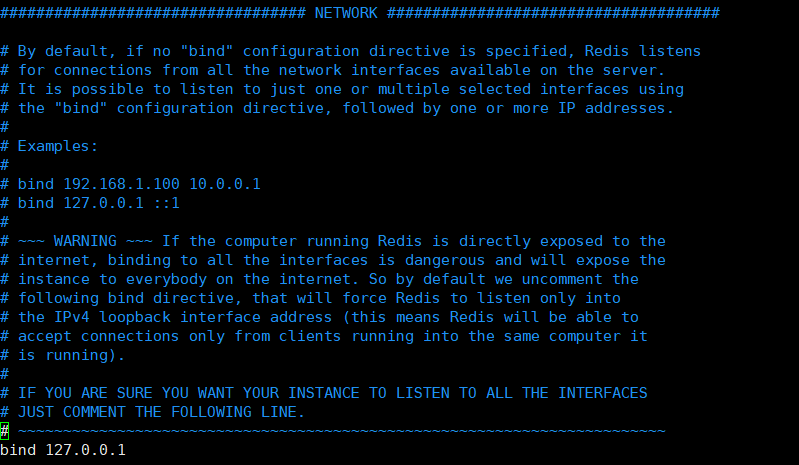

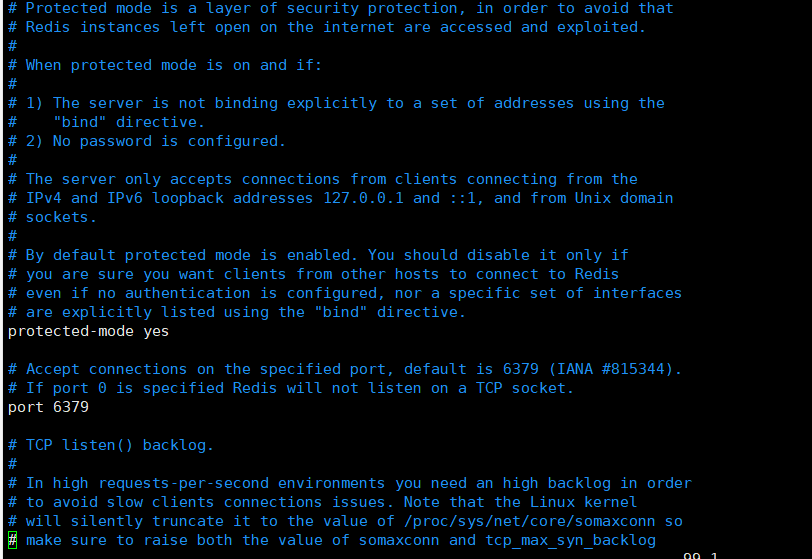

网络

bind 127.0.0.1 # 绑定 ip

protected-mode yes # 保护模式

port 6379 # 端口号

通用 GENERAL

daemonize yes # 以守护进程的方式运行,默认是 no,我们需要自己开启为yes

pidfile /var/run/redis_6379.pid # 如果以后台的方式运行,我们就需要指定一个 pid 文件

# 日志

# Specify the server verbosity level.

# This can be one of:

# debug (a lot of information, useful for development/testing) # 一般用于测试开发阶段

# verbose (many rarely useful info, but not a mess like the debug level)

# notice (moderately verbose, what you want in production probably) # 生产环境

# warning (only very important / critical messages are logged)

loglevel notice

logfile "" # 日志的文件位置

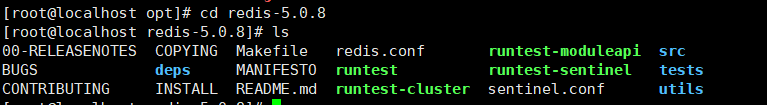

database 16 # 数据库数量,默认是16个数据库

always-show-logio yes # 是否总显示logo

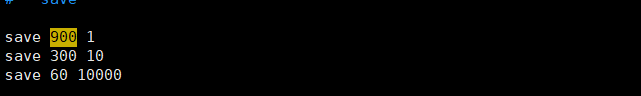

快照 SNAPSHOTTING

持久化,在规定的时间内,执行了多少次操作,则会持久化到文件/生成一个快照 .rdb .aof

redis是内存数据库,如果没有持久化,那么数据断电即失

# 如果900s内,至少有 1 个 key 进行了修改,我们就进行持久化操作

save 900 1

# 如果300s内,至少有 10 个 key 进行了修改,我们就进行持久化操作

save 300 10

# 如果600s内,至少有 10000 个 key 进行了修改,我们就进行持久化操作

save 60 10000

# 我们之后学习持久化,会自己定义这个测试

stop-writes-on-bgsave-error yes # 持久化如果出错,是否还需要继续工作

rdbcompression yes # 是否压缩 rdb 文件,需要消耗一些 cpu 资源

rdbchecksum yes # 保存 rdb 文件的时候,进行错误的检查校验

dir ./ # rdb 文件保存的目录

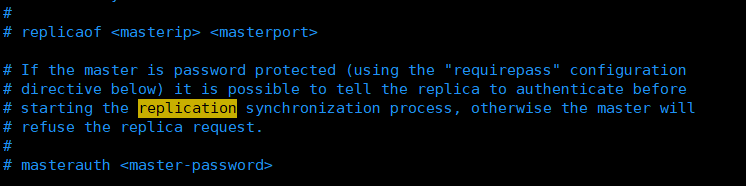

REPLICATION 复制,配置主机信息与密码

SECURITY 安全

可以在这里设置 redis 的密码,默认没有密码。

127.0.0.1:6379> config get requirepass # 获取 redis 的密码

1) "requirepass"

2) ""

127.0.0.1:6379> config set requirepass "123456" # 设置 redis 密码

OK

127.0.0.1:6379> config get requirepass # 未登录没有权限去使用命令

(error) NOAUTH Authentication required.

127.0.0.1:6379> ping

(error) NOAUTH Authentication required.

127.0.0.1:6379> auth 123456 # 登录 redis 输入密码

OK

127.0.0.1:6379> ping

PONG

127.0.0.1:6379> config get requirepass # 获取 redis 密码

1) "requirepass"

2) "123456"

限制 CLIENTS

maxclients 10000 # 设置能连接上 redis 的最大客户端数量

maxmemory <bytes> # redis 配置最大的内存容量

maxmemory-policy noeviction # 内存到达上限之后的处理策略

1、volatile-lru:只对设置了过期时间的key进行LRU(默认值)

2、allkeys-lru : 删除lru算法的key

3、volatile-random:随机删除即将过期key

4、allkeys-random:随机删除

5、volatile-ttl : 删除即将过期的

6、noeviction : 永不过期,返回错误

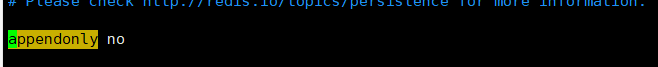

APPEND ONLY 模式 aof配置

appendonly no # 默认是不开启aof模式的,默认是使用rdb方式持久化的,大部分情况下 rdb 完全够用

appendfilename "appendonly.aof" # 持久化文件的名字

# appendfsync always # 每次修改都会 sync,消耗性能

appendfsync everysec # 每秒执行一次 sync,可能会丢失这1s的数据

# appendfsync no # 不执行 sync,这时操作系统自己同步数据,速度最快

具体的配置,在 Redis持久化中。

9、Redis持久化(重点)

Redis 是内存数据库,如果不将内存中的数据库状态保存到磁盘,那么一旦服务器进程退出,服务器中的数据库状态也会消失,所以 Redis 提供了持久化功能。

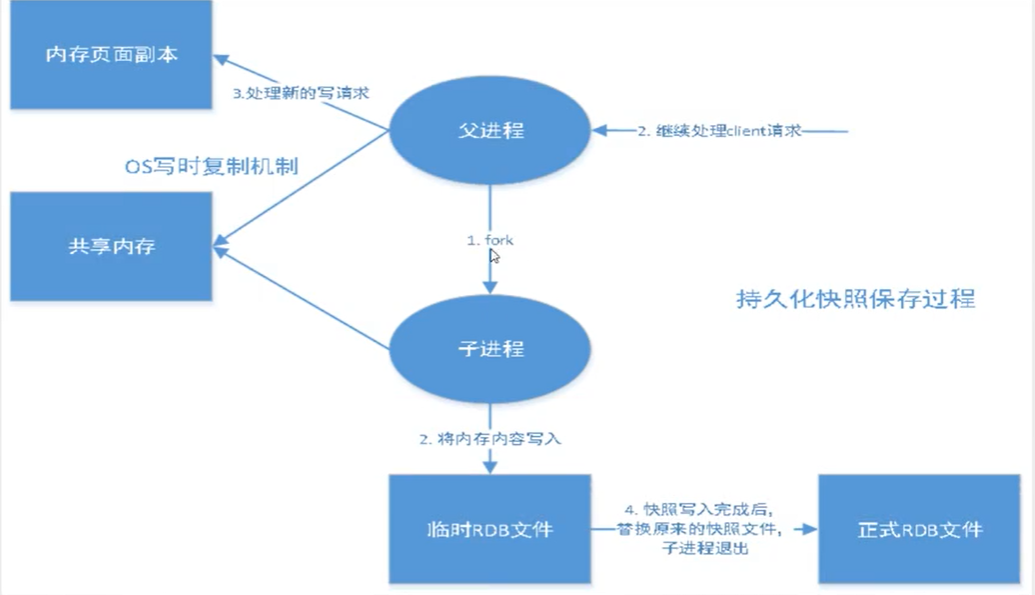

RDB(Redis DataBase)

在指定的时间间隔内,将内存中的数据集快照写入磁盘,也就是行话讲的Snapshot快照,它恢复时是将快照文件直接读到内存里。

Redis会单独创建(fork)一个子进程来进行持久化,会将数据写入到一个临时文件中,这个文件会进行持久化操作,等持久化过程都结束了,再用这个临时文件替换上次持久化好的文件。整个过程中,主进程是不进行任何IO操作的,这就确保了极高的性能。如果需要进行大规模数据的恢复,且对于数据恢复的完整性不是非常敏感,那RDB方式要比AOF方式更加高效。RDB的缺点是最后一次持久化的数据可能丢失。我们默认的就是RDB,一般情况下不需要修改这个配置。

有时候在生产环境我们会将这个文件进行备份。

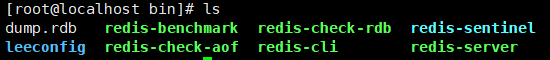

rdb保存的文件是 dump.rdb 都是在我们的配置文件中,快照(snapshot)进行配置的

rdb 触发机制

- 在save的规则满足下,会自动触发rdb规则。

- 执行 flushall 清空命令,会触发产生一个rdb文件。

- 退出 redis,也会产生 rdb 文件。

备份会自动生产一个 dump.rdb 文件

如何恢复 rdb 文件

- 只需要将 rdb 文件放在我们redis启动目录就可以,redis启动的时候会自动检查 dump.rdb 恢复其中的数据

- 查看需要存在的位置

127.0.0.1:6379> config get dir

1) "dir"

2) "/usr/local/bin" # 如果在这个目录下存 dump.rdb,启动就会自动恢复其中的数据

几乎就它自己默认的配置就够用了,但是我们还是需要去学习。

优点:

- 适合大规模的数据恢复。(因为父进程正常处理客户端请求,而子进程进行folk,性能非常高,宕机后有dump.rdb)

- 对数据的完整性要求不高

缺点:

- 需要一定的时间间隔进程操作。(我们可以自己设置)

- 如果redis意外宕机了,这个最后一次修改数据就没有了。

- fork进程的时候,会占用一定的内存空间

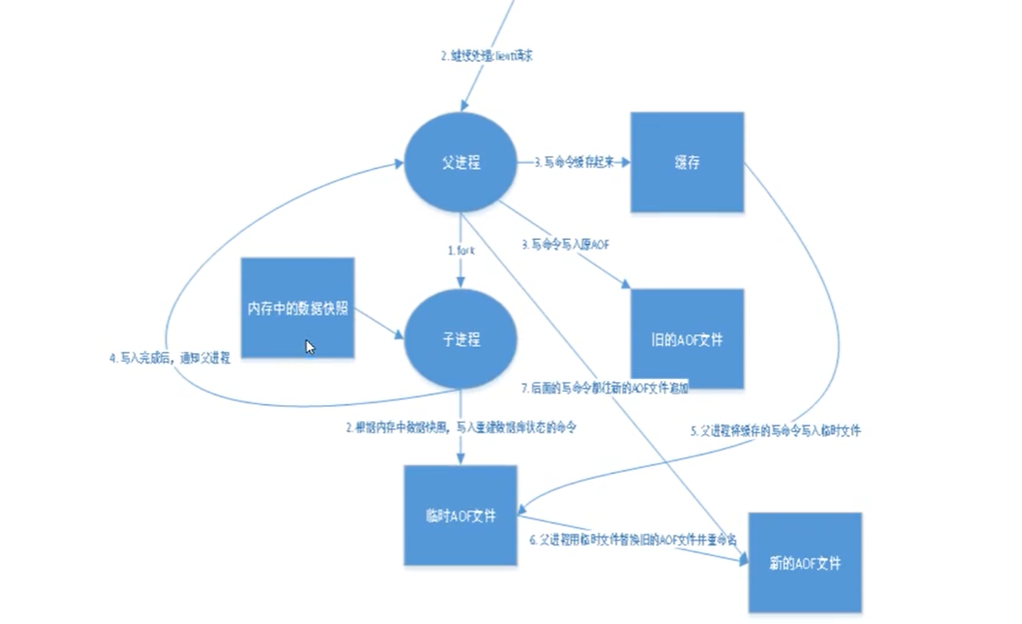

AOF(Append Only File)

将我们的所有命令都记录下来,history,恢复的时候就把这个文件全部再执行一遍。

以日志的形式来记录每个写操作,将Redis执行过的所有指令记录下来(读操作不记录),只许追加文件但不可以改写文件,redis重启的话,就根据日志文件的内容,将写指令从头到尾执行一次,以完成数据的恢复工作。

如果我们破坏了 aof 文件,aof 有错误,这时,是启动不了 redis 的。我们需要修复 aof 配置文件,redis给我们提供了 redis-check-aof --fix appendonly.aof

如果文件正常,重启就可以直接恢复了。可能会丢失小部分数据。

Aop保存的文件是 appendonly.aof 文件

append

默认是不开启的,我们需要手动配置,将 no 变为 yes

持久化策略

如果 aof 文件大于64m,fork一个新的进程来将我们的文件进行重写。(aof 默认就是文件无限追加,文件越来越大)

Aof 优点与缺点

appendonly no # 默认情况下不开启aof模式,默认使用rdb方式持久化。

# The name of the append only file (default: "appendonly.aof") # 持久化文件的名字

# appendfsync always # 每次修改都会 sync,消耗性能

appendfsync everysec # 每秒执行一次 sync,可能会丢失这1s的数据

# appendfsync no # 不执行 sync,这时操作系统自己同步数据,速度最快

优点:

- 每一次修改都同步,文件完整性强

- 每秒同步一次,可能会丢失一秒的数据

- 从不同步,效率最高。

缺点:

- 相对于数据文件来说,aof 远远大于 rdb,修复的速度也比 rdb 慢

- Aof 运行效率也要比 rdb 慢,所以我们 redis 默认的配置就是 rdb 持久化而不是 aof。

10、Redis发布订阅

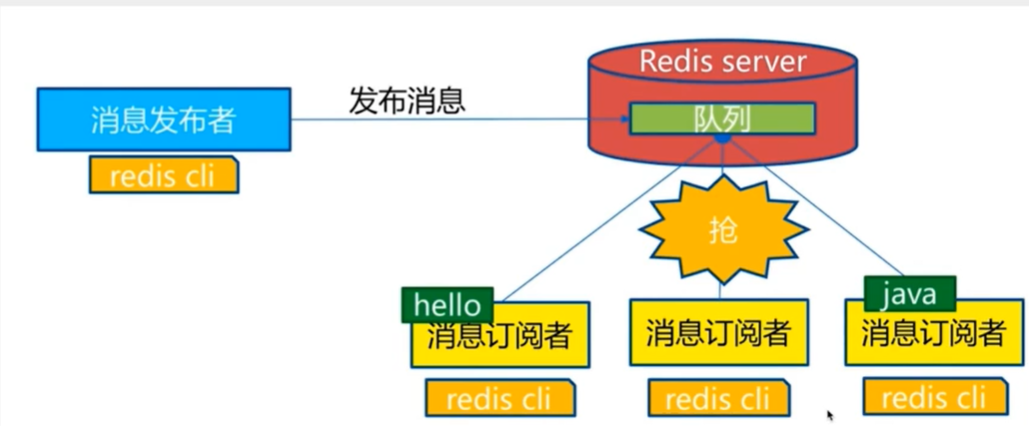

通信 队列 发送者 ==> 订阅者

Redis 发布订阅(pub/sub)是一种消息通信模式:发送者(pub)发送消息,订阅者(sub)接收消息。微信、微博、关注系统。

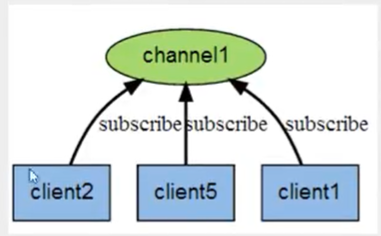

Redis 客户端可以订阅任意数量的频道。

订阅/发布消息图:

第一个:消息发送者,第二个:频道,第三个:消息订阅者

频道channel1,以及订阅这个频道的三个客户端-client2、client5和client1之间的关系

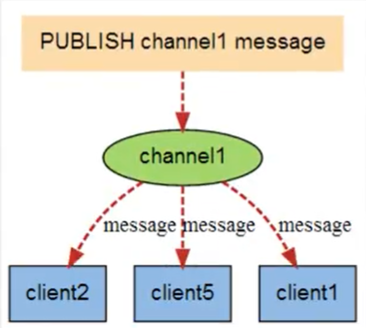

当有新消息通过 PUBLISH 命令发送给频道 channel1 时,这个消息就会被发送给订阅它的三个客户端:

| 序号 | 命令及描述 |

|---|---|

| 1 | PSUBSCRIBE pattern [pattern …] 订阅一个或多个符合给定模式的频道。 |

| 2 | PUBSUB subcommand [argument [argument …]] 查看订阅与发布系统状态。 |

| 3 | PUBLISH channel message 将信息发送到指定的频道。 |

| 4 | PUNSUBSCRIBE [pattern [pattern …]] 退订所有给定模式的频道。 |

| 5 | SUBSCRIBE channel [channel …] 订阅给定的一个或多个频道的信息。 |

| 6 | UNSUBSCRIBE [channel [channel …]] 指退订给定的频道。 |

测试

订阅端:

127.0.0.1:6379> subscribe swaelee # 订阅一个频道 名为swaelee

Reading messages... (press Ctrl-C to quit)

1) "subscribe"

2) "swaelee"

3) (integer) 1

# 等待读取推送的信息

1) "message" # 消息

2) "swaelee" # 消息来源频道

3) "hello,swaeleegang" # 消息的具体内容

1) "message"

2) "swaelee"

3) "hello.redis yo"

发送端:

127.0.0.1:6379> publish swaelee "hello,swaeleegang" # 发布者发布消息到频道

(integer) 1

127.0.0.1:6379> publish swaelee "hello.redis yo" # 发布者发布消息到频道

(integer) 1

127.0.0.1:6379>

原理

Redis是使用C实现的,通过分析 Redis 源码里的 pubsub.c 文件,了解发布和订阅机制的底层实现,加深对 Redis 的理解。

Redis 通过 Publish、Subscribe 和 Psubscribe 等命令实现发布和订阅功能

通过 SUBSCRIBE 命令订阅某频道后,redis-server 里维护了一个字典,字典的键就是一个个 频道,而字典的值则是一个链表,链表中保存了所有订阅这个 channel 的客户端。SUBSCRIBE 命令的关键,就是将客户端添加到给定 channel 的订阅链表中。

通过 PUBLISH 命令向订阅者发送消息,redis-server 会使用给定的频道作为键,在它所维护的 channel 字典中查找订阅了这个频道的所有客户端链表,遍历这个链表,将消息发布给所有订阅者。

使用场景:

- 实时消息系统

- 事实聊天(频道当作聊天室,将信息回显给所有人)

- 订阅,关注系统

稍微复杂的场景我们会使用 消息中间件 MQ

11、Redis主从复制

概念

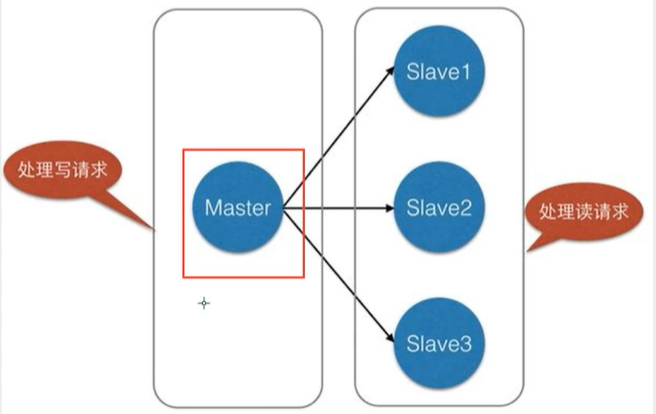

主从复制,是指将一台Redis服务器的数据,复制到其他的Redis服务器。前者称为主节点(master/leader),后者称为从节点(slave/follower);数据的复制是单向的,只能由主节点到从节点。Master以写为主,Slave以读为主。

默认的情况下,每台Redis服务器都是主节点;

且一个主节点可以有多个从节点(或者没有从节点),但一个从节点只能有一个主节点。

主从复制的作用主要包括:

- 数据冗余:主从复制实现了数据的热备份,是持久化之外的一种数据冗余方式

- 故障恢复:当主节点出现问题时,可以由从节点提供服务,实现快速的故障恢复;实际上是一种服务的冗余。

- 负载均衡:在主从复制的基础上,配合读写分离,可以由主节点提供写服务,由从节点提供读服务(即写Redis数据时应用连接主节点,读Redis数据时应用连接从节点),分担服务器负载;尤其是在写少读多的场景下,通过多个节点分担读负载,可以大大提高Redis服务器的并发量。

- 高可用(集群)基石:除了上述作用之外,主从复制还是哨兵和集群能够实施的基础,因此说主从复制是Redis高可用的基础。

一般来说,要将Redis运用于工程项目中,只使用一台Redis是万万不能的(宕机,一主二从),原因如下:

- 从结构上,单个 Redis 服务器会发生单点故障,并且一台服务器需要处理所有的请求负载,压力较大;

- 从容量上,单个 Redis 服务器内存容量有限,就算一台服务器内存容量为256G,也不能将所有内存用作 Redis 存储内存,一般来说,单台 Redis 最大使用内存不应该超过 20G。

电商网站上的商品,一般都是一次上传,无数次浏览的,也就是"多读少写"

对于这种场景,我们可以使用如下架构:

主从复制,读写分离,80%的情况下都是在进行读操作,减缓服务器的压力,架构中经常使用。(最低:一主二从)

只要在公司中,主从复制就是必须要使用的,因为在真实的项目中不可能单机使用Redis。

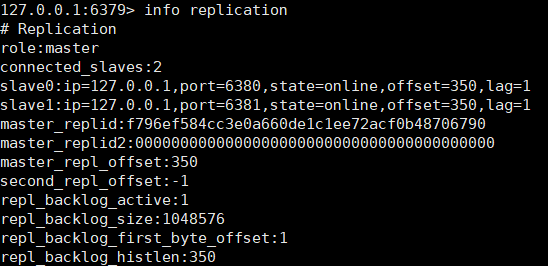

环境配置

只配置从库,不用配置主库。

127.0.0.1:6379> info replication # 查看当前库的信息

# Replication

role:master # 角色 master

connected_slaves:0 # 没有从机

master_replid:9a80bf5d68a4555e156dfd9066b06069e4df33dc

master_replid2:0000000000000000000000000000000000000000

master_repl_offset:0

second_repl_offset:-1

repl_backlog_active:0

repl_backlog_size:1048576

repl_backlog_first_byte_offset:0

repl_backlog_histlen:0

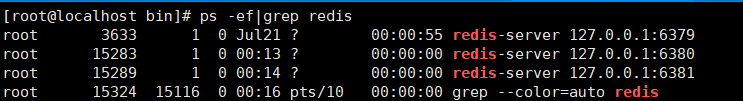

单机多集群

复制三个配置文件,修改对应的信息

- 端口号

- pid 名字

- log 文件名字

- dump.rdb 名字

修改完毕之后,启动三个redis服务器,可以通过进程信息查看。

一主而从

默认的情况下,每台Redis服务器都是主节点; 我们一般情况下,只用配置从机就好了

认老大,一主(79)二从(80,81)slaveof

127.0.0.1:6380> slaveof 127.0.0.1 6379 # Slaveof host 6379 找谁当自己的老大

OK

127.0.0.1:6380> info replication

# Replication

role:slave # 当前角色是从机

master_host:127.0.0.1 # 可以看到主机的信息

master_port:6379

master_link_status:up

master_last_io_seconds_ago:2

master_sync_in_progress:0

slave_repl_offset:42

slave_priority:100

slave_read_only:1

connected_slaves:0

master_replid:f796ef584cc3e0a660de1c1ee72acf0b48706790

master_replid2:0000000000000000000000000000000000000000

master_repl_offset:42

second_repl_offset:-1

repl_backlog_active:1

repl_backlog_size:1048576

repl_backlog_first_byte_offset:1

repl_backlog_histlen:42

# 在主机中查看

127.0.0.1:6379> info replication

# Replication

role:master

connected_slaves:1 # 多了从机的信息

slave0:ip=127.0.0.1,port=6380,state=online,offset=70,lag=0 # 多了从机的配置

master_replid:f796ef584cc3e0a660de1c1ee72acf0b48706790

master_replid2:0000000000000000000000000000000000000000

master_repl_offset:70

second_repl_offset:-1

repl_backlog_active:1

repl_backlog_size:1048576

repl_backlog_first_byte_offset:1

repl_backlog_histlen:70

# 配置第二个从机

127.0.0.1:6381> slaveof 127.0.0.1 6379

OK

127.0.0.1:6381> clear

127.0.0.1:6381> info replication

# Replication

role:slave

master_host:127.0.0.1

master_port:6379

master_link_status:up

master_last_io_seconds_ago:3

master_sync_in_progress:0

slave_repl_offset:322

slave_priority:100

slave_read_only:1

connected_slaves:0

master_replid:f796ef584cc3e0a660de1c1ee72acf0b48706790

master_replid2:0000000000000000000000000000000000000000

master_repl_offset:322

second_repl_offset:-1

repl_backlog_active:1

repl_backlog_size:1048576

repl_backlog_first_byte_offset:323

repl_backlog_histlen:0

如果两个都配置完了,就有了两个从机的

真实的主从配置应该在配置文件中配置,这样的话是永久的,这里我们使用的是命令,暂时的。

细节

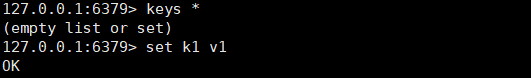

主机可以写,从机不可能写只能读。主机中所有信息和数据,都会自动被从机保存。

主机写:

从机只能读:

测试:主机断开连接,从机依旧连接着主机,但是没有写操作,这时主机如果回来了,从机依旧可以直接获取主机写的信息

如果使用命令行配置的主从,如果重启了服务,就会变回主机。只要变为从机,立马就会从主机中获取值。

复制原理

Slave 启动成功连接到 master 后会发送一个 sync 同步命令

Master 接到命令,启动后台的存盘进程,同时收集所有接收到的用于修改数据集命令,在后台进程执行完毕之后,master 将传送整个数据文件到 slave,并完成一次完全同步。

- 全量复制:而 slave 服务在接收到数据库文件数据后,将其存盘并加载到内存中。

- 增量复制:Master 继续将新的所有收集的修改命令依次传给 slave,完成同步。

但是只要是重新连接master,一次完全同步(全量复制)将被自动执行。我们的数据一定可以在从机中看到。

宕机后手动配置主机

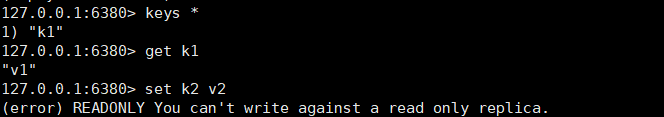

层层链路

上一个M连接下一个S

这时候也可以完成我们的主从复制。

如果没有老大了,这个时候能不能选择一个老大出来呢?手动

谋朝篡位

如果主机断开了连接,我们可以使用slaveof no one让自己变成主机,其他的节点就可以手动连接到最新的这个主节点,如果这时老大(6379)修复了,那就只能重新连接。

127.0.0.1:6381> slaveof no one

OK

127.0.0.1:6381> info replication

# Replication

role:master

connected_slaves:0

master_replid:5b60e9d093e2f585c3f43c249a17679adf18ac51

master_replid2:16cf8c166705396f1185c6691d1036b7f070d10f

master_repl_offset:2320

second_repl_offset:2321

repl_backlog_active:1

repl_backlog_size:1048576

repl_backlog_first_byte_offset:531

repl_backlog_histlen:1790

127.0.0.1:6381>

12、哨兵模式(重点)

(自动选取老大的模式)

概述

主从切换技术的方法是:当主服务器宕机后。需要手动把一台从服务器切换为主服务器,这就需要人工干预,费时费力,还会造成一段时间内服务不可用。这不是一种推荐的方式,更多时候,我们优先考虑哨兵模式。Redis从2.8开始正式提供了 Sentinel(哨兵)架构来解决这个问题。

谋朝篡位的自动版,能够后台监控主机是否故障,如果故障了根据投票数自动将从库转为主库。

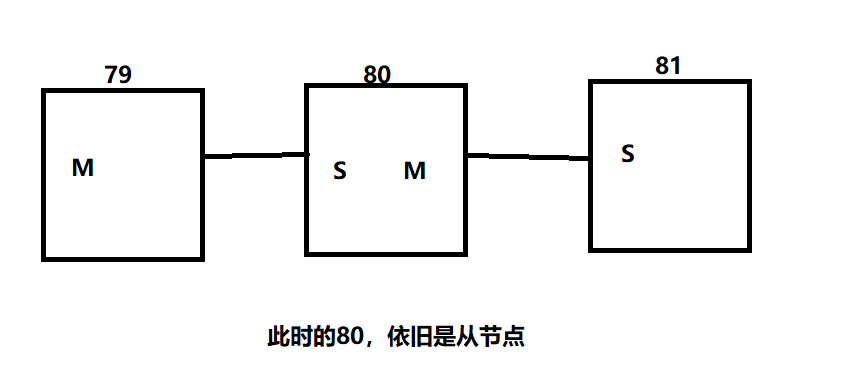

哨兵模式是一种特殊的模式,首先Redis提供了哨兵的命令,哨兵是一个独立的进程,作为进程,它就会独立运行。其原理是哨兵通过发送命令,等待Redis服务器响应,从而监控运行的多个Redis实例

这里哨兵模式的两个作用

- 通过发送命令,让Redis服务器返回监控其运行状态,包括主服务器和从服务器。

- 当哨兵监控到master宕机,会自动将slave切换成master,然后通过发布订阅模式通知其他的从服务器,修改配置文件,让它们切换主机。

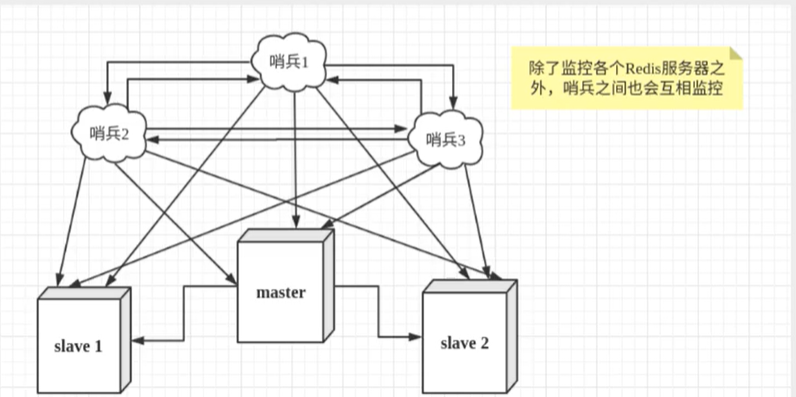

然而一个哨兵进程对Redis服务器进行监控,可能会出现问题,为此,我们可以使用多个哨兵进行监控。各个哨兵之间还会进行监控,这样就形成了多哨兵模式。

所以说,配置哨兵起步就是6个进程。

- 假设主服务器宕机,哨兵1先检测到这个结果,系统并不会马上进行failover(故障转移)过程,仅仅是哨兵1主观的认为主服务器不可用,这个现象称为主观下线。

- 当后面的哨兵也检测到主服务器不可用,并且数量达到一定值时,那么哨兵之间就会进行一次投票,投票的结果由一个哨兵发起,进行failover(故障转移)操作。切换成功后,就会通过发布订阅模式,让各个哨兵把自己监控的从服务器实现切换主机,这个过程称为客观下线。

测试

我们目前的状态是 一主二从。

- 配置哨兵配置文件 sentinel.conf(后面的这个数字1,代表主机挂了,slave投票看让谁接替成为主机,票数最多的就会成为主机)

# sentinel monitor 被监控的名称 host port

sentinel monitor myredis 127.0.0.1 6379 1

- 启动哨兵

[root@localhost bin]# redis-sentinel leeconfig/sentinel.conf

_._

_.-``__ ''-._

_.-`` `. `_. ''-._ Redis 5.0.8 (00000000/0) 64 bit

.-`` .-```. ```\/ _.,_ ''-._

( ' , .-` | `, ) Running in sentinel mode

|`-._`-...-` __...-.``-._|'` _.-'| Port: 26379

| `-._ `._ / _.-' | PID: 17166

`-._ `-._ `-./ _.-' _.-'

|`-._`-._ `-.__.-' _.-'_.-'|

| `-._`-._ _.-'_.-' | http://redis.io

`-._ `-._`-.__.-'_.-' _.-'

|`-._`-._ `-.__.-' _.-'_.-'|

| `-._`-._ _.-'_.-' |

`-._ `-._`-.__.-'_.-' _.-'

`-._ `-.__.-' _.-'

`-._ _.-'

`-.__.-'

17166:X 22 Jul 2021 02:44:34.276 # WARNING: The TCP backlog setting of 511 cannot be enforced because /proc/sys/net/core/somaxconn is set to the lower value of 128.

17166:X 22 Jul 2021 02:44:34.278 # Sentinel ID is ba57e9d78661e898ba6b2e0ac8a89254c6b1c899

17166:X 22 Jul 2021 02:44:34.278 # +monitor master myredis 127.0.0.1 6379 quorum 1 # 监控的主机为127.0.0.1 6379

17166:X 22 Jul 2021 02:44:34.279 * +slave slave 127.0.0.1:6380 127.0.0.1 6380 @ myredis 127.0.0.1 6379 # 发现还有两个从机 6380

17166:X 22 Jul 2021 02:44:34.279 * +slave slave 127.0.0.1:6381 127.0.0.1 6381 @ myredis 127.0.0.1 6379 # 发现还有两个从机 6381

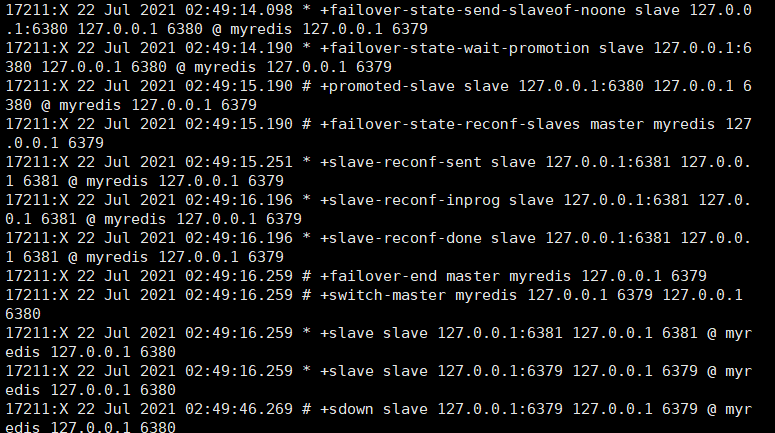

- 如果Master 节点断开了,这个时候就会从从机中随机选择一个服务器(这里有一个投票算法)

当新的主机选好后,这时原来的主机重新连接后,只能当从机,而它的主机为新选的主机

哨兵模式优缺点:

优点:

- 哨兵集群,基于主从复制模式,所有的主从配置优点,它全有。

- 主从可以切换,故障可以转移,系统的可用性更高。

- 哨兵模式是主从模式的升级,手动到自动,更加健壮。

缺点:

- Redis 不好在线扩容,集群容量一旦到达上限,在线扩容就十分麻烦。

- 实现哨兵模式的配置其实是很麻烦的,里面有很多选择。

哨兵模式的全部配置

如果有哨兵集群,我们还需要配置每个 哨兵端口

一般都是由运维来配置

# Example sentinel.conf

# 哨兵sentinel实例运行的端口 默认26379

port 26379

# 哨兵sentinel的工作目录

dir /tmp

# 哨兵sentinel监控的redis主节点的 ip port

# master-name 可以自己命名的主节点名字 只能由字母A-z、数字0-9 、这三个字符".-_"组成。

# quorum 当这些quorum个数sentinel哨兵认为master主节点失联 那么这时 客观上认为主节点失联了

# sentinel monitor <master-name> <ip> <redis-port> <quorum>

sentinel monitor mymaster 127.0.0.1 6379 1

# 当在Redis实例中开启了requirepass foobared 授权密码 这样所有连接Redis实例的客户端都要提供密码

# 设置哨兵sentinel 连接主从的密码 注意必须为主从设置一样的验证密码

# sentinel auth-pass <master-name> <password>

sentinel auth-pass mymaster MySUPER--secret-0123passw0rd

# 指定多少毫秒之后 主节点没有应答哨兵sentinel 此时 哨兵主观上认为主节点下线 默认30秒

# sentinel down-after-milliseconds <master-name> <milliseconds>

sentinel down-after-milliseconds mymaster 30000

# 这个配置项指定了在发生failover主备切换时最多可以有多少个slave同时对新的master进行 同步,

这个数字越小,完成failover所需的时间就越长,

但是如果这个数字越大,就意味着越 多的slave因为replication而不可用。

可以通过将这个值设为 1 来保证每次只有一个slave 处于不能处理命令请求的状态。

# sentinel parallel-syncs <master-name> <numslaves>

sentinel parallel-syncs mymaster 1

# 故障转移的超时时间 failover-timeout 可以用在以下这些方面:

#1. 同一个sentinel对同一个master两次failover之间的间隔时间。

#2. 当一个slave从一个错误的master那里同步数据开始计算时间。直到slave被纠正为向正确的master那里同步数据时。

#3.当想要取消一个正在进行的failover所需要的时间。

#4.当进行failover时,配置所有slaves指向新的master所需的最大时间。不过,即使过了这个超时,slaves依然会被正确配置为指向master,但是就不按parallel-syncs所配置的规则来了

# 默认三分钟

# sentinel failover-timeout <master-name> <milliseconds>

sentinel failover-timeout mymaster 180000

# SCRIPTS EXECUTION

#配置当某一事件发生时所需要执行的脚本,可以通过脚本来通知管理员,例如当系统运行不正常时发邮件通知相关人员。

#对于脚本的运行结果有以下规则:

#若脚本执行后返回1,那么该脚本稍后将会被再次执行,重复次数目前默认为10

#若脚本执行后返回2,或者比2更高的一个返回值,脚本将不会重复执行。

#如果脚本在执行过程中由于收到系统中断信号被终止了,则同返回值为1时的行为相同。

#一个脚本的最大执行时间为60s,如果超过这个时间,脚本将会被一个SIGKILL信号终止,之后重新执行。

#通知型脚本:当sentinel有任何警告级别的事件发生时(比如说redis实例的主观失效和客观失效等等),将会去调用这个脚本,

#这时这个脚本应该通过邮件,SMS等方式去通知系统管理员关于系统不正常运行的信息。调用该脚本时,将传给脚本两个参数,

#一个是事件的类型,

#一个是事件的描述。

#如果sentinel.conf配置文件中配置了这个脚本路径,那么必须保证这个脚本存在于这个路径,并且是可执行的,否则sentinel无法正常启动成功。

#通知脚本

# sentinel notification-script <master-name> <script-path>

sentinel notification-script mymaster /var/redis/notify.sh

# 客户端重新配置主节点参数脚本

# 当一个master由于failover而发生改变时,这个脚本将会被调用,通知相关的客户端关于master地址已经发生改变的信息。

# 以下参数将会在调用脚本时传给脚本:

# <master-name> <role> <state> <from-ip> <from-port> <to-ip> <to-port>

# 目前<state>总是“failover”,

# <role>是“leader”或者“observer”中的一个。

# 参数 from-ip, from-port, to-ip, to-port是用来和旧的master和新的master(即旧的slave)通信的

# 这个脚本应该是通用的,能被多次调用,不是针对性的。

# sentinel client-reconfig-script <master-name> <script-path>

sentinel client-reconfig-script mymaster /var/redis/reconfig.sh

13、Redis缓存穿透和雪崩(重点且常用)

服务的高可用问题

Redis缓存的使用,极大的提升了应用程序的性能和效率,特别是数据查询方面。但同时它也带来了一些问题,其中最要害的问题,就是数据一致性问题,从严格意义上讲这个问题无解。如果数据的一致性要求很高,那么就不能使用缓存。

另外的一些典型问题就是,缓存穿透、缓存雪崩和缓存击穿。目前,业界也有比较流行的解决方案。在此不会详细的去分析解决方案的底层。

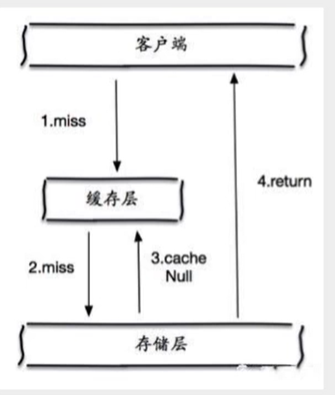

缓存穿透(查不到)

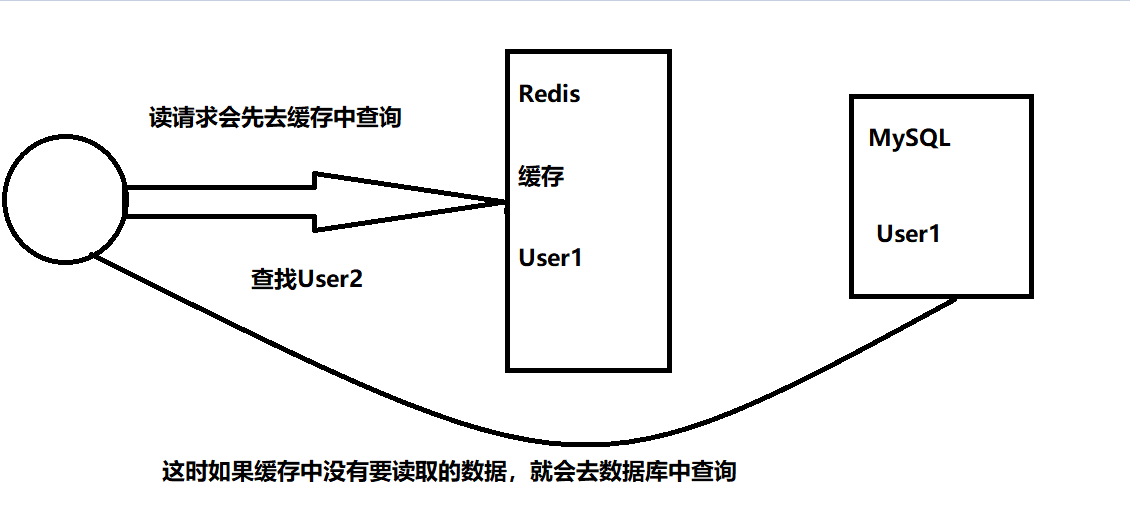

概念

当用户要查询一个不存在的数据User2时,发现redis内存数据库没有,也就是缓存没有命中,于是向持久层数据库查询,发现也没有,于是本次查询失败。当查询不存在数据的用户很多时,缓存都没有命中(秒杀场景),都去请求了持久层数据库。这会给持久层数据库造成很大的压力,这就相当于出现了缓存穿透。黑客利用此漏洞一直攻击可能会压垮数据库。

解决方案

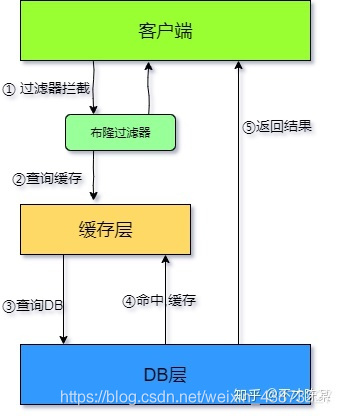

布隆过滤器

布隆过滤器是一种数据结构,对所有可能查询的参数以hash形式存储,在控制层先进行校验,不符合直接打回,减轻了对底层存储系统的查询压力。

缓存空对象

当缓存中没找到时,在缓存中存一个空对象用于处理后续的请求,同时会设置一个过期时间,之后再访问这个数据时将会从缓存中获取,保护了后端数据源。

但是这种方法会存在两个问题:

- 如果空值能够被缓存起来,这就意味着缓存需要更多的空间存储更多的键,因为这当中可能会有很多的空值键。

- 即使对空值设置了过期时间,还是会存在缓存层,和存储层的数据会有一段时间窗口的不一致,这对于需要保持一致性的业务会有影响。

缓存击穿(量太大,缓存过期)

概述

这里需要注意和缓存穿透的区别,缓存击穿,是指一个key非常热点,在不停的扛着大并发,大并发集中对这一个点进行访问,当这个key在失效的瞬间,持续的大并发就穿破缓存,直接请求数据库,就像在一个屏障上凿开了一个洞。(微博服务器宕机)

解决方案

1. 设置热点数据永不过期

从缓存层面来看,不设置过期时间,就不会出现热点数据过期的情况。但是当Redis内存空间满的时候也会清理部分数据,而且此种方案会占用空间,一旦热点数据多了起来,就会浪费空间。

2. 加互斥锁

分布式锁:保证每个key同时只有一个线程去查询后端服务。在访问key之前,采用SETNX(set if not exists)来设置另一个短期key来锁住当前key的访问,访问结束再删除该短期key。保证同时刻只有一个线程访问。将高并发的压力转移到了分布式锁,这样对分布式锁的要求就十分高。

缓存雪崩

概念

缓存雪崩,大量的key设置了相同的过期时间,缓存集中失效,造成瞬时DB请求量大、压力骤增,引起雪崩。

例如:在写本文时,马上就要到双十一零点,很快就会迎来一波抢购,这波商品时间比较集中的放入了缓存,假设缓存一小时。到了凌晨一点时缓存都过期了,而这批商品的访问查询就落到了数据库上,数据库产生周期性压力波峰。所有请求到达存储层,造成存储层挂掉的情况。

其中集中过期不是很致命,比较致命的缓存雪崩,是缓存服务器某个节点宕机或断网。因为自然形成的缓存雪崩,一定是在某个时间段集中创建缓存,这时数据库也可以顶住压力。无非就是对数据库产生周期性的压力而已。而缓存服务器节点的宕机,对数据库服务器造成的压力是不可预知的,很有可能瞬间就把数据库压垮。

双十一:停掉一些服务,保证主要的服务可用。

解决方案

Redis高可用

既然redis有可能挂掉,那我多增设几台redis,这样一台挂掉之后其他的还可以继续工作,其实就是搭建的集群。(异地多活)

限流降级(Spring Cloud)

这个解决方案的思想是,在缓存失效后,通过加锁或者队列来控制读数据库写缓存的线程数量。比如对某个key只允许一个线程查询数据和写缓存,其他线程等待。

数据预热

数据加热的含义就是在正式部署之前,我先把可能的==数据先预先访问一遍,这样部分可能大量访问的数据就会加载到缓存中。==在即将发生大并发访问前手动触发加载缓存不同的key,设置不同的过期时间,让缓存失效的时间点尽量均匀。

本笔记基于视频:B站狂神说

234

234

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?