spark安装踩坑

1.下载文件

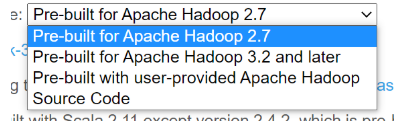

应当下载前三个,最后一个很小估计只有代码资源,该有的包都没有。于是直接运行bin/spark-shell 时会报错:Failed to find Spark jars directory (/opt/module/spark-3.1.1/assembly/target

2.JNI error

报错:A JNI error has occurred, please check your installation and try again

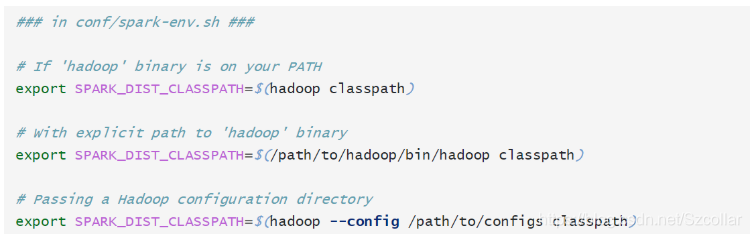

这种情况是由于*/opt/module/spark-3.1.1-bin-without-hadoop/conf目录下的配置文件spark-env.sh.template*没有配置,首先使用如下命令:

cp spark-env.sh.template spark-env.sh

然后根据官方文档中的描述添加配置信息:

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

3086

3086

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?