转载公众号 | 知识图谱科技

前言:

MedReason是由美国加州大学圣克鲁斯分校、加拿大不列颠哥伦比亚大学等机构联合推出的一个医学推理数据集。该项目旨在通过知识图谱引导的方式,为大型语言模型(LLMs)生成高质量的医学推理步骤,从而提升其在医学领域的推理能力和准确性。MedReason利用结构化的医学知识图谱,将临床问答对转换为逻辑推理链,生成详细的逐步解释,并通过监督微调(SFT)显著提升了模型在复杂临床场景的多个医学基准测试中的表现,其最佳模型MedReason-8B在多个医学问答基准测试中达到了最先进的性能,为医学AI的实际应用提供了重要支持。

摘要:

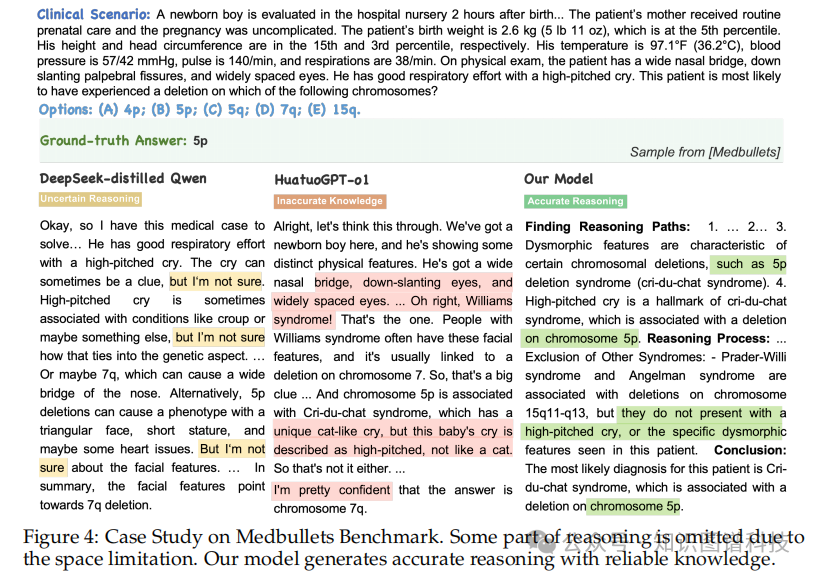

医疗任务如诊断和治疗计划需要精确且复杂的推理,特别是在生命攸关的领域。与数学推理不同,医疗推理要求细致、可验证的思维过程以确保可靠性和准确性。然而,目前缺乏提供透明、逐步推理的数据集来验证和提升人工智能模型的医疗推理能力。为了填补这一空白,我们推出了MedReason,一个大规模高质量的医疗推理数据集,旨在使大型语言模型(LLMs)能够进行忠实且可解释的医疗问题解决。我们利用结构化的医疗知识图谱(KG),将临床问答对转换为逻辑推理链或“思维路径”,这些路径通过相关的KG实体追踪从问题元素到答案的联系。每条路径都经过与临床逻辑和循证医学的一致性验证。我们的流程从7个医疗数据集中生成各种医疗问题的详细推理,得出一个包含32,682个问答对的数据集,每个问答对都有详细、逐步的解释。实验表明,用我们的数据集进行微调能够持续提升医疗问题解决能力,DeepSeek-Ditill-8B模型在临床基准MedBullets上取得了高达7.7%的显著增益。我们表现最佳的模型MedReason-8B,在临床基准MedBullets上比最先进的医疗推理模型Huatuo-01-8B高出最多4.2%。我们还邀请了来自不同专业的医疗专业人士来评估我们数据集的质量,确保MedReason提供准确且连贯的医疗推理。

问题:识别一种常用于急性呼吸窘迫综合症(ARDS)的治疗方法,但根据基于证据的研究,这种方法未被证明有效。

真实答案:吸入一氧化氮

GPT-4o生成的推理:……考虑到所有这些因素,我们生成的推理:……吸入一氧化氮可以解释,早期使用类固醇似乎可以通过解决ARDS低氧血症的常见但不太有效的治疗方法,暂时改善ARDS患者的氧合情况。然而,基于证据的研究表明,根据证据,它并没有改善存活率或长期结果。

图:来自华佗的CoT数据的示例,突出显示GPT-4o生成的推理过程中的事实错误。相比之下,我们生成的推理则能够得出正确答案,并具备准确的知识。

GitHub仓库:https://github.com/UCSC-VLAA/MedReason

HuggingFace模型库:https://huggingface.co/collections/UCSC-VLAA/medreason

arXiv技术论文:https://arxiv.org/pdf/2504.00993

核心速览

研究背景

- 研究问题

:这篇文章要解决的问题是如何在大型语言模型(LLMs)中通过知识图谱(KG)引导生成高质量的医疗推理链(Chain-of-Thought, CoT),以提高其在医疗任务中的可靠性和准确性。

- 研究难点

:该问题的研究难点包括:医疗任务的复杂性和精确性要求高,缺乏透明且逐步的推理数据集来验证和增强AI模型的医疗推理能力。

- 相关工作

:该问题的研究相关工作包括:利用知识图谱进行推理的LLMs、从开源推理模型中蒸馏CoT数据的方法、以及使用GPT-4o生成医疗CoT数据的研究。然而,这些方法在保持医学知识和事实一致性方面存在局限性。

研究方法

这篇论文提出了MedReason,一种大规模高质量的医疗推理数据集,用于在大语言模型中实现忠实且可解释的医疗问题解决。具体来说,

知识图谱整合:首先,利用结构化的医疗知识图谱将临床问答对转换为逻辑推理链。每个推理路径都通过与相关KG实体的连接进行验证,确保与临床逻辑和循证医学的一致性。

数据生成管道:生成管道包括以下步骤:

从7个医疗数据集中提取问答对。

使用LLM提取问答中的实体,并将这些实体映射到医疗知识图谱中的相应节点。

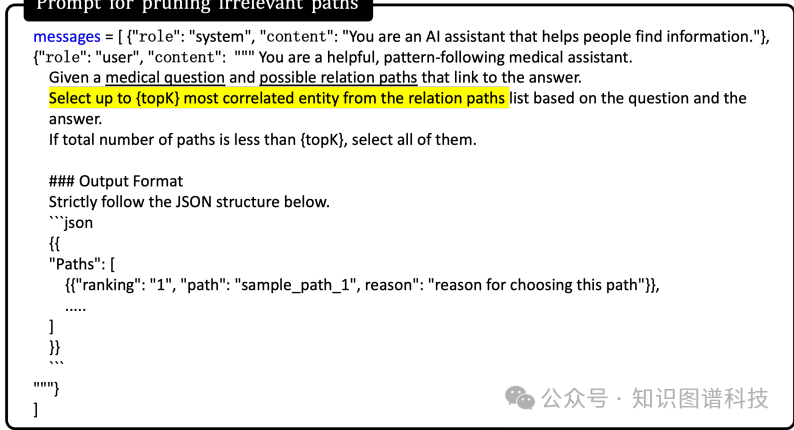

识别知识图谱中连接问答实体的所有推理路径,并指导LLM剪枝不相关的路径。

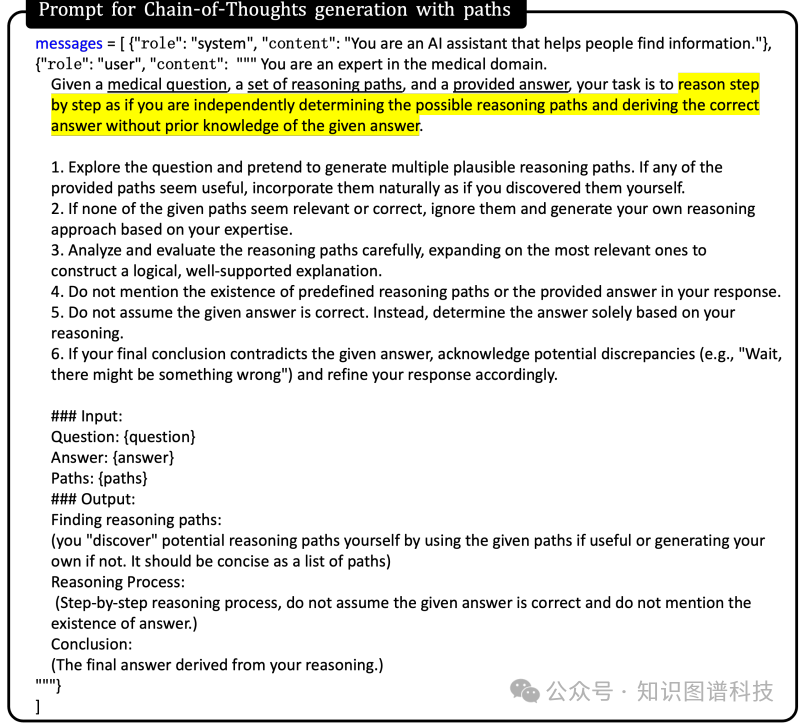

最终的推理路径作为结构化的支架,指导LLM生成医学上基于事实的CoT解释。

3. 质量过滤

:为了确保生成数据的准确性,实施了一个验证步骤,其中LLM使用生成的推理路径回答每个问题。系统地消除未能产生正确答案的CoT样本,确保只保留逻辑上合理且临床有效的推理路径。

实验设计

- 数据收集和预处理

:从多个医疗问答数据集中收集问答对,包括MedQA、MedMCQA、PubmedQA、MMLU-Pro、HuatuoGPT-o1、MedXpert和Humanity's Last Exam。使用每个数据集的训练集进行CoT数据生成,最终生成45K个问答对。

- 基线模型

:选择多个7-8B模型作为基线,并在MedReason上进行监督微调。具体包括LLaMA 3.1-Instruct-8B和Mistral-Instruct-7B等指令微调模型,以及Medical-CoT-8B、DeepSeek-Distill-8B和Huatuo-o1-RL-8B等专业推理模型。

- 基准测试

:在标准的医疗基准上进行评估,包括MedQA、MedMCQA、MMLU-Pro和PubMedQA。此外,还在一些具有挑战性的LLM基准上评估,如MedBullets、MedXpert和Humanity's Last Exam。

结果与分析

指令微调模型:在MedReason上进行微调的指令微调模型在多个医疗基准上表现出色。例如,Llama3.1-Instruct-8B的平均准确率从45.8%提高到51.2%(+5.4%),而Mistral-Instruct-7B的提高更为显著,从36.1%提高到44.7%(+8.6%)。

推理模型:在专业推理模型上,MedReason数据集的微调也显著提高了性能。例如,Medical-CoT-8B在MedBullets(op4)上的平均提高为5.3%,而DeepSeek-Distill-8B在MedBullets(op5)上的提高更为显著,达到7.7%。

消融研究:质量过滤显著提高了整体性能,平均得分提高了1.1%。这进一步强调了CoT数据质量在增强LLMs在医疗应用中的推理能力方面的关键作用。

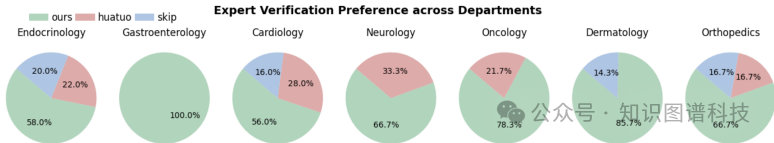

总体结论

这篇论文提出了一种可扩展的知识引导管道,用于自动生成高质量的医疗CoT数据。通过利用结构化的知识图谱来锚定推理过程,生成医学上基于事实且可解释的解释,增强了LLMs生成的推理的临床有效性。实验结果表明,该方法在指令微调和专业推理模型上均表现出色,特别是在复杂的临床场景中。专家评估进一步确认了该方法在医疗推理质量上的优越性。希望这项工作能激发未来在临床有效推理方面的探索,以推动可信医疗AI的发展。

论文评价

优点与创新

- 高质量医学推理数据集

:MedReason提供了一个大规模、高质量的医学推理数据集,旨在使大型语言模型(LLMs)在医学问题解决中更加可靠和可解释。

- 结构化医学知识图

:利用结构化的医学知识图(KG),将临床问答对转换为逻辑推理链,确保每一步推理都与临床逻辑和循证医学一致。

- 详细的推理过程

:为每个医学问题生成详细的推理步骤,提供透明且可验证的医学问题解决方法。

- 多领域专家评估

:邀请来自七个不同医学专业的医学专家评估数据集的质量,确保生成的推理数据准确且连贯。

- 实验验证

:通过在多个医学基准上的监督微调实验,证明了MedReason数据集在提升医学问题解决能力方面的有效性。

- 知识引导的数据生成

:提出了一种新的数据生成管道,通过搜索和剪枝医学知识图中的推理路径,确保生成的链式推理数据具有事实指导和临床有效性。

不足与反思

- 数据生成过程的复杂性

:论文提到,尽管采用了知识图引导的数据生成方法,但整个生成过程仍然较为复杂,可能需要进一步优化以提高效率和准确性。

- 模型的泛化能力

:虽然MedReason数据集在多个医学基准上表现出色,但论文指出,未来的研究需要进一步评估这些模型在不同数据集和实际应用场景中的泛化能力。

- 长文本推理的挑战

:医学推理往往涉及长文本,论文中提到的方法在处理长文本推理时可能存在一定的局限性,未来需要探索更有效的长文本推理方法。

关键问题及回答

问题1:MedReason数据集是如何利用知识图谱(KG)来生成高质量的医疗推理链(CoT)的?

MedReason数据集通过以下步骤利用知识图谱生成高质量的医疗推理链:

- 实体提取和映射

:首先,使用大型语言模型(LLM)从问题和答案中提取医疗实体,并将这些实体映射到医疗知识图谱中的相应节点。这个过程包括精确匹配、相似性匹配和基于LLM的选择三个阶段。

- 路径搜索和剪枝

:接下来,识别知识图谱中连接问答实体的所有推理路径,并通过LLM剪枝不相关的路径,确保每条推理路径都与当前问题相关。

- CoT生成和质量过滤

:最后,利用筛选后的推理路径作为结构化的支架,指导LLM生成医学上基于事实的CoT解释。为了确保生成数据的质量,实施了一个验证步骤,其中LLM使用生成的推理路径回答每个问题,系统性地消除未能产生正确答案的CoT样本。

问题2:MedReason数据集在实验中表现如何,特别是在哪些基准测试上取得了显著的提升?

MedReason数据集在多个基准测试上取得了显著的提升,特别是在复杂的临床场景中:

- 指令微调模型

:在MedReason上进行微调的指令微调模型在多个医疗基准上表现出色。例如,Llama3.1-Instruct-8B的平均准确率从45.8%提高到51.2%(+5.4%),而Mistral-Instruct-7B的提高更为显著,从36.1%提高到44.7%(+8.6%)。

- 推理模型

:在专业推理模型上,MedReason数据集的微调也显著提高了性能。例如,Medical-CoT-8B在MedBullets(op4)上的平均提高为5.3%,而DeepSeek-Distill-8B在MedBullets(op5)上的提高更为显著,达到7.7%。

- 消融研究

:质量过滤显著提高了整体性能,平均得分提高了1.1%,这进一步强调了CoT数据质量在增强LLMs在医疗应用中的推理能力方面的关键作用。

问题3:MedReason数据集在生成高质量的CoT数据时,如何确保推理路径的正确性和临床有效性?

- 精确匹配

:首先,算法会检查提取的实体是否与知识图谱中的节点完全匹配。

- 相似性匹配

:如果精确匹配失败,算法会计算实体与图谱节点的相似性,并选择相似度最高的节点。

- 基于LLM的选择

:在前两个阶段都没有找到合适节点的情况下,算法会提示LLM分析问题和答案的上下文,并结合实体名称来确定最相关的节点。

- 路径搜索和剪枝

:识别出所有可能的推理路径后,算法会使用LLM剪枝那些与当前问题无关的路径,确保每条路径都与问题的核心内容直接相关。

- 质量过滤

:最后,通过一个验证步骤,LLM使用生成的推理路径回答每个问题,只有那些能够产生正确答案的路径才会被保留,从而确保生成数据的逻辑正确性和临床有效性。

参考文献:

PatientSeek: 海外首个基于Deepseek R1的"KG+LLM"结合的开源医学法律推理模型 - WhyHow.AI

AIPatient:基于EHR和知识增强大模型智能体工作流的模拟患者-密歇根、斯坦福、哈佛医学院、山大、港大、医科院、北大六院等

AIPatient:基于EHR和知识增强大模型智能体工作流的模拟患者-密歇根、斯坦福、哈佛医学院、山大、港大、医科院、北大六院等

OpenKG

OpenKG(中文开放知识图谱)旨在推动以中文为核心的知识图谱数据的开放、互联及众包,并促进知识图谱算法、工具及平台的开源开放。

点击阅读原文,进入 OpenKG 网站。

308

308

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?