3 核函数与非线性支持向量机

3.1 核函数

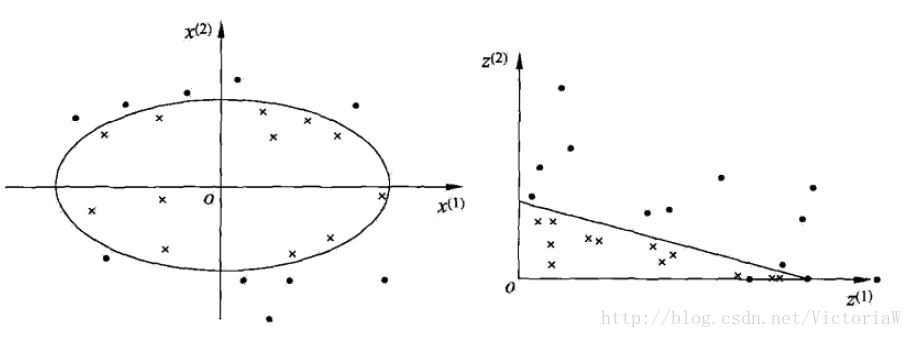

如果训练数据本身是非线性的,比如按下图分布:

那么此时原输入空间没有超平面能将训练集很好地分离开,但存在这样的超曲面。而我们仍然希望用求解线性分类问题的方法求解非线性问题。这时可以将原输入空间中的数据点通过非线性变换,映射到新特征空间去,在此特征空间中,训练集是线性可分的,这时可以使用线性分类的方法找解决分类问题。比如上图中,将左边的原始输入空间映射到右边的新特征空间中去,然后用线性分类器在新空间中解决分类问题。

核函数

设 X 是输入空间(欧式空间 Rn 的子集或者离散集合),设 H 为特征空间(希尔伯特空间),如果存在一个从 X 到 H 的映射ϕ(x):X→H使得对所有的 x,z∈X ,函数 K(x,z) 满足条件

K(x,z)=ϕ(x)⋅ϕ(z)

则称 K(x,z) 为核函数, ϕ(x)为映射函数。

但是,

本文是支持向量机系列的第三部分,主要介绍如何利用核函数实现非线性分类。核函数允许我们将数据从原始非线性空间映射到高维特征空间,使得在新空间中数据变得线性可分。文中详细讲解了核函数的概念,非线性支持向量机的优化问题以及常见的核函数类型,如多项式核和高斯核。

本文是支持向量机系列的第三部分,主要介绍如何利用核函数实现非线性分类。核函数允许我们将数据从原始非线性空间映射到高维特征空间,使得在新空间中数据变得线性可分。文中详细讲解了核函数的概念,非线性支持向量机的优化问题以及常见的核函数类型,如多项式核和高斯核。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

473

473

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?