文章目录

1.SVM cost function 代价函数

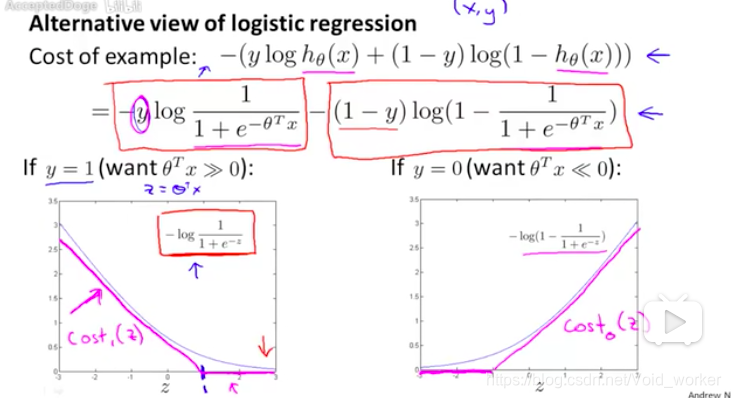

SVM cost function的引出

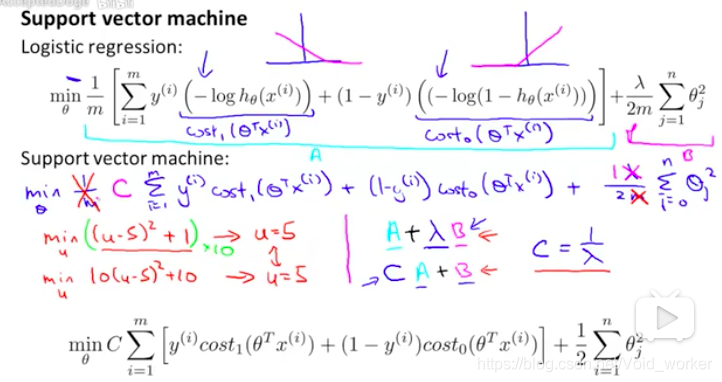

从logistic regression的代价函数开始

修改logistic regression的代价函数,粉色划线部分为SVM的cost function。

cost function代价函数 :

m i n θ C ∑ i = 1 m [ y ( i ) c o s t 1 ( θ T x ( i ) ) ) + ( 1 − y ( i ) ) c o s t 0 ( θ T x ( i ) ) ] + 1 2 ∑ θ j 2 \underset{\theta}{min}C\sum_{i=1}^m[y^{(i)}cost_1(\theta^Tx^{(i)}))+(1-y^{(i)})cost_0(\theta^Tx^{(i)})]+\frac{1}{2}\sum\theta_j^2 θminCi=1∑m[y(i)cost1(θTx(i)))+(1−y(i))cost0(θTx(i))]+21∑θ

本文深入探讨了支持向量机(SVM)的代价函数、假设函数和大间距分类思想,强调了SVM在创建具有鲁棒性的决策边界方面的优势。文章详细解释了核函数的概念,包括高斯核函数和如何通过选择合适的标记点来优化计算。此外,还讨论了SVM参数选择对模型的影响,如C和σ的选择,并提到了线性与高斯核函数的应用场景。

本文深入探讨了支持向量机(SVM)的代价函数、假设函数和大间距分类思想,强调了SVM在创建具有鲁棒性的决策边界方面的优势。文章详细解释了核函数的概念,包括高斯核函数和如何通过选择合适的标记点来优化计算。此外,还讨论了SVM参数选择对模型的影响,如C和σ的选择,并提到了线性与高斯核函数的应用场景。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

933

933

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?