4)查看是否解压成功

[ovo@hadoop102 software]$ ls /opt/module/

hadoop-3.1.3

5)将Hadoop添加到环境变量

- 1.获取Hadoop安装路径

[ovo@hadoop102 hadoop-3.1.3]$ pwd

/opt/module/hadoop-3.1.3

- 2.打开/etc/profile.d/my_env.sh文件

[ovo@hadoop102 hadoop-3.1.3]$ sudo vim /etc/profile.d/my_env.sh

在my_env.sh文件末尾添加如下内容:(shift+g)

#HADOOP_HOME

export HADOOP_HOME=/opt/module/hadoop-3.1.3

export PATH= P A T H : PATH: PATH:HADOOP_HOME/bin

export PATH= P A T H : PATH: PATH:HADOOP_HOME/sbin

保存并退出: :wq

- 3.让修改后的文件生效

[ovo@hadoop102 hadoop-3.1.3]$ source /etc/profile

6)测试是否安装成功

[ovo@hadoop102 hadoop-3.1.3]$ hadoop version

Hadoop 3.1.3

7)重启(如果Hadoop命令不能用再重启虚拟机)

[ovo@hadoop102 hadoop-3.1.3]$ sudo reboot

1)查看Hadoop目录结构

[ovo@hadoop102 hadoop-3.1.3]$ ll

2)重要目录

-

bin目录:存放对Hadoop相关服务(hdfs,yarn,mapred)进行操作的脚本

-

etc目录:Hadoop的配置文件目录,存放Hadoop的配置文件

-

lib目录:存放Hadoop的本地库(对数据进行压缩解压缩功能)

-

sbin目录:存放启动或停止Hadoop相关服务的脚本

-

share目录:存放Hadoop的依赖jar包、文档、和官方案例

==============================================================================

1)Hadoop官方网站:http://hadoop.apache.org

2)Hadoop运行模式包括:本地模式、伪分布式模式以及完全分布式模式。

-

本地模式:单机运行,只是用来演示一下官方案例。生产环境不用。

-

伪分布式模式:也是单机运行,但是具备Hadoop集群的所有功能,一台服务器模拟一个分布式的环境。个别缺钱的公司用来测试,生产环境不用。

-

完全分布式模式:多台服务器组成分布式环境。生产环境使用。

分析:

-

1.准备3台虚拟机(

关闭防火墙、静态IP、主机名称) -

2.安装JDK

-

3.配置环境变量

-

4.安装Hadoop

-

5.配置环境变量

-

6.配置集群

-

7.单点启动

-

8.配置ssh

-

9.群起并测试集群

2.2.1 虚拟机准备

详见1.1、1.2两节。

2.2.2 编写集群分发脚本xsync

1)scp(secure copy)安全拷贝

scp定义:scp可以实现服务器与服务器之间的数据拷贝。(from server1 to server2)

- 1.基本语法(

重要!!!)

| scp | -r | $pdir/$fname | $user@$host:$pdir/$fname |

| — | — | — | — |

| 命令 | 递归 | 要拷贝的文件路径/名称 | 目的地用户@主机:目的地路径/名称 |

- 2.案例实操

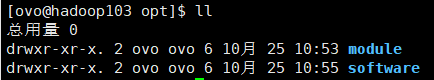

前提:在hadoop102、hadoop103、hadoop104都已经创建好的/opt/module、 /opt/software两个目录,并且已经把这两个目录修改为ovo:ovo

[ovo@hadoop102 ~]$ sudo chown ovo:ovo -R /opt/module

效果如图:

(a)在hadoop102上,将hadoop102中/opt/module/jdk1.8.0_212目录拷贝到hadoop103上。

[ovo@hadoop102 ~]$ scp -r /opt/module/jdk1.8.0_212 ovo@hadoop103:/opt/module

(b)在hadoop103上,将hadoop102中/opt/module/hadoop-3.1.3目录拷贝到hadoop103上。

[

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

897

897

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?