哈工大pyltp的安装教程

哈工大语言技术平台(Language Technology Platform, LTP)是哈尔滨工业大学社会计算与信息检索研究中心开发的一整套中文语言处理系统。LTP还提供了包括中文分词、词性标注、命名实体识别、依存句法分析、语义角色标注等NLP技术。

哈工大语言技术平台:http://ltp.ai/index.html

安装环境

- Windows10 64位

- python 3.6

- pycharm

步骤

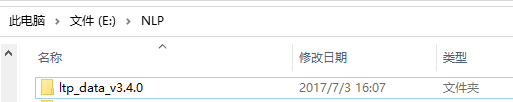

1、模型下载:下载最新版的模型ltp_data_v3.4.0

下载地址:http://ltp.ai/download.html

2、下载LTP:pyltp-0.2.1-cp36-cp36m-win_amd64.whl

下载地址:wheels里面的第二种方案

备注:需要和自己电脑python版本对于,我的是python3.6

3、将第一步中下载的ltp_data_v3.4.0压缩包解压

4、将第二步中下载的pyltp-0.2.1-cp36-cp36m-win_amd64.whl拷贝到自己python安装目录下的Scripts文件夹中(我的是D:\Python\Python36\Scripts)

5、win+R,输入cmd

进入自己python安装目录下的Scripts文件夹中(我的是D:\Python\Python36\Scripts)

然后执行命令行:

pip.exe install pyltp-0.2.1-cp36-cp36m-win_amd64.whl

6、出现Successfully installed pyltp-0.2.1说明安装成功

7、检验是否成功:进入自己python安装目录下的Scripts文件夹中(我的是D:\Python\Python36\Scripts)

然后执行命令行:

pip.exe list

出现如图所示情况表示安装成功

代码实践

1、打开pycharm,创建新的python项目

检查Settings里面的python是否为3.6,可用的包中是否有pyltp

如果不是,设置一下:

2、设置好后,运行如下代码:

#itp-cws 分词方法

from pyltp import Segmentor

def segmenter(sentence):

segmenter = Segmentor()

#加载模型

segmenter.load(r'E:/NLP/ltp_data_v3.4.0/cws.model')

words = segmenter.segment(sentence)

words_list = list(words)

segmenter.release()

return words_list

if __name__ == "__main__":

sentence = r"我今天终于安装成功啦"

words = segmenter(sentence)

print(words)

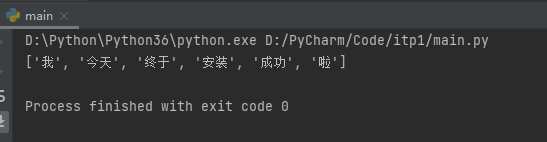

2、运行结果

参考:

自然语言处理(NLP)——哈工大pyltp的安装与使用教程

哈工大自然语言处理ltp在windows10下的安装使用

1303

1303

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?