点击上方“3D视觉工坊”,选择“星标”

干货第一时间送达

作者丨泡泡图灵智库

来源丨 泡泡机器人SLAM

标题:Point-NeRF: Point-based Neural Radiance Fields

作者:Qiangeng Xu, Zexiang Xu, Julien Philip, Sai Bi, Zhixin Shu, Kalyan Sunkavalli, Ulrich Neumann

来源:CVPR2022

编译:张海晗

审核:zhh

大家好,今天要介绍的文章是CVPR2022的Point-NeRF: Point-based Neural Radiance Fields

摘要:

NeRF系的体积神经渲染方法会生成高质量的视图合成结果,但会针对每个场景进行优化,从而导致重建时间过长。另一方面,深度多视图立体方法(MVS)可以通过直接网络推理快速重建场景几何。 Point-NeRF 通过使用具有相关神经特征的神经3D 点云来模拟辐射场,从而结合了这两种方法的优点。 Point-NeRF 可以通过在基于光线行进的渲染管道中聚合场景表面附近的神经点特征来有效地渲染。此外,Point-NeRF 可以通过直接推断预训练的深度网络来初始化,以生成神经点云;这个点云可以被微调以超过 NeRF 的视觉质量,训练时间快 30 倍。 Point-NeRF 可以与其他 3D 重建方法相结合,并通过一种新颖的剪枝和生长机制来处理此类方法中的错误和异常值。在 DTU、NeRF Synthetics 、ScanNet和 Tanks and Temples 数据集上的实验表明,Point-NeRF 可以超越现有方法并达到最先进的结果。

主要贡献:

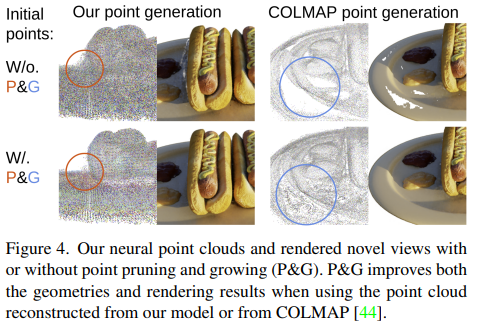

将MVS方法和NeRF相结合,对点云的生成进行了加速。

引入点云的裁剪和生成算法对重建和渲染速度进行加速,同时也提高了生成点云的质量。

主要方法:

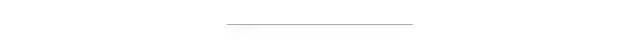

Point-NeRF的表示方式

NeRF中利用神经辐射场的体积表示呈现了三维模型,这里对基于体积的辐射场进行了改造。对于一个点云P将其表示为P={(pi,fi,yi)∣i=1,...,N},将每个点云中的点与含有局部场景信息的神经特征向量fi关联,并用一个0到1之间的置信度y来描述这个点接近真实场景表面的程度。将其抽象到神经辐射场表示为:

![]()

在训练的过程中,使用MLP F对每个相邻的神经点处理,来预测着色位置X的特征向量:

![]()

本质上,原始特征 fi 对 pi 周围的局部 3D 场景内容进行编码。该 MLP 网络表示一个局部 3D 函数,该函数在 x 处输出特定的神经场景描述 fi,x,由其局部帧中的神经点建模。相对位置 x - p 的使用使网络对点平移保持不变,以实现更好的泛化。

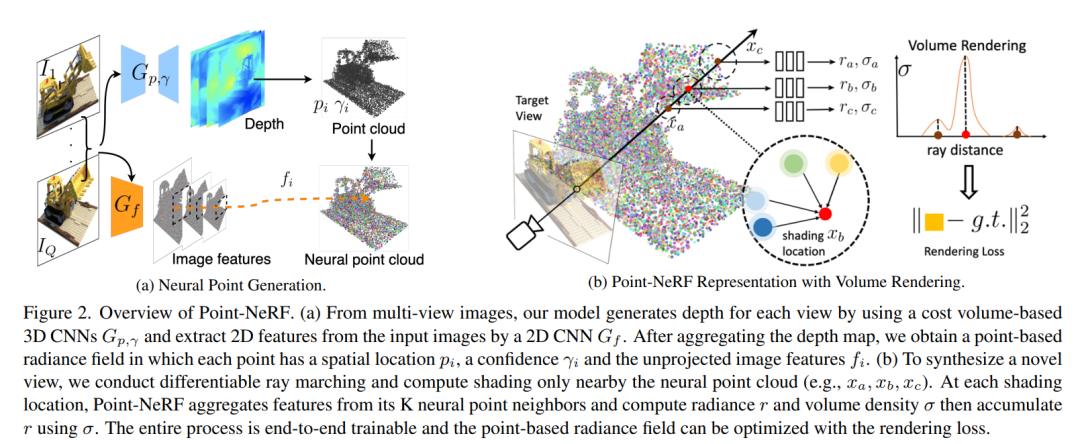

接下来使用inverse distance weighting来聚合特征fi,x:

![]()

然后用一个MLP, R从聚合特征回归给定视图方向d

![]()

密度回归是利用MLP,T,并使用了反距离权重:

Point-NeRF的重建

生成基于点的初始辐射场:给定一组已知图像I1,...,IQ 和点云,我们的 Point-NeRF 表示可以通过优化随机初始化的每点神经特征和带有渲染的 MLP 来重建损失(类似于 NeRF)。然而,这种纯粹的逐场景优化依赖于现有的点云,并且速度可能非常慢。因此,我们提出了一个神经生成模块,通过前馈神经网络预测所有神经点属性,包括点位置 pi 、神经特征 fi 和点置信度γi ,以实现高效重建。网络的直接推断输出了良好的基于初始点的辐射场。然后可以微调初始字段以实现高质量渲染。在很短的时间内,渲染质量更好或与NeRF 相当,后者需要更长的时间来优化。

获得点云后对MVSNet中的深度置信体进行了tri-Linearly 采样:

![]()

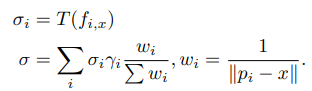

最后提取了2D CNN特征Gf,并构建了一个端到端的重建网络。

![]()

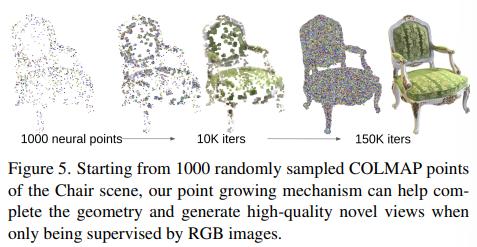

优化基于点的辐射场:这里使用可微分的ray marching来优化点特征fi和置信度 γi来提升辐射场。首先基于置信度对点进行裁剪来去除一些不必要的离群点。

![]()

裁剪后,本文还利用NeRF中的光纤着色位置xj来识别新的候选点,以此来完成点的生成。

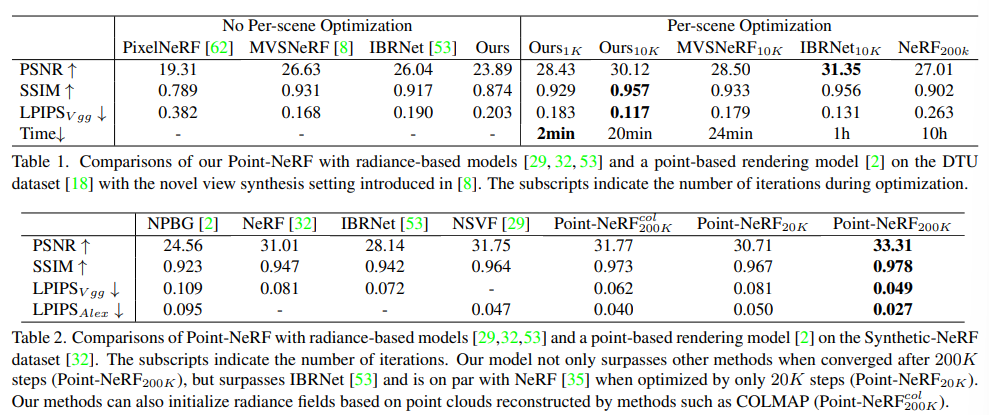

主要结果:

如果你对本文感兴趣,请点击点击阅读原文下载完整文章。

本文仅做学术分享,如有侵权,请联系删文。

3D视觉工坊精品课程官网:3dcver.com

2.面向自动驾驶领域的3D点云目标检测全栈学习路线!(单模态+多模态/数据+代码)

3.彻底搞透视觉三维重建:原理剖析、代码讲解、及优化改进

4.国内首个面向工业级实战的点云处理课程

5.激光-视觉-IMU-GPS融合SLAM算法梳理和代码讲解

6.彻底搞懂视觉-惯性SLAM:基于VINS-Fusion正式开课啦

7.彻底搞懂基于LOAM框架的3D激光SLAM: 源码剖析到算法优化

8.彻底剖析室内、室外激光SLAM关键算法原理、代码和实战(cartographer+LOAM +LIO-SAM)

重磅!3DCVer-学术论文写作投稿 交流群已成立

扫码添加小助手微信,可申请加入3D视觉工坊-学术论文写作与投稿 微信交流群,旨在交流顶会、顶刊、SCI、EI等写作与投稿事宜。

同时也可申请加入我们的细分方向交流群,目前主要有3D视觉、CV&深度学习、SLAM、三维重建、点云后处理、自动驾驶、多传感器融合、CV入门、三维测量、VR/AR、3D人脸识别、医疗影像、缺陷检测、行人重识别、目标跟踪、视觉产品落地、视觉竞赛、车牌识别、硬件选型、学术交流、求职交流、ORB-SLAM系列源码交流、深度估计等微信群。

一定要备注:研究方向+学校/公司+昵称,例如:”3D视觉 + 上海交大 + 静静“。请按照格式备注,可快速被通过且邀请进群。原创投稿也请联系。

▲长按加微信群或投稿

▲长按关注公众号

3D视觉从入门到精通知识星球:针对3D视觉领域的视频课程(三维重建系列、三维点云系列、结构光系列、手眼标定、相机标定、激光/视觉SLAM、自动驾驶等)、知识点汇总、入门进阶学习路线、最新paper分享、疑问解答五个方面进行深耕,更有各类大厂的算法工程人员进行技术指导。与此同时,星球将联合知名企业发布3D视觉相关算法开发岗位以及项目对接信息,打造成集技术与就业为一体的铁杆粉丝聚集区,近4000星球成员为创造更好的AI世界共同进步,知识星球入口:

学习3D视觉核心技术,扫描查看介绍,3天内无条件退款

圈里有高质量教程资料、答疑解惑、助你高效解决问题

觉得有用,麻烦给个赞和在看~

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?