大数据分析的前置数据处理部分。

参考了网上的一些爬虫进行了修改,主要是增加了批量下载的功能,通过读取excel来实现批量。

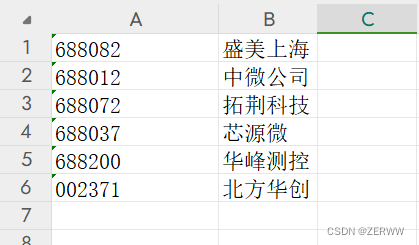

需要在目录文件夹中的excel表中存放需要查询的公司代码及名称,如下图格式。

具体的实现代码:

# 导入pandas工具库

import pandas as pd

#实现系统功能

import os

#读取excel

import xlrd

#写入excel

import xlwt

#解析json

import json

#获取网页内容

import requests

#数学函数

import math

#正则表达

import re

#下载网络文件到本地

from urllib.request import urlretrieve

# 从以下url中提取所需要的上市企业数据源信息

url = "http://www.cninfo.com.cn/new/data/szse_stock.json"

ret = requests.get(url = url)

ret = ret.content

stock_list = json.loads(ret)["stockList"]

len(stock_list)

# 检查数据格式案例

stock_list[:2]

//这一段是参考代码中的,在此处应该没用,懒得删,怕出bug

def export_excel(export):

#将字典列表转换为DataFrame

pf = pd.DataFrame(export)

#指定字段顺序

order = ['orgId','category','code','pinyin','zwjc']

pf = pf[order]

#将列名替换为中文

columns_map = {

'orgId':'orgId(原始ID)',

'category':'category(股市类型)',

'code':'code(代码)',

'pinyin':'pinyin(拼音)',

'zwjc':'zwjc()'

}

pf.rename(columns = columns_map,inplace

本文介绍了如何利用Python爬虫技术,通过读取Excel文件中的公司代码和名称,批量下载CNINFO网站的上市企业数据,并将数据整理成CSV格式。作者详细展示了如何使用requests、pandas和xlrd/xlwt库进行数据抓取、处理和导出的过程。

本文介绍了如何利用Python爬虫技术,通过读取Excel文件中的公司代码和名称,批量下载CNINFO网站的上市企业数据,并将数据整理成CSV格式。作者详细展示了如何使用requests、pandas和xlrd/xlwt库进行数据抓取、处理和导出的过程。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2177

2177

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?