一、下载地址及前提

1、官方下载:Apache Spark

2、网盘下载(也是官网下载的):

链接:https://pan.baidu.com/s/1hWZoJtvWcUlgxwmVt7w0vA

提取码:di3h

前提:安装spark必须确保Hadoop和Java JDK已经安装配置好了。

二、安装Spark

1、解压到/usr/local目录;

sudo tar -zxf ~/下载/spark-3.0.0-preview2-bin-hadoop2.7.tgz -C /usr/local/

2、重命名;

sudo mv ./spark-3.0.0-preview2-bin-hadoop2.7/ ./spark3.0

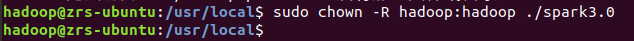

3、授权;

sudo chown -R hadoop:hadoop ./spark3.0

这里的Hadoop是用户名,就是你开机登录密码时使用的用户名。

三、修改Spark的配置文件spark-env.sh

1、复制文件;

cd /usr/local/spark3.0

cp ./conf/spark-env.sh.template ./conf/spark-env.sh

2、编辑文件;

vim ./conf/spark-env.sh

插入配置信息,如下:

export SPARK_DIST_CLASSPATH=$(/usr/local/hadoop/bin/hadoop classpath)

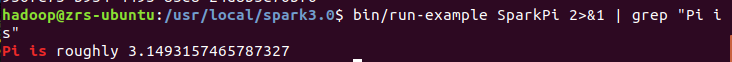

3、验证安装是否成功;

配置完成后,可以通过运行Spark自带的示例,验证Spark是否安装成功。

cd /usr/local/spark

bin/run-example SparkPi

执行时会输出非常多的运行信息,输出结果不容易找到,可以通过 grep 命令进行过滤。

命令中的 2>&1 可以将所有的信息都输出到 stdout 中,否则由于输出日志的性质,还是会输出到屏幕中。

bin/run-example SparkPi 2>&1 | grep "Pi is"

执行命令结果如下:

四、使用 Spark Shell 编写代码

1、启动Spark Shell;

cd /usr/local/spark3.0

bin/spark-shell

启动spark-shell后,会自动创建名为sc的spark context对象和名为sqlContext的sql context对象,如上图所示。

2、加载text文件;

spark创建sc,可以加载本地文件和HDFS文件创建RDD。这里用Spark自带的本地文件README.md文件测试。

val textFile = sc.textFile("file:///usr/local/spark/README.md")

加载HDFS文件和本地文件都是使用textFile,区别是添加前缀(hdfs://和file://)进行标识。

3、退出Spark Shell

:quit

到这里,Spark的安装和配置以及简单测试基本完成了!

声明:素材来源于厦门大学大数据实验室,文章由个人实操!

3935

3935

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?