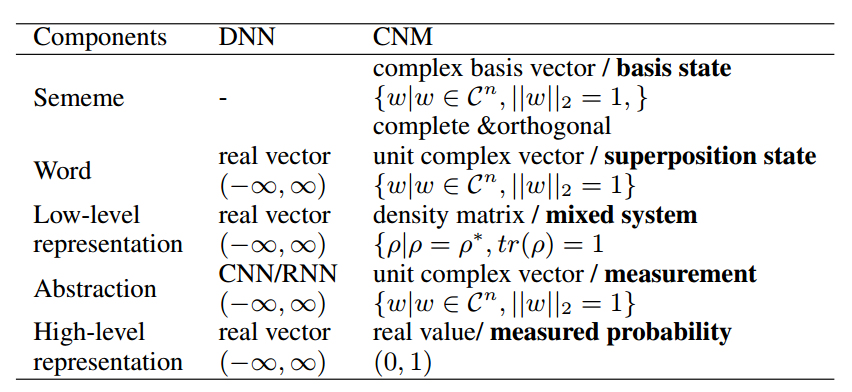

本文提出了以量子概率来驱动神经网络模型,从而进行语义的表示。具体的,以量子里的基本状态来表示NLP里的基本单元,并逐层向上构建出词及句子等元素的表示。

论文地址:

https://arxiv.org/abs/1904.05298

引言

神经网络虽然取得了巨大的成就,但其可解释一直较差。本文根据Lipton的说法,主要解释为事后解释性或透明度,事后解释性通常在模型训练完成之后再进行解释,而透明性主要是从模型设计之初加入的一些可解释的机制。本文根据量子力学来构建满足这两种解释性的模型。主要研究内容如下:

RQ1:基于量子力学能否构建人类语言?

RQ2:能否从NLP里语言的复值表示受益?

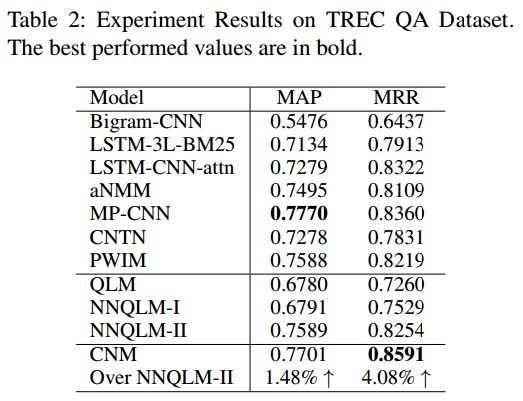

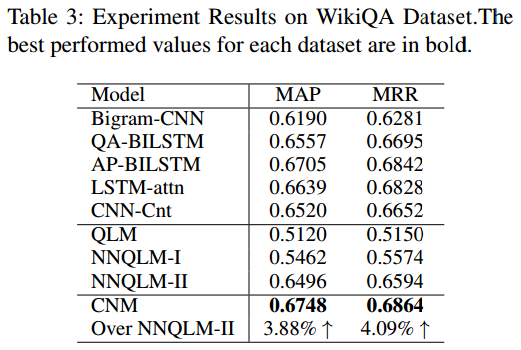

数据集

本文基于 TREC QA 和 WikiQA来进行模型效果的验证

模型

量子概率

将事件作为具有射影几何的向量空间中的子空间

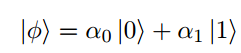

量子叠加态

量子力学里的叠加态描述了一个粒子的不确定性,如二维空间中的波,其可以描述为x方向和y方向基本运动的叠加。词也像粒子一样,可以用基本语义单元的复值权重线性叠加来得到。

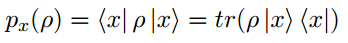

度量

希尔伯特空间

希尔伯特空间中,自然语言与量子力学中状态的类比如下:

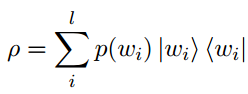

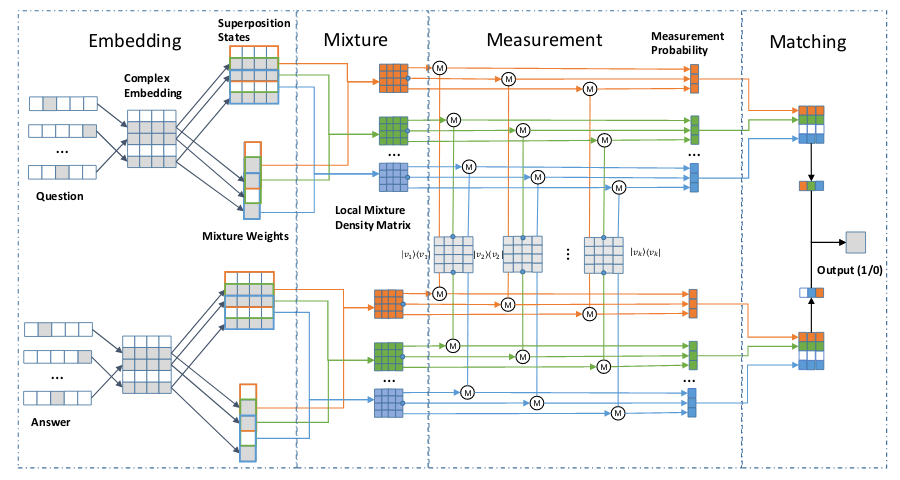

每个单词都被描述成一个复值向量,其长度表示n-gram窗口内词的权重,方向表示量子的叠加态。

用滑动窗口来对文本的n-gram构建混合系统,其概率可以由一个密度矩阵来描述。文本被描述为其n-gram向一个投影平面的投影,投影的长度的平方对应混合系统投影到该平面的概率。

根据投影长度来判断两个文本对象是否匹配。如果两个文本匹配,则希望找到一些投影方向让两个密度矩阵投影后的长度相近,反之希望投影长度相差更大。

因为投影平面是由一个向量张成的子空间,该投影向量跟词语同时嵌入在同一个希尔伯特空间,所以可以通过最靠近该投影向量的词向量来理解投影向量可能蕴含的含义。

CNM网络结构

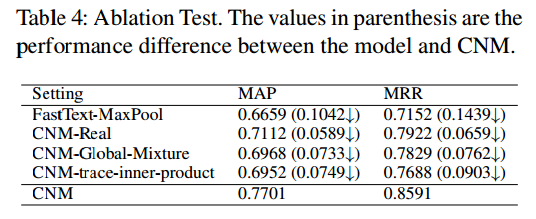

实验结果

结论

实验结果取得与一些经典模型可比较的结果。由于评测的数据集相对比较小,在结果上提供的贡献比较有限。相比较 CNN 和 RNN,本文模型相对较浅且参数有限,贡献更多是体现提供一个新的视角来看待神经网络。

扫码识别关注,获取更多论文解读

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?