win10系统的“C:\Windows\System32\CompatTelRunner.exe”占用过高的CPU,而且经常莫名其妙的启动,该问题其实是“客户体验改善计划”导致的,系统会定期启动计划任务,运行CompatTelRunner.exe,可以通过下面的方法进行修复。

步骤如下:

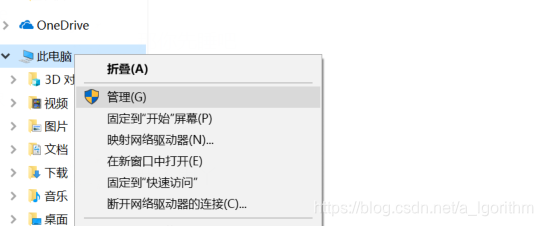

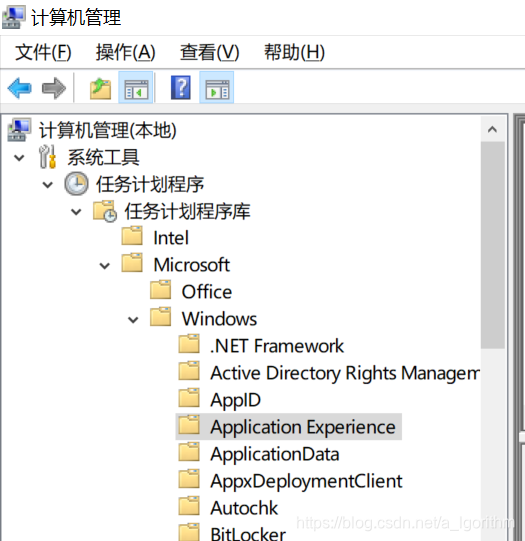

1、在此电脑右键选择管理-计算机管理-系统工具-任务计划程序-Microsoft-Windows-Application Experience,如图所示:

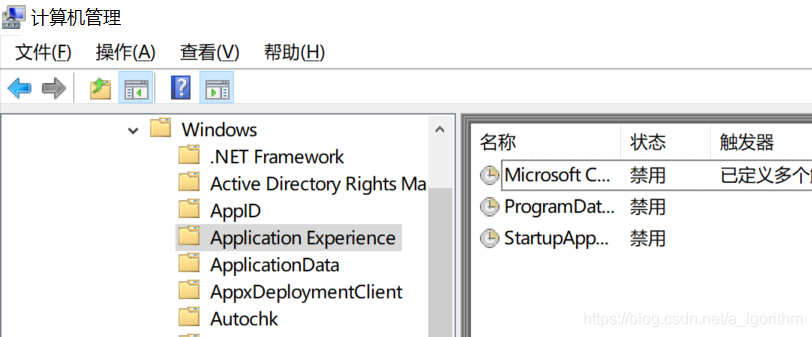

2、可以看到右侧有三个计划任务,都是微软的客户体验改差计划。全部选择禁止或者删除,这样下次电脑再启动之后就不会有这三个计划了。

操作完成后重启计算机,若还会出现CompatTelRunner或task scheduler占用CPU过高的情况,那么可以重新打开任务计划程序库\Microsoft\Windows\customer experience improvement program,将右侧的3个选项删除即可!

另外补充一点,在“C:\Windows\System32\Tasks\Microsoft\Windows\Application Experience”可以看到上述右侧三个计划任务的文件,如果仍然出现CompatTelRunner或task scheduler占有CPU过高的情况,可直接把该文件夹删除。

本文介绍如何解决Win10系统中C:WindowsSystem32CompatTelRunner.exe进程占用CPU过高的问题,通过禁用或删除特定计划任务,有效降低CPU使用率。

本文介绍如何解决Win10系统中C:WindowsSystem32CompatTelRunner.exe进程占用CPU过高的问题,通过禁用或删除特定计划任务,有效降低CPU使用率。

2975

2975

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?