目录

1)从2D图像提取左右眼的视角,生成空间照片——利用机器学习

大会视频地址:苹果 WWDC 2024 完整视频中英文字幕_哔哩哔哩_bilibili

ARKit视频地址:【中文教程2】使用ARkit创造增强的空间计算体验_哔哩哔哩_bilibili

开发者视频地址:

WWDC24大会AR/VR开发汇总:visionOS讲座视频及开发指南 - 映维网资讯WWDC24 - 视频 - Apple Developer

1 visionOS 2

visionOS 2介绍位置:定位到0小时7分45秒——0小时16分21秒。

1)从2D图像提取左右眼的视角,生成空间照片——利用机器学习

2)提供丰富的API和框架

2 Apple Intelligence

Apple Intelligence介绍位置:定位到1小时7分10秒。

1)自动对通知优先级排序、缩略通知、专注模式

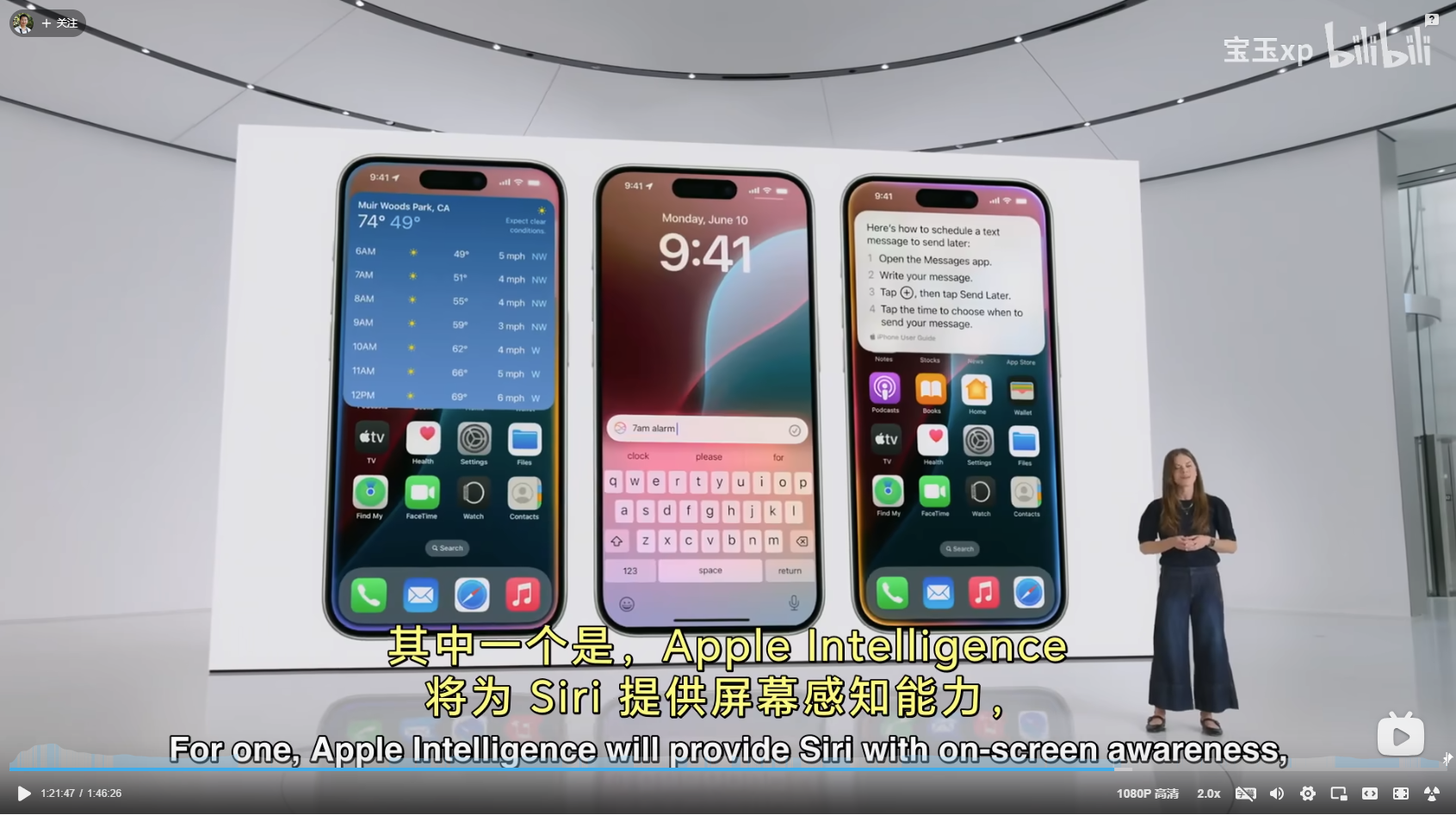

2)Siri可以根据屏幕内容执行相关操作

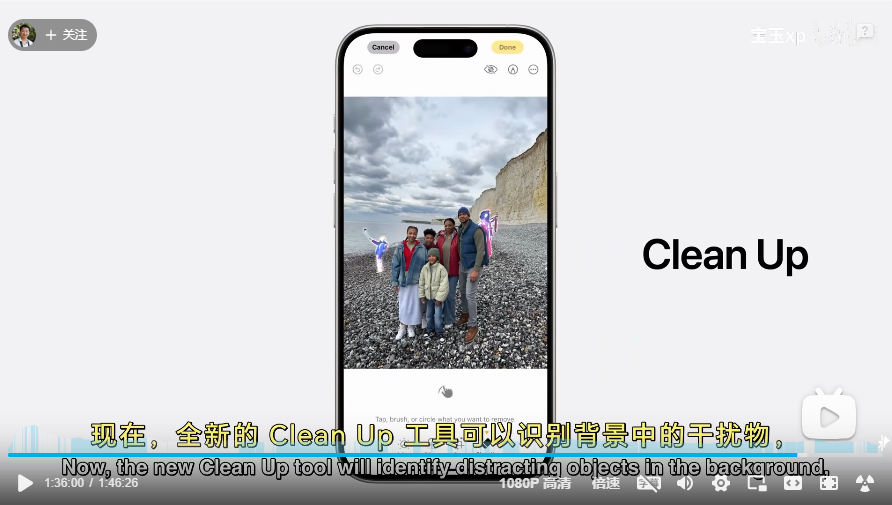

3)自动P图去掉背景干扰物

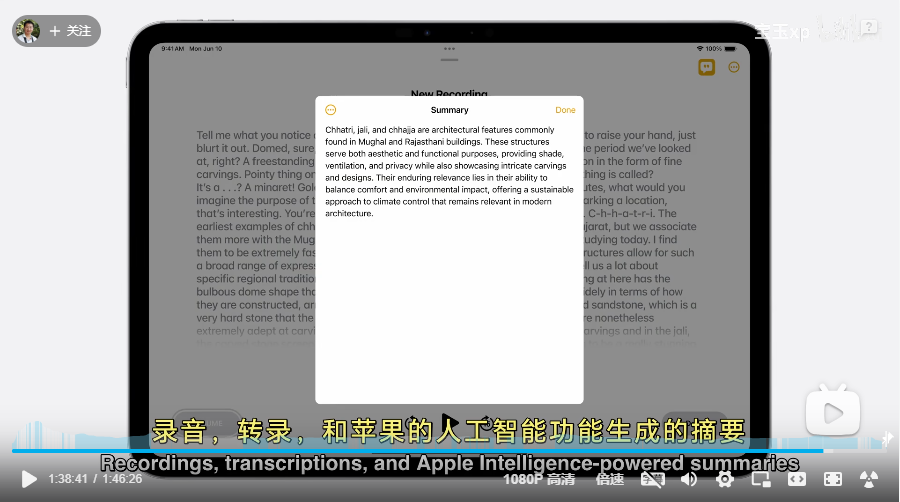

4)录音、转文字、生成摘要

3 ARKit

1)Room tracking:房间追踪

场景理解,房间定制体验。

-

在房间放置更加逼真的虚拟内容来增强设置;

-

为每个空间量身定制独特的体验;

2)Plane detection:平面检测

场景理解,房间定制体验,在检测到的平面周围放置虚拟内容。

3)Object tracking:物体追踪

追踪静态放置在环境中的真实世界物体,为真实世界的物体创建可视化交互效果。

4)World tracking:现实场景追踪

视频定位到9点36分。一个人所在物理位置的光照不足时,影响传感器数据和算法的准确性,导致现实场景追踪质量不佳,怎么处理?

a、仅追踪其方向的变化,不追踪其在位置空间中的位置;

b、通知追踪中的变化,应用可以根据变化重新排列放置的内容;

c、要求用户转向更明亮的环境以恢复体验;

5)Hand tracking:手部追踪

追踪人的手和手指,将虚拟内容锚定到手中。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?