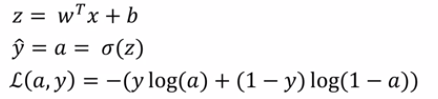

1.回顾logistic回归,下式中a是逻辑回归的输出,y是样本的真值标签值

、

、

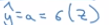

(1)现在写出该样本的偏导数流程图。假设这个样本只有两个特征x1和x2, 为了计算z,我们需要输入参数w1、w2和b还有样本的特征值x1和x2,用这个来计算偏导数的计算公式 ,然后我们可以计算y^就是a,即

,然后我们可以计算y^就是a,即 ,最后计算L(a,y),在逻辑回归中,我们要做的就是变换参数w和b的值,来最小化损失函数l(a,y)。现在看看怎样向后传播计算偏导数:

,最后计算L(a,y),在逻辑回归中,我们要做的就是变换参数w和b的值,来最小化损失函数l(a,y)。现在看看怎样向后传播计算偏导数:

要计算损失函数L的导数,首先要向前一步,计算损失函数的导数:

接下来再向后一步计算dz,dz是损失函数l关于z的导数,对于dl下面的两种形式都可以:

向后传播的最后一步:

1027

1027

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?