嗨嗨,我是小圆。

相信大家都会看小说,但是有些小说看几章就要付费,奈何自己又没有会员,只能用用python爬取一下了。

基本开发环境

Python 3.6

Pycharm

相关模块的使用

requests

parsel

安装Python并添加到环境变量,pip安装需要的相关模块即可。

单章爬取

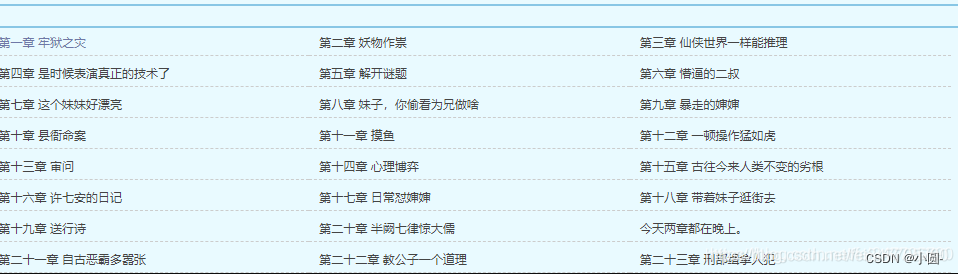

一、明确需求

爬取小说内容保存到本地

- 小说名字

- 小说章节名字

- 小说内容

# 第一章小说url地址

url = 'http://www.平台原因自己打.com/52_52642/25585323.html'

url = 'http://www.平台原因自己打.com/52_52642/25585323.html'

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/81.0.4044.138 Safari/537.36'

}

response = requests.get(url=url, headers=headers)

print(response.text)

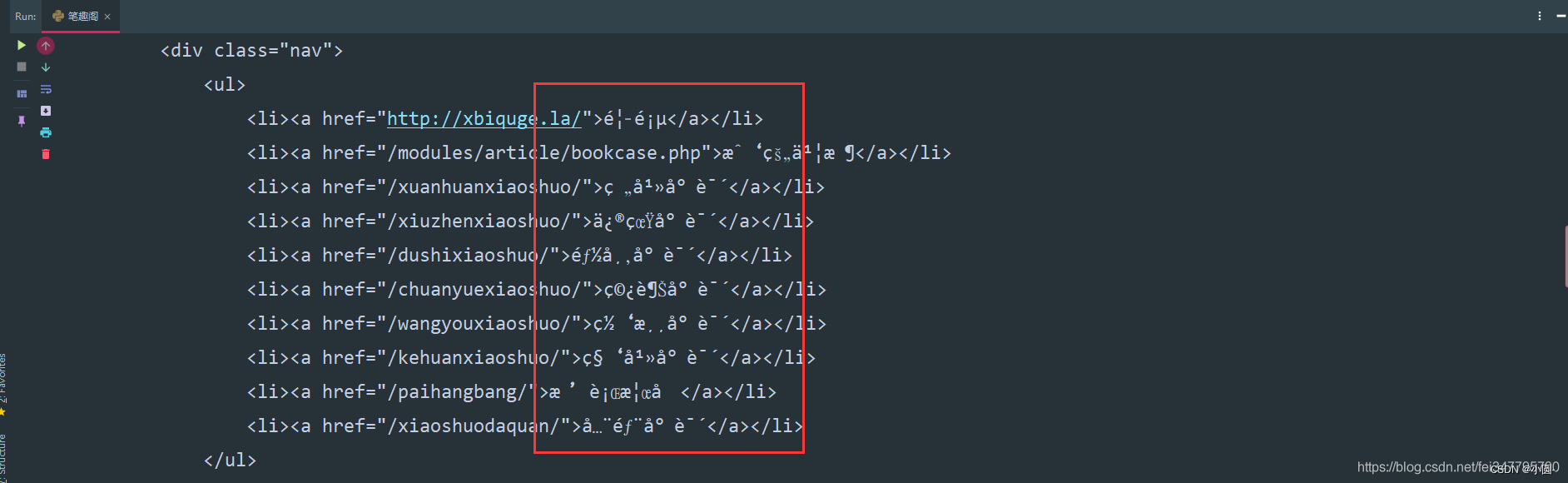

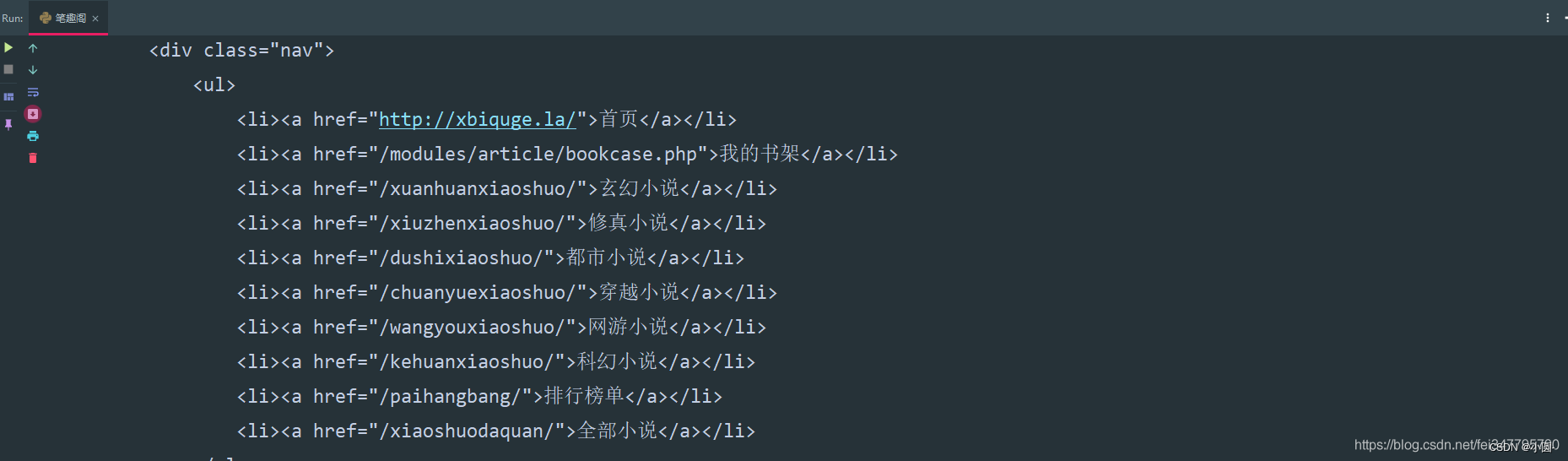

请求网页返回的数据中出现了乱码,这就需要我们转码了。

加一行代码自动转码。

response.encoding = response.apparent_encoding

解析数据

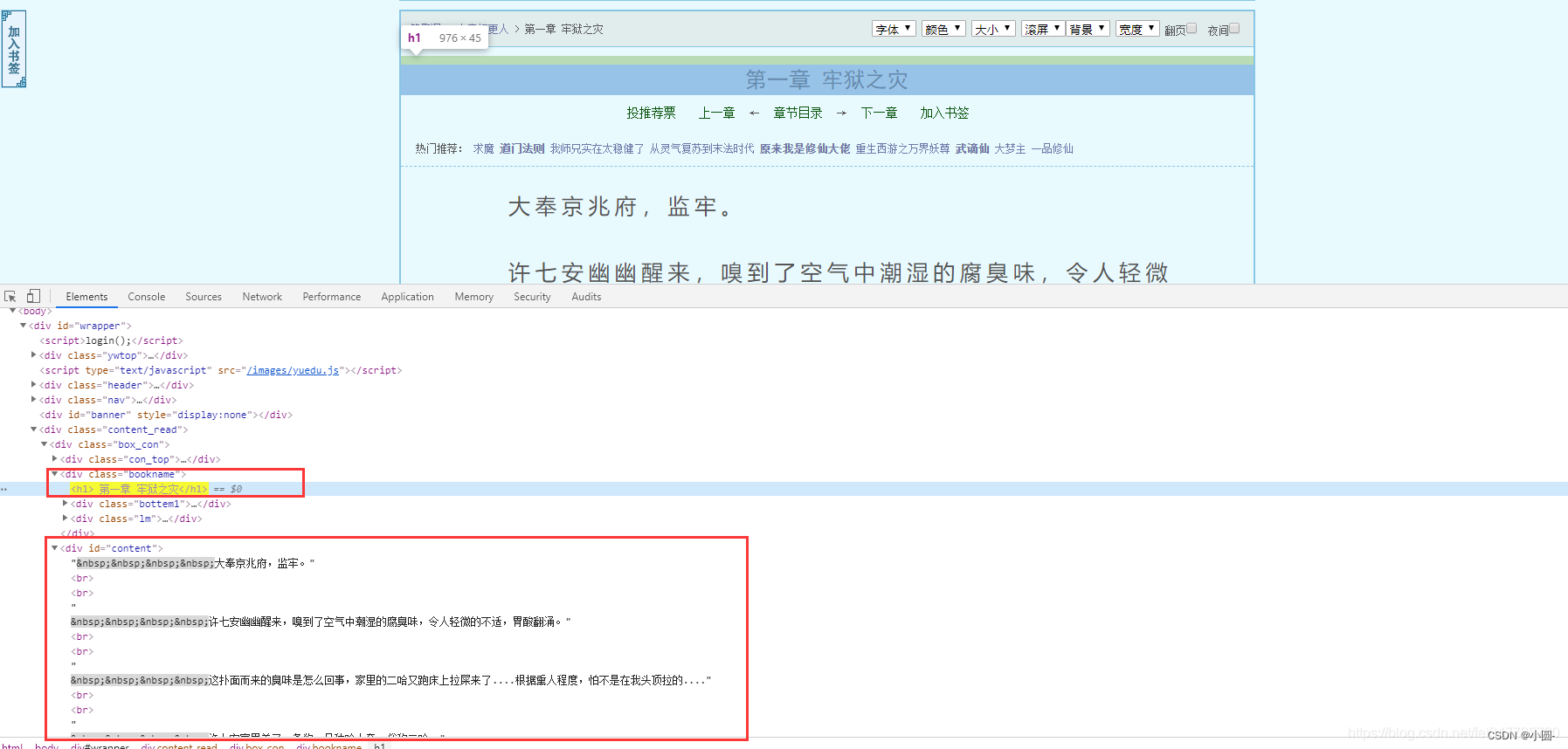

根据css选择器可以直接提取小说标题以及小说内容。

def get_one_novel(html_url):

# 调用请求网页数据函数

response = get_response(html_url)

# 转行成selector解析对象

selector = parsel.Selector(response.text)

# 获取小说标题

title = selector.css('.bookname h1::text').get()

# 获取小说内容 返回的是list

content_list

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

900

900

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?