1.scrapy startproject projectname 创建名称为projectname的scrapy项目

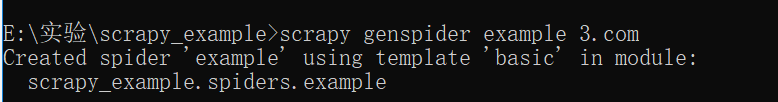

2.scrapy genspider example 3.com 创建名称为example的spider ,allowed_domains为 3.com

3.初始化的介绍,目录结构为:

spider文件初始为:

此处可以定向的修改,具体的项目修改为具体的allowed_domains,start_urls修改为具体的首次请求的页面(默认为get请求)。

4.如果首次请求页面为post请求,则需要修改start_requests内置函数,首先需要引入scrapy中post请求的传递函数-FormRequest(一般我习惯一并引入Request,这样后续使用get请求时就不用写成scrapy.Request,直接写成Request)

这样一个基本的spider空壳已经构建成功,可以插入具体的操作了。

5.scrapy bench

我的理解是测试一下你的爬虫的速度也就相当于是测试网速吧,会每秒输出一个打印结果。但是因为具体的爬虫中有各种操作,越复杂的话就会越慢,而且我们也经常会自己控制爬虫的速度。图上显示我每秒可以发送3000次以上的请求,但是我从来没有这种体验。(根据经验一般情况下(网速正常、爬虫不是太复杂),使用scrapy中默认的设置,一个小时大概可以发送3-5w次请求)

6.爬虫结束之后的操作

一般情况下,我们得到数据之后就会将数据yield到pepline中,前两天帮朋友弄一个东西,需求是:在爬虫获取到所有的item之后,将所有的item都加入到一个列表中,这个时候我想起了,pepline中的默认的函数:close_spider(self, spider), 此函数在爬虫将所有的item传入管道之后,在整个项目结束掉之前会执行,所有这个需求就可以在这里面执行。

7.如果想要写入文件:

(1)打开文件以追加的方式写入, with open() as f 方法,在每一个item传回时调用这个方法,这个方法可以让item不仅如此管道直接到spider中进行数据的处理,图片的保存我就用此类方法

(2)在item传入pepline中时:爬虫开启时pepline默认的调用函数为 open_spider(self,spider) 可以在此函数中打开一个文件,然后在 爬虫结束时调用 close_spdier函数 对文件关闭。

4008

4008

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?