1.概述

在Hive 的世界里有一下几种表

| 类型 | 说明 |

|---|---|

| Table | 内部表 |

| Partition | 分区表 |

| External Table | 外部表 |

| Bucket Table | 桶表 |

2.Table(内部表)

- 与数据库中的 Table 在概念上是类似

- 每一个 Table 在 Hive 中都有一个相应的目录存储数据。

- 例如,一个表test,它在HDFS中的路径为:/hive/warehouse/test.

- warehouse是在 hive-site.xml 中由 ${hive.metastore.warehouse.dir} 指定的数据仓库的目录

- 所有的 Table 数据(不包括 External Table)都保存在这个目录中。

- 删除表时,元数据与数据都会被删除

- 创建一个内部表的相关操作:

- 创建数据文件inner_table.dat,内容如下:

1

2

3 - 创建表

hive>create table inner_table (key string); - 加载数据

hive>load data local inpath ‘/root/inner_table.dat’ into table inner_table; - 查看数据

select * from inner_table

select count(*) from inner_table - 删除表 drop table inner_table

- 创建数据文件inner_table.dat,内容如下:

3.Partition(分区表)

- Partition 对应于数据库的 Partition 列的密集索引

在 Hive 中,表中的一个 Partition 对应于表下的一个目录,所有的 Partition 的数据都存储在对应的目录中

- 例如:test表中包含 date 和 city 两个 Partition

则对应于date=20130201, city = bj 的 HDFS 子目录为:

/warehouse/test/date=20130201/city=bj

对应于date=20130202, city=sh 的HDFS 子目录为;

/warehouse/test/date=20130202/city=sh

- 例如:test表中包含 date 和 city 两个 Partition

创建一个分区表的相关操作

- 创建表

create table partition_table(rectime string,msisdn string) partitioned by(daytime string,city string) row format delimited fields terminated by ‘\t’ stored as TEXTFILE; - 加载数据到分区

load data local inpath ‘/home/partition_table.dat’ into table partition_table partition (daytime=’2013-02-01’,city=’bj’); - 查看数据

select * from partition_table

select count(*) from partition_table - 删除表

drop table partition_table - 添加一个分区

通过load data 加载数据

alter table partition_table add partition (daytime=’2013-02-04’,city=’bj’); - 删除一个分区

元数据,数据文件删除,但目录daytime=2013-02-04还在

alter table partition_table drop partition (daytime=’2013-02-04’,city=’bj’);

- 创建表

另外一个例子,再一次说明创建表的过程

CREATE TABLE tmp_table #表名

(

title string, #字段名称 字段类型

minimum_bid double,

quantity bigint,

have_invoice bigint

)COMMENT '注释:XXX' #表注释

PARTITIONED BY(pt STRING) #分区表字段

ROW FORMAT DELIMITED

FIELDS TERMINATED BY '\t' # 字段是用什么分割开的

STORED AS SEQUENCEFILE; #用哪种方式存储数据,SEQUENCEFILE是hadoop自带的文件压缩格式PS:

#分区表字段—–如果你文件非常之大的话,采用分区表可以快过滤出按分区字段划分的数据

基于Partition的查询

一般 SELECT 查询是全表扫描。但如果是分区表,查询就可以利用分区剪枝(input pruning)的特性,类似“分区索引“”,只扫描一个表中它关心的那一部分。Hive 当前的实现是,只有分区断言(Partitioned by)出现在离 FROM 子句最近的那个WHERE 子句中,才会启用分区剪枝。例如,如果 page_views 表(按天分区)使用 date 列分区,以下语句只会读取分区为‘2008-03-01’的数据。

SELECT page_views.* FROM page_views WHERE page_views.date >= '2013-03-01' AND page_views.date <= '2013-03-01'4.External Table(外部表)

- 指向已经在 HDFS 中存在的数据,可以创建 Partition

- 它和 内部表 在元数据的组织上是相同的,而实际数据的存储则有较大的差异

- 内部表 创建过程和数据加载过程(这两个过程可以在同一个语句中完成),在加载数据的过程中,实际数据会被移动到数据仓库目录中;之后对数据对访问将会直接在数据仓库目录中完成。删除表时,表中的数据和元数据将会被同时删除

- 外部表 只有一个过程,加载数据和创建表同时完成,并不会移动到数据仓库目录中,只是与外部数据建立一个链接。当删除一个 外部表 时,仅删除该链接

- 创建一个外部表的相关操作

- 创建数据文件external_table.dat内容如下

- 创建表

hive>create external table external_table1 (key string) ROW FORMAT DELIMITED FIELDS TERMINATED BY ‘\t’ location ‘/home/external’; - 在HDFS创建目录/home/external

#hadoop fs -put /home/external_table.dat /home/external - 加载数据

LOAD DATA INPATH ‘/home/external_table1.dat’ INTO TABLE external_table1; - 查看数据

select * from external_table

select count(*) from external_table - 删除表

drop table external_table

5.Bucket Table(桶表)

- 桶表是对数据进行哈希取值,然后放到不同文件中存储

- 创建一个桶表

- 创建表

create table bucket_table(id string) clustered by(id) into 4 buckets; - 加载数据

set hive.enforce.bucketing = true;

insert into table bucket_table select name from stu;

insert overwrite table bucket_table select name from stu;

- 创建表

PS:数据加载到桶表时,会对字段取hash值,然后与桶的数量取模。把数据放到对应的文件中。

6.视图

- 视图的创建

CREATE VIEW v1 AS select * from t1;

7.总结

有关表的其他操作:

- 表的修改

alter table target_tab add columns (cols,string) - 表的删除

drop table - 一些相关命令

SHOW TABLES; # 查看所有的表

SHOW TABLES ‘*TMP*’; #支持模糊查询

SHOW PARTITIONS TMP_TABLE; #查看表有哪些分区

DESCRIBE TMP_TABLE; #查看表结构 - LIMIT Clause

Limit 可以限制查询的记录数。查询的结果是随机选择的。下面的查询语句从 t1 表中随机查询5条记录:

SELECT * FROM t1 LIMIT 5- Top N查询

下面的查询语句查询销售记录最大的 5 个销售代表。

SET mapred.reduce.tasks = 1

SELECT * FROM sales SORT BY amount DESC LIMIT 5- 表连接

- 内连接

- 左外连接

select b.name,a.* from dim_ac a join acinfo b on (a.ac=b.acip) limit 10;select b.name,a.* from dim_ac a left outer join acinfo b on a.ac=b.acip limit 10;- JAVA客户端相关代码

Class.forName("org.apache.hadoop.hive.jdbc.HiveDriver");

Connection con = DriverManager.getConnection("jdbc:hive://192.168.1.102:10000/wlan_dw", "", "");

Statement stmt = con.createStatement();

String querySQL="SELECT * FROM wlan_dw.dim_m order by flux desc limit 10";

ResultSet res = stmt.executeQuery(querySQL);

while (res.next()) {

System.out.println(res.getString(1) +"\t" +res.getLong(2)+"\t" +res.getLong(3)+"\t" +res.getLong(4)+"\t" +res.getLong(5));

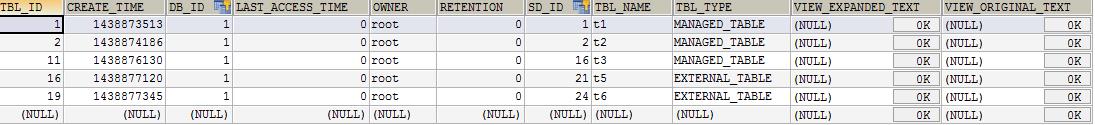

}- 当利用Mysql存储Hive的元数据时,创建的一些表的信息存放在hive数据库的TBLS表中,内容如图:

PS:

其中,TBL_NAME 是创建表时指定的表名,TBL_TYPE 是创建表的类型,内部表是MANAGED_TABLE,外部表是EXTERNAL_TABLE。

1426

1426

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?