BP中文名为误差后向传播算法,其是针对前馈神经网络的常用训练算法。BP的算法原理资料很多,这里就不一一赘述。

一、算法的思考与改进

BP算法虽然很强大,但是其收敛速度慢,训练时间长、容易落入局部最优值等缺点一直为人诟病。而对于BP算法的改进方法有如:自适应步长、增加动量项等。

固定步长:

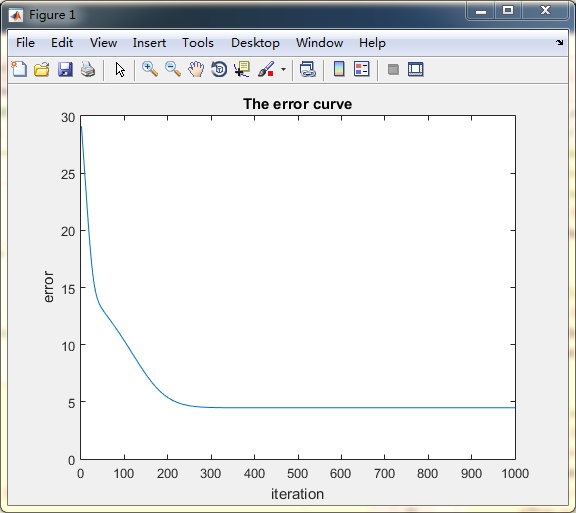

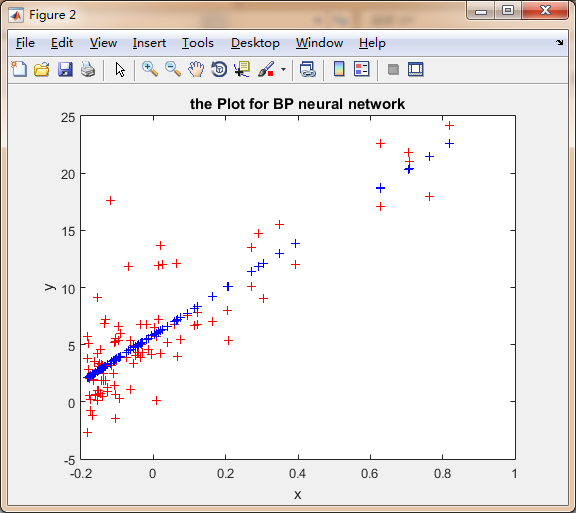

如下对于这是简单的线性数据拟合,差不到200+次迭代神经网络才收敛:

调整策略1:

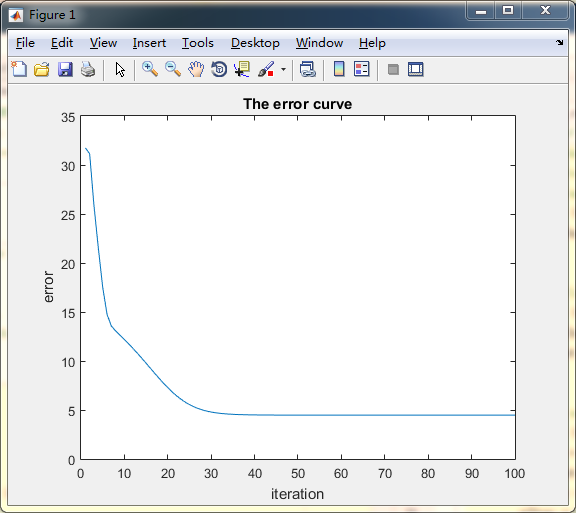

这个调整策略来自参考文献[1]的变学习率公式,前期的步长十分大,而后学习率随着迭代次数增加而线性减小:

stepDist = max_step - ((max_step - min_step) * cntIter / nIter);其接近20次就基本收敛了:

调整策略2:

使用前后两次的迭代误差的差值来确定是否

本文探讨了BP神经网络在收敛速度和局部最优问题上的挑战,并提出了两种改进策略:一是根据迭代次数线性调整学习率,二是利用误差差值的log函数来动态改变步长,以提高收敛速度并减少网络震荡。

本文探讨了BP神经网络在收敛速度和局部最优问题上的挑战,并提出了两种改进策略:一是根据迭代次数线性调整学习率,二是利用误差差值的log函数来动态改变步长,以提高收敛速度并减少网络震荡。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?