运维工程师在进行服务器运维时,往往一个人要同时监控几十甚至成百上千的机器,当机器数量增加时,服务器管理的难度将会大大增加。很多工程师在工作中会使用一些运维面板,比如bt,1panel等,但是这些工具往往一次只能监控管理一台机器,在多机器的场景下不能满足需求。

今天给大家介绍一种方式,使用一款免费的服务器运维工具,就可以批量的绑定多台主机,并同时对多台主机进行监控和管理。

服务器绑定

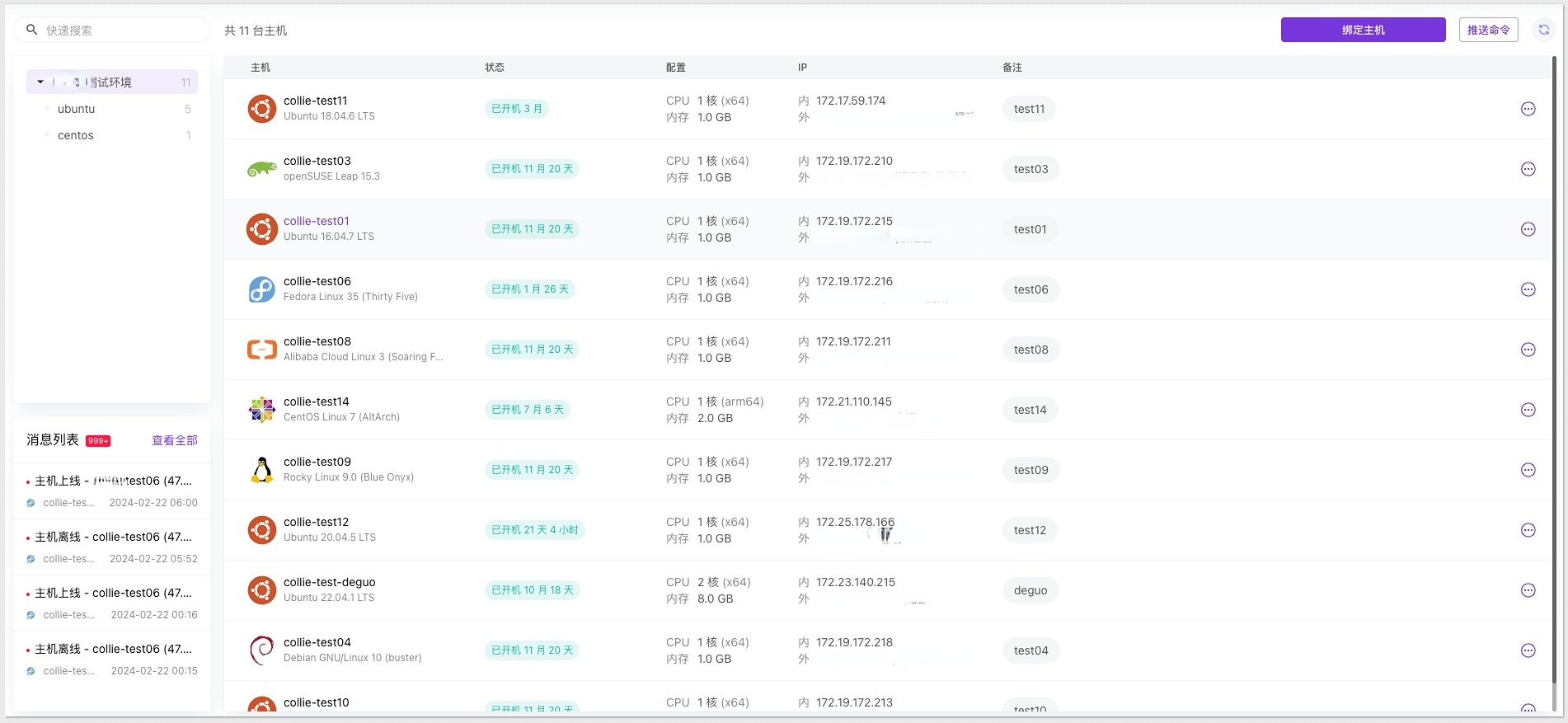

首先打开浏览器进入服务器运维工具-牧云主机管理助手页面,完成登录和产品开通后,只需要点击页面上方的“绑定主机”按钮,复制命令行到目标服务器的终端,粘贴执行就可以了。

服务器完成绑定后,页面会展示所有的服务器及其“配置”“状态”等基本信息。

如果需要对这些主机进行监控,可以参考 服务器运维小技巧(二) 中的技巧,进行批量的监控告警配置。

批量推送命令

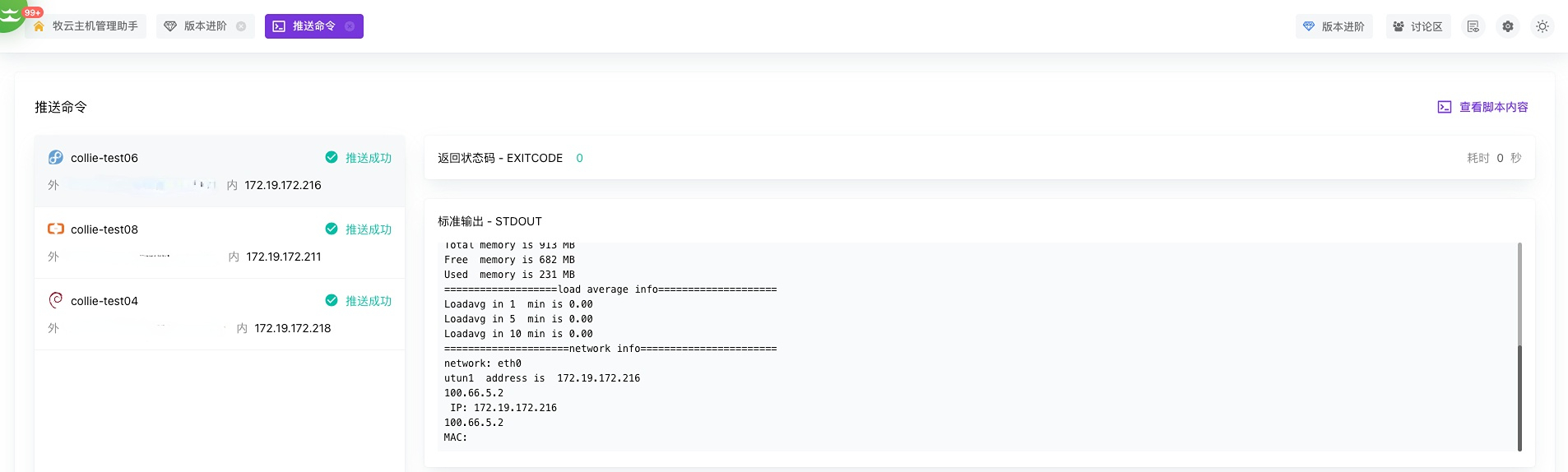

如需对这些服务器批量的进行命令推送,可以点击页面上方的“推送命令”按钮,即可选择内置的模板或自定义命令,批量地对需要执行这些命令的主机进行推送。

推送完成可查看不同主机的输出情况,会返回命令执行状态码,提供标准输出和错误输出,便于排查服务器命令执行情况。快捷方便的实现了规模化管理服务器,节省了逐台服务器检查的繁琐步骤。

本文介绍了运维工程师在面临大量服务器管理挑战时,如何利用牧云主机管理助手这款工具进行批量绑定主机、配置监控告警和推送命令,以简化大规模服务器管理工作流程。

本文介绍了运维工程师在面临大量服务器管理挑战时,如何利用牧云主机管理助手这款工具进行批量绑定主机、配置监控告警和推送命令,以简化大规模服务器管理工作流程。

1096

1096

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?