CONV1D

官网: https://pytorch.org/docs/stable/generated/torch.nn.Conv1d.html#torch.nn.Conv1d

torch.nn.Conv1d(

in_channels,

out_channels,

kernel_size,

stride=1,

padding=0,

dilation=1,

groups=1,

bias=True,

padding_mode='zeros',

device=None, dtype=None)

torch.nn.Conv1d(in_channels, "输入图像中的通道数"

out_channels, "卷积产生的通道数"

kernel_size, "卷积核的大小"

stride, "卷积的步幅。默认值:1"

padding, "添加到输入两侧的填充。默认值:0"

dilation, "内核元素之间的间距。默认值:1"

groups, "从输入通道到输出通道的阻塞连接数。默认值:1"

bias, "If True,向输出添加可学习的偏差。默认:True"

padding_mode "'zeros', 'reflect', 'replicate' 或 'circular'. 默认:'zeros'"

)

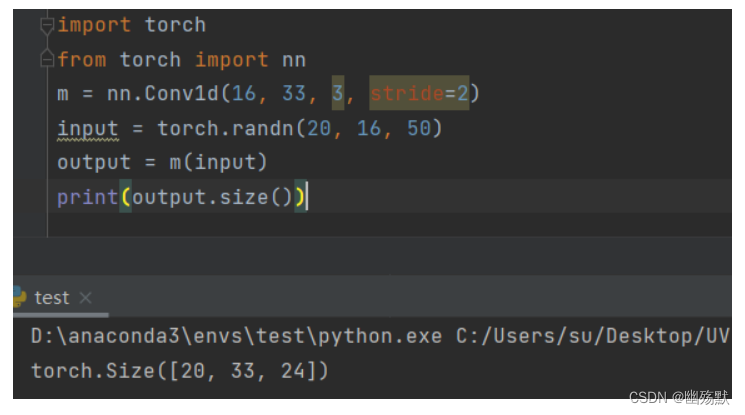

例子:

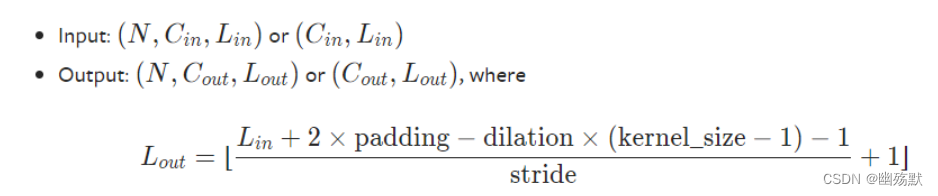

一维卷积输入(N1,C1,L1)输出(N2,C2,L2)理解:

- N1:表示输入的样本数,即输入数据中有多少个样本。

- C1:表示输入的通道数,也就是输入数据的特征图数量。

- L1:表示输入数据的长度或者序列长度,可以理解为输入数据在时间轴上的长度(如果是时序数据)、在空间轴上的长度(如果是空间数据)等。

- N2:表示输出的样本数,与输入样本数N1有可能不同。

- c2:表示输出的通道数,也就是输出数据的特征图数量。

- L2:表示输出数据的长度或者序列长度,在一维卷积中通常会根据输入数据的长度、卷积核大小和填充来计算得到。

输出通道数指的设卷积核的数量.

例子:对于输入(20,16,50),输出(20,33,24)其卷积核的大小为(33 16 3)

20,16,50),输出(20,33,24)其卷积核的大小为(33 16 3)

其中说明有33个卷积核每一个卷积核的大小为16x3.可以看到batch的数量是永远不会变的。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?