机器学习

文章平均质量分 85

Bravo٩

这个作者很懒,什么都没留下…

展开

-

机器学习——————支持向量机

1. 基于最大间隔分割数据支持向量机:优点:泛化错误率低,计算开销不大,结果易解释。缺点:对参数调节和函数的选择敏感,原始分类器不加修改仅适用于处理二类问题。适用数据类型:数值型和标称型数据。如下图中A-D共4个方框中的数据点分布,不能画出一条直线将圆形点和方形点分开。故其为线性不可分的数据集。 图1.1 4个线性不可分数据集而如图1.2...原创 2021-12-26 02:15:43 · 275 阅读 · 0 评论 -

【基于概率论的分类方法:朴素贝叶斯】

4.1 基于贝叶斯决策理论的分类方法朴素贝叶斯优4点:在数据较少的情况下仍然有效,可以处理多类别问题。缺点:对于输入数据的准备方式较为敏感。适用数据类型:标称型数据。朴素贝叶斯是贝叶斯决策理论的一部分。先简单了解一下贝叶斯决策理论,假设有两类数据的统计参数,p1(x,y)表示数据点(x,y)属于类别1的概率,p2(x,y)表示数据点(x,y)属于类别2的概率。那么对于一个新的数据点(x,y),可以用下面的规则来判断它的类别:如果p1(x,y) >p2(x,y) ,..原创 2021-11-28 18:37:38 · 674 阅读 · 0 评论 -

【机器学习---Logistic回归】

一、基于Logistic回归和Sigmoid函数的分类Logistic回归:优点:计算代价不高,易于理解和实现。缺点:容易欠拟合,分类精度可能不高。使用数据类型:数值型和标称型数据。 我们想要的函数是:能够接受所有的输入然后预测出类别。...原创 2021-11-21 01:07:54 · 368 阅读 · 0 评论 -

机器学习实验二(决策树)

一、原理1.1决策树决策树(Decision Tree)是一种基本的分类与回归方法,在这里主要讨论用于分类的决策树。决策树的学习通常包含三个步骤:特征选择,决策树的生成,决策树的剪枝。1.2决策树的特点:优点:计算复杂度不高,输出结果易于理解,对中间值的缺失不敏感,可以处理不相关特征数据。 缺点:可能会产生过度匹配的问题。 适用数据类型:数值型和标称型(数值型需要离散化)。1.3决策树的一般流程(1)收集数据:可以使用任何方法。(2)准备数据:树构造算法只适用于标称型数据,因.原创 2021-10-27 23:01:59 · 1929 阅读 · 0 评论 -

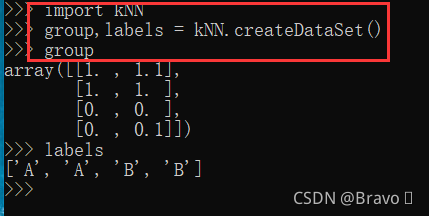

机器学习(K-近邻算法实战)

标题Array()接受1到2个位置参数,但给出了4个def classi原创 2021-10-10 23:46:17 · 259 阅读 · 0 评论 -

机器学习实验一

机器学习实验一配置python+numpy环境python下载安装在https://www.python.org/downloads/下载安装Python 3.9.7(由于本人在此之前已安装,便不再重复。)numpy下载安装在 https://pypi.org/project/numpy/#files下载安装numpy,并选择对应的版本。如python版本为3.9,则选择numpy版本含“cp39”,并根据自身电脑的系统和配置做出相应的选择,我这里是Windows系统,64位,故选择了n原创 2021-10-03 19:11:44 · 546 阅读 · 0 评论

分享

分享