Generative Face Completion

CVPR 2017

https://arxiv.org/abs/1704.05838

Code: https://github.com/Yijunmaverick/GenerativeFaceCompletion

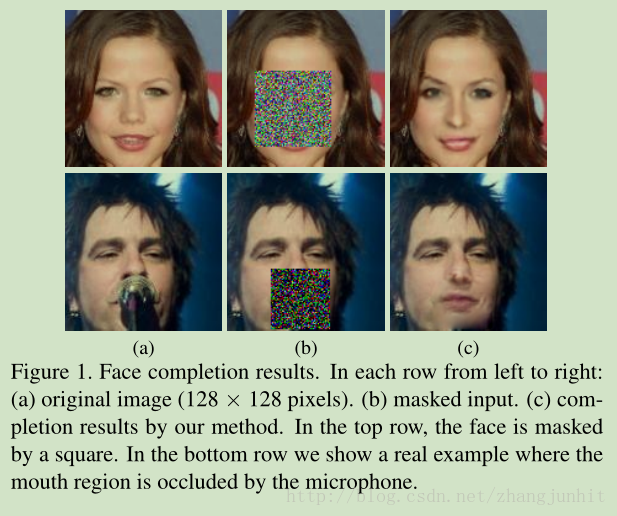

首先来直观的认识一下人脸修复是什么? 输入一个有缺失的人脸图像,得到完整的人脸图像

本文算法训练流程图如下:

主要由三个模块构成:Generator,Discriminator,Parsing network

3.1. Generator

这里的 Generator 被设计为一个 autoencoder,输入不完整的图像,输出修复后的图像。这里我们使用了 VGG19的前半部分网络结构,外加2个卷积层,一个池化层,一个全链接层。decoder 和 encoder 是对称的,使用了 unpooling 层 用于放大特征图尺寸

3.2. Discriminator

这里使用了两个 Discriminator,一个 local Discriminator, 一个 global Discriminator

local Discriminator 是针对 缺失图像区域的

global Discriminator 是针对整个图像区域的

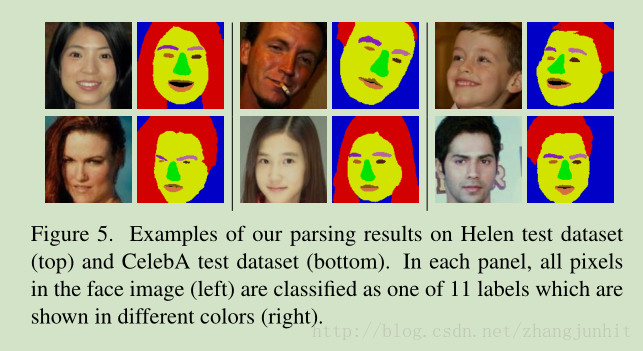

3.3. Semantic Regularization

这里的 Parsing network 主要用于进一步完善缺失区域的生成图像的真实性。

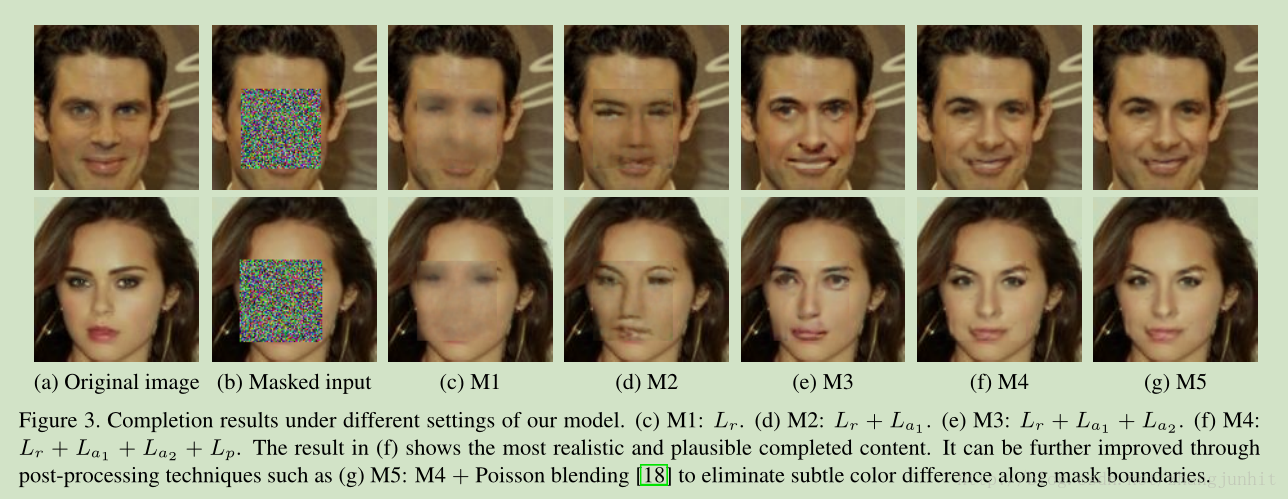

不同损失函数下修复的结果:

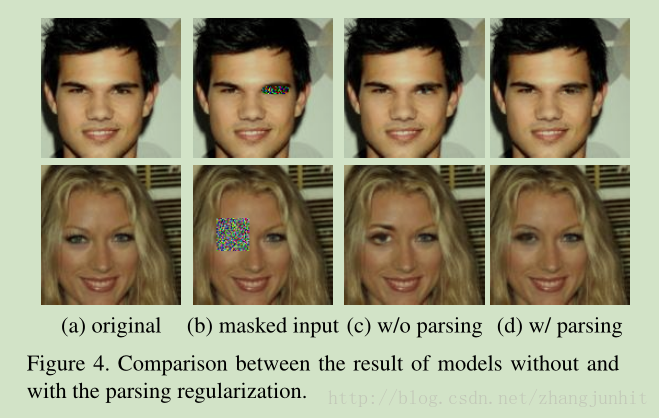

有无 Parsing network 的对比:

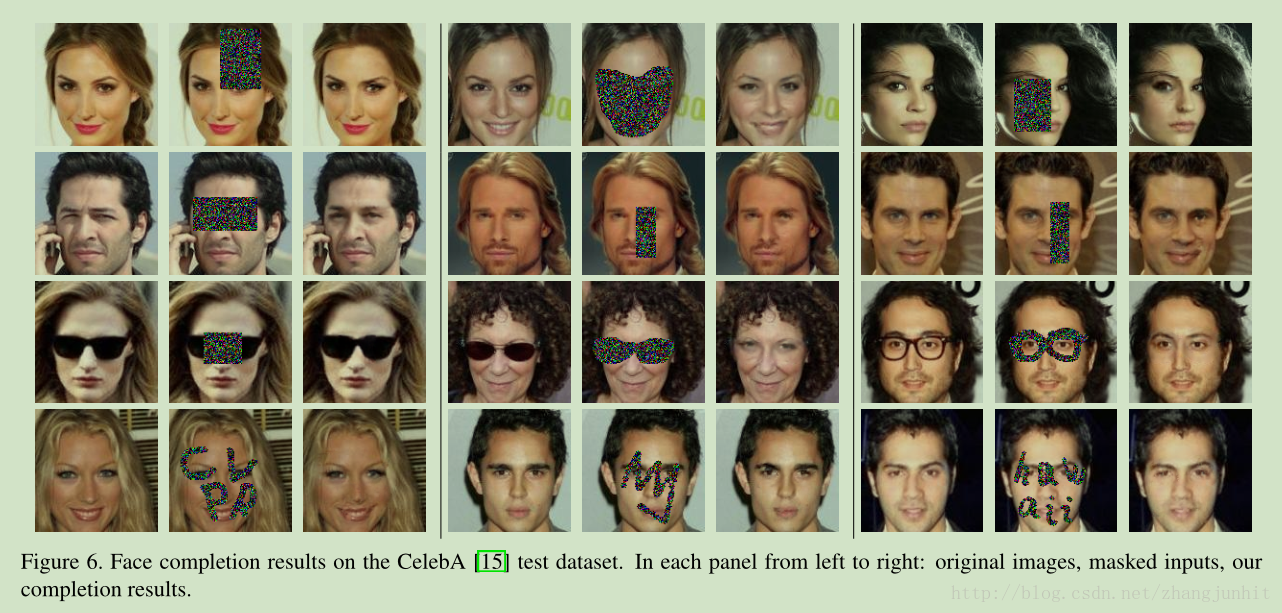

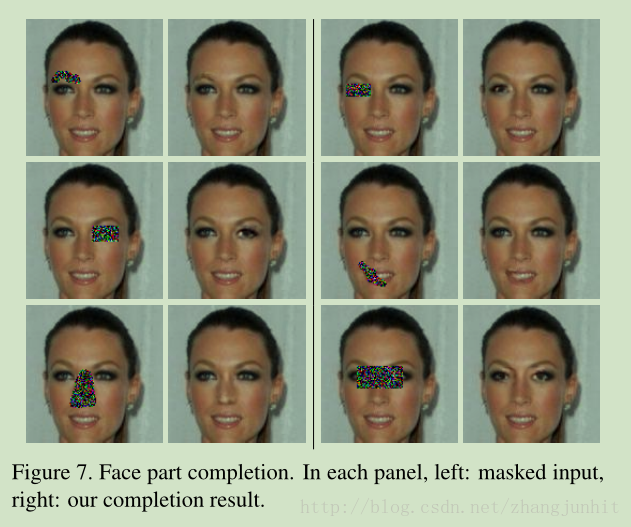

修复结果:

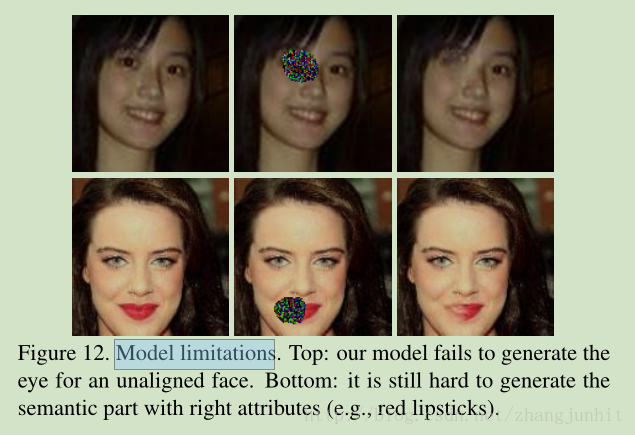

Model limitations

在这项工作中我们提出了一个深度生成网络来进行人脸补全。该网络是基于GAN的,使用一个自编码器作为生成器,两个对抗损失函数(局部和全局)和一个语义正则项作为鉴别器。该模型可以针对丢失的关键部分从随机噪声中成功合成语义上有效且视觉上和谐的内容。实验结果充分展示了补全结果的高质量感官体验,以及模型能灵活处理各种各样掩模特征(比如,不同位置,大小,形状)的能力。

GitHub代码实现:

关于人脸补全的CVPR17论文的Matcaffe实现

每组图片从左向右依次是:原始人脸,带掩模的输入,补完后的结果

软件环境配置:

我们使用caffev2.5.48版本。更多安装细节请参见Caffe官网。

最基本的是,你需要在Makefile.config文件中修改MATLAB_DIR,然后运行如下命令才能成功编译:

训练阶段:

就像在DCGAN中那样对数据进行预处理。唯一的区别在于我们剪切下来的人脸图像大小为128*128。请在crop_celebA.lua文件中的第10处进行修改。对于CelebA数据集我们使用了标准的训练集&测试集分割方式。

在./matlab/FaceCompletion_training/GFC_caffeinit.m文件中修改训练数据路径。

下载我们的人脸解析模型Model_parsing并将其放置在./matlab/FaceCompletion_training/model/目录下。

我们提供了一个仅用重构损失训练得到的初始模型,对于接下来GAN的训练这可以作为一个很好的参数起点。请将其下载到./matlab/FaceCompletion_training/model/目录下。

通过运行./matlab/FaceCompletion_training/demo_GFC_training.m就可以训练了。

测试阶段:

下载我们的人脸补完模型Model_G到./matlab/FaceCompletion_testing/model/目录下。

运行./matlab/FaceCompletion_testing/demo_face128.m开始对人脸进行补全。测试图像来自于CelebA的测试集。

GitHub项目:https://github.com/Yijunmaverick/GenerativeFaceCompletion论文地址:https://arxiv.org/pdf/1704.05838.pdf

这篇paper将巧妙地将四个loss函数结合在一起,其中每一个loss的功能不同。但这篇paper不够elegant的地方也是loss太多!在本文中,我采用散文的写作方法谈谈自己对这篇paper的理解,其实质就是“想到哪,写到哪!”

如上图所示,(a)输入图像;(b)用随机square模板遮住输入图像一部分;(c)复原得到的图像。理想状态下,我们希望复原出的图像与输入图像完全一致(视觉上 and 语义上)。哈哈,这个不是很简单吗,我们可以用L2范数regularize输入图像与输出图像,理想状态下,输入图像与复原出的图像完全一致!恭喜你,回答正确!作者也这样试了试,结果如Figure 3 (c)所示。

哎呀!理想与现实差距有点大哦!仔细观察一下Figure 3 (c),我们可以得出结论:复原结果模糊、复原得到的patch有点像、复原patch的边缘清晰可见。其实,这个也很好理解,L2范数倾向于去平均,这样会丢失很多高频、低频信息,使得图像较为模糊、细节丢失。简而言之,复原图像与真实图像差距有点大!换句话说,就是复原图像看起来不真实!

这时候我脑海中浮现出一个概念,GAN的判决器不就是判定随机噪声生成图像(或者patch)是否真实的吗?哈哈,我们可以把这个思路搬过来哦!如果判决器判断不出来复原的图像是否是原图,这不就表明,复原得到的图像与原始图像一致吗?当然了,L2 loss还是必须的(可以理解为一个多任务学习)。说干就干,我直接判断生成的patch的是否真实,于是得到了Figure 3 (d)。看起来比之前好多了哦!细细看来,发现这个图片不是很真实,生成的patch在整幅图像中显得不协调!

不要灰心!生成的patch在整幅图像中看起来不协调,换一种理解方式就是:整幅图像看起来不真实吗?索性我在上述两个loss的基础上,再加上一个生成的全局图像是否真实的判定。这样是不是就保证了生成的patch在整幅图像中看起来比较自然些呢?请看Figure 3 (f)美女的大致轮廓已经显现,看起来也自然的多了!

等等!对于我这个美女控来说,怎么允许美女的脸颊有褶皱呢,参看Figure 3 (f)?男的吧,我忍了!哈哈!怎么办呢?我已经耗尽脑汁了!在山重水复疑无路时,我脑海中忽然浮现出一句诗“横看成岭侧成峰”。于是,我决定大胆试试,遮住美女或者帅哥的一只眼睛,看看复原的这只眼是不是与另外一只眼搭配呢?请看下图

在(c)中,我们可以明显感觉出,所说两只眼睛单独看没有问题,但是放在帅哥的脸上,怎么那么不自然呢?给人的感觉怪怪的!我们怎么才能使得他们协调一些呢?这个问题可理解为:保证两只眼睛大小一致、五官比例匀称等一些审美上的要求吧!

咯咯!这怎么和语义分割概念那么相似呢?假如,我能够事先知道一些五官布局之类的语义,这不就帮我解决上述问题了吗?说干就干,就给她引入语义信息!!!结果如(d),真是“千呼万唤始出来”哦!总算得到了让我满意的“帅哥”、“美女”图像!!!

说了这么多,我究竟在说的是什么呢?你是在搞图像处理呢,还是在干啥?恩,不能不务正业了,下面给您放出论文中的模型

是不是看着很熟悉的样子哦!Global discriminator就是判断复原图像是否真实的;local discriminator就是判断复原图像patch是否真实的。Parsing network那个是使得得到的人脸五官匀称、整齐的!至于L2 重构,您就自己意会一下吧!这不就是将我刚刚分析的几个要素整合到CNN网络中了吗?原理建模还可以这么理解哦!

明白了这篇paper的基本思路之后,下面就是在特定的数据集上训练我们的网络,当然了这个数据集必须包含作者需要的信息:GT parsing。作者选取的数据集是,CelebA。实际上,训练好这个网络之后,我们可以拿自己的人脸试试哦,看看是变帅了呢,还是变亮了呢?

说句话外话,Loss函数太多,每一个loss函数的权值怎么选,这个的确是个“黯然销魂”的问题,作者只是给出了权重,但是没有给出一些原则哦!如果您对鸟脸比较感兴趣,估计您得自己选择这些参数了哦!也许,您一下子就能选到了最佳组合,也许您在纠结到底什么权重是合适的呢?

本文介绍了一种基于生成对抗网络(GAN)的人脸修复技术,旨在完成缺失部分的人脸图像。该技术利用自编码器作为生成器,并结合局部和全局判别器及语义正则化项,以确保修复结果的真实性和协调性。

本文介绍了一种基于生成对抗网络(GAN)的人脸修复技术,旨在完成缺失部分的人脸图像。该技术利用自编码器作为生成器,并结合局部和全局判别器及语义正则化项,以确保修复结果的真实性和协调性。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?