©作者 | 崔以博

单位 | 军事科学院国防科技创新研究院

本文是 ICCV 2023 入选 Oral 论文 Grounded Entity-Landmark Adaptive Pre-training for Vision-and-Language Navigation 的解读。本论文是某智能人机交互团队在视觉-语言导航(Vision-and-Language Navigation, VLN)领域的最新工作。该工作构建了 VLN 中首个带有高质量实体-标志物对齐标注的数据集,并提出实体-标志物对齐的自适应预训练方法,从而显著提高了智能体的导航性能。

ICCV 是“计算机视觉三大顶级会议”之一,ICCV 2023 于今年 10 月 2 日至 6 日在法国巴黎举行,本届会议共收到全球 8260 篇论文投稿,2161 篇被接收,接收率为 26.16%,其中 152 篇论文被选为口头报告展示(Oral Presentation),Oral 接收率仅为 1.8%。

论文题目:

Grounded Entity-Landmark Adaptive Pre-training for Vision-and-Language Navigation

论文地址:

https://arxiv.org/abs/2308.12587

开源数据集:

https://pan.baidu.com/s/12WTzZ05T8Uxy85znn28dfQ?pwd=64t7

代码地址:

https://github.com/csir1996/vln-gela

引言

视觉-语言导航(Vision-and-Language Navigation, VLN)任务旨在构建一种能够用自然语言与人类交流并在真实 3D 环境中自主导航的具身智能体。自提出以来,VLN 越来越受到计算机视觉、自然语言处理和机器人等领域的广泛关注。

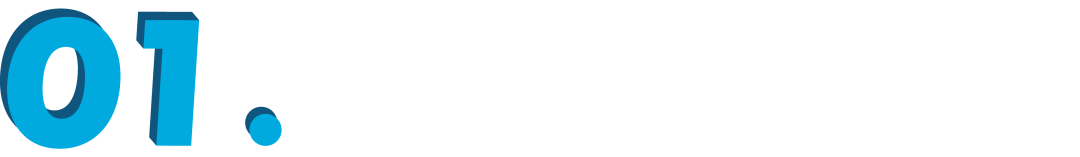

如图 1 所示,将自然语言指令中提过的标志物(物体或者场景)对应到环境中能够极大的帮助智能体理解环境和指令,由此跨模态对齐是 VLN 中的关键步骤。然而,大多数可用的数据集只能提供粗粒度的文本-图像对齐信号,比如整条指令与整条轨迹的对应或者子指令与子路径之间的对应,而跨模态对齐监督也都停留在句子级别(sentence-level)。因此,VLN 需要更细粒度(entity-level)的跨模态对齐数据和监督方法以促进智能体更准确地导航。

为解决以上问题,我们提出了一种面向 VLN 的实体-标志物自适应预训练方法,主要工作与贡献如下:

1. 我们基于 Room-to-Room(R2R)数据集 [1] 标注实体-标志物对齐,构建了第一个带有高质量实体-标志物对齐标注的 VLN 数据集,命名为 GEL-R2R;

2. 我们提出一种实体-标志物自适应预训练 (Grounded Entity-Landmark Adaptive,GELA) 方法,利用 GEL-R2R 数据集显式监督 VLN 模型学习实体名词和环境标志物之间的细粒度跨模态对齐;

3. 我们构建的 GELA 模型在两个 VLN 下游任务上取得了最佳的导航性能,证明了我们数据集和方法的有效性和泛化性。

▲ 图1. 具身智能体在3D真实环境中的导航示例

GEL-R2R数据集

为了建立指令中实体短语与其周围环境中相应标志物之间的对齐,我们在 R2R 数据集的基础上进行了实体-标志物对齐的人工标注,整个流程包括五个阶段:

1. 原始数据准备。我们从 Matterport3D 模拟器中采集每个可导航点的全景图。为了提高标注的效率和准确性,我们在全景图中标注下一个动作方向,并根据 FG-R2R 数据集 [2] 将每个全景图与相应的子指令进行对应;

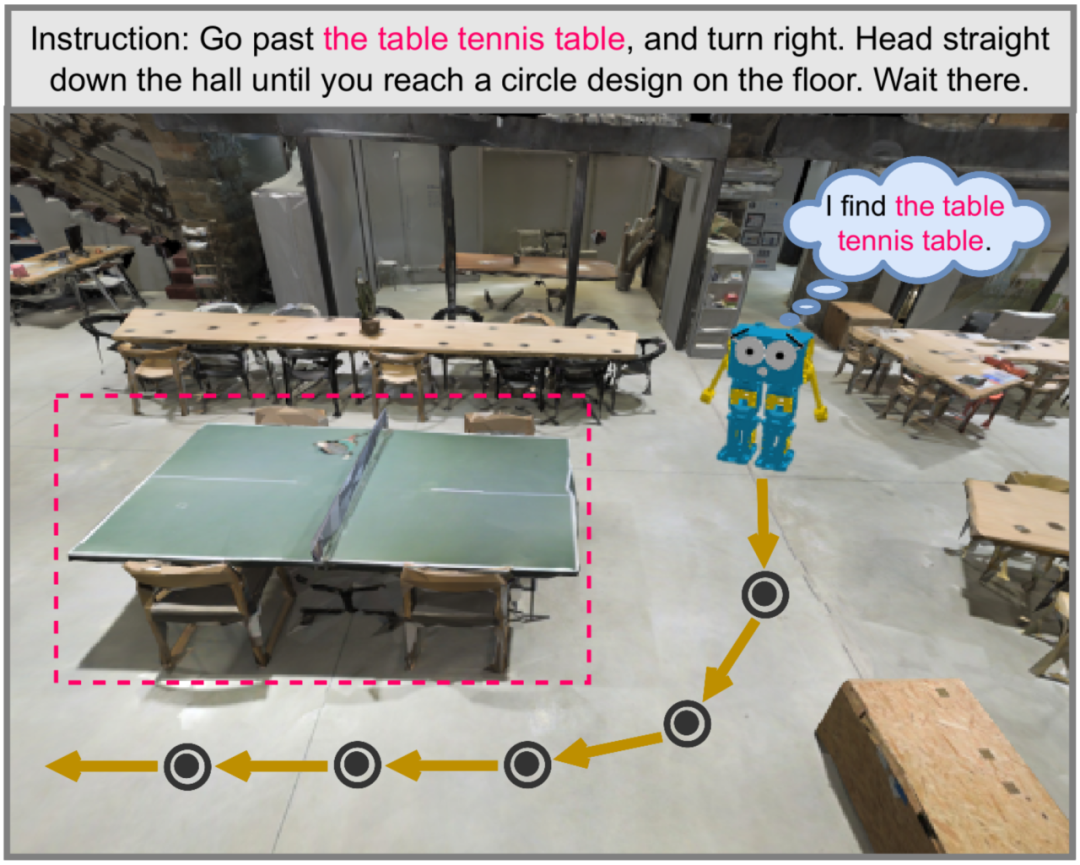

2. 标注工具开发。我们基于 Label-Studio 开发了一个跨模态标注平台,如图 2 所示;

3. 标注指南建立。为确保标注的一致性,我们经过预标注之后建立了四个准则来标准化标注指南:

对齐准则:指令中的实体短语应与全景图中的标志物准确匹配

自由文本准则:标注自由文本而不是类别

文本共指准则:指代相同标志物的实体短语用相同的标签标注

唯一标志物准则:对于一个实体短语,在全景图中只应标注一个对应的标志物

4. 数据标注与修订;

5. 数据整合与处理。

▲ 图2. GEL-R2R数据集标注界面

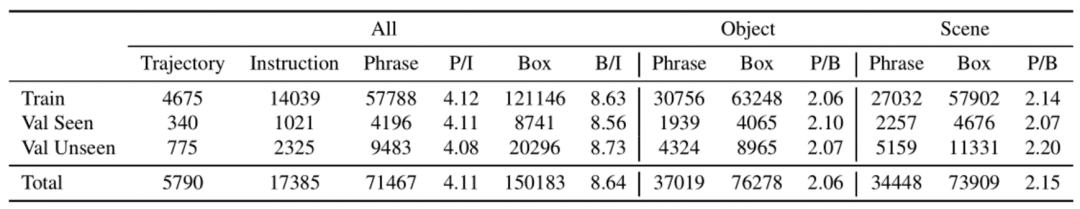

如图 3 所示,GEL-R2R 数据集共包含:71467 个实体短语,其中训练集 57788 个,已见环境验证集 4196 个,未见环境验证集 9483 个;150183 个标志物,其中训练集 121146 个,已见环境验证集 8741 个,未见环境验证集 20296 个。

▲ 图3. GEL-R2R数据集统计分析

GELA方法

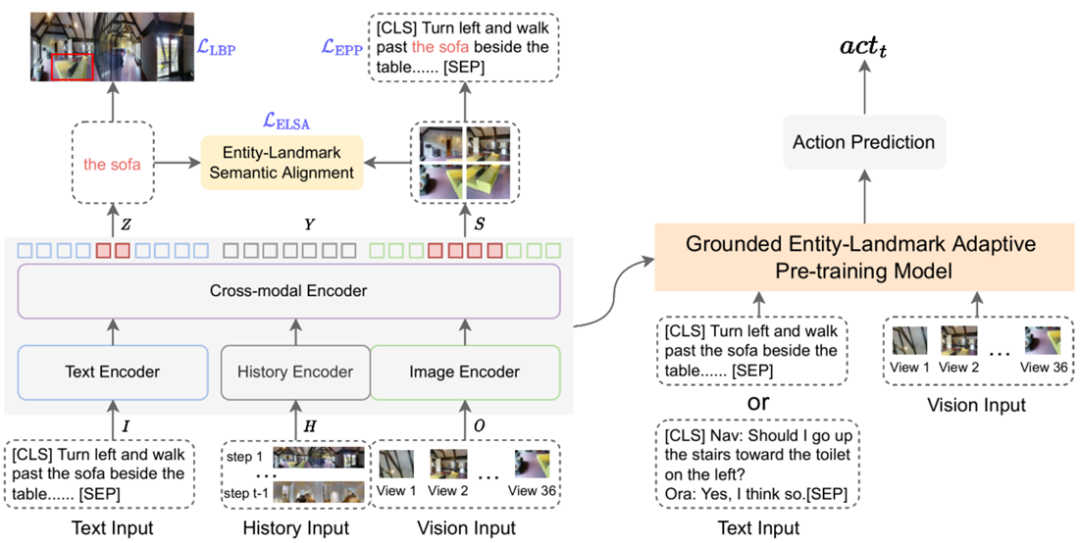

▲ 图4. GELA方法概览

如图 4 所示,方法流程分为三个阶段:预训练(pre-training)、自适应预训练(adaptive pre-training)和微调(fine-tuning)。我们直接在预训练模型 HAMT [3] 的基础上进行自适应预训练,HAMT 模型由文本编码器、图像编码器、历史编码器和跨模态编码器构成。我们将跨模态编码器输出的文本向量、历史向量和图像向量分别记为 Z、Y 和 S。我们设计了三种自适应预训练任务:

1. 实体短语预测。在这个任务中,我们通过标注的环境标志物预测其对应的实体短语在指令中的位置。首先将人工标注的实体位置转化为 L+1 维的掩码向量 (与 维度相同),并将人工标注的标志物边界框转化为 37 维的掩码向量 (与 维度相同)。然后,我们将标志物图像 patch 的特征平均化,并将其输入一个两层前馈网络(Feedforward Network, FFN)中,预测指令序列中 token 位置的概率分布,用掩码向量 作监督,具体损失函数为:

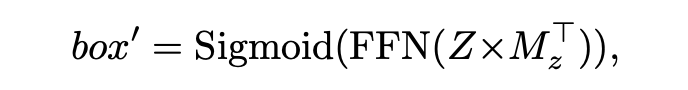

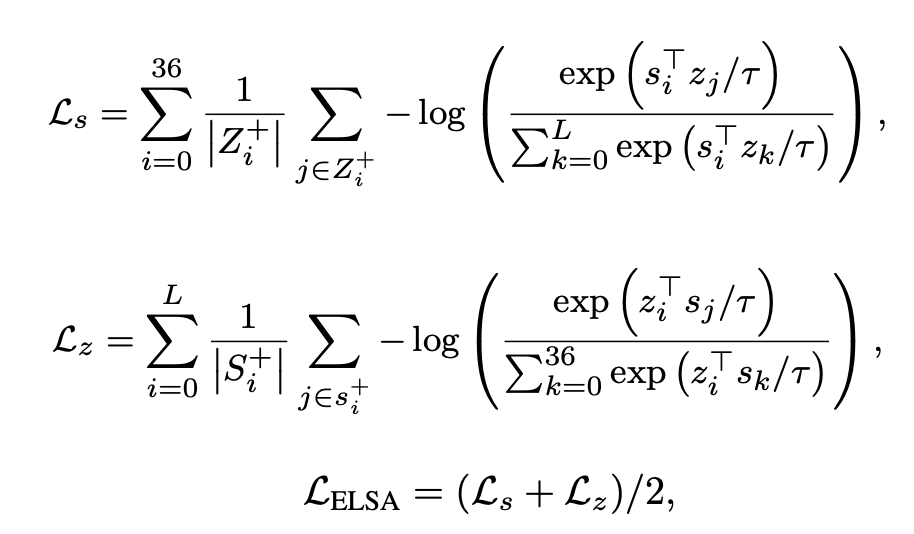

2. 标志物边界框预测。在这个任务中,我们通过标注的实体名词预测其对应的标志物边界框坐标。首先平均实体短语 token 的特征向量,然后将其输入两层 FFN 和 Sigmoid 函数预测坐标 :

最后,将人工标注的 box=(x,y,w,h) 和 box’ 作 smooth-l1 损失和 GIoU 损失:

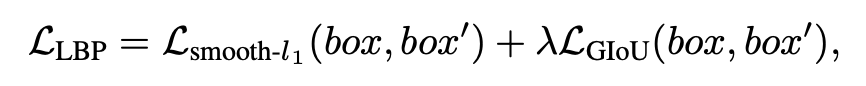

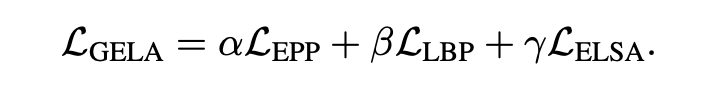

3. 实体-标志物语义对齐。上述两个单向预测任务使用位置信息来匹配实体和标志物,而此任务在跨模态编码器输出端强制对齐相对应的标志物和实体的特征向量。这个任务的约束比上面两个单向预测任务更强,因为它直接作用于表示,而不是仅仅基于位置信息。具体损失函数如下:

自适应预训练最终的损失函数为:

经过自适应预训练后,我们利用模仿学习 (Imitation Learning,IL) 和强化学习 (Reinforcement Learning,RL) 训练策略对 GELA 模型在两个 VLN 下游任务(R2R 和 CVDN)上进行微调。IL 监督智能体克隆专家的行为,RL 鼓励智能体根据学习策略探索轨迹。

实验结果

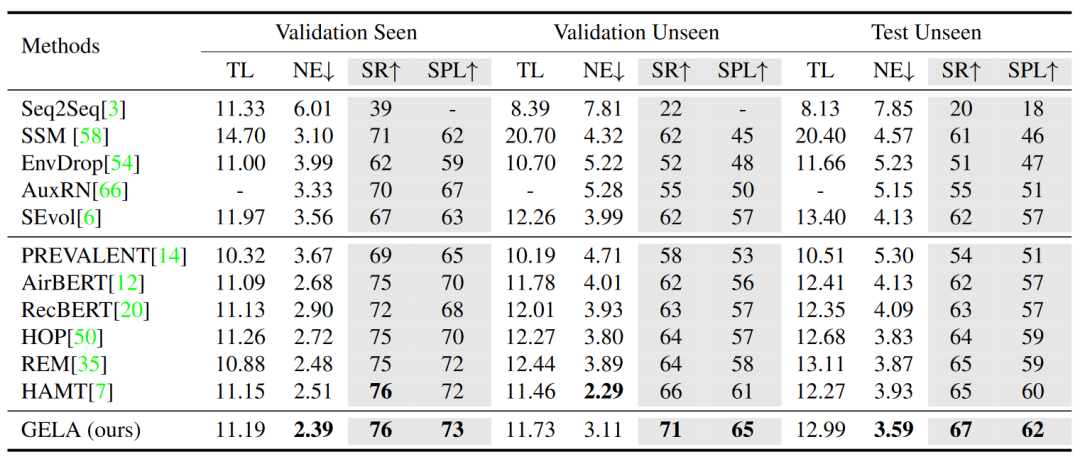

如图 5 所示,GELA 模型在 R2R 数据集上与先前 SOTA 模型的性能进行比较。GELA 模型在所有子集上的主要指标(SR 和 SPL)均优于所有其他模型。具体地,在已知验证集上,GELA 的性能与 HAMT 模型相当,而在未知验证集和测试集上,GELA 模型分别取得了 5% 、2% (SR) 和 4% 、2% (SPL) 的提高。因此,GELA 模型具有更好的未知环境泛化能力,这主要是由于 GELA 模型在学习实体-标志物对齐后,具有较强的语义特征捕捉能力。

▲ 图5. R2R数据集上的性能对比

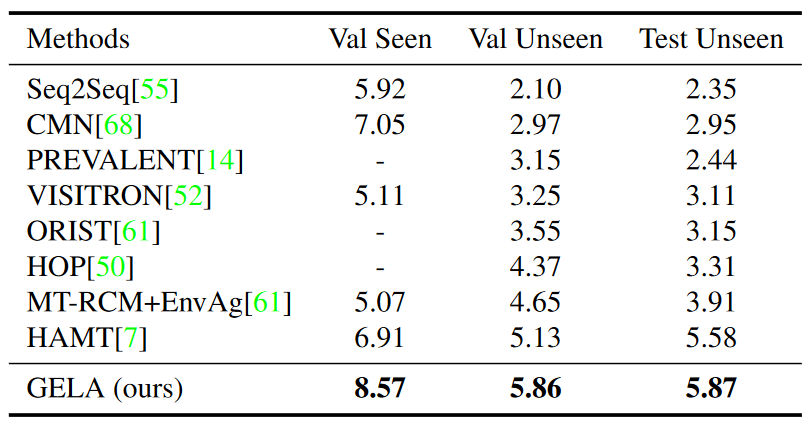

我们同样在 CVDN 数据集上对比了 GELA 模型与先前 SOTA 模型的性能,如图 6 所示,该数据集使用以米为单位的目标进度 (Goal Progress,GP) 作为关键性能指标。结果表明,GELA 模型在验证集和测试集上的性能都明显优于其他模型。因此,GELA 模型对不同的 VLN 下游任务具有良好的泛化能力。

▲ 图6. CVDN数据集上的性能对比

参考文献

[1] Peter Anderson, Qi Wu, Damien Teney, Jake Bruce, Mark Johnson, Niko S ̈ underhauf, Ian D. Reid, Stephen Gould, and Anton van den Hengel. Vision-and-language navigation: Interpreting visually-grounded navigation instructions in real environments. In CVPR, pages 3674–3683, 2018.

[2] Yicong Hong, Cristian Rodriguez Opazo, Qi Wu, and Stephen Gould. Sub-instruction aware vision-and-language navigation. In EMNLP, pages 3360–3376, 2020.

[3] Shizhe Chen, Pierre-Louis Guhur, Cordelia Schmid, and Ivan Laptev. History aware multimodal transformer for vision-and-language navigation. In NeurIPS, pages 58345847, 2021.

更多阅读

#投 稿 通 道#

让你的文字被更多人看到

如何才能让更多的优质内容以更短路径到达读者群体,缩短读者寻找优质内容的成本呢?答案就是:你不认识的人。

总有一些你不认识的人,知道你想知道的东西。PaperWeekly 或许可以成为一座桥梁,促使不同背景、不同方向的学者和学术灵感相互碰撞,迸发出更多的可能性。

PaperWeekly 鼓励高校实验室或个人,在我们的平台上分享各类优质内容,可以是最新论文解读,也可以是学术热点剖析、科研心得或竞赛经验讲解等。我们的目的只有一个,让知识真正流动起来。

📝 稿件基本要求:

• 文章确系个人原创作品,未曾在公开渠道发表,如为其他平台已发表或待发表的文章,请明确标注

• 稿件建议以 markdown 格式撰写,文中配图以附件形式发送,要求图片清晰,无版权问题

• PaperWeekly 尊重原作者署名权,并将为每篇被采纳的原创首发稿件,提供业内具有竞争力稿酬,具体依据文章阅读量和文章质量阶梯制结算

📬 投稿通道:

• 投稿邮箱:hr@paperweekly.site

• 来稿请备注即时联系方式(微信),以便我们在稿件选用的第一时间联系作者

• 您也可以直接添加小编微信(pwbot02)快速投稿,备注:姓名-投稿

△长按添加PaperWeekly小编

🔍

现在,在「知乎」也能找到我们了

进入知乎首页搜索「PaperWeekly」

点击「关注」订阅我们的专栏吧

·

·

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?