©作者 | 孔令宇

单位 | 国科大博士生

研究方向 | 多模态学习

想将一份文档图片转换成 Markdown 格式?以往这一任务需要文本识别、布局检测和排序、公式表格处理、文本清洗等多个步骤——

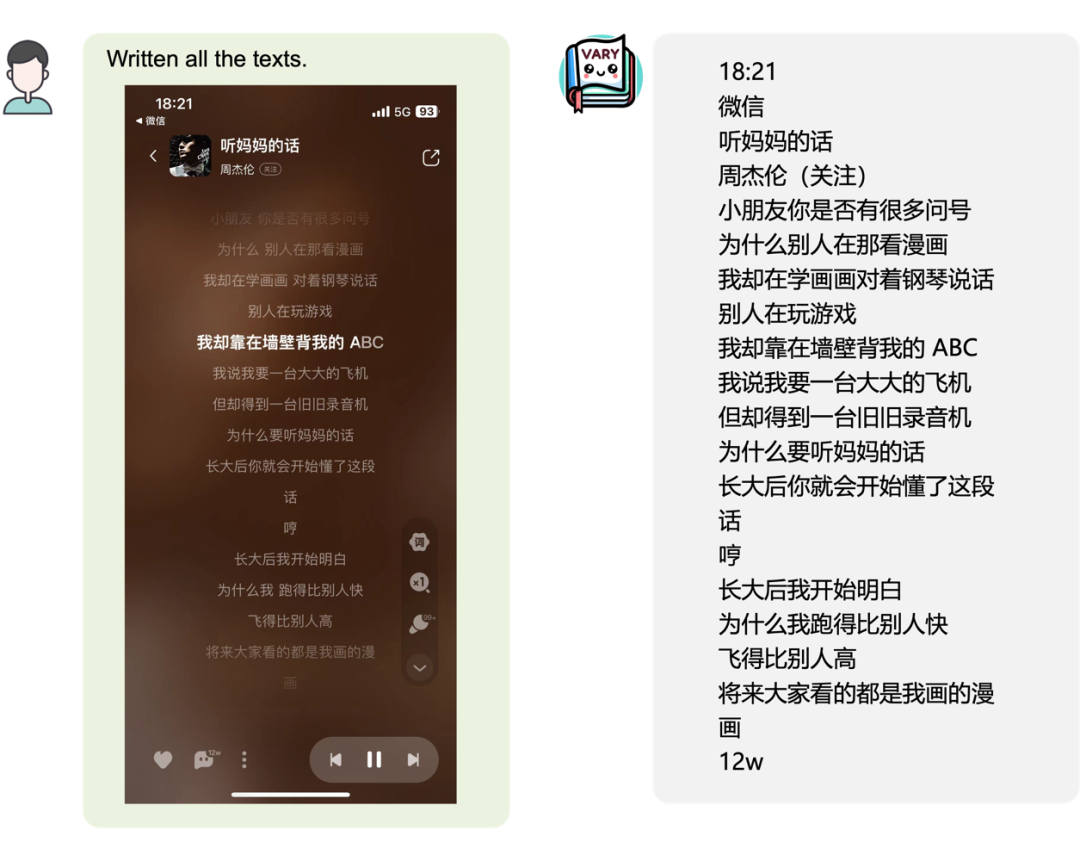

这一次,只需一句话命令,多模态大模型 Vary 直接端到端输出结果:

无论是中英文的大段文字:

还是包含了公式的文档图片:

又或是手机页面截图:

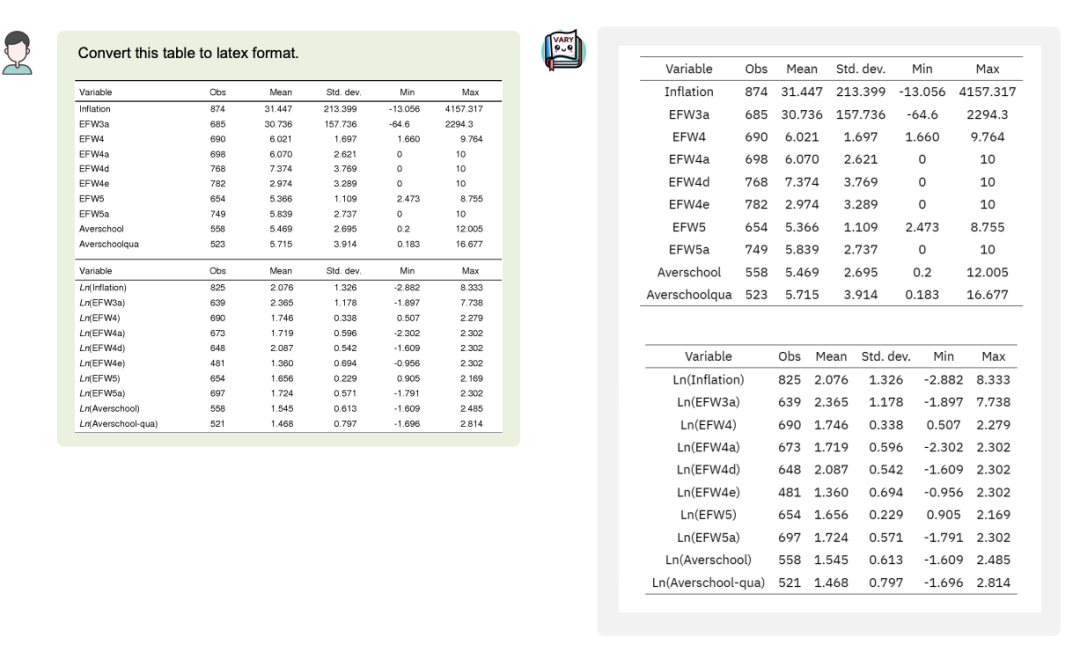

甚至可以将图片中的表格转换成 Latex 格式:

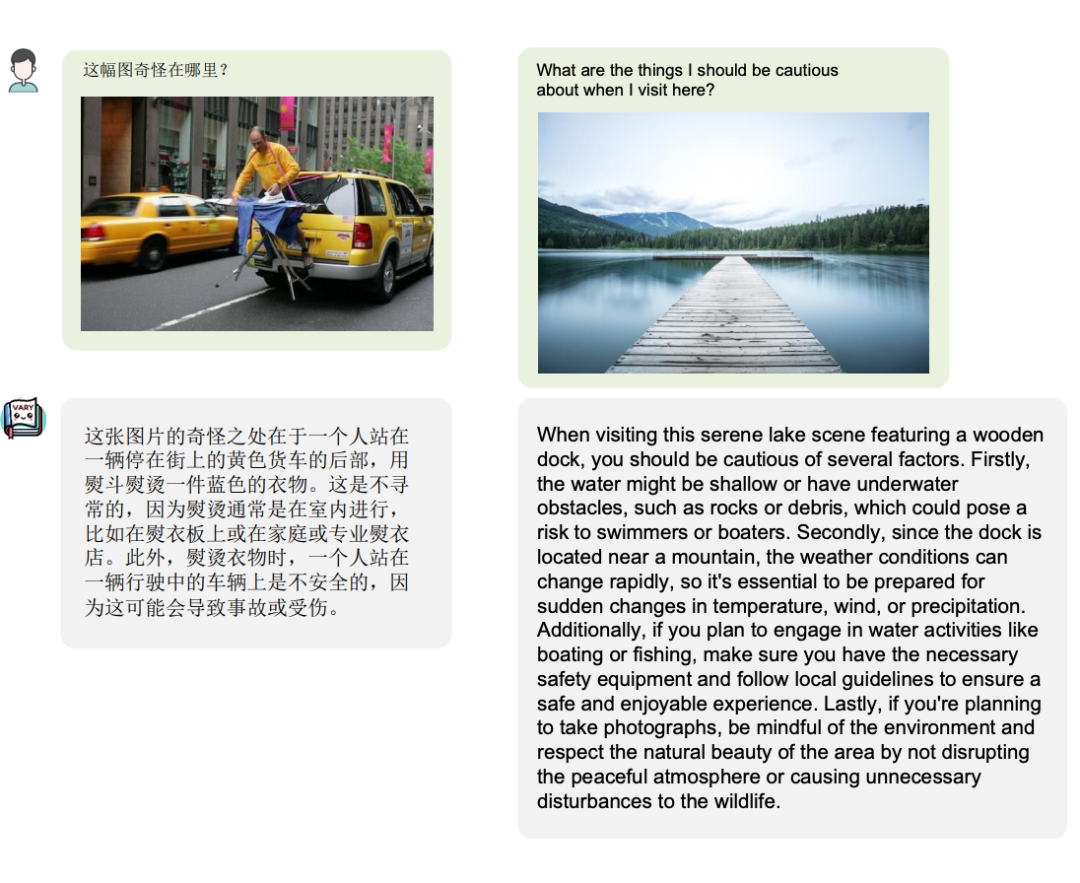

当然,作为多模大模型,通用能力的保持也是必须的:

Vary 表现出了很大的潜力和极高的上限,OCR 可以不再需要冗长的 pipline,直接端到端输出,且可以按用户的 prompt 输出不同的格式如 Latex、Word、Markdown。通过 LLM 极强的语言先验,这种架构还可以避免 OCR 中的易错字,比如“杠杆”和“杜杆”等, 对于模糊文档,也有望在语言先验的帮助下实现更强的 OCR 效果。

项目一出,引发了不少网友的关注,有网友看后直呼 “kill the game!”

那么这样的效果,是如何做到的呢?

背后原理

目前的多模态大模型几乎都是用 CLIP 作为 Vision Encoder 或者说视觉词表。确实,在 400M 图像文本对训练的 CLIP 有很强的视觉文本对齐能力,可以覆盖多数日常任务下的图像编码。但是对于密集和细粒度感知任务,比如文档级别的 OCR、Chart 理解,特别是在非英文场景,CLIP 表现出了明显的编码低效和 out-of-vocabulary 问题。

受语言的 LLMs 启发,纯 NLP 大模型(如 LLaMA)从英文到中文(外语)时因为原始词表编码中文效率低,必须要扩大 text 词表。那么对于现在基于 CLIP 视觉词表的多模大模型也是一样的,遇到 “foreign language image”,如一页论文密密麻麻的文字,很难高效地将图片 token 化,Vary 提出就是解决这一问题,在不 overwrite 原有词表前提下,高效扩充视觉词表。

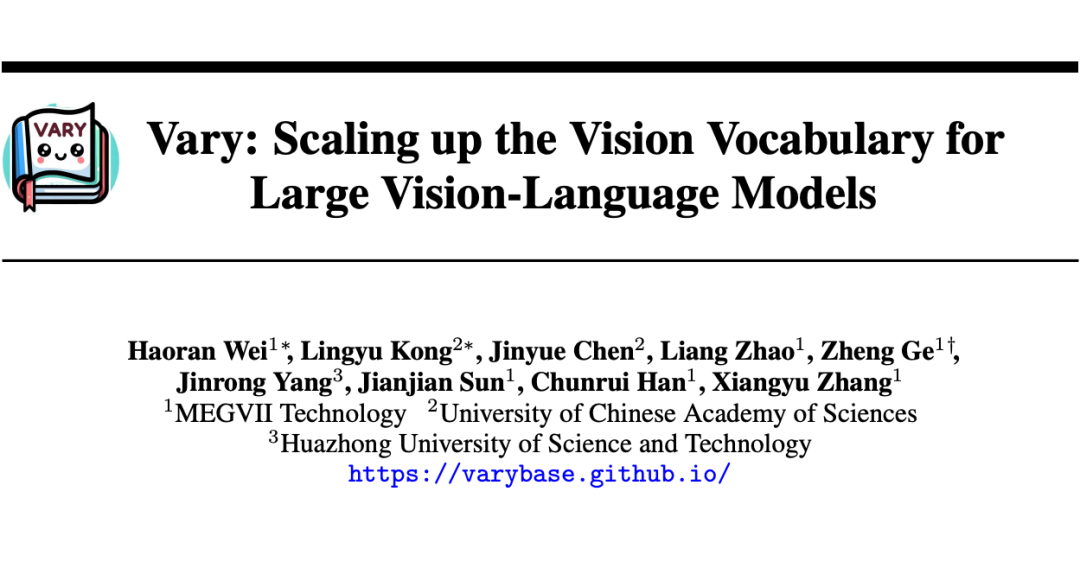

不同于现有方法直接用现成的 CLIP 词表,Vary 分两个阶段:第一阶段先用一个很小的 Decoder-only 网络用自回归方式帮助产生一个强大的新视觉词表;然后在第二阶段融合新词表和 CLIP 词表,从而高效的训练多模大模型拥有新 feature。Vary 的训练方法和模型结构如下图:

通过在公开数据集以及渲染生成的文档图表等数据上训练,Vary 极大增强了细粒度的视觉感知能力。在保持 Vanilla 多模态能力的同时,激发出了端到端的中英文图片、公式截图和图表理解能力。

另外,原本可能需要几千 tokens 的页面内容,通过文档图片输入,信息被Vary压缩在了 256 个图像 tokens 中。这也为进一步的页面分析和总结提供了更多的想象空间。

目前,Vary 的代码和模型均已开源,还给出了供大家试玩的网页 demo。感兴趣的小伙伴可以去试试了~

项目主页:

https://varybase.github.io/

参考链接

https://zhuanlan.zhihu.com/p/671420712

更多阅读

#投 稿 通 道#

让你的文字被更多人看到

如何才能让更多的优质内容以更短路径到达读者群体,缩短读者寻找优质内容的成本呢?答案就是:你不认识的人。

总有一些你不认识的人,知道你想知道的东西。PaperWeekly 或许可以成为一座桥梁,促使不同背景、不同方向的学者和学术灵感相互碰撞,迸发出更多的可能性。

PaperWeekly 鼓励高校实验室或个人,在我们的平台上分享各类优质内容,可以是最新论文解读,也可以是学术热点剖析、科研心得或竞赛经验讲解等。我们的目的只有一个,让知识真正流动起来。

📝 稿件基本要求:

• 文章确系个人原创作品,未曾在公开渠道发表,如为其他平台已发表或待发表的文章,请明确标注

• 稿件建议以 markdown 格式撰写,文中配图以附件形式发送,要求图片清晰,无版权问题

• PaperWeekly 尊重原作者署名权,并将为每篇被采纳的原创首发稿件,提供业内具有竞争力稿酬,具体依据文章阅读量和文章质量阶梯制结算

📬 投稿通道:

• 投稿邮箱:hr@paperweekly.site

• 来稿请备注即时联系方式(微信),以便我们在稿件选用的第一时间联系作者

• 您也可以直接添加小编微信(pwbot02)快速投稿,备注:姓名-投稿

△长按添加PaperWeekly小编

🔍

现在,在「知乎」也能找到我们了

进入知乎首页搜索「PaperWeekly」

点击「关注」订阅我们的专栏吧

·

·

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?