1. 特征缩放

实际当我们在计算线性回归模型的时候,会发现特征变量x,不同维度之间的取值范围差异很大。这就造成了我们在使用梯度下降算法的时候,由于维度之间的差异使得Jθ的值收敛的很慢。

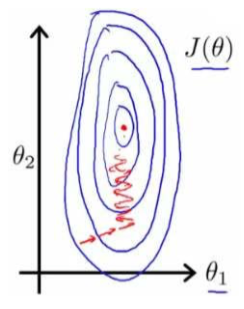

我们还是以房价预测为例子,我们使用2个特征。房子的尺寸(1~2000),房间的数量(1-5)。以这两个参数为横纵坐标,绘制代价函数的等高线图能看出整个图显得很扁,假如红色的轨迹即为函数收敛的过程,会发现此时函数收敛的非常慢。

为了解决这个问题,我们采用特征缩放,所谓的特征缩放就是把所有的特征都缩放到一个相近的取值范围内。比如-1~1,或者-0.5~2,或者-2~05 等等,只要不超过-3 ~ 3这个范围,基本上都能够满足梯度下降算法

本文探讨了在机器学习中梯度下降算法遇到的特征缩放问题和学习速率选择的策略。特征缩放通过将所有特征调整到相近范围,如-1到1,有助于梯度下降更快收敛。对于学习速率,合适的α值应使代价函数J(θ)每次迭代都下降。过小的α会导致过多迭代,过大的α可能导致无法收敛。建议从0.001开始,以3或10的倍数递增,观察J(θ)的变化来确定最佳学习速率。

本文探讨了在机器学习中梯度下降算法遇到的特征缩放问题和学习速率选择的策略。特征缩放通过将所有特征调整到相近范围,如-1到1,有助于梯度下降更快收敛。对于学习速率,合适的α值应使代价函数J(θ)每次迭代都下降。过小的α会导致过多迭代,过大的α可能导致无法收敛。建议从0.001开始,以3或10的倍数递增,观察J(θ)的变化来确定最佳学习速率。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

789

789

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?