1、两种模式的区别

cluster模式:Driver程序在YARN中运行,应用的运行结果不能在客户端显示,所以最好运行那些将结果最终保存在外部存储介质(如HDFS、Redis、Mysql)而非stdout输出的应用程序,客户端的终端显示的仅是作为YARN的job的简单运行状况。

client模式:Driver运行在Client上,应用程序运行结果会在客户端显示,所有适合运行结果有输出的应用程序(如spark-shell)

2、原理

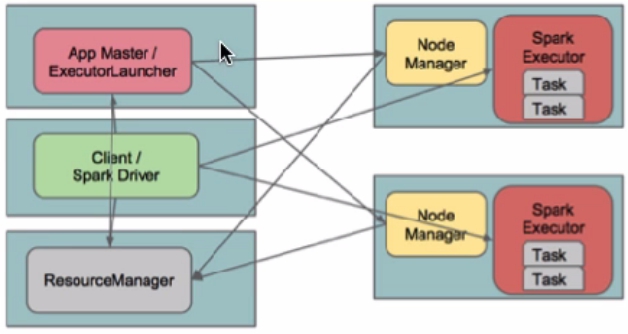

client 模式

①在client模式下,Driver运行在Client上,通过ApplicationMaster向RM获取资源。本地Driver负责与所有的executor container进行交互,并将最后的结果汇总。结束掉终端,相当于kill掉这个spark应用。

②客户端的Driver将应用提交给Yarn后,Yarn会先后启动ApplicationMaster和executor,另外ApplicationMaster和executor都 是装载在container里运行,container默认的内存是1G,ApplicationMaster分配的内存是driver- memory,executor分配的内存是executor-memory。同时,因为Driver在客户端,所以程序的运行结果可以在客户端显 示,Driver以进程名为SparkSubmit的形式存在。

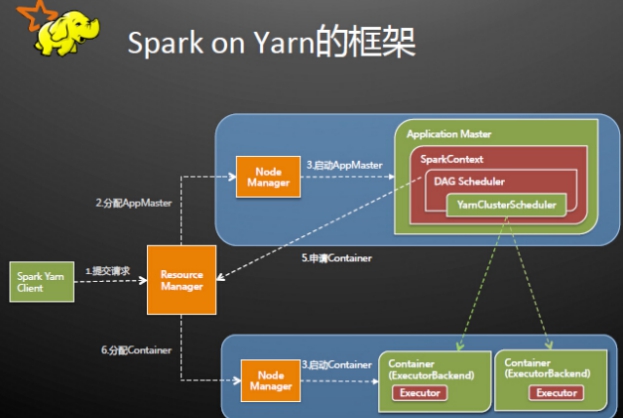

2、cluster模式

①. 由client向ResourceManager提交请求,并上传jar到HDFS上

这期间包括四个步骤:

a).连接到RM

b).从RM的ASM(ApplicationsManager )中获得metric、queue和resource等信息。

c). upload app jar and spark-assembly jar

d).设置运行环境和container上下文(launch-container.sh等脚本)

②. ResouceManager向NodeManager申请资源,创建Spark ApplicationMaster(每个SparkContext都有一个ApplicationMaster)

③. NodeManager启动ApplicationMaster,并向ResourceManager AsM注册

④. ApplicationMaster从HDFS中找到jar文件,启动SparkContext、DAGscheduler和YARN Cluster Scheduler

⑤. ResourceManager向ResourceManager AsM注册申请container资源

⑥. ResourceManager通知NodeManager分配Container,这时可以收到来自ASM关于container的报告。(每个container对应一个executor)

⑦. Spark ApplicationMaster直接和container(executor)进行交互,完成这个分布式任务。

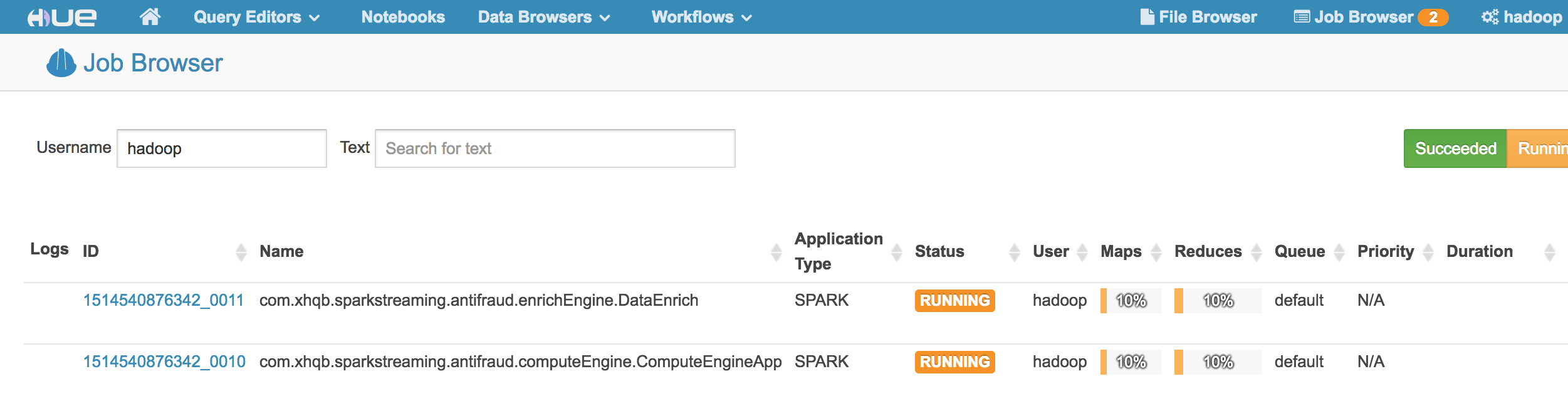

通过aws Hue可以查看 cluster执行的时候,显示出来的是Object类名称

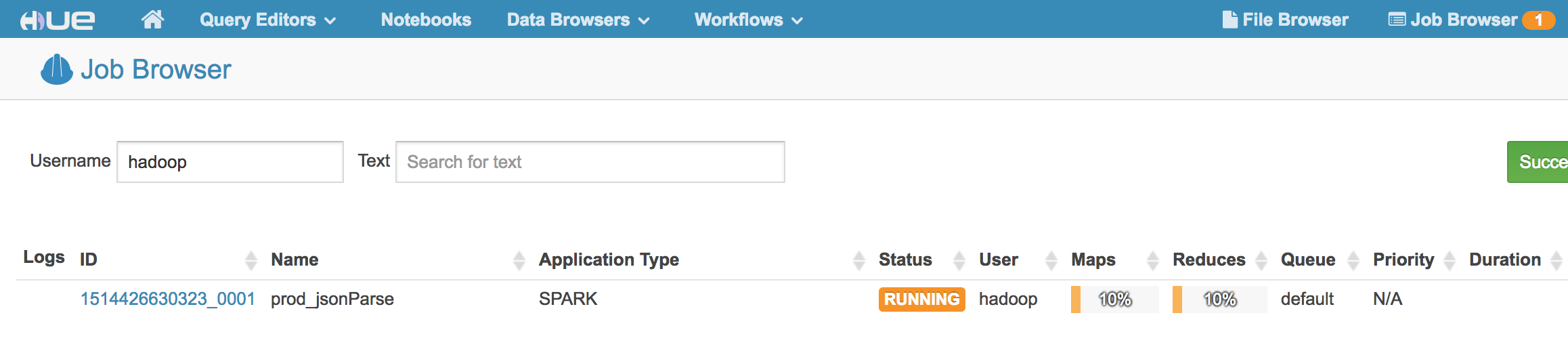

通过 aws Hue 可以查看client 执行的时候,显示出来的是appName名称

总结:一般测试来说,可以使用client模式可以实时打印数据,生产的话建议用cluster,因为数据只是在集群内部然后不用collect到driver端,预防driver内存撑爆

2119

2119

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?