1。之前的日志传输的方案: Nginx => Logstash =>ES AND Kakfa 。 存在的问题,如果Es挂掉,整个的 Logstash 传输的pipline 管道就会阻塞,Kafka 端也收不到消息,耦合性很强。一个 Logstash 进程 属于一个 pipline 管道。

2.为了解决上述问题,采用 Nginx => Logstash =>Kafka =》logstash =>ES AND =》Kafka Consumer。 消息同一由Logstash 传输到 Kafka 。 kafka 到 Logstash =>Es; kafka 到 Consumer 到 Hdfs 这种方式。

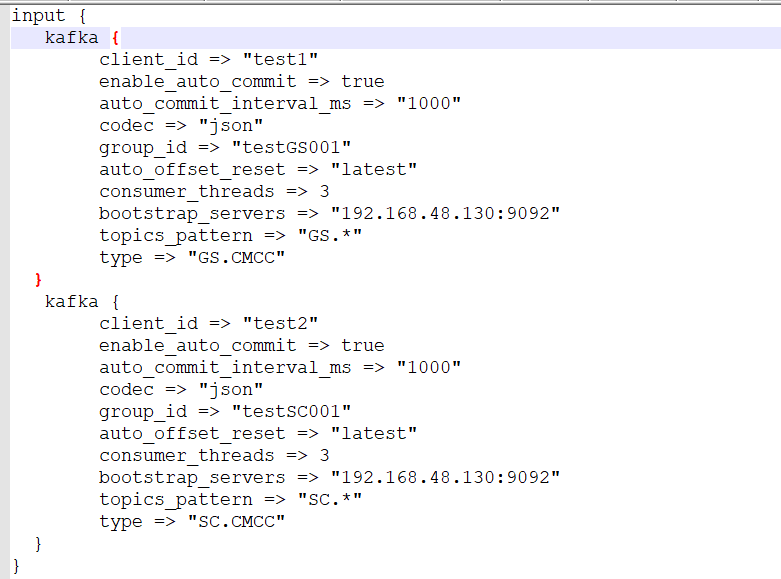

其中涉及到的问题:Logstash 配置文件中 input 配置 多个kafka 问题,每个kafka 必须要有 client_id,并且每个kafka的client_id 不可以相同。

根据 type 字段 区分到 es的不同index。

配置多个kafka 每个kafka group.id 不相同 达到区分 的问题。

488

488

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?