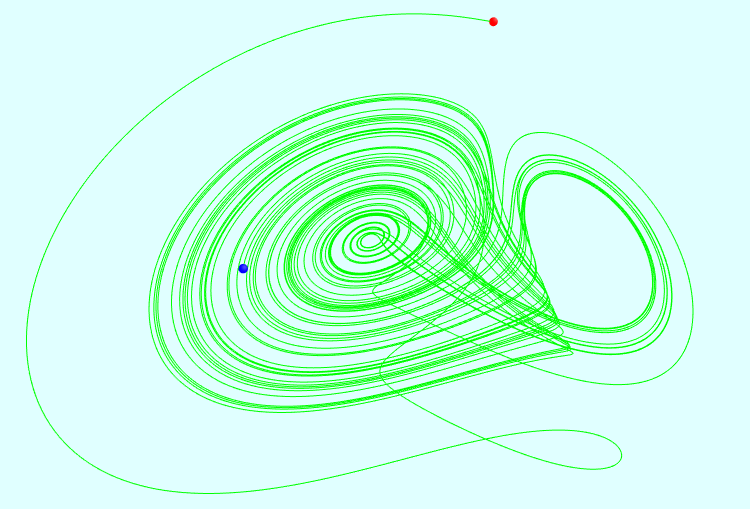

吕陈吸引子(Lu Chen attractor)也称Lu attractor 吸引子是2002年中国科学院数学与系统科学研究院研究员

吕金虎(Jinhu Lu),Suchun Zhang 和香港城市大学电子工程系讲座教授陈关荣( Guangrong Chen )发现和分析的

种新型的介于洛伦茨吸引子和蔡氏电路之间的吸引子。

吕氏吸引子的特点是其随控制参数的变化,而呈现为左卷波混沌吸引子、麻花型吸引子或右卷波混沌吸引子.

吕氏吸引子方程:

frac{dx(t)}{dt}=a*(y(t)-x(t))

frac{dy(t)}{dt}=x(t)-x(t)*z(t)+c*y(t)+u

frac{dz(t)}{dt}=x(t)*y(t)-b*z(t)

参数:a = 36, c = 20, b = 3, u = -15..15

初始条件:x(0) = .1, y(0) = .3, z(0) = -.6

其中 u 是一个控制数,

当 u ≤-11 时,Lṻ Chen 混沌吸引子为左卷波混沌吸引子,

当 u 在 -10 和 10 之间 时为麻花型吸引子,

当 u≥ 11 ,是右卷波混沌吸引子。

相关软件:混沌数学及其软件模拟

相关代码:

class LuChenAttractor : public DifferentialEquation

{

public:

LuChenAttractor()

{

m_StartX = 0.1f;

m_StartY = 0.3f;

m_StartZ = -0.6f;

m_ParamA = 36.0f;

m_ParamB = 3.0f;

m_ParamC = 20.0f;

m_ParamD = 8.0f;

}

void Derivative(float x, float y, float z, float& dX, float& dY, float& dZ)

{

dX = m_ParamA*(y - x);

dY = x - x*z + m_ParamC*y + m_ParamD;

dZ = x*y - m_ParamB*z;

}

bool IsValidParamA() const {return true;}

bool IsValidParamB() const {return true;}

bool IsValidParamC() const {return true;}

bool IsValidParamD() const {return true;}

};

相关截图:

429

429

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?