block数据块是HDFS文件系统基本的存储单位

block(块)128M 小于一个块的文件,不会占据整个块的空间

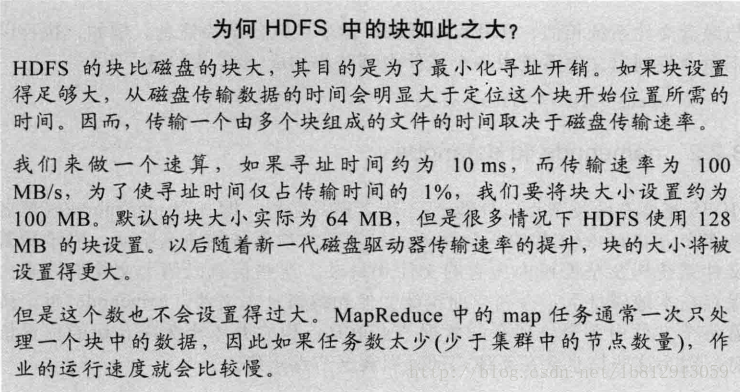

block数据块大小设置较大的原因:

1)减少文件寻址时间

2)减少管理块的数据开销,每个块都需要在NameNode上有对应的记录

3)对数据块进行读写,减少建立网络的连接成本

然而真正实际开发中要把block设置的远大于128MB,比如存储文件是1TB时,一般把Block大小设置成512MB.但是也不能任意设置的太大,比如200GB一个,因为在MapReduce的map任务中通常一次只处理一个块中数据(切片大小默认等于block大小),如果设置太大,因为任务数太少(少于集群中的节点数量),那么作业的运行速度就会慢很多,此外比如故障等原因也会拖慢速度。

1546

1546

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?