监控端口数据官方案例

案例需求:首先,Flume 监控本机 44444 端口,然后通过 telnet 工具向本机 44444 端口发送消息,最后 Flume 将监听的数据实时显示在控制台。

分析:

netcat工具的使用

安装nc:

sudo yum install -y nc

netcat 是 Linux 系统中的网络工具,其通过 TCP 和 UDP 协议在网络中读写数据。如果与其他工具结合,以及加上重定向功能,还可以实现很多不同的功能。所以其以体积小功能灵活而著称,可以用来做很多网络相关的工作。

nc命令常用参数

netcat 使用的基本形式为:

nc 参数 目的地址 端口

参数说明如下:

-k 在当前连接结束后保持继续监听

-l 用作端口监听,而不是发送数据

-n 不使用 DNS 解析

-N 在遇到 EOF 时关闭网络连接

-p 指定源端口

-u 使用 UDP 协议传输

-v (Verbose)显示更多的详细信息

-w 指定连接超时时间

-z 不发送数据

本次案例使用:

## 开启服务器,监听44444端口,没有指定地址默认使用localhost

nc -lk 44444

## 客户端连接,

nc hadoop113 44444

## 在客户端输入hello并回车发送,在服务端可以看到hello

## 在服务端输入nihao并回车发送,在客户端可以看到nihao

## 当服务端不存在时,客户端不能单独存在

案例实践

创建配置文件,内容如下(配置文件内容来自http://flume.apache.org/releases/content/1.7.0/FlumeUserGuide.html);

# Name the components on this agent

# 命名组件,可以定义多个,用空格隔开

# a1表示agent的名字,也是自定义的,但是要全局变量

a1.sources = r1

a1.sinks = k1

a1.channels = c1

# Describe/configure the source

# source的类型

a1.sources.r1.type = netcat

# source监听的主机和端口

a1.sources.r1.bind = localhost

a1.sources.r1.port = 44444

# Describe the sink

# sink的类型,即控制台输出

a1.sinks.k1.type = logger

# Use a channel which buffers events in memory

# channel的类型

a1.channels.c1.type = memory

# channel的容量的阈值,这里表示1000个event

a1.channels.c1.capacity = 1000

# channel传输时收集到了100条event以后再去提交事务

a1.channels.c1.transactionCapacity = 100

# Bind the source and sink to the channel

# 绑定channel

# sources绑定的channel可以有多个

# sink绑定的channel只能有一个,但是channel可以被多个sink绑定

a1.sources.r1.channels = c1

a1.sinks.k1.channel = c1

运行flume监听端口,运行完成之后,相当于使用nc启动了一个服务端。

# 启动agent

# --conf conf/ 表示配置文件存储在conf/目录

# --name a1 表示给agent起名为a1

# --conf-file job/netcat-flume-logger.conf 表示本次启动读取的配置文件是在job文件夹下的netcat-flume-logger.conf文件

# -Dflume.root.logger==INFO,console 其中-D表示flume运行时动态修改flume.root.logger参数属性值,并将日志打印到控制台,级别设置为INFO级别

# 日志级别包括:log、info、warn、error

bin/flume-ng agent --conf conf/ --name a1 --conf-file job/netcat-flume-logger.conf -Dflume.root.logger=INFO,console

## 相当于

bin/flume-ng agent -c conf/ -n a1 -f job/netcat-flume-logger.conf -Dflume.root.logger=INFO,console

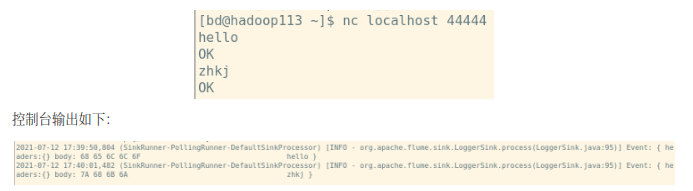

开启nc客户端,并发送hello和zhkj,结果如下:

在关闭时,会先停止接收source数据,然后等待channel中的数据全部处理完成,最后再退出。

1045

1045

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?