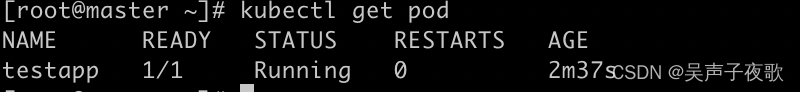

直接命令运行

kubectl run testapp --image=ccr.ccs.tencentyun.com/k8s-tutorial/test-k8s:v1

Pod 报错解决

如果你运行 kubectl describe pod/pod-name 发现 Events 中有下面这个错误

networkPlugin cni failed to set up pod "test-k8s-68bb74d654-mc6b9_default" network: open /run/flannel/subnet.env: no such file or directory

在每个节点创建文件/run/flannel/subnet.env写入以下内容,配置后等待一会就好了

FLANNEL_NETWORK=10.244.0.0/16

FLANNEL_SUBNET=10.244.0.1/24

FLANNEL_MTU=1450

FLANNEL_IPMASQ=true

部署应用YAML文件

路径/usr/local/k8s/test

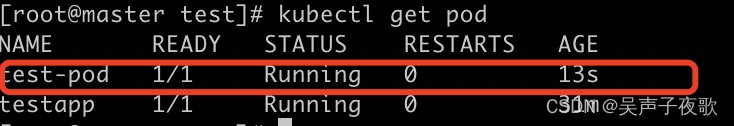

1. 单独运行pod

pod

apiVersion: v1

kind: Pod

metadata:

name: test-pod

spec:

# 定义容器,可以多个

containers:

- name: test-k8s # 容器名字

image: ccr.ccs.tencentyun.com/k8s-tutorial/test-k8s:v1 # 镜像

运行pod

kubectl apply -f ./pod.yaml

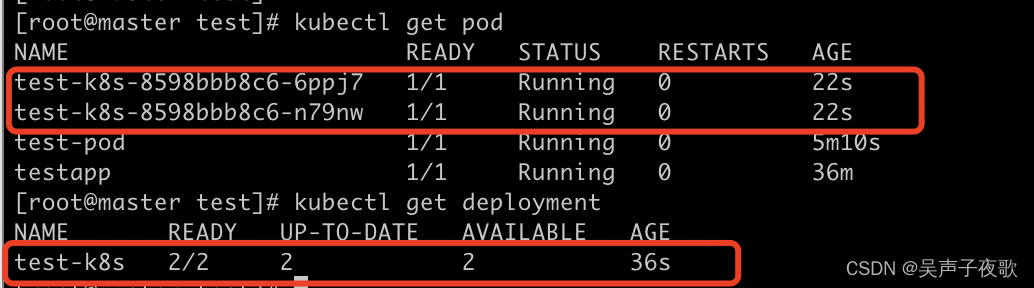

2. 使用Deployment管理pod

Deployment

apiVersion: apps/v1

kind: Deployment

metadata:

# 部署名字

name: test-k8s

spec:

replicas: 2

# 用来查找关联的 Pod,所有标签都匹配才行

selector:

matchLabels:

app: test-k8s

# 定义 Pod 相关数据

template:

metadata:

labels:

app: test-k8s

spec:

# 定义容器,可以多个

containers:

- name: test-k8s # 容器名字

image: ccr.ccs.tencentyun.com/k8s-tutorial/test-k8s:v1 # 镜像

运行deployment

kubectl apply -f ./app.yaml

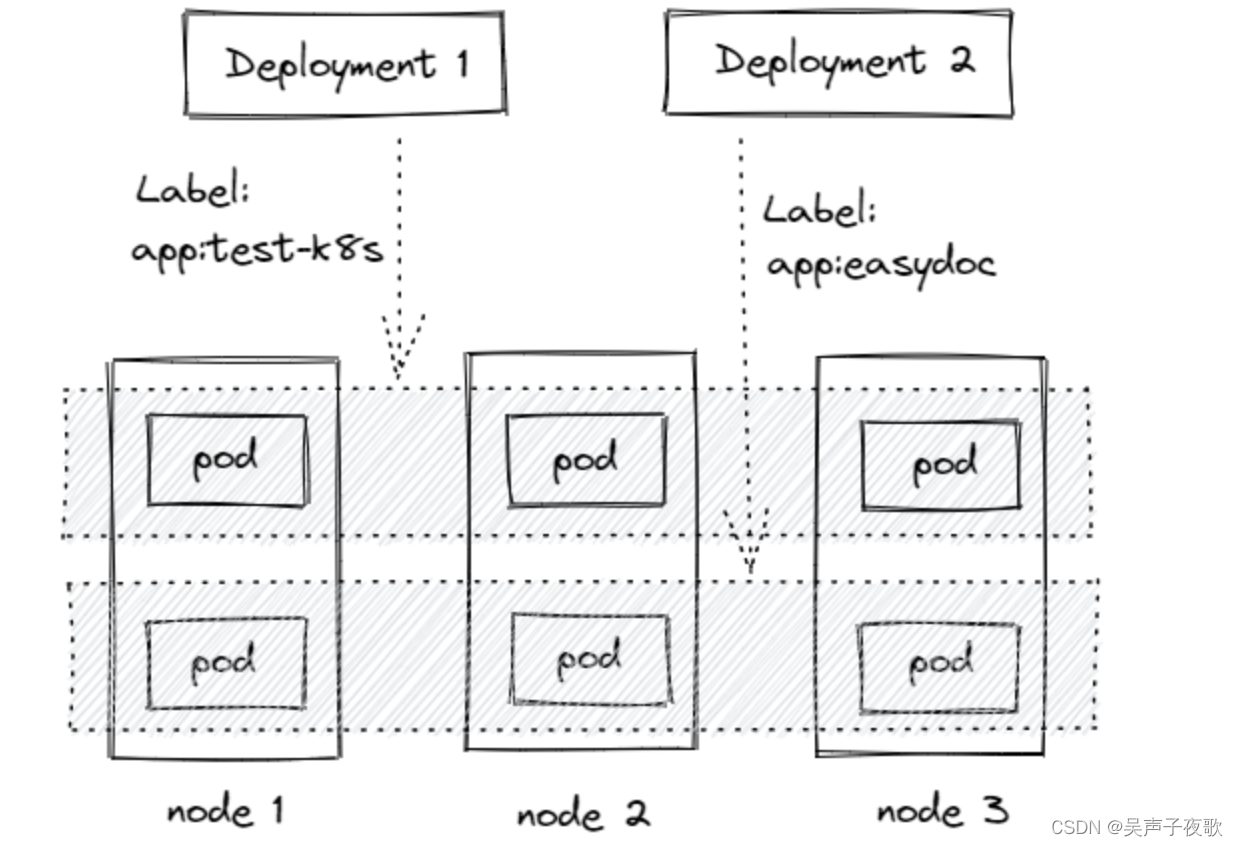

Deployment 通过 label 关联起来 Pods

应用源码及dockerfile

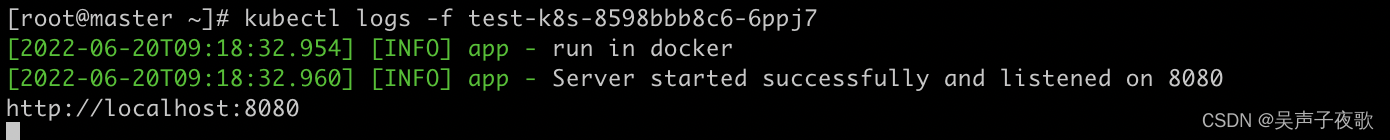

应用源码,nodejs服务,监听8080端口。

let Koa = require('koa');

let app = new Koa();

let Router = require('koa-router');

const koaBody = require('koa-body');

let router = new Router;

app.use(koaBody({multipart: true}));

let log4js = require('log4js');

log4js.configure('./log4js.json');

log4js.level = 'DEBUG';

let logger = log4js.getLogger('app');

// 获取服务器 ip、hostname

function getServerInfo() {

let os = require("os");

let ifaces = os.networkInterfaces();

let adresses = Object.keys(ifaces).reduce(function (result, dev) {

return result.concat(ifaces[dev].reduce(function (result, details) {

return result.concat(details.family === 'IPv4' && !details.internal ? [details.address] : []);

}, []));

});

return `IP ${adresses}, hostname: ${os.hostname()}`

}

router.all('/', async ctx =>{

logger.info('on index page')

ctx.body = `index page \n\n${getServerInfo()}\n`

});

router.all('/hello/:name', async ctx =>{

let name = ctx.params.name

logger.info('on hello page')

ctx.body = `hello ${name ? name : 'world'} \n\n${getServerInfo()}\n`

});

// let isDocker = false;

// try{

// const fs = require('fs')

// // 判断是否在 Docker 里面运行

// fs.accessSync('/.dockerenv');

// isDocker = true;

// logger.info('run in docker')

// }

// catch (e) {

// isDocker = false

// logger.info('not in docker')

// }

//

// let url = `mongodb://localhost:27017`;

// if(isDocker)

// {

// url = 'mongodb://mongodb-0.mongodb:27017'

// // url = `mongodb://${process.env.MONGO_USERNAME}:${process.env.MONGO_PASSWORD}@${process.env.MONGO_ADDRESS}`

// }

//

// const MongoDB = require('mongodb')

// const mongoClient = new MongoDB.MongoClient(url);

// mongoClient.connect((err) =>{

// if(!err)

// {

// logger.info(`MongoDB Connected successfully`);

// app.context.db = mongoClient.db("testdb");

// }

// else {

// logger.error('connect mongo failed:%s', err)

// }

// });

//

//

// router.all('/regist', async ctx =>{

// let username = ctx.request.body.username

// let password = ctx.request.body.password

// if(!username || !password){

// ctx.body = {code: -1, msg: '参数不全'}

// return

// }

// try{

// await ctx.db.collection("users").updateOne({_id: username}, {'$set': {password: password}}, {upsert: true})

// ctx.body = {code: 0, msg: 'success'}

// }

// catch (e) {

// ctx.body = {code: -10, msg: `注册失败 ${e}`}

// }

// });

//

// router.all('/login', async ctx =>{

// let username = ctx.request.body.username

// let password = ctx.request.body.password

// if(!username || !password){

// ctx.body = {code: -1, msg: '参数不全'}

// return

// }

// try{

// let user = await ctx.db.collection("users").findOne({_id: username, password})

// if(user)

// ctx.body = user

// else

// ctx.body = {code: -10, msg: '登录失败'}

// }

// catch (e) {

// ctx.body = {code: -20, msg: `登录失败 ${e}`}

// }

// });

app.use(router.routes());

let port = process.env.PORT || 8080;

try{

app.listen(port);

logger.info('Server started successfully and listened on '+ port +'\n'+'http://localhost:'+port);

}catch(err){

console.error(err);

}

dockerfile

FROM node:11

MAINTAINER easydoc.net

# 复制代码

ADD . /app

# 设置容器启动后的默认运行目录

WORKDIR /app

# 运行命令,安装依赖

# RUN 命令可以有多个,但是可以用 && 连接多个命令来减少层级。

# 例如 RUN npm install && cd /app && mkdir logs

RUN npm install --registry=https://registry.npm.taobao.org

# CMD 指令只能一个,是容器启动后执行的命令,算是程序的入口。

# 如果还需要运行其他命令可以用 && 连接,也可以写成一个shell脚本去执行。

# 例如 CMD cd /app && ./start.sh

CMD node app.js

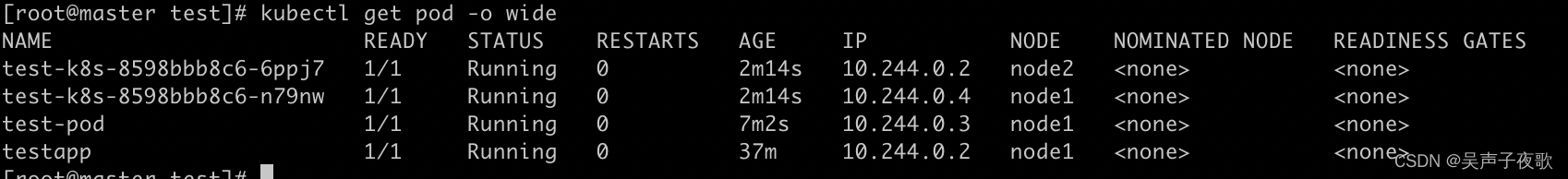

kubectl命令

# 部署应用

kubectl apply -f app.yaml

# 查看 deployment

kubectl get deployment

# 查看 pod

kubectl get pod -o wide

# 把集群内端口映射到节点

kubectl port-forward pod-name 8090:8080

# 查看历史

kubectl rollout history deployment test-k8s

# 回到上个版本

kubectl rollout undo deployment test-k8s

# 回到指定版本

kubectl rollout undo deployment test-k8s --to-revision=2

# 删除部署

kubectl delete deployment test-k8s

# 查看全部

kubectl get all

# 重新部署

kubectl rollout restart deployment test-k8s

# 命令修改镜像,--record 表示把这个命令记录到操作历史中

kubectl set image deployment test-k8s test-k8s=ccr.ccs.tencentyun.com/k8s-tutorial/test-k8s:v2-with-error --record

# 暂停运行,暂停后,对 deployment 的修改不会立刻生效,恢复后才应用设置

kubectl rollout pause deployment test-k8s

# 恢复

kubectl rollout resume deployment test-k8s

# 输出到文件

kubectl get deployment test-k8s -o yaml >> app2.yaml

# 删除全部资源

kubectl delete all --all

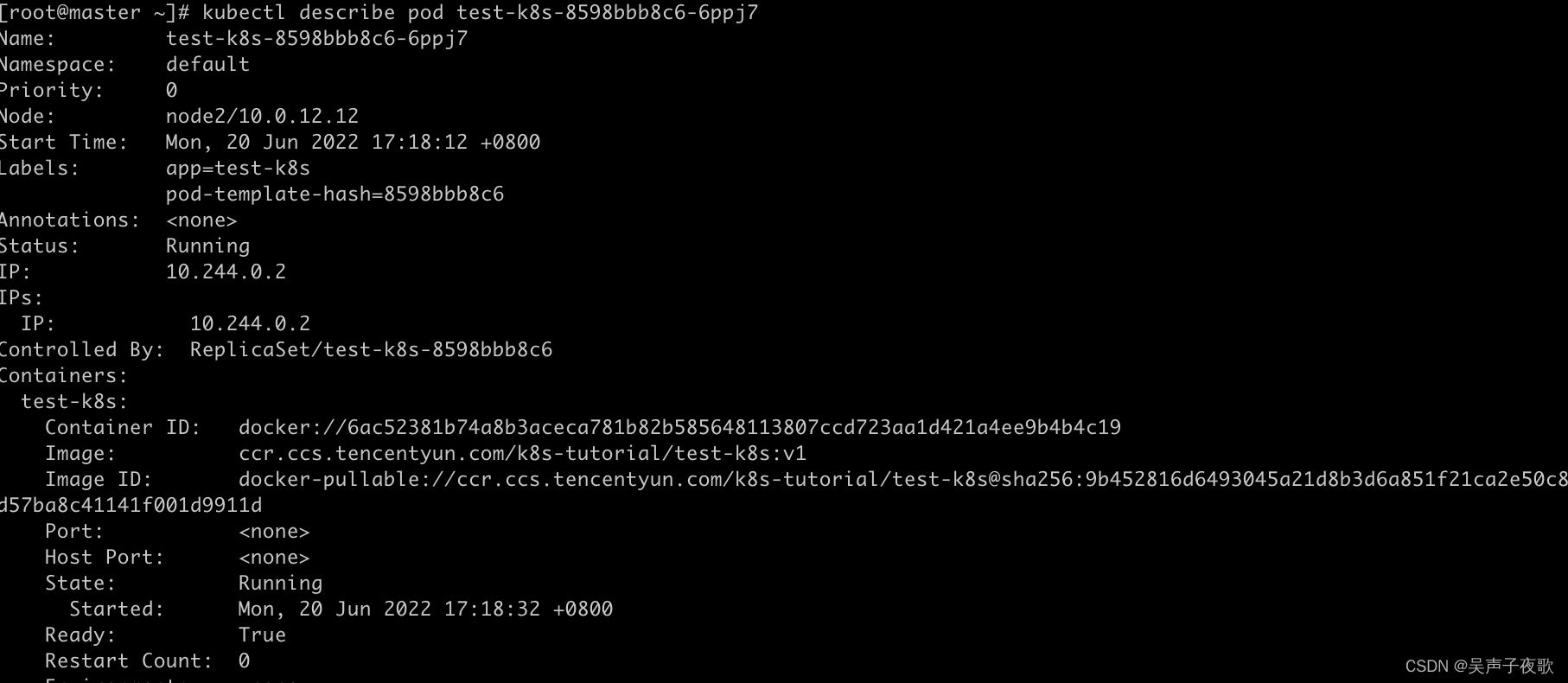

查看 pod 详情:

kubectl describe pod pod-name

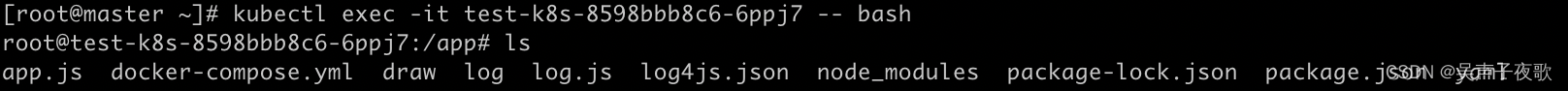

进入 Pod 容器终端, -c container-name 可以指定进入哪个容器

kubectl exec -it pod-name -- bash

查看 log

kubectl logs -f pod-name

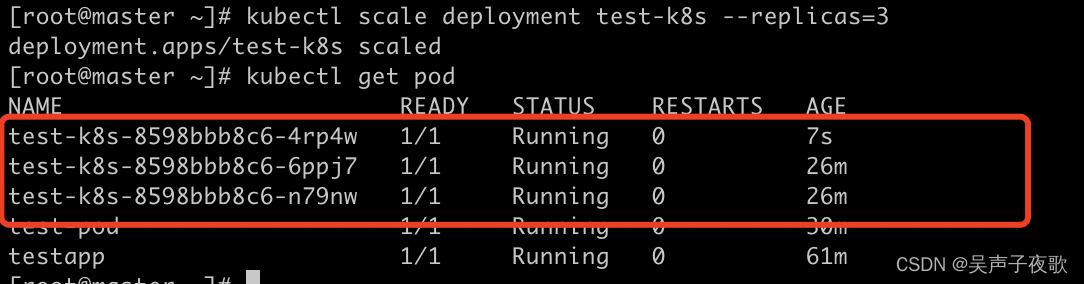

伸缩扩展副本

kubectl scale deployment test-k8s --replicas=3

将 Pod 指定到某个节点运行:nodeselector

限定 CPU、内存总量

apiVersion: v1

kind: Pod

metadata:

name: nginx

labels:

env: test

spec:

containers:

- name: nginx

image: nginx

imagePullPolicy: IfNotPresent

nodeSelector:

disktype: ssd #有ssd的节点

工作负载分类

- Deployment

适合无状态应用,所有pod等价,可替代 - StatefulSet

有状态的应用,适合数据库这种类型。 - DaemonSet

在每个节点上跑一个 Pod,可以用来做节点监控、节点日志收集等 - Job & CronJob

Job 用来表达的是一次性的任务,而 CronJob 会根据其时间规划反复运行。

现存问题

- 每次只能访问一个 pod,没有负载均衡自动转发到不同 pod

- 访问还需要端口转发

- Pod 重创后 IP 变了,名字也变了

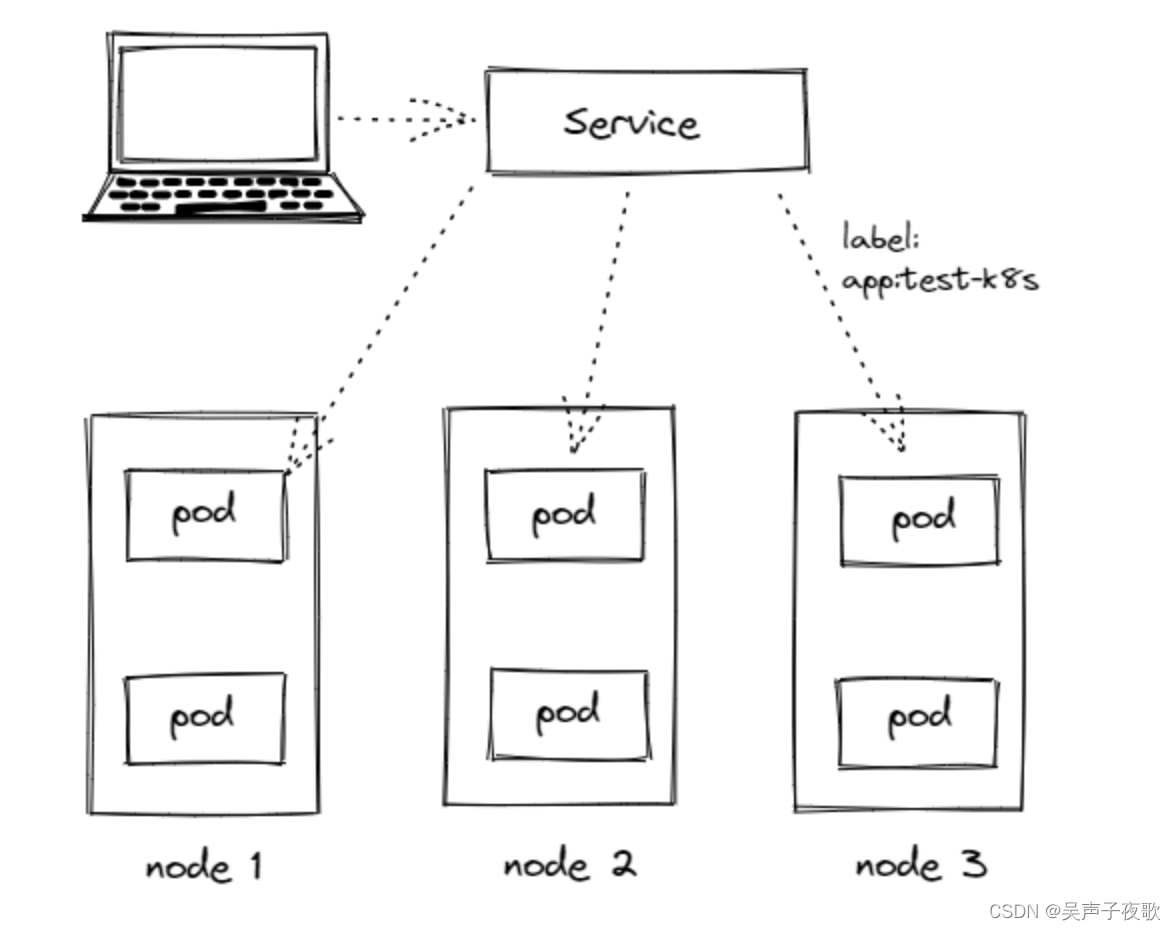

Service

- Service 通过 label 关联对应的 Pod

- Servcie 生命周期不跟 Pod 绑定,不会因为 Pod 重创改变 IP

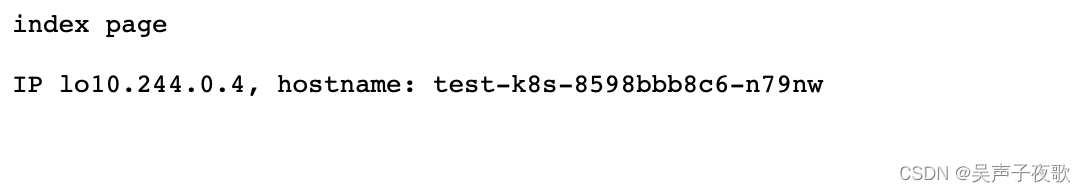

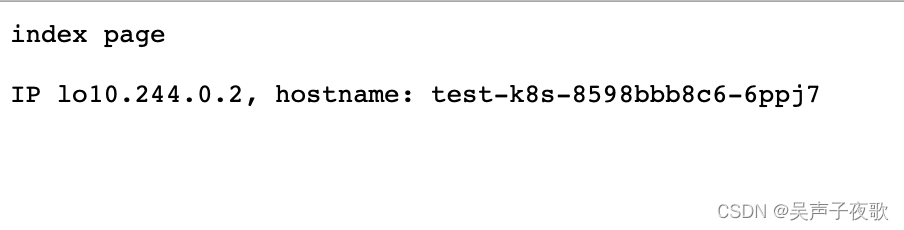

- 提供了负载均衡功能,自动转发流量到不同 Pod

- 可对集群外部提供访问端口

- 集群内部可通过服务名字访问

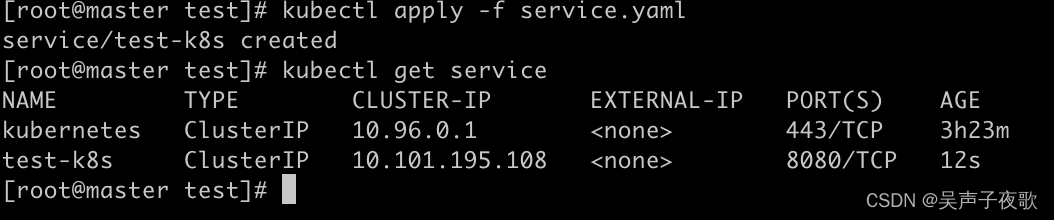

创建Service

创建 一个 Service,通过标签test-k8s跟对应的 Pod 关联上

service.yaml

apiVersion: v1

kind: Service

metadata:

name: test-k8s

spec:

selector:

app: test-k8s

type: ClusterIP

ports:

- port: 8080 # 本 Service 的端口

targetPort: 8080 # 容器端口

应用配置 kubectl apply -f service.yaml

查看服务 kubectl get svc

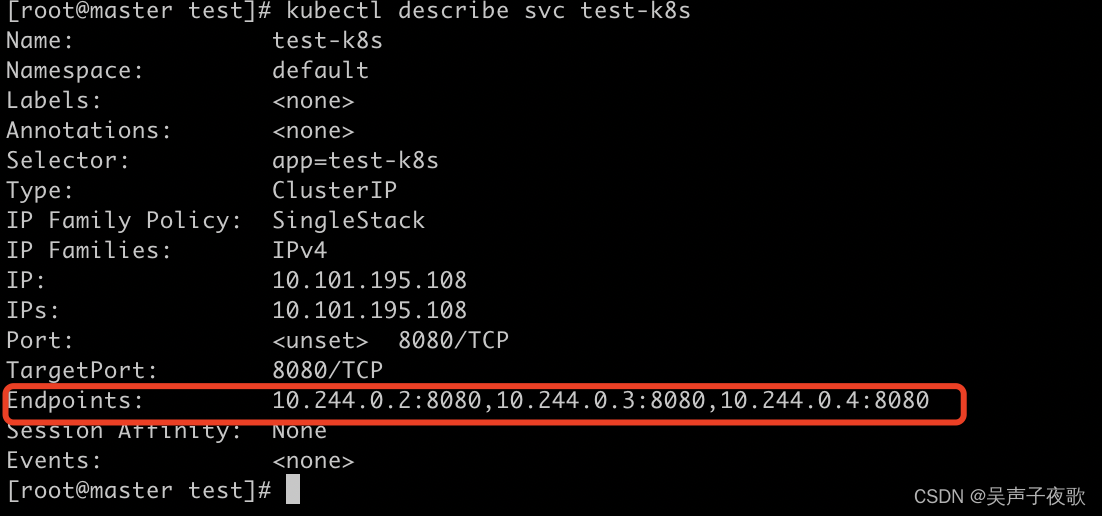

查看服务详情 kubectl describe svc test-k8s,可以发现 Endpoints 是各个 Pod 的 IP,也就是他会把流量转发到这些节点。

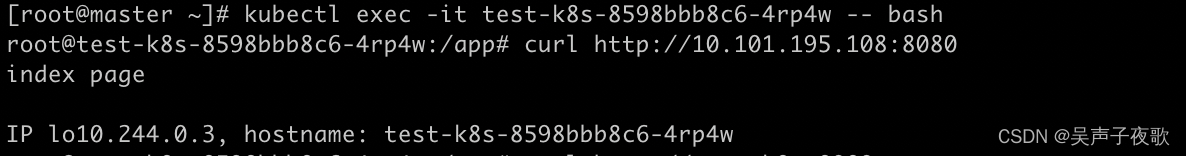

服务的默认类型是ClusterIP,只能在集群内部访问,我们可以进入到 Pod 里面访问

kubectl exec -it pod-name -- bash

curl http://test-k8s:8080

如果要在集群外部访问,可以通过端口转发实现(只适合临时测试用)

kubectl port-forward --address 0.0.0.0 service/test-k8s 8090:8080

如果你用 minikube,也可以这样minikube service test-k8s

http://10.101.195.108:8080

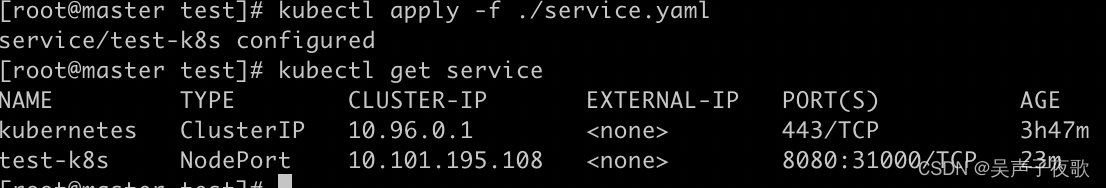

对外暴露服务

上面我们是通过端口转发的方式可以在外面访问到集群里的服务,如果想要直接把集群服务暴露出来,我们可以使用NodePort 和 Loadbalancer 类型的 Service

apiVersion: v1

kind: Service

metadata:

name: test-k8s

spec:

selector:

app: test-k8s

# 默认 ClusterIP 集群内可访问,NodePort 节点可访问,LoadBalancer 负载均衡模式(需要负载均衡器才可用)

type: NodePort

ports:

- port: 8080 # 本 Service 的端口

targetPort: 8080 # 容器端口

nodePort: 31000 # 节点端口,范围固定 30000 ~ 32767

应用配置 kubectl apply -f service.yaml

在节点上,我们可以 curl http://节点公网ip:31000/hello/easydoc 访问到应用

注意:如果你是用 minikube,因为是模拟集群,你的电脑并不是节点,节点是 minikube 模拟出来的,所以你并不能直接在电脑上访问到服务

Loadbalancer 也可以对外提供服务,这需要一个负载均衡器的支持,因为它需要生成一个新的 IP 对外服务,否则状态就一直是 pendding,这个很少用了,后面我们会讲更高端的 Ingress 来代替它。

多端口

多端口时必须配置 name

apiVersion: v1

kind: Service

metadata:

name: test-k8s

spec:

selector:

app: test-k8s

type: NodePort

ports:

- port: 8080 # 本 Service 的端口

name: test-k8s # 必须配置

targetPort: 8080 # 容器端口

nodePort: 31000 # 节点端口,范围固定 30000 ~ 32767

- port: 8090

name: test-other

targetPort: 8090

nodePort: 32000

总结

-

ClusterIP

默认的,仅在集群内可用 -

NodePort

暴露端口到节点,提供了集群外部访问的入口

端口范围固定 30000 ~ 32767 -

LoadBalancer

需要负载均衡器(通常都需要云服务商提供,裸机可以安装 METALLB 测试)

会额外生成一个 IP 对外服务

K8S 支持的负载均衡器:负载均衡器 -

Headless

适合数据库

clusterIp 设置为 None 就变成 Headless 了,不会再分配 IP,后面会再讲到具体用法

1107

1107

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?