这里只是简单的记录下

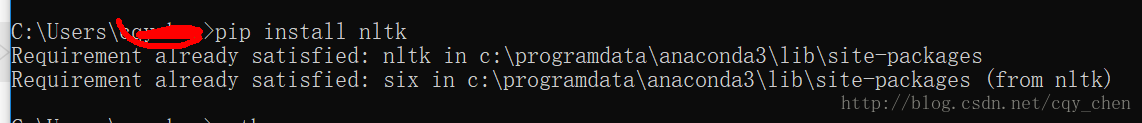

首先直接安装好nltk

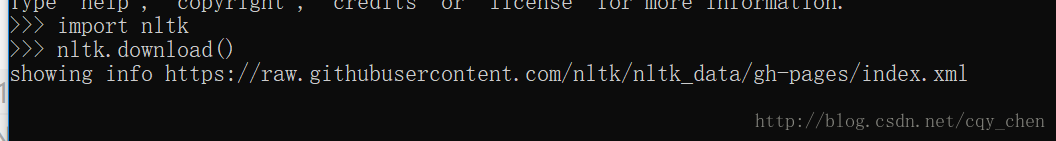

然后进入python

下载语料库

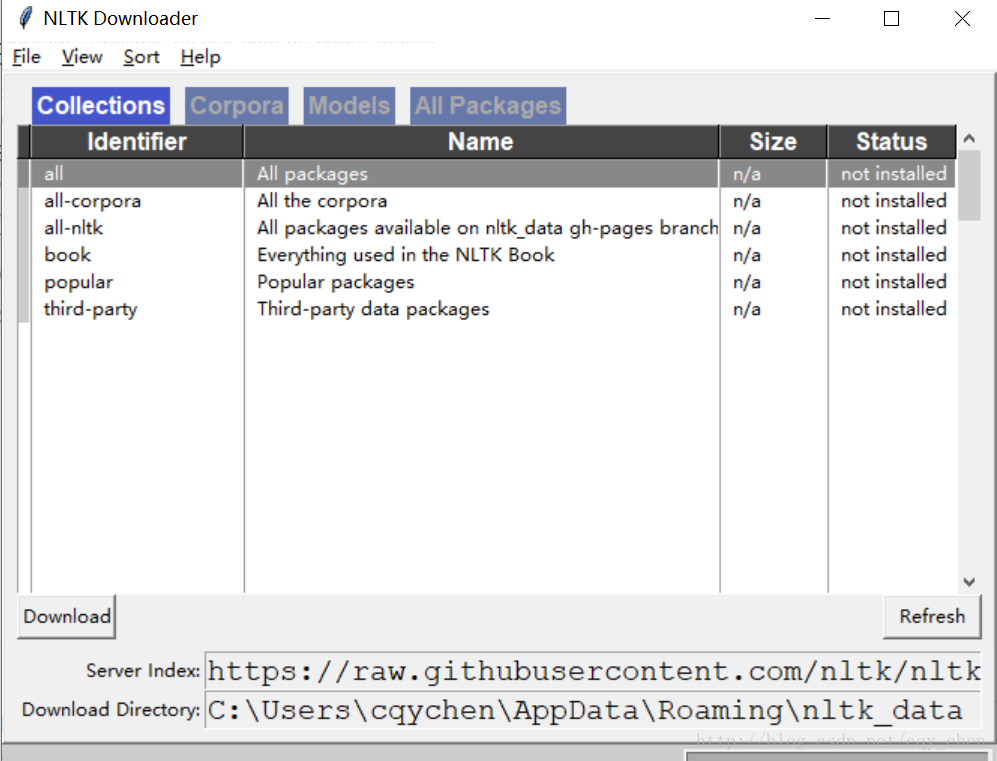

主要分为:

corpora:语料库

book:所用到的一些书籍的资料,作为文档

以及其他的三方库。

这些资料是很大的,最好准备1G的存储空间。

最后注意的是,中文分词,一般采用结巴分词 https://pypi.python.org/pypi/jieba/

或者

https://nlp.stanford.edu/software/segmenter.shtml

采用crf进行计算的分词方法。

中文和英文分词还是不太一样的,而自然语言处理的第一步就是分词喽。

8445

8445

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?