下载

cdh5.3.6 密码:bqgj

【cdh】

链接: https://pan.baidu.com/s/1ASwsAS2eRrV7WpymuQS3-w 密码: bqgj

配置

在虚拟机的 /opt 下创建 cdh5.3.6 文件夹,并将hadoop-2.5.0-cdh5.3.6上传到 /opt/cdh5.3.6 下,然后进入 /hadoop-2.5.0-cdh5.3.6/etc/hadoop下,更改配置。

安装Hadoop 之前需要JDK环境,如何安装,查看 Linux虚拟机安装JDK

下面的 wqq 是虚拟机的hostname,如何更改hostname,查看 Centos修改主机名hostname

1.hanoop-env.sh

//更新前:

# The java implementation to use.

export JAVA_HOME=${JAVA_HOME}

//更新后:

export JAVA_HOME=/opt/module/jdk1.8.0_144

2.core-site.xml

//更新前

<configuration>

</configuration>

//更新后

<configuration>

<property>

<name>fs.defaultFS</name>

<value>hdfs://wqq:9000</value>

</property>

<property>

<name>hadoop.tmp.dir</name>

<value>/opt/cdh-3.5.6/hadoop-2.5.0-cdh5.3.6/data/tmp</value>

</property>

</configuration>

并创建 /opt/cdh5.3.6/hadoop-2.5.0-cdh5.3.6/data/tmp 目录

3.hdfs-site.sh

//更新前

<configuration>

</configuration>

//更新后

<configuration>

<property>

<name>dfs.namenode.secondary.http-address</name>

<value>wqq:50090</value>

</property>

<property>

<name>dfs.namenode.http-address</name>

<value>wqq:50070</value>

</property>

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

<property>

<name>dfs.premissions</name>

<value>false</value>

</property>

</configuration>

4.mapred-env.sh

//更新前

# export JAVA_HOME=/home/y/libexec/jdk1.6.0/

//更新后

export JAVA_HOME=/opt/module/jdk1.8.0_144

5.mapred-site.xml.template

将template去除

//更新前

<configuration>

</configuration>

//更新后

<configuration>

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

<property>

<name>mapreduce.jobhistory.address</name>

<value>wqq:10020</value>

</property>

<property>

<name>mapreduce.jobhistory.webapp.address</name>

<value>wqq:19888</value>

</property>

</configuration>

6.yarn-env.sh

//更新前

# some Java parameters

# export JAVA_HOME=/home/y/libexec/jdk1.6.0/

//更新后

export JAVA_HOME=/opt/module/jdk1.8.0_144

7.slaves

//更新前

localhost

//更新后

wqq

配置文件完成之后,进入 /opt/cdh5.3.6/hadoop-2.5.0-cdh5.3.6,先格式化文件系统

bin/hdfs namenode -format

然后启动dfs服务:

sbin/start-dfs.sh

启动yarn服务:

sbin/start-yarn.sh

启动jobserver服务:

sbin/mr-jobhistory-daemon.sh start history-server

如果出现以下错误:

Error: Could not find or load main class org.apache.hadoop.mapred.JobClient

如果Hadoop是直接解压,此问题应该很少遇到。经过排查发现,在 /opt/cdh5.3.6/hadoop-2.5.0-cdh5.3.6/share/hadoop 下少了mapreduce 文件夹,补上即可。

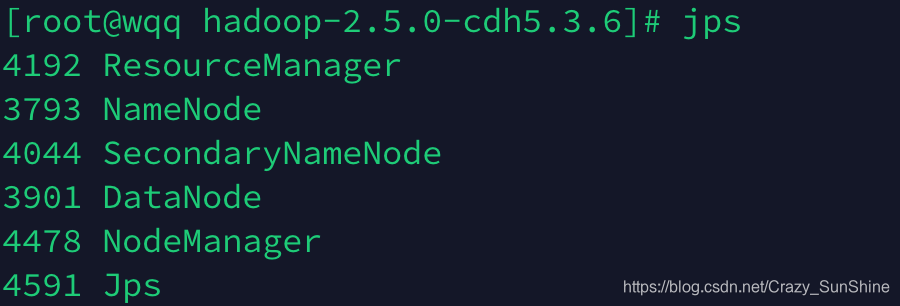

查看已启动的服务:

jps

服务已启动,好想访问 hdfs文件系统,然后在Mac上输入地址ip:8088 、 ip:50070 、ip:50090 (无论是ip或者是hostname),都访问不了???

在另一篇有详细解决方法:

本机无法访问虚拟机hdfs文件系统

=================================================================

个人博客

Github

个人公众号:Flutter小同学

个人网站

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?