1.安装前提

1.1安装企业7以上环境

请参照我之前的博客,与安装7.3的步骤完全相同。

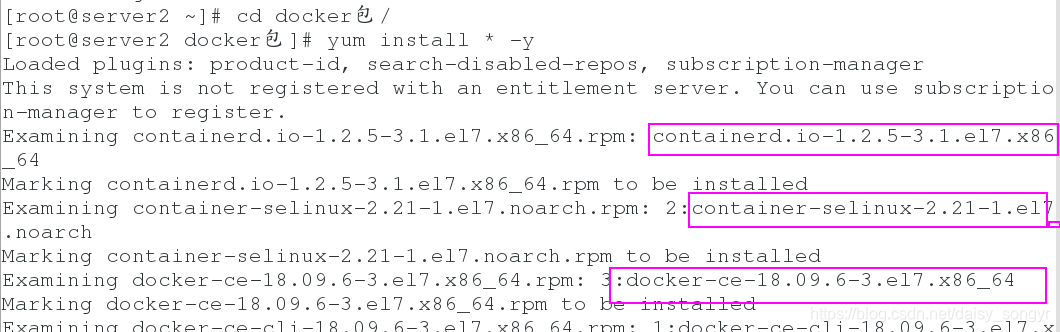

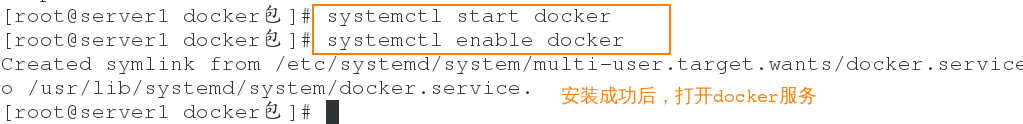

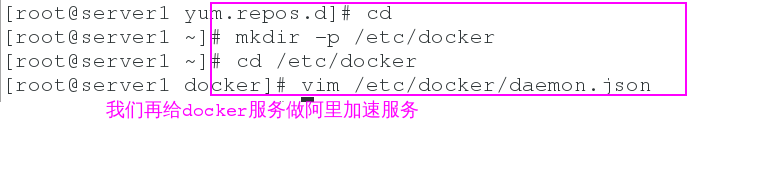

1.2安装docker应用环境

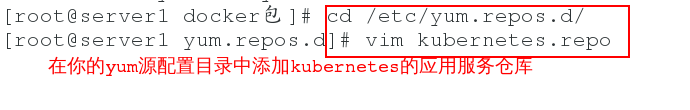

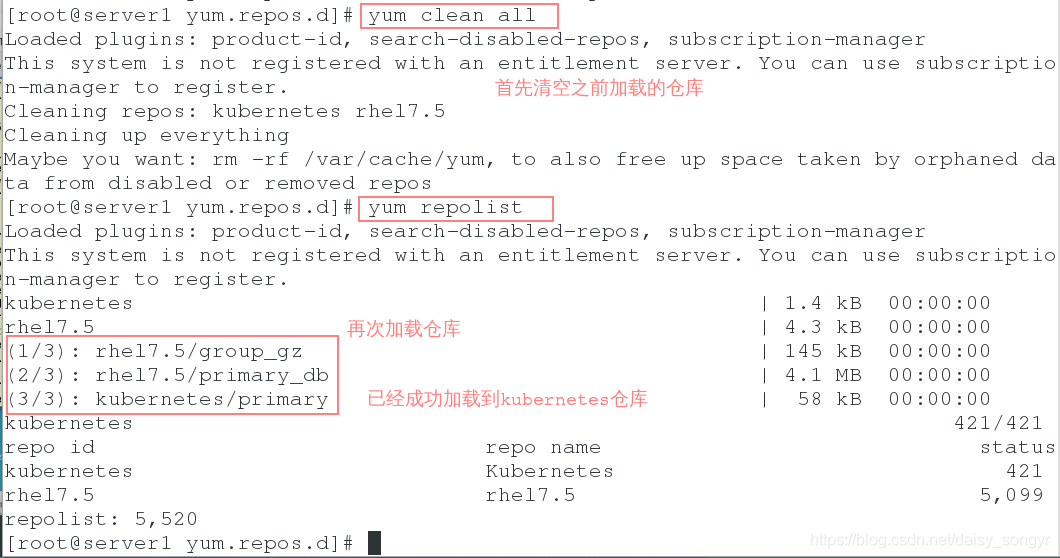

1.3 配置k8s的yum库源

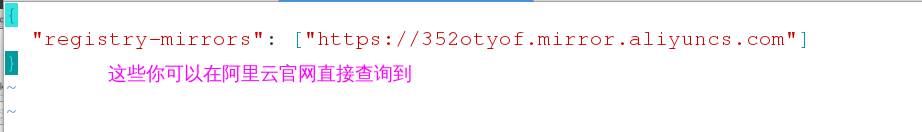

1.4 docker加速

1.5 导出各版本镜像列表

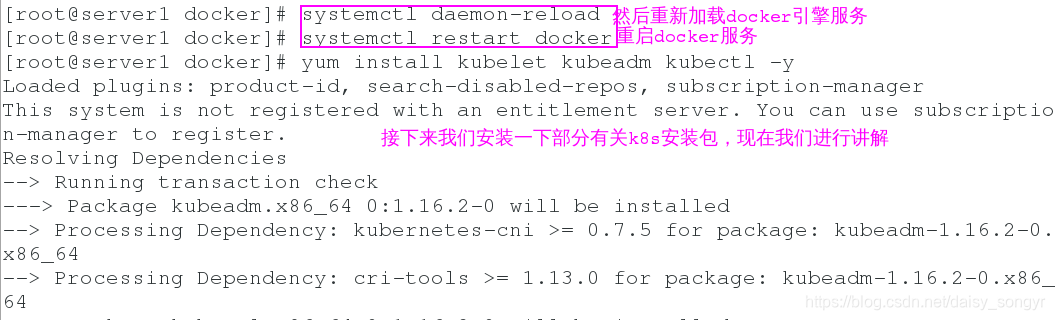

kubelet是Node的agent,当Scheduler确定在某个Node上运行Pod后,会将Pod的具体配置信息(image、volume等)发送给该节点的kubelet,kubelet根据这些信息创建和运行容器,并向Master报告运行状态。

# kubelet:运行在cluster所有节点上,负责启动pod和容器

# kubeadm:用于初始化cluster

# kubectl:是kubernetes命令行工具,通过kubectk可以部署和管理应用,查看各种资源,创建,删除和更新各种组件配置阿里云网络yum源头(三台虚拟机都做)

k8s.gcr.io/kube-apiserver:v1.16.2

# API Server提供HTTP/HTTPS RESTful API,即Kubernetes API。API Server是Kubernetes Cluster的前端接口,各种客户端工具(CLI或UI)以及Kubernetes其他组件可以通过它管理Cluster的各种资源

k8s.gcr.io/kube-controller-manager:v1.16.2

# Controller Manager负责管理Cluster各种资源,保证资源处于预期的状态

k8s.gcr.io/kube-scheduler:v1.16.2

# Scheduler负责决定将Pod放在哪个Node上运行。Scheduler在调度时会充分考虑Cluster的拓扑结构,当前各个节点的负载,以及应用对高可用、性能、数据亲和性的需求

k8s.gcr.io/kube-proxy:v1.16.2

k8s.gcr.io/pause:3.1

# service在逻辑上代表了后端的多个Pod,外界通过service访问Pod。service接收到的请求是如何转发到Pod的呢?这就是kube-proxy要完成的工作

k8s.gcr.io/etcd:3.3.15-0

k8s.gcr.io/coredns:1.6.2

# etcd负责保存Kubernetes Cluster的配置信息和各种资源的状态信息。当数据发生变化时,etcd会快速地通知Kubernetes相关组件

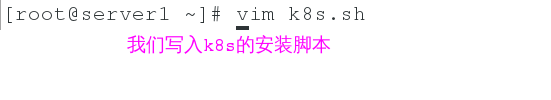

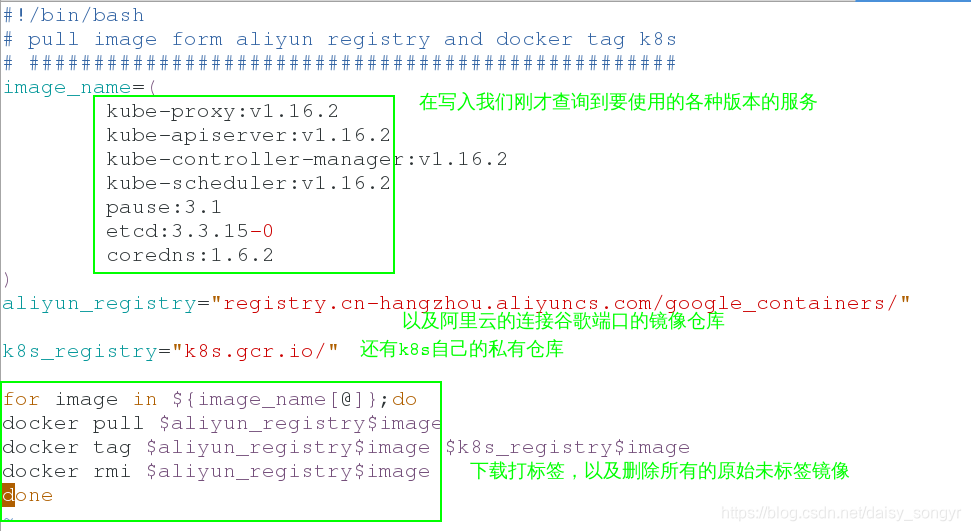

1.6 编写下载镜像的脚本

下载镜像的脚本

下载完成后删除不必要的标签

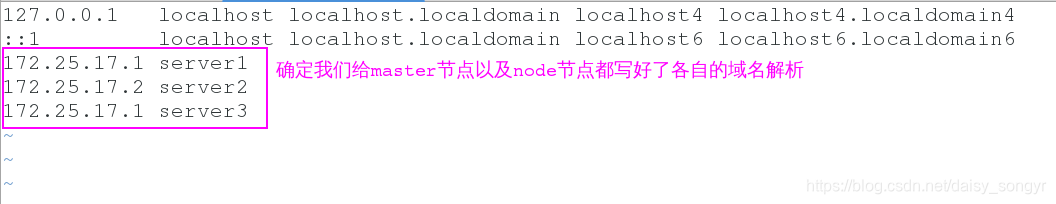

1.6确定域名解析

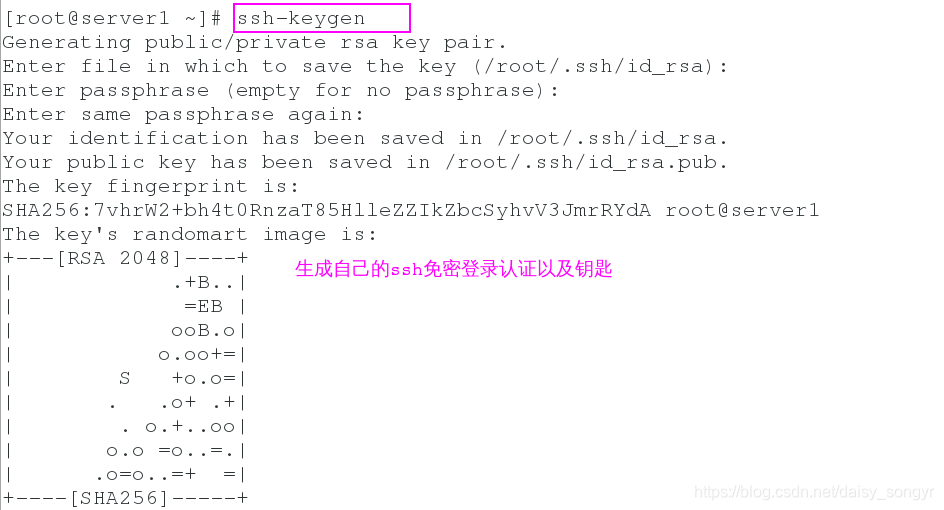

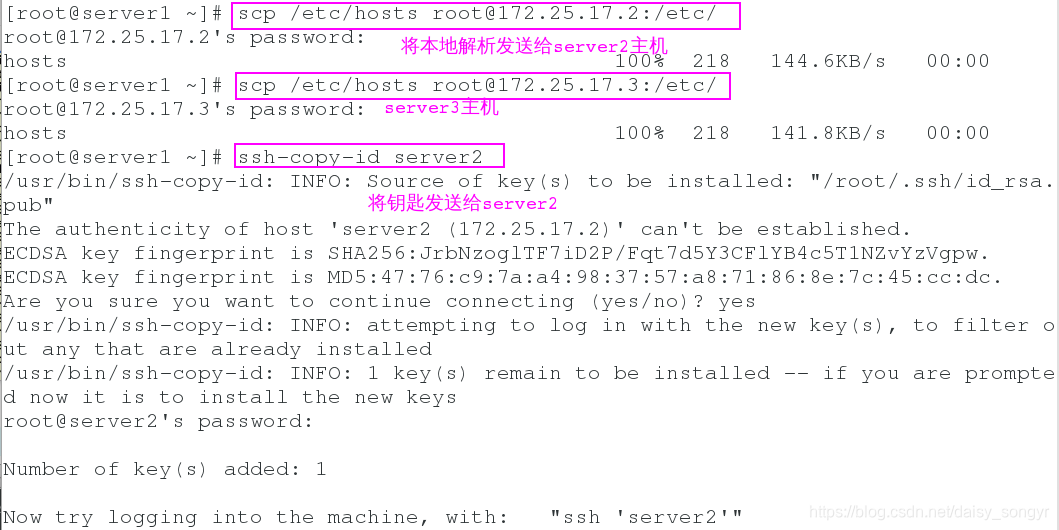

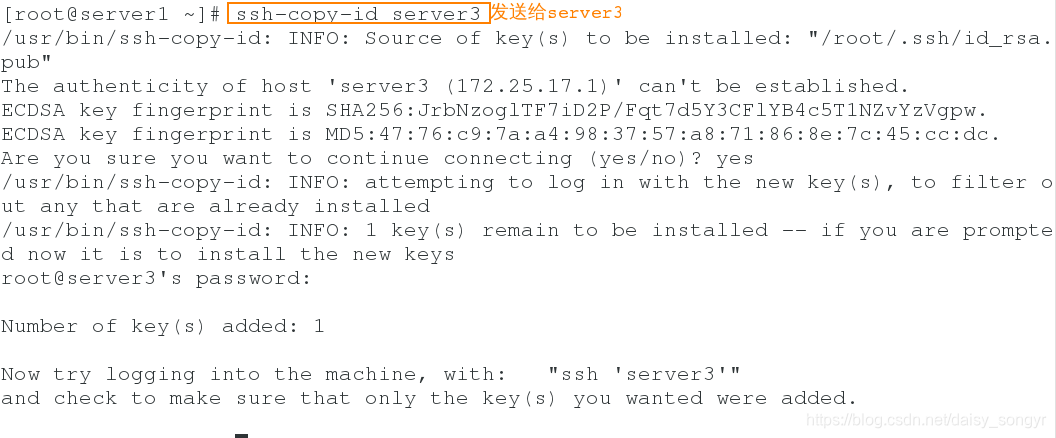

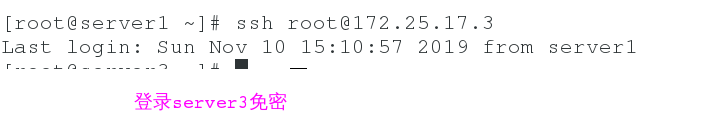

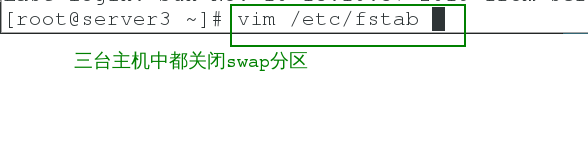

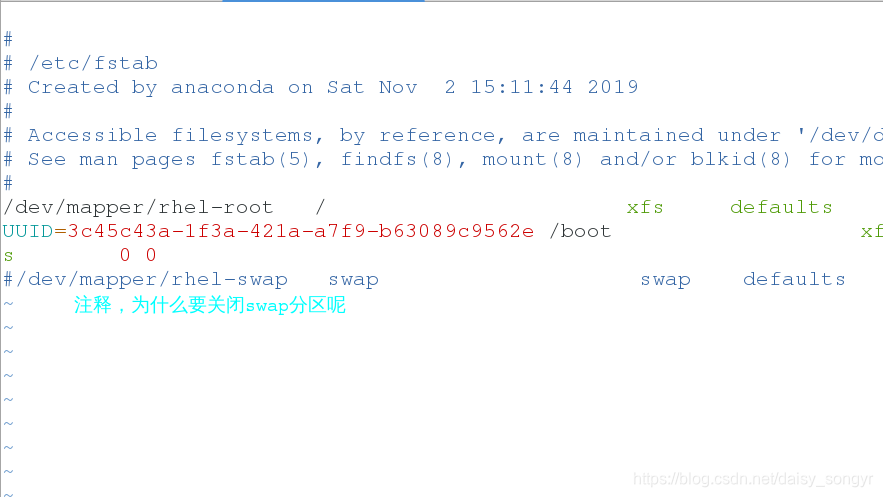

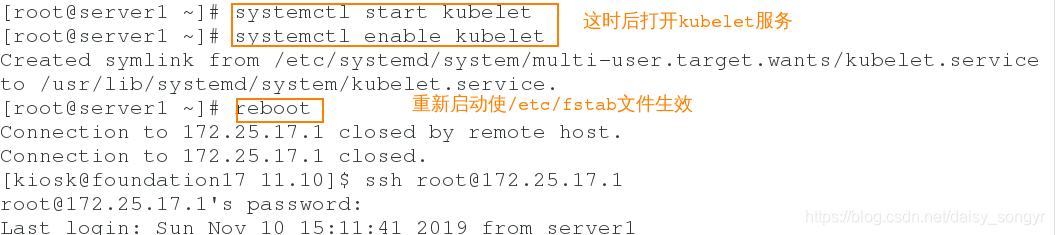

1.7 配置免秘和关闭swap分区

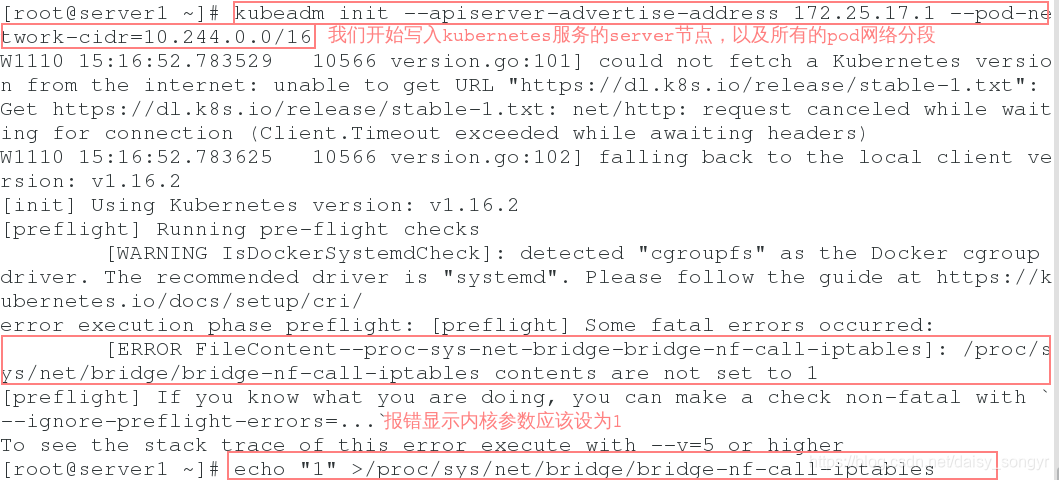

1.8 kubeadm创建cluster

# --apiserver-advertise-address:指明用master的哪个intserface与cluster的其他节点通信(如果master有多个intserface,建议明确指定,如果不指定,kubeadm会自动选择有默认网关的interface)

# --pod-network-cidr= 指定pos网络的范围(lubernetes支持多种网络方案,而且不同的网络方案对--pod-network-cidr 有自己的要求,这里设定为 10.244.0.0/16 是因为我们将使用flannel网络方案,必须设置成这个CIDR)

1.9 配置kubectl

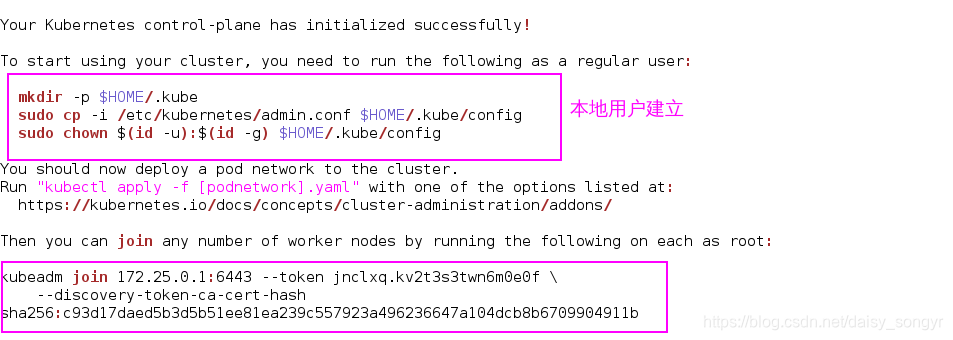

根据执行结果向下做

最后结果提示如何配置kubectl,提示如何安装pod网络,提示如何注册其他节点到cluster。

kubeadm # 执行初始化前的检查

# 生成token和证书

# 生成kubeconfig文件,kubelet需要用这个文件与master通信

# 安装附加组建kube-proxy 和kube-dns

# kubernetes master初始化成功

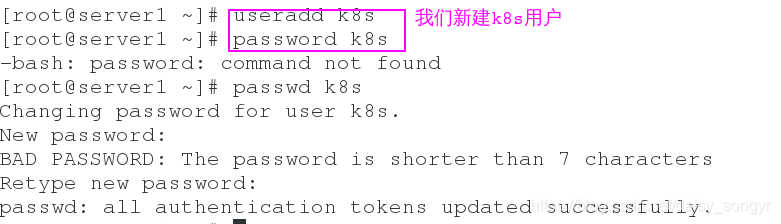

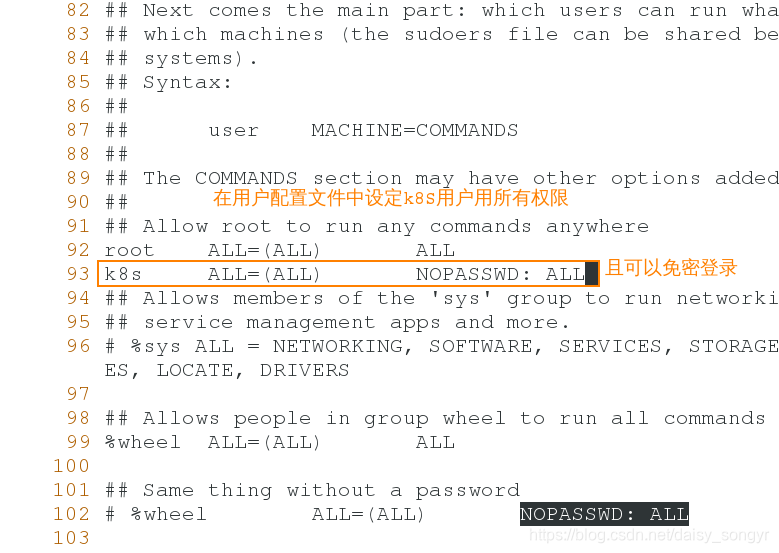

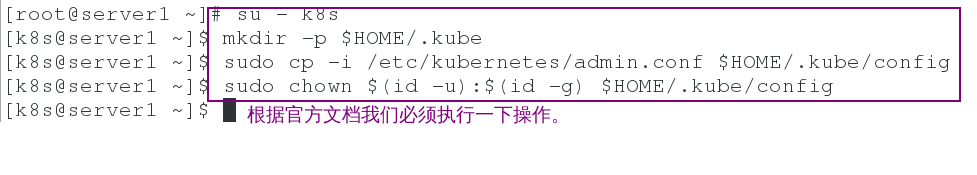

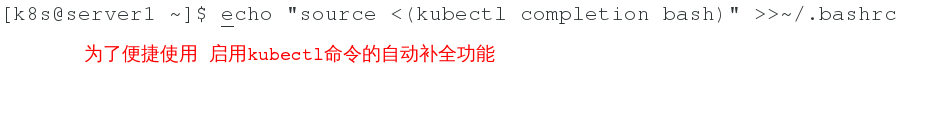

# 根据提示执行命令 推荐linux的普通用户执行(因为root执行会有一些问题)

在你用户家目录下,你应该建立一个kube目录,在目录中写下config文件是复制admin.conf文件,

给这个文件本用户的可执行的权限

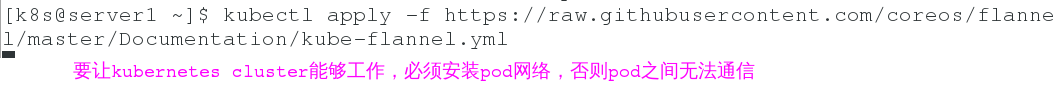

1.9 安装pod网络

要让kubernetes cluster能够工作,必须安装pod网络,否则pod之间无法通信

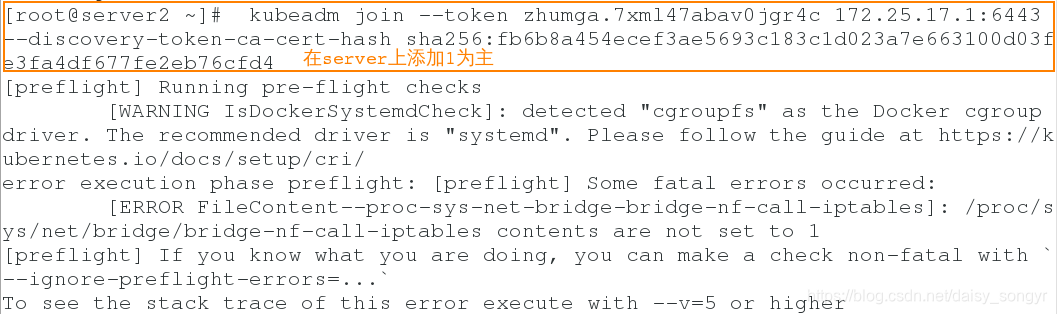

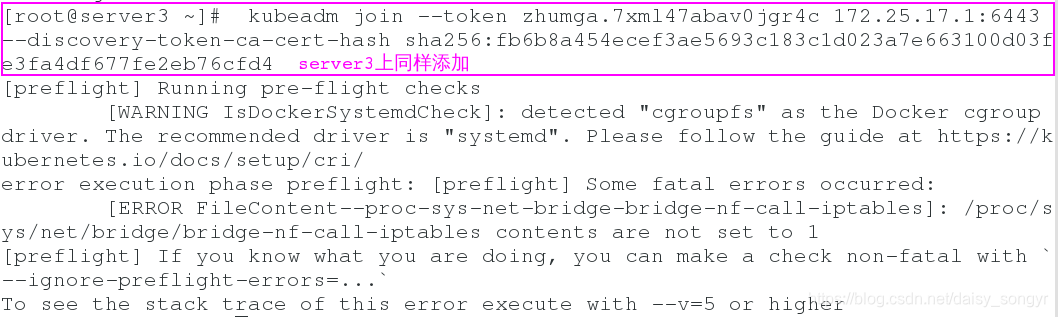

1.10 添加node节点

# 后面的认证信息在master初始化的时候可以获得

1.11等待下载成功

# Pending、ContainerCreating、ImagePullBackOff都表明Pod没有就绪,Running才是就绪状态。我们可以通过kubectl describe pod <Pod Name>查看Pod的具体情况

# 可以看到在下载image时失败,如果网络质量不好,这种情况是很常见的。我们可以耐心等待,因为Kubernetes会重试 我们也可以自己手动执行docker pull去下载这个镜像

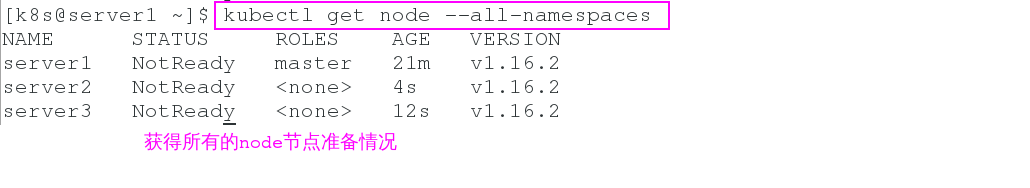

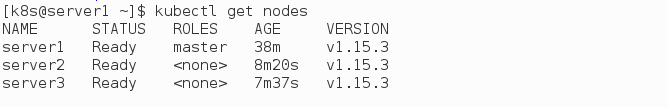

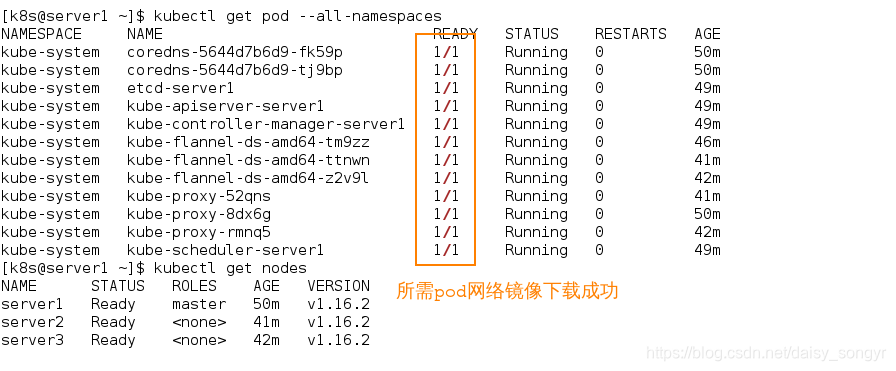

这时三个节点都没有准备好,直到我们的到了一下所有变为Ready时,就已将准备成功。

我们查看这个pod所需要的所有镜像下载肯定已经成功。

那么我们的问题就出现了,到底怎样区分node和pod呢

Node的职责是运行容器应用。Node由Master管理,Node负责监控并汇报容器的状态,同时根据Master的要求管理容器的生命周期。Node运行在Linux操作系统上,可以是物理机或者是虚拟机

Pod是Kubernetes的最小工作单元。每个Pod包含一个或多个容器。Pod中的容器会作为一个整体被Master调度到一个Node上运行Kubernetes引入Pod主要基于下面两个目的:

1)可管理性。

有些容器天生就是需要紧密联系,一起工作。Pod提供了比容器更高层次的抽象,将它们封装到一个部署单元中。Kubernetes以Pod为最小单位进行调度、扩展、共享资源、管理生命周期

2)通信和资源共享。

Pod中的所有容器使用同一个网络namespace,即相同的IP地址和Port空间。它们可以直接用localhost通信。同样的,这些容器可以共储,Kubernetes挂载volume到Pod,本质上是将volume挂载到Pod中的每一个容器Pods有两种使用方式:

(1)运行单一容器

one-container-per-Pod是Kubernetes最常见的模型,这种情况下,只是将单个容器简单封装成Pod。即便是只有一个容器,Kubernetes管理的也是Pod而不是直接管理容器。

(2)运行多个容器。

问题在于:哪些容器应该放到一个Pod中?

答案是:这些容器联系必须非常紧密,而且需要直接共享资源举个例子这个Pod包含两个容器:一个是File Puller,一个是Web Server

File Puller会定期从外部的Content Manager中拉取最新的文件,将其存放在共享的volume中。Web Server从volume读取文件,响应Consumer的请求这两个容器是紧密协作的,它们一起为Consumer提供最新的数据;同时它们也通过volume共享数据,所以放到一个Pod是合适的再来看一个反例:是否需要将Tomcat和MySQL放到一个Pod中?

Tomcat从MySQL读取数据,它们之间需要协作,但还不至于需要放到一个Pod中一起部署、一起启动、一起停止。同时它们之间是通过JDBC交换数据,并不是直接共享存储,所以放到各自的Pod中更合适

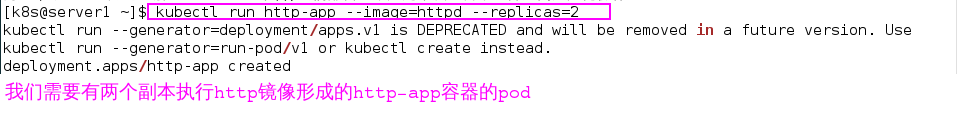

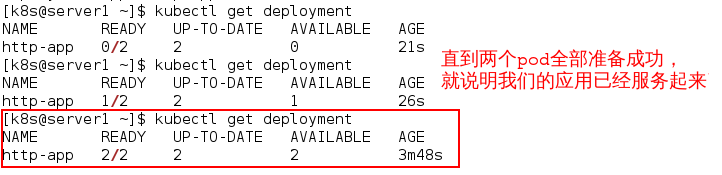

2.搭建一个简单的应用

为了帮助大家更好地理解Kubernetes架构,我们部署一个应用来演示各个组件之间是如何协作的

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?