概述:

- HDFS集群分为两大角色:NameNode、DataNode (Secondary Namenode)

- NameNode负责管理整个文件系统的元数据

- DataNode 负责管理用户的文件数据块

- 文件会按照固定的大小(blocksize)切成若干块后分布式存储在若干台datanode上

- 每一个文件块可以有多个副本,并存放在不同的datanode上

- Datanode会定期向Namenode汇报自身所保存的文件block信息,而namenode则会负责保持文件的副本数量

- HDFS的内部工作机制对客户端保持透明,客户端请求访问HDFS都是通过向namenode申请来进行

1.HDFS写数据流程:

详细步骤:

1、根namenode通信请求上传文件,namenode检查目标文件是否已存在,父目录是否存在;

2、namenode返回是否可以上传;

3、client请求第一个 block该传输到哪些datanode服务器上;

4、namenode返回3个datanode服务器ABC;

5、client请求3台dn中的一台A上传数据(本质上是一个RPC调用,建立pipeline),A收到请求会继续调用B,然后B调用C,将真个pipeline建立完成,逐级返回客户端;

6、client开始往A上传第一个block(先从磁盘读取数据放到一个本地内存缓存),以packet为单位,A收到一个packet就会传给B,B传给C;A每传一个packet会放入一个应答队列等待应答;

7、当一个block传输完成之后,client再次请求namenode上传第二个block的服务器。

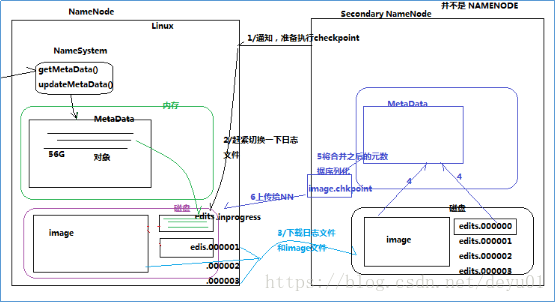

2.namenode工作机制

2.1元数据管理:namenode对数据的管理采用了三种存储形式:

内存元数据(NameSystem)

磁盘元数据镜像文件

数据操作日志文件(可通过日志运算出元数据)

2.2元数据存储机制:

A、内存中有一份完整的元数据(内存meta data)

B、磁盘有一个“准完整”的元数据镜像(fsimage)文件(在namenode的工作目录中)

C、用于衔接内存metadata和持久化元数据镜像fsimage之间的操作日志(edits文件)注:当客户端对hdfs中的文件进行新增或者修改操作,操作记录首先被记入edits日志文件中,当客户端操作成功后,相应的元数据会更新到内存meta.data中

hadoop中元数据的位置和目录结构:在开始自己创建的tmp目录中:

2.3checkpoint:

每隔一段时间,会由secondary namenode将namenode上积累的所有edits和一个最新的fsimage下载到本地,并加载到内存进行merge(这个过程称为checkpoint)

checkpoint的附带作用:

namenode和secondary namenode的工作目录存储结构完全相同,所以,当namenode故障退出需要重新恢复时,可以从secondary namenode的工作目录中将fsimage拷贝到namenode的工作目录,以恢复namenode的元数据

几个关于namenode常见问题:

1、Namenode服务器的磁盘故障导致namenode宕机,如何挽救集群及数据?

两种方式:a.可以将secondary namenode的工作目录拷贝进namenode中,可以最大限度恢复namenode的数据;

b.在配置core-site.xml的

| <!---namenode配置多个目录和datanode配置多个目录,有什么区别?----> <property> <name>dfs.namenode.name.dir</name> <value>/home/hadoop/data/name,/path2/,/path3/,nfs://</value> </property> |

时可以指定多个存储目录用来备份。

c.配置HA高可用 ,冷热切换,一个节点挂了,马上有另一个启动。

2、Namenode是否可以有多个?namenode内存要配置多大?namenode跟集群数据存储能力有关系吗?

在非HA下只有一个,若HA情况下可以有两个,联邦机制可以有多个;

内存根据需求,一般情况下一个block块为150字节,一般服务器内存为64G,此时可以用几十G作为namenode内存可以;

有关的是datanode,namenode倒不是很大,不过要避免上传很多的小文件,因为这样会耗费namenode的数据存储,效率低。

3、文件的blocksize究竟调大好还是调小好?--结合mapreduce

要结合数据量和业务逻辑一般一个maptask保证跑50秒左右,根据业务来确认blocksize大小。

4、集群启动后,可以查看目录,但是上传文件时报错,打开web页面可看到namenode正处于safemode状态,怎么处理?

解释:

safemode是namenode的一种状态(active/standby/safemode安全模式)

namenode进入安全模式的原理:

a、namenode发现集群中的block丢失率达到一定比例时(0.01%),namenode就会进入安全模式,在安全模式下,客户端不能对任何数据进行操作,只能查看元数据信息(比如ls/mkdir)

b、如何退出安全模式?

找到问题所在,进行修复(比如修复宕机的datanode)

或者可以手动强行退出安全模式(没有真正解决问题): hdfs namenode --safemode leave

c、在hdfs集群正常冷启动时,namenode也会在safemode状态下维持相当长的一段时间,此时你不需要去理会,等待它自动退出安全模式即可

(原理:

namenode的内存元数据中,包含文件路径、副本数、blockid,及每一个block所在datanode的信息,而fsimage中,不包含block所在的datanode信息,那么,当namenode冷启动时,此时内存中的元数据只能从fsimage中加载而来,从而就没有block所在的datanode信息——>就会导致namenode认为所有的block都已经丢失——>进入安全模式——>datanode启动后,会定期向namenode汇报自身所持有的blockid信息,——>随着datanode陆续启动,从而陆续汇报block信息,namenode就会将内存元数据中的block所在datanode信息补全更新——>找到了所有block的位置,从而自动退出安全模式)

1123

1123

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?