Flink 的安装和部署

Flink 的安装和部署主要分为本地(单机)模式和集群模式,其中本地模式只需直接解压就可以使用,不以修改任何参数,一般在做一些简单测试的时候使用。本地模式在我们的课程里面不再赘述。集群模式包含:

a、 Standalone。

b、 Flink on Yarn。

c、 Mesos。

d、 Docker。

e、 Kubernetes。

f、 AWS。

g、 Goole Compute Engine。

目前在企业中使用最多的是 Flink on Yarn 模式。我们的课程中讲 Standalone 和 Flink onYarn 这两种模式。

1. 集群基本架构

Flink 整个系统主要由两个组件组成,分别为 JobManager 和 TaskManager,Flink 架构也遵循 Master-Slave 架构设计原则,JobManager 为 Master 节点,TaskManager 为 Worker(Slave)节点。所有组件之间的通信都是借助于 Akka Framework,包括任务的状态以及Checkpoint 触发等信息。

1) Client 客户端

客户端负责将任务提交到集群,与 JobManager 构建 Akka 连接,然后将任务提交到JobManager,通过和 JobManager 之间进行交互获取任务执行状态。客户端提交任务可以采用 CLI 方式或者通过使用 Flink WebUI 提交,也可以在应用程序中指定 JobManager 的 RPC网络端口构建 ExecutionEnvironment 提交 Flink 应用。

2) JobManager

JobManager 负责整个 Flink 集群任务的调度以及资源的管理,从客户端中获取提交的应用,然后根据集群中 TaskManager 上 TaskSlot 的使用情况,为提交的应用分配相应的TaskSlots 资源并命令 TaskManger 启动从客户端中获取的应用。JobManager 相当于整个集群的 Master 节点,且整个集群中有且仅有一个活跃的 JobManager,负责整个集群的任务管理和资源管理。JobManager 和 TaskManager 之间通过 Actor System 进行通信,获取任务执行的情况并通过 Actor System 将应用的任务执行情况发送给客户端。同时在任务执行过程中,Flink JobManager 会触发 Checkpoints 操作,每个 TaskManager 节点收到 Checkpoint触发指令后,完成 Checkpoint 操作,所有的 Checkpoint 协调过程都是在 Flink JobManager中完成。当任务完成后,Flink 会将任务执行的信息反馈给客户端,并且释放掉 TaskManager中的资源以供下一次提交任务使用。

3) TaskManager

TaskManager 相当于整个集群的 Slave 节点,负责具体的任务执行和对应任务在每个节点上的资源申请与管理。客户端通过将编写好的 Flink 应用编译打包,提交到 JobManager,然后 JobManager 会根据已经注册在 JobManager 中 TaskManager 的资源情况,将任务分配给有资源的 TaskManager 节点,然后启动并运行任务。TaskManager 从 JobManager 接收需要部署的任务,然后使用 Slot 资源启动 Task,建立数据接入的网络连接,接收数据并开始数据处理。同时 TaskManager 之间的数据交互都是通过数据流的方式进行的。

可以看出,Flink 的任务运行其实是采用多线程的方式,这和 MapReduce 多 JVM 进程的方式有很大的区别 Fink 能够极大提高 CPU 使用效率,在多个任务和 Task 之间通过 TaskSlot方式共享系统资源,每个 TaskManager 中通过管理多个 TaskSlot 资源池进行对资源进行有效管理。

2. Standalone 集群安装和部署

Standalone 是 Flink 的独立部署模式,它不依赖其他平台。在使用这种模式搭建 Flink集群之前,需要先规划集群机器信息。在这里为了搭建一个标准的 Flink 集群,需要准备 3台 Linux 机器,如图下所示。

1) 解压 Flink 的压缩包

2) 修改配置文件

1 进入到 conf 目录下,编辑 flink-conf.yaml 配置文件:

其中:taskmanager.numberOfTaskSlot 参数默认值为 1,修改成 3。表示数每一个TaskManager 上有 3 个 Slot。

2 编辑 conf/slaves 配置文件

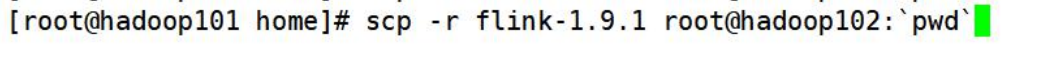

3) 分发给另外两台服务器

![]()

4) 启动 Flink 集群服务

5) 访问 WebUI

6) 通过命令提交 job 到集群

1 把上一章节中第一个 Flink 流处理案例代码打包,并上传

2 执行命令: 在执行命令之前先确保 nc -lk 8888 是否启动

其中-d 选项表示提交 job 之后,客户端结束并退出。之后输入测试数据

3 查看 job 执行结果

然后去 hadoop101 的 TaskManager 上查看最后的结果:

7) 通过 WebUI 提交 job 到集群

8) 配置文件参数说明

下面针对 flink-conf.yaml 文件中的几个重要参数进行分析:

a、 jobmanager.heap.size:JobManager 节点可用的内存大小。

b、 taskmanager.heap.size:TaskManager 节点可用的内存大小。

c、 taskmanager.numberOfTaskSlots:每台机器可用的 Slot 数量。

d、 parallelism.default:默认情况下 Flink 任务的并行度。

上面参数中所说的 Slot 和 parallelism 的区别:

a、 Slot 是静态的概念,是指 TaskManager 具有的并发执行能力。

b、 parallelism 是动态的概念,是指程序运行时实际使用的并发能力。

c、 设置合适的 parallelism 能提高运算效率。

9436

9436

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?