自然语言处理NLP星空智能对话机器人系列:Transformer 101问答集 第一问

Gavin大咖:请大家多多贡献问题,我们共同做好Transformer 101 问答,送个全世界不同国家的Transformer学习者、大学、研究机构、工业界等一份通用的礼物

Gavin大咖 Transformer 金句

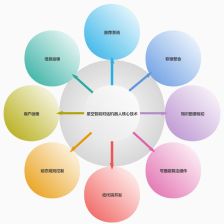

- Gavin:如果说Transformer是新一代人工智能的内核,那么作为Transformer大脑🧠的Multi-head Attention机制,就是AI核心的核心。

Gavin大咖 Transformer 第一问

- Transformer中的可训练Queries、Keys和Values矩阵从哪儿来?

要回答Gavin大咖的问题,首先我们阅读论文 《Attention Is All You Need》,从中洞察Transformer内幕机制,论文的链接地址

本文是NLP星空智能对话机器人系列的Transformer 101问答集,Gavin大咖提出Transformer中的Queries、Keys和Values矩阵来源问题。通过阅读论文《Attention Is All You Need》和简单的Python示例,解释了如何通过输入向量、初始化权重矩阵得到QKV矩阵,为理解Transformer的注意力机制提供帮助。

本文是NLP星空智能对话机器人系列的Transformer 101问答集,Gavin大咖提出Transformer中的Queries、Keys和Values矩阵来源问题。通过阅读论文《Attention Is All You Need》和简单的Python示例,解释了如何通过输入向量、初始化权重矩阵得到QKV矩阵,为理解Transformer的注意力机制提供帮助。

订阅专栏 解锁全文

订阅专栏 解锁全文

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?