返校在即,现对假期所学机器学习知识做一个小小的梳理,再前进,磨刀不误砍柴工。

线性回归的梯度下降

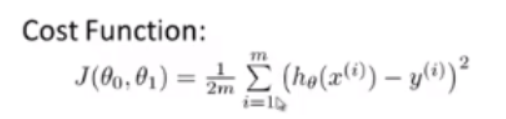

①代价函数:平方差代价函数,公式为:

J(θ) = 1/2m×Σmi=1(hθ(x(i)) - y(i)))2

👆其中,θ为假设函数hθ(x) = θT×X中的θ向量,用于存放参数,寻找到正确的参数,以最好地拟合数据集,就是线性回归要做的事情。

②代价函数的作用:平方差代价函数表示的是预测值和真实值的偏差程度,因此,想要更准确地预测数据,应该使代价函数尽可能地小,因此,由于X向量为自变量(输入值,即根据X预测y),不能更改,能做的只有改变参数θ,以找到最小地J(θ)。

应该知道,在线性回归问题中,代价函数J(θ)一定会收敛,因此不需考虑是否存在局部最低点,只需按定义更新θ即可。

③更新θ及参数的说明:

👆上式即为更新参数θ的公式,注意,要同时更新所有的θ,即,在完成所有的θi更新之前,仅将已经改变的θj暂存,所有θ更新完之后,再统一赋值。

参数α:为学习率,控制的是一次梯度下降代价函数值改变的步幅。注意,α过小会导致迭代速度过慢,过大可能会导致无法收敛ÿ

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1021

1021

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?