如今大数据各种火,看看各种招聘网址,大数据、数据挖掘起薪20W啊,各种诱惑,所以,自己也学学大数据相关。

具体大数据什么,能做什么,发展史等等,我在这里就不描述了,网上一大堆,再说,个人从来不记什么东西发展史什么的,浪费脑细胞。

本文主要是作为个人的学习笔记,如果有不对之处,欢迎指正。

首先肯定是从环境的搭建开始。

个人环境配置

| Linux | Centos7 |

| JDK | jdk7u25 |

| Hadoop | 2.5.2 |

安装步骤

1:安装SSH

使用yum install openssh-server安装ssh服务(Centos7默认已经安装ssh)

2:配置ssh免密码登陆

ssh-keygen -t rsa -P ''使用上面命令后,会在~/home/{username}/.ssh/下生成两个加密文件,id_rsa(私钥)和id_rsa.pub(公钥)。

然后进入.ssh目录,将id_rsa.pub中的内容追加到authorized_keys文件中:cat id_rsa.pub >> authorized_keys;

如果是Ubuntu,则此时已经可以使用ssh免密码登陆,如果是centos环境,则需要修改.ssh目录权限和authorized_keys权限,如下:

chmod 700 .ssh

chmod 600 authorized_keys3:安装配置JDK

jdk的安装配置此处也不在描述,相信搞java的童鞋都能搞定。

4:安装Hadoop

- 下载Hadoop(可在官方提供的镜像地址下载:http://mirror.bit.edu.cn/apache/hadoop/common/)选择hadoop-2.5.2.tar.gz下载。

- 将压缩文件解压到某目录下(tar -zxvf hadoop-2.5.2.tar.gz)。

- 添加Hadoop环境变量(vim /etc/profile,将如下内容添加到文件中)。

export HADOOP_HOME={Hadoop目录}/hadoop-2.5.2

export HADOOP_COMMON_HOME=$HADOOP_HOME

export HADOOP_HDFS_HOME=$HADOOP_HOME

export HADOOP_MAPRED_HOME=$HADOOP_HOME

export HADOOP_YARN_HOME=$HADOOP_HOME

export HADOOP_CONF_DIR=$HADOOP_HOME/etc/hadoop

export CLASSPATH=.:$HADOOP_HOME/lib:$CLASSPATH

export PATH=$HADOOP_HOME/bin:$HADOOP_HOME/sbin:$PATHsource /etc/profile- 修改Hadoop配置

进入Hadoop目录下/home/shipg/soft/hadoop/hadoop-2.5.2/etc/hadoop,修改hadoop-env.sh文件中JAVA_HOME值,如下我的配置:

export JAVA_HOME=/usr/java/jdk1.7.0_75此时,单机版Hadoop环境已经安装完成。

5:验证结果

使用Hadoop自带的wordcount来验证安装结果。首先在Hadoop跟目录下创建input目录(mkdir input),在input目录中随便拷贝一份文件进去,或者自己写些内容到此目录下,此处将README.txt拷贝进input目录。

然后执行如下命令执行单词统计:

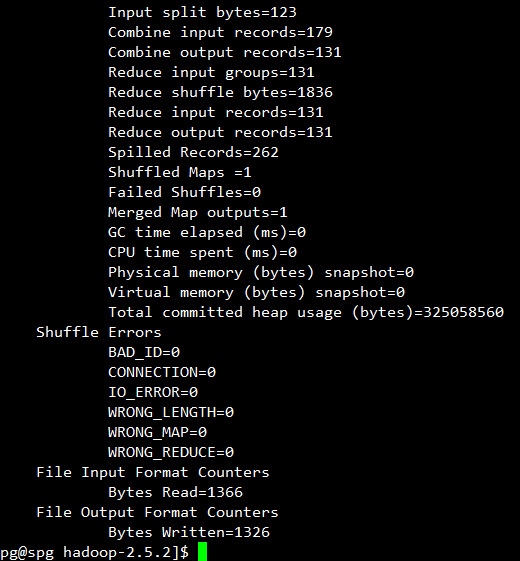

bin/hadoop jar share/hadoop/mapreduce/sources/hadoop-mapreduce-examples-2.5.2-sources.jar org.apache.hadoop.examples.WordCount input output此命令大概意思为:执行hadoop-mapreduce-example-2.5.2-sources.jar包中的WordCount类,数据源在input目录,将最终结果输出到output目录下。执行命令后可看到如下图所示表示执行成功。

此时,在Hadoop跟目录下你会发现多出了output目录,其中统计结果即放在此目录下。

cat part-r-00000

至此,Hadoop单机版即安装并验证结果完成。

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?