前提条件:

1. 以现线上集群为模拟环境,搭建一套CDH5.3的hadoop集群

参考:http://blog.csdn.net/korder/article/details/46909253

2. 执行用户

(此处以root为执行用户,真实环境另做处理)

部署:

1. 启动hadoop集群,如:38节点安装的主namenode

[root@JXQ-23-27-38 ~]# jps

31624 NameNode

23659 WebAppProxyServer

26447 Jps

32581 DFSZKFailoverController

13861 ResourceManager

11119 JobHistoryServer

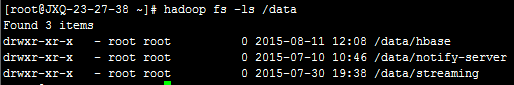

2. 以38节点为客户机做实验,上传测试数据到HDFS

3. 给root用户操作hdfs权限

su hdfs

hadoop fs -mkdir -p /xxx/data/mydata

hadoop fs -mkdir /xxx/result

hadoop fs -mkdir -p /xxx/spark/lib

hadoop fs -mkdir -p /xxx/spark/wylog

hadoop fs -chown -R root:root /xxx

4. 安装spark核心core

yum install spark-core -y

因为主要测试spark on yarn,只在提交job的38节点安装该核心core就够

5. 优化YARN模式

通常,Spark 会在每次运行 spark-submit 时将组件 JAR 文件复制到 HDFS,正如以下示例日志消息中所示:

15/07/

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1403

1403

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?