Windows下搭建spark环境

【有问题或错误,请私信我将及时改正;借鉴文章标明出处,谢谢】

参考文章:

Spark在Windows环境是如何搭建的

运行环境:

Win10 64位

Jdk 1.8.0_171

Scala 2.11.12

Hadoop 2.7.3

Winutils.exe

一:JDK的安装与环境变量的配置

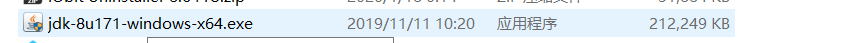

1.下载并安装jdk

到官网找到自己想要下载的jdk下载其windows版本

双击下载到自己要安装的目录下

2.jdk的环境变量配置

此电脑(右击)------>点击“属性” ------>点击”高级系统设置”------>点击”环境变量”------>在系统变量中新建

----->在PATH中添加环境变量

3.这样设置好后,便可以在任意目录下打开的cmd命令行窗口下运行下面命令。查看是否设置成功。

java -veriosn

二: Scala的安装与环境变量的配置

1.下载scala

从官网下载Scala

此处版本为scala-2.11.12

2.Scala的环境变量配置

在path下添加scala安装的目录下的bin

- 这样设置好后,便可以在任意目录下打开的cmd命令行窗口下运行下面命令。查看是否设置成功。

输入scala #显示版本进入scala编写

三: Hadoop安装与环境变量配置

1.下载hadoop

到官网下载你所需要版本hadoop

2.hadoop环境变量的配置

参考jdk与scala配置过程

- 这样设置好后,便可以在任意目录下打开的cmd命令行窗口下运行下面命令。查看是否设置成功。

hadoop -version

4.下载winutils.exe(这个文件是模拟hadoop的运行环境)

到GitHub选择你安装的Hadoop版本号,然后进入到bin目录下,找到winutils.exe文件

下载好之后放入hadoop的bin目录下

四: Spark的安装与环境变量的配置

1.下载所需版本spark

到官网

这里是spark2.3.2

找到想要下载对应版本号

2.存放Spark的文件夹右击属性取消只读不然会出错

3.Spark环境变量的配置

参考jdk与scala配置过程

- 这样设置好后,便可以在任意目录下打开的cmd命令行窗口下运行下面命令。查看是否设置成功。

spark-shell

【有问题或错误,请私信我将及时改正;借鉴文章标明出处,谢谢】

402

402

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?