深度挖掘局部注意力与动态深度卷积的联系——On the Connection between Local Attention and Dynamic Depth-wise Convolution

1、项目介绍

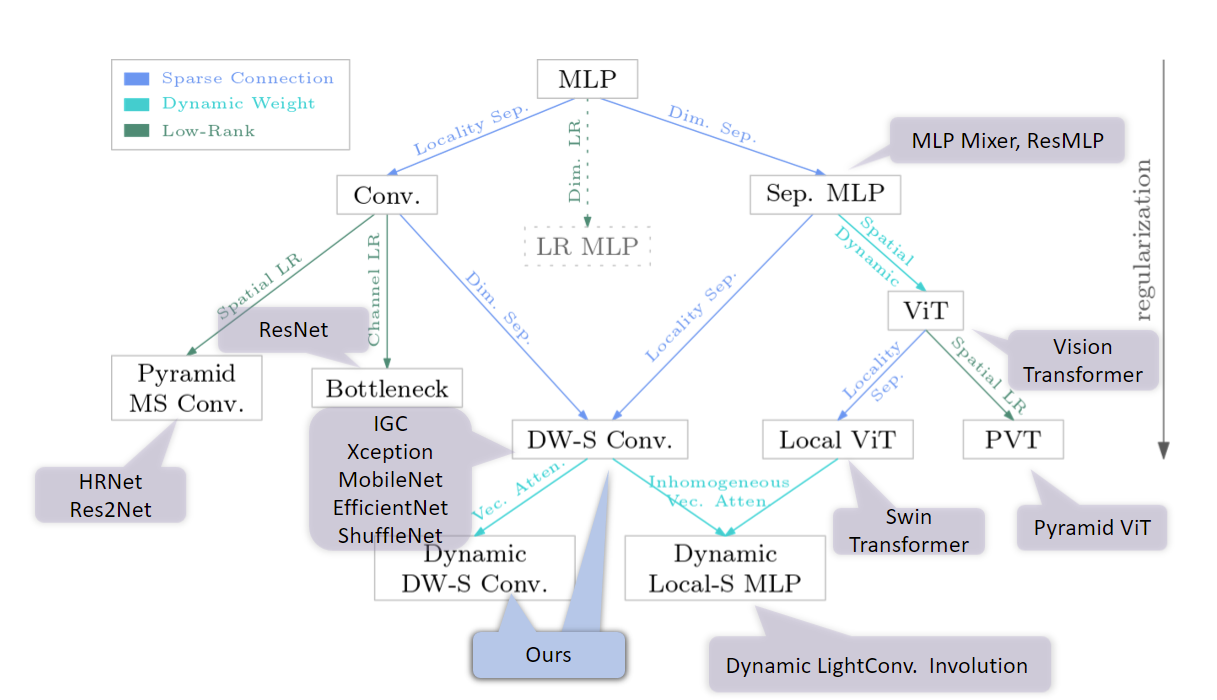

On the Connection between Local Attention and Dynamic Depth-wise Convolution,这是一个在ICLR 2022上发表的研究成果的官方PyTorch实现。该项目通过简单地用动态深度卷积替换局部自注意力,实现了与Swin Transformer相当的性能,但计算成本更低。研究的主要贡献在于对深度卷积和局部自注意力进行了理论和详细的比较,从稀疏连接性、权重共享以及动态权重三个方面进行剖析,旨在让社区重新审视这两种技术,并为基本模型架构设计提供新思路。

此外,本项目还提供了用于对象检测和语义分割的应用代码和预训练模型。

2、项目技术分析

项目基于PyTorch构建,通过将局部自我注意力模块替换成动态深度卷积,有效降低了运算负担。它揭示了局部自注意力与动态深度卷积在稀疏连接、权重共享和动态权重方面的相似性和差异性。这一创新性方法保持了模型性能的同时,显著减少了计算资源的需求。

3、项目及技术应用场景

- 图像分类:该项目已经在ImageNet数据集上训练并评估了模型,适用于大规模图像分类任务。

- 物体检测:提供了基于DWNet和dynamic DWNet的COCO数据集上的预训练模型,可以在目标检测任务中应用。

- 语义分割:支持ADE20K数据集的语义分割任务,预训练模型同样可用。

4、项目特点

- 低计算成本:通过使用动态深度卷积,实现了与Swin Transformer相当的性能,但计算效率更高。

- 全面的理论对比:论文深入探讨了局部自注意力和动态深度卷积之间的关系,提供了新颖的理解角度。

- 广泛应用:支持图像分类、物体检测和语义分割等多种计算机视觉任务。

- 开放源代码:该项目是开源的,允许开发者自由使用、修改和扩展,促进了相关领域的研究与发展。

- 易于复现:提供了详细的训练脚本和配置文件,使得实验结果可轻松复现。

总之,On the Connection between Local Attention and Dynamic Depth-wise Convolution是一个值得探索和使用的项目,尤其对于那些关注模型效率和性能平衡的研究者和开发者来说,这个项目无疑提供了一个新的视角和技术路径。立即尝试,体验更加高效且强大的计算机视觉模型吧!

3134

3134

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?