动态群组卷积:加速深度学习的高效工具

在不断推进深度学习效率的过程中,动态群组卷积(Dynamic Group Convolution, DGC) 作为一种创新的技术方案脱颖而出。由苏卓等一众学者共同研发,并在《欧洲计算机视觉会议(ECCV)》上发表,此项目带来了显著的性能提升和资源优化。本文将深入探讨这一项目,展示其如何成为加速卷积神经网络(CNNs)的一股新力量。

项目介绍

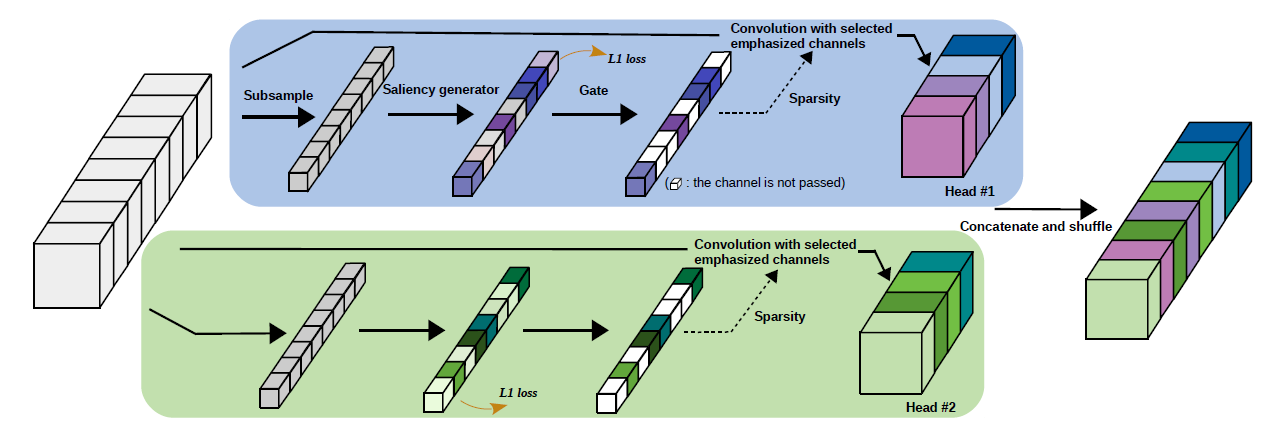

动态群组卷积是基于 CondenseNet 框架上的进一步创新。通过赋予每一群组一个小巧的特征选择器,DGC 能够根据输入图像自适应地选择要连接的输入通道部分。这种智能选择不仅增强了模型对不同输入的适应性,同时也保持了与传统群组卷积相近的计算效率,为图像分类任务提供了全新的解决方案。

技术分析

DGC 的核心在于它的动态性和高效性。它利用条件化的小型选择器来决定每个样本中的哪些通道应该被激活。这种方法的一个巧妙之处在于,仅对前向传播中选中的权重计算梯度,在反向传播时对未选中的通道设置零梯度,通过无偏门控策略确保训练过程的稳定性。此外,训练过程中采用逐步减少非关键通道的“余弦形”学习率策略,平滑过渡,避免训练损失的突然波动。

应用场景

DGC 的设计旨在广泛的应用于各种图像识别任务中,尤其是资源受限的环境。从基础的图像分类如CIFAR-10和CIFAR-100到大规模的ImageNet挑战,DGC均展现出了卓越的表现。例如,结合ResNet18架构应用于ImageNet数据集,即使大幅剪枝(55%)后,仍然能维持相当不错的准确率(Top-1错误率为31.22%,Top-5错误率11.38%)。对于需要快速响应或在边缘设备部署的AI应用而言,DGC提供了一种理想的优化途径。

项目特点

- 动态灵活性:自动选择最相关通道,提高了模型的适应性和效率。

- 保留结构:在不改变原始CNN架构的基础上,实现性能提升。

- 训练友好:无需预训练,支持端到端训练,简化了模型开发流程。

- 高效执行:拥有近似传统群组卷积的计算开销,却带来更优的性能。

- 渐进式优化:通过逐渐调整通道活跃度,平稳训练过程。

结语

动态群组卷积是面向未来深度学习模型优化的重要一步。它不仅展示了在理论研究上的突破,也为实际应用提供了强有力的工具,特别是在追求速度与精度平衡的场景下。无论是科研人员还是开发者,DGC都值得一试,它或将为您的项目带来前所未有的性能提升。记得在实施过程中访问项目仓库参与讨论,共同推动这一技术的进步。立即拥抱DGC,解锁您的模型潜能!

请注意,为了获取最佳效果并顺利运行此项目,请仔细参考提供的训练命令和环境配置说明,并鼓励积极贡献社区,分享你的使用体验或提出宝贵意见。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?