引领图像创意新潮流:探索Instruction-tuning在Stable Diffusion中的潜力

instruction-tuned-sd项目地址:https://gitcode.com/gh_mirrors/in/instruction-tuned-sd

在这个数字时代,图像处理技术和人工智能的结合正以前所未有的方式拓展我们的创造力。今天,我们要向您推荐一个名为Instruction-tuning Stable Diffusion的开源项目,它将让您对图像编辑的能力达到全新的高度。

项目介绍

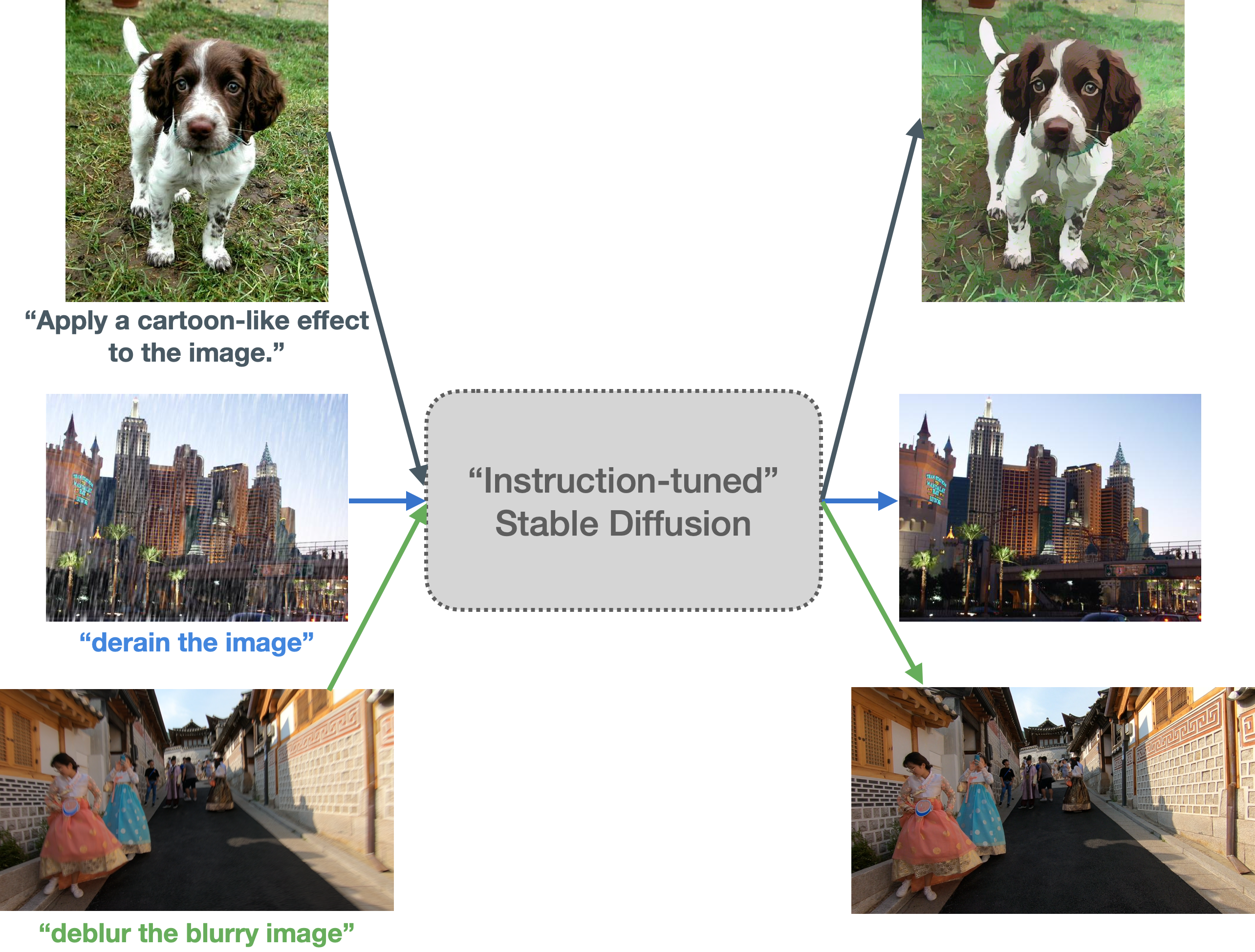

Instruction-tuning Stable Diffusion,灵感来源于FLAN和InstructPix2Pix的研究成果,旨在通过指令微调Stable Diffusion模型,实现输入图像配合特定“指令”的高级编辑操作。想象一下,只需一句话指令,就能让模型为您转换图片风格,比如轻松地将一张自然风景照转化为卡通画风。这一创新不仅简化了复杂的图像处理流程,更开启了个性化图像创作的新篇章。

技术深度解析

该项目基于监督学习的方法——指令微调,这是在语言模型领域取得突破的关键策略之一。如FLAN所展示的,经过微调的语言模型能在零样本下完成任务,而InstructPix2Pix则证明了引导图像编辑模型理解指令的可能性。项目团队利用PyTorch框架,在A100 GPU上进行了实验,借助xformers等工具以提升训练效率和内存管理,确保模型在大规模数据集上的高效运行。

应用场景探索

在创意设计、社交平台内容生成、个人照片美化乃至艺术创作中,Instruction-tuning Stable Diffusion的应用前景广阔。无论是快速批量生成特色滤镜效果的图片,还是精确执行低级别图像处理(如去雨、增色)指令,这款工具都能成为艺术家、设计师、甚至是普通用户的强大助手,释放每个人的创意潜能。

项目亮点

- 高度自定义指令:用户能通过简单的文本指令控制图像变化,赋予图像处理前所未有的灵活性。

- 广泛适用性:覆盖从卡通化到低级图像操作的各种需求,为多种场景提供了可能。

- 易于接入与扩展:基于成熟的Hugging Face生态系统,从数据准备到模型训练,提供详细指引,便于开发者和爱好者迅速上手并进行二次开发。

- 高性能与效率:利用加速库和混合精度训练,即使在资源有限的环境下也能高效训练高质量模型。

- 社区支持和共享:通过Hugging Face Hub分享模型和结果,促进社区交流与合作。

结语

Instruction-tuning Stable Diffusion项目是图像处理与自然语言处理跨界融合的一次大胆尝试,它为未来的AI辅助创意工作铺平了道路。无论是专业领域内的应用探索,还是日常生活的创意实践,这一项目的开放与成熟无疑为每一个爱好创作的人打开了一扇新的大门。现在就加入探索之旅,解锁您的图像创作潜能吧!

instruction-tuned-sd项目地址:https://gitcode.com/gh_mirrors/in/instruction-tuned-sd

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?