由于Spark是基于Scala编写的,而Scala又是依赖于Java,所以需要你先安装Scala以及JDK。有时我们需要依赖HDFS去取数据或者使用YARN集群部署,所以需要一般也需要安装Hadoop。安装JDK以及安装Sacla这里不做介绍。

1.下载Spark包

进入Spark的下载页面,选择需要下载的tgz文件。

2.下载Hadoop包

下载Spark时,我们选择的是Hadoop 2.7,所以我们进入Apache Hadoop下载页中下载对应版本的tar.gz文件

3. 安装Spark

解压下载后的文件到指定目录,然后在Path中设置你的解压目录地址。

我的地址是D:\spark-3.0.3-bin-hadoop2.7,所以在Path中添加地址D:\spark-3.0.3-bin-hadoop2.7\bin即可。完成后可以在控制台输入:spark-shell测试安装是否成功

如果你本地没有hapoop环境,会出现以下错误:

当你安装了hadoop后,该错误就没有了。

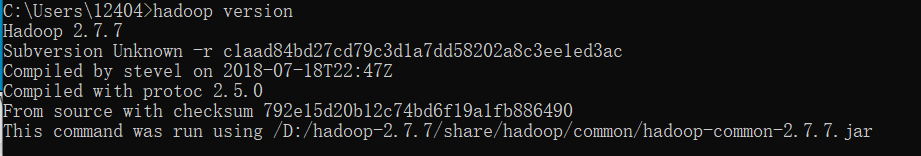

4.安装hadoop

解压下载后的文件到指定目录,在Path设置你的解压目录地址。

我的地址是D:\hadoop-2.7.7,所以在Path中添加地址D:\hadoop-2.7.7\bin即可。完成后可以在控制台输入:hadoop version测试安装是否成功

2812

2812

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?